今天起,DeepSeek V4成OpenClaw默认模型!

今天起,DeepSeek V4成OpenClaw默认模型!OpenClaw最新版本官宣,DeepSeek V4 Flash正式成为默认大模型,250k+星标的全球最火开源Agent框架,把中国最强开源AI推上了C位。

OpenClaw最新版本官宣,DeepSeek V4 Flash正式成为默认大模型,250k+星标的全球最火开源Agent框架,把中国最强开源AI推上了C位。

就在这两天,GitHub和Hugging Face社区上线了一枚医疗大模型领域的“核弹”。全球规模最大、性能最强的医疗视频理解大模型——uAI Nexus MedVLM(中文名:元智医疗视频理解大模型)开源!

作者:张小珺 2026年,大模型战争全面升级,掀开了第二幕。 在AI范式巨变之时,我访谈了人工智能研究员罗福莉。罗福莉曾供职阿里达摩院、DeepSeek,目前是小米大模型团队负责人,主导研发了MiMo

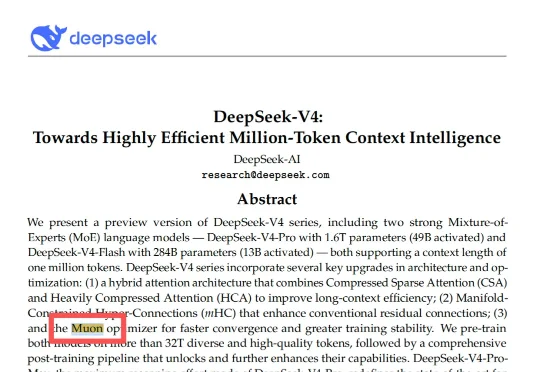

今天上午,DeepSeek V4 发布,直接把这个大模型疯狂更新月推向了最高潮。不过在我翻看 V4 的技术报告的时候,在训练层面看到了一个被大部分人滑过去的名词:Muon 优化器。

「前方智能」从知情人士处获悉,国内大模型独角兽「阶跃星辰」计划发布首款一方AI手机,最快或于今年8月正式亮相。为此,阶跃星辰还吸引了来自魅族科技、荣耀公司不少团队成员。

刚刚,混元的 Hy3 Preview 也正式亮相,这是腾讯首席 AI 科学家姚顺雨主导的一个模型。姚顺雨表示,Hy3 preview是混元大模型重建的第一步。他希望通过这次开源和发布,不断提升 Hy3 正式版的实用性,以及模型在真实场景中的综合表现,并开始探索特色模型能力。

一位接近DeepSeek的一线机构投资人士告诉我们,这些数字都不准确,DeepSeek融前估值是3000亿人民币,约合440亿美元。这一估值超过当前已经上市的大模型公司Minimax的2400亿(4月23日),接近智谱的3800亿元。

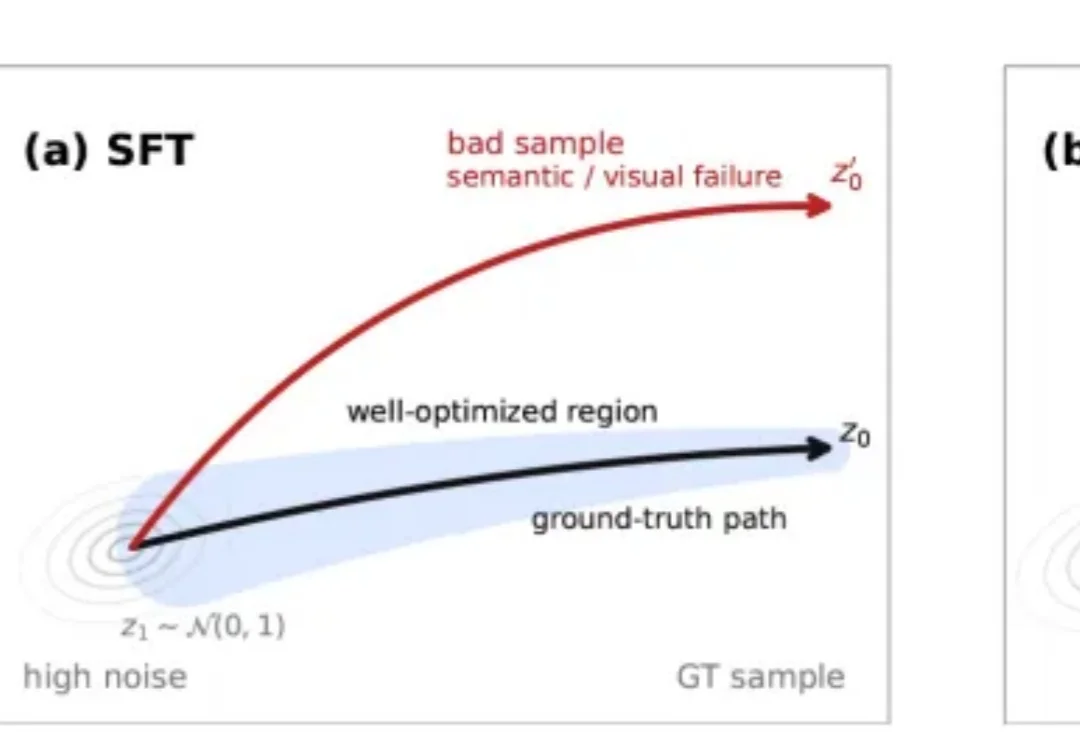

近日,腾讯混元团队提出HY-SOAR (Self-Correction for Optimal Alignment and Refinement),一种面向扩散模型和流匹配模型的数据驱动后训练方法。

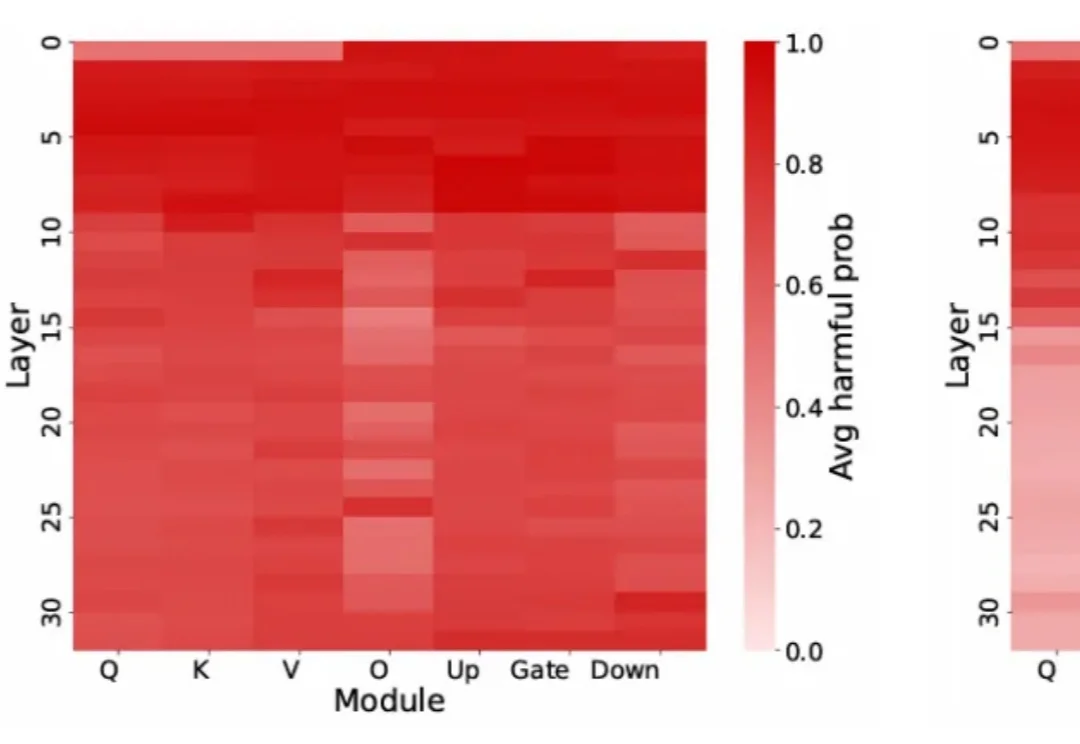

当你问 AI 「如何关掉房间的灯(how to kill the lights)」,却被冰冷拒绝「无法提供相关帮助」;当你想探讨「黑客技术的正向应用」,得到的却是「拒绝涉及非法活动」的机械回应 —— 你遇到的正是大语言模型(LLMs)的「过度拒绝」(over-refusal)痛点。

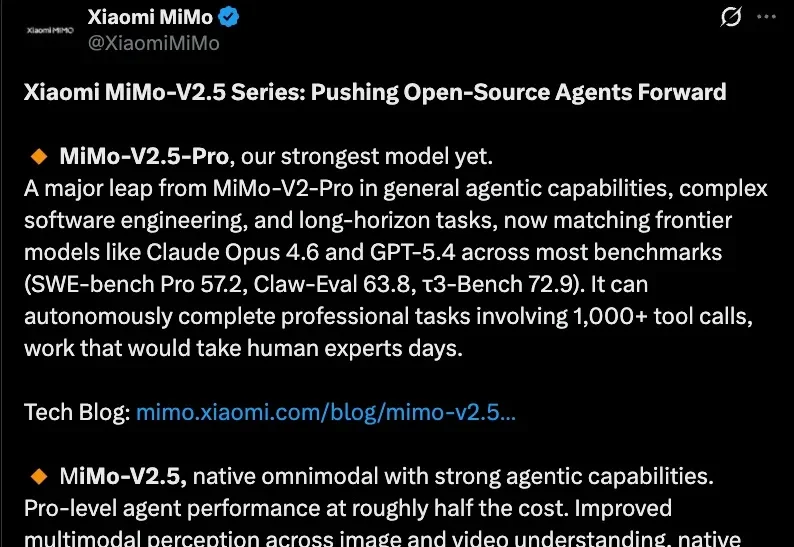

小米大模型时隔一月能力飙涨,比Kimi K2.6省42% Token。