Llama 3.1正式发布:4050亿参数模型开源,小扎:把开源进行到底

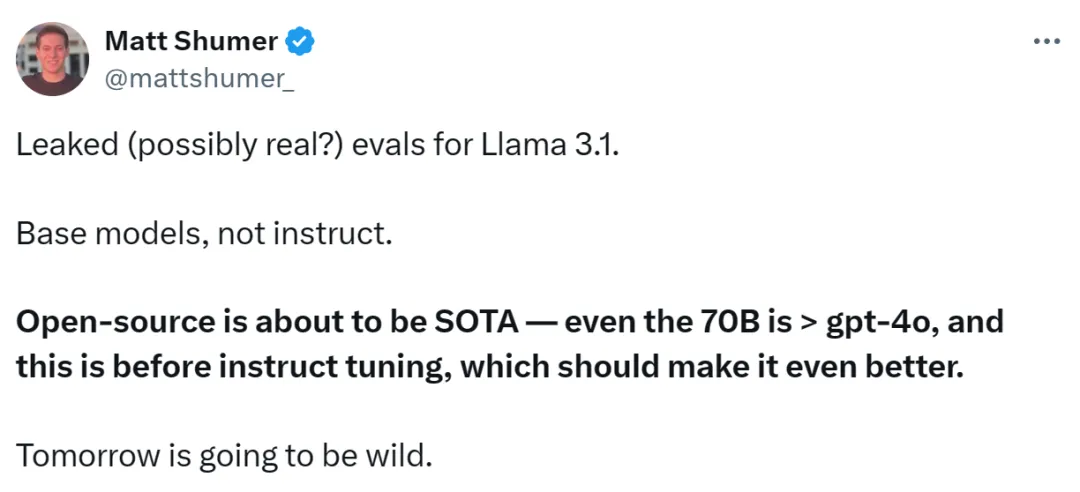

Llama 3.1正式发布:4050亿参数模型开源,小扎:把开源进行到底GPT-4o的王座还没坐热乎,小扎率领开源大军火速赶到——

GPT-4o的王座还没坐热乎,小扎率领开源大军火速赶到——

就在刚刚,Meta 如期发布了 Llama 3.1 模型。

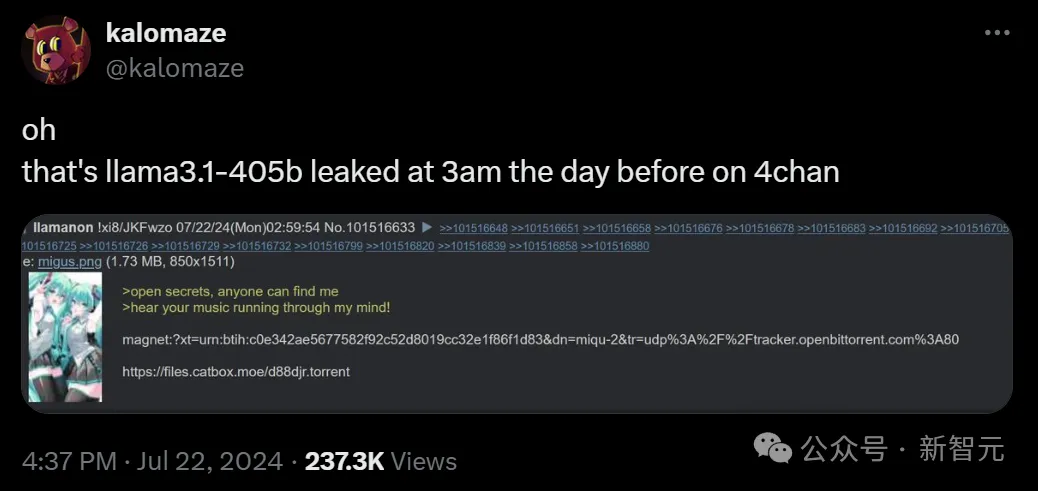

Llama 3.1 终于现身了,不过出处却不是 Meta 官方。

当今的LLM已经号称能够支持百万级别的上下文长度,这对于模型的能力来说,意义重大。但近日的两项独立研究表明,它们可能只是在吹牛,LLM实际上并不能理解这么长的内容。

Llama 3.1又被提前泄露了!开发者社区再次陷入狂欢:最大模型是405B,8B和70B模型也同时升级,模型大小约820GB。基准测试结果惊人,磁力链全网疯转。

苹果最新杀入开源大模型战场,而且比其他公司更开放。 推出7B模型,不仅效果与Llama 3 8B相当,而且一次性开源了全部训练过程和资源。大模型,AI,苹果AI,苹果开源模型

小模型成趋势?

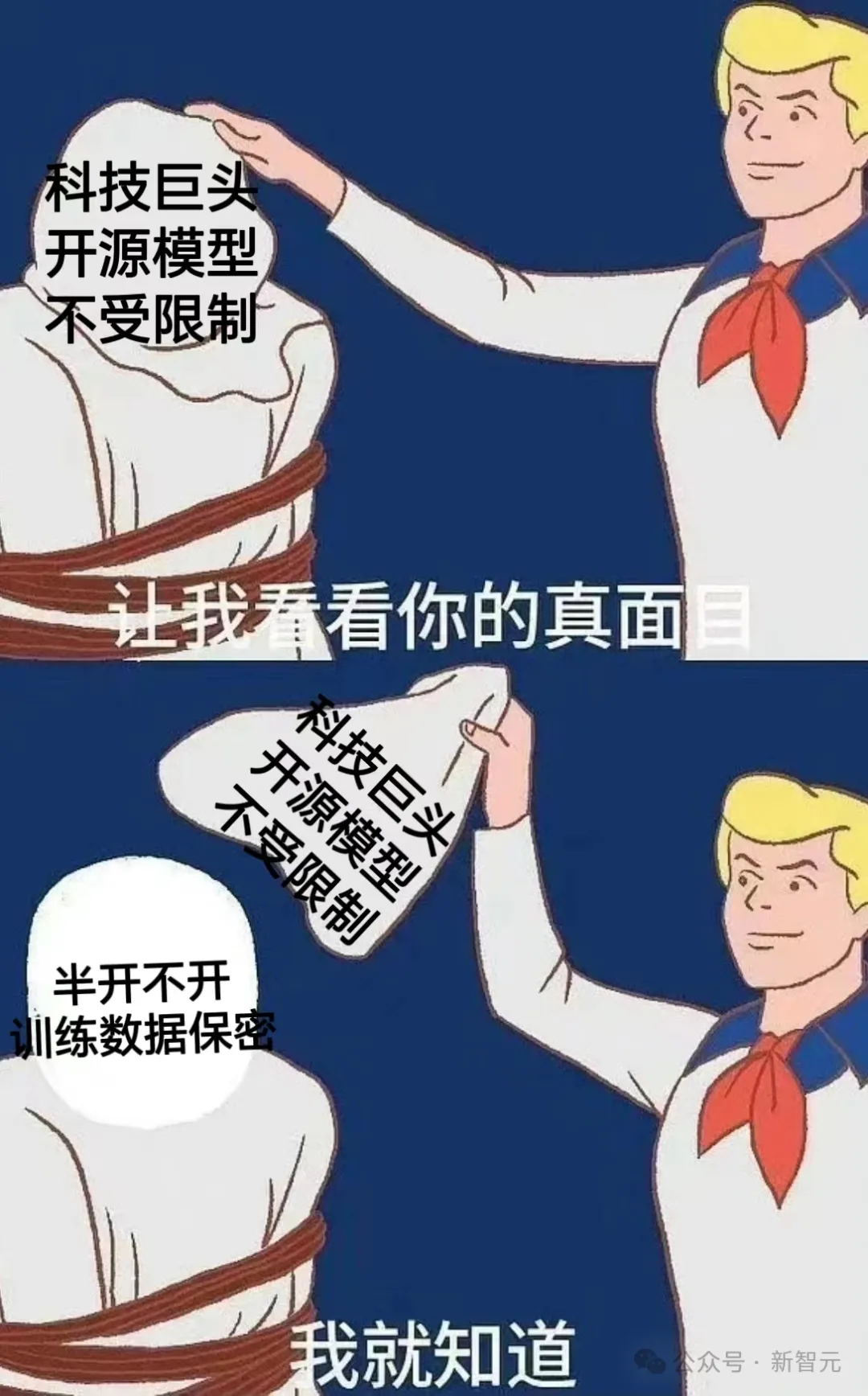

大模型开源的热潮下,隐藏着诸多问题,从定义的模糊到实际开放内容的局限性,Lecun再陷Meta大模型是否真开源的质疑风波只是冰山一角。

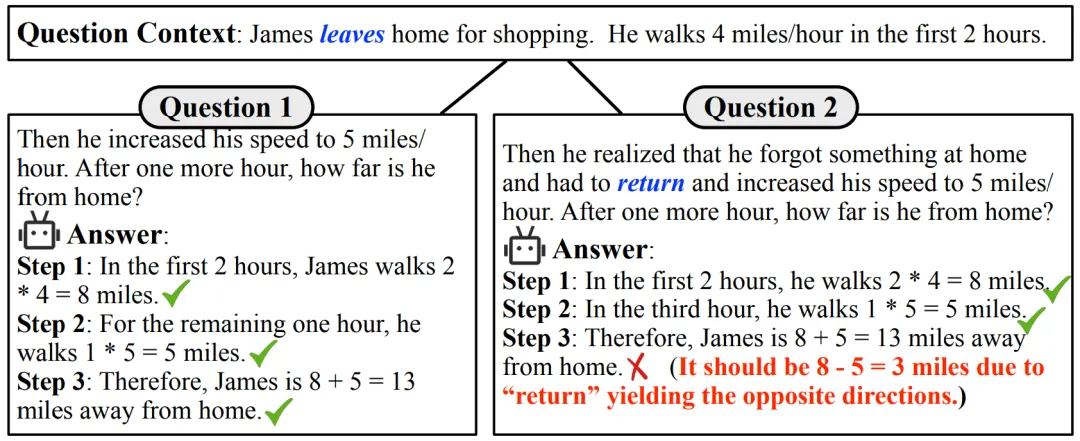

大型语言模型(LLMs)在解决问题方面的非凡能力日益显现。最近,一个值得关注的现象是,这些模型在多项数学推理的基准测试中获得了惊人的成绩。以 GPT-4 为例,在高难度小学应用题测试集 GSM8K [1] 中表现优异,准确率高达 90% 以上。同时,许多开源模型也展现出了不俗的实力,准确率超过 80%。

在国内市场,这既是技术之争、其实也是路线之争。