拿下全球最大临床数据库,微软甩出王炸模型!CEO放话:医疗才是AI最重要的赛道

拿下全球最大临床数据库,微软甩出王炸模型!CEO放话:医疗才是AI最重要的赛道官宣全球顶尖医院,微软要为AI医疗定制一款大模型!

搜索

搜索

官宣全球顶尖医院,微软要为AI医疗定制一款大模型!

训练大模型时,工程师绝对不会指望网络做一次前向传播就能收敛。它需要数据喂养、Batch切分、学习率控制、验证集筛选以及优化器状态的迭代试错。

Claude Mythos就用6.1×10²⁷ FLOPs提前叩响了奇点的大门。

在上午 11 点开始的英伟达 GTC Taibei 2026 大会现场,黄仁勋拿出了英伟达与微软联手打造的 PC 产品。在细数了将近 1 个小时已有成果之后,黄仁勋终于开讲今天的重头戏:一款迄今为止全球性能最强、能效最高的轻薄型 Windows PC。

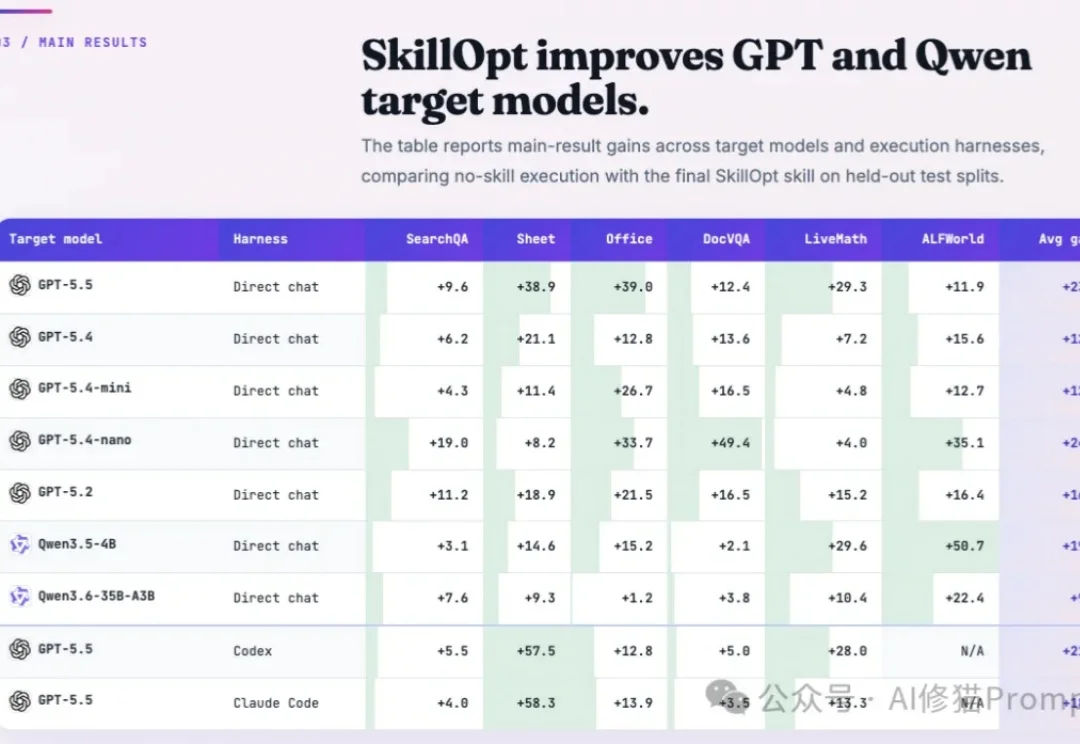

从大模型的提示词到智能体的 Skills,看着进化了,但又没有完全进化。

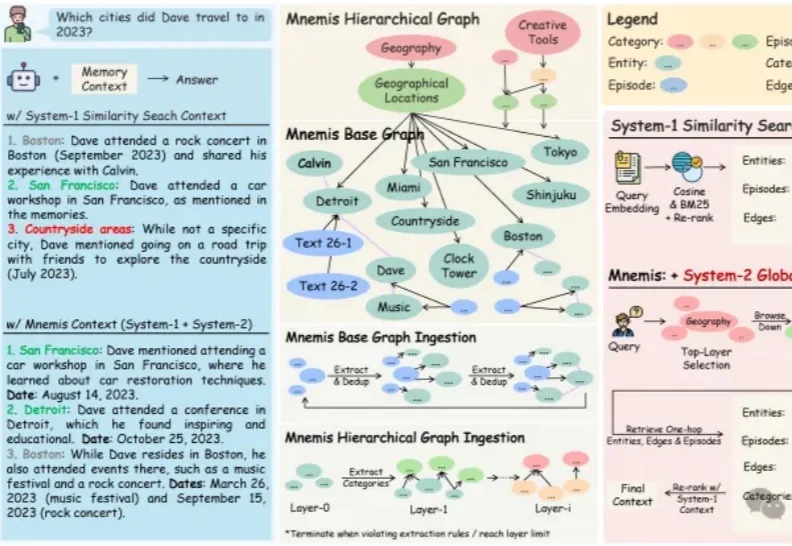

随着大语言模型在各类应用中加速落地,一个核心技术瓶颈日益凸显——AI始终缺乏真正的长期记忆能力。当前主流的RAG(检索增强生成)方案依赖语义相似度检索历史信息,但“语义相似”并不等于“真正相关”,常常出现检索结果不完整、无法区分信息相关性、缺乏推理能力等问题。

OpenAI联手Broadcom造芯片,想摆脱对英伟达的单一依赖,却在关键一步上,仍被微软卡了脖子。

微软工程师们,天塌了!昨天, 微软工程师们还在用Anthropic的Claude Code狂飙代码、改代码库、跑代理,今天就被一纸通知:6月底前必须全部下线,强制转向自家GitHub Copilot CLI!这不是小打小闹,是微软多个部门集体断供Claude Code。

扩散模型杀进了文本生成的地盘,而巨头们为了抢它,已经打起来了。

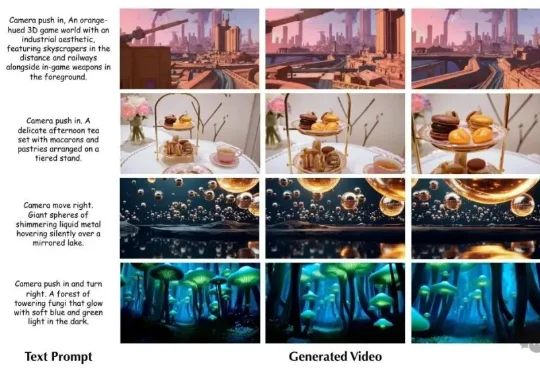

浙大联合微软亚洲研究院最新提出的World-R1,不改架构、不要3D数据,纯靠强化学习就让视频生成模型学会了“理解”三维世界。World-R1 的出发点很简单:预训练的视频模型里面已经有 3D 知识了,只是“沉睡”着。用强化学习把它叫醒就行。