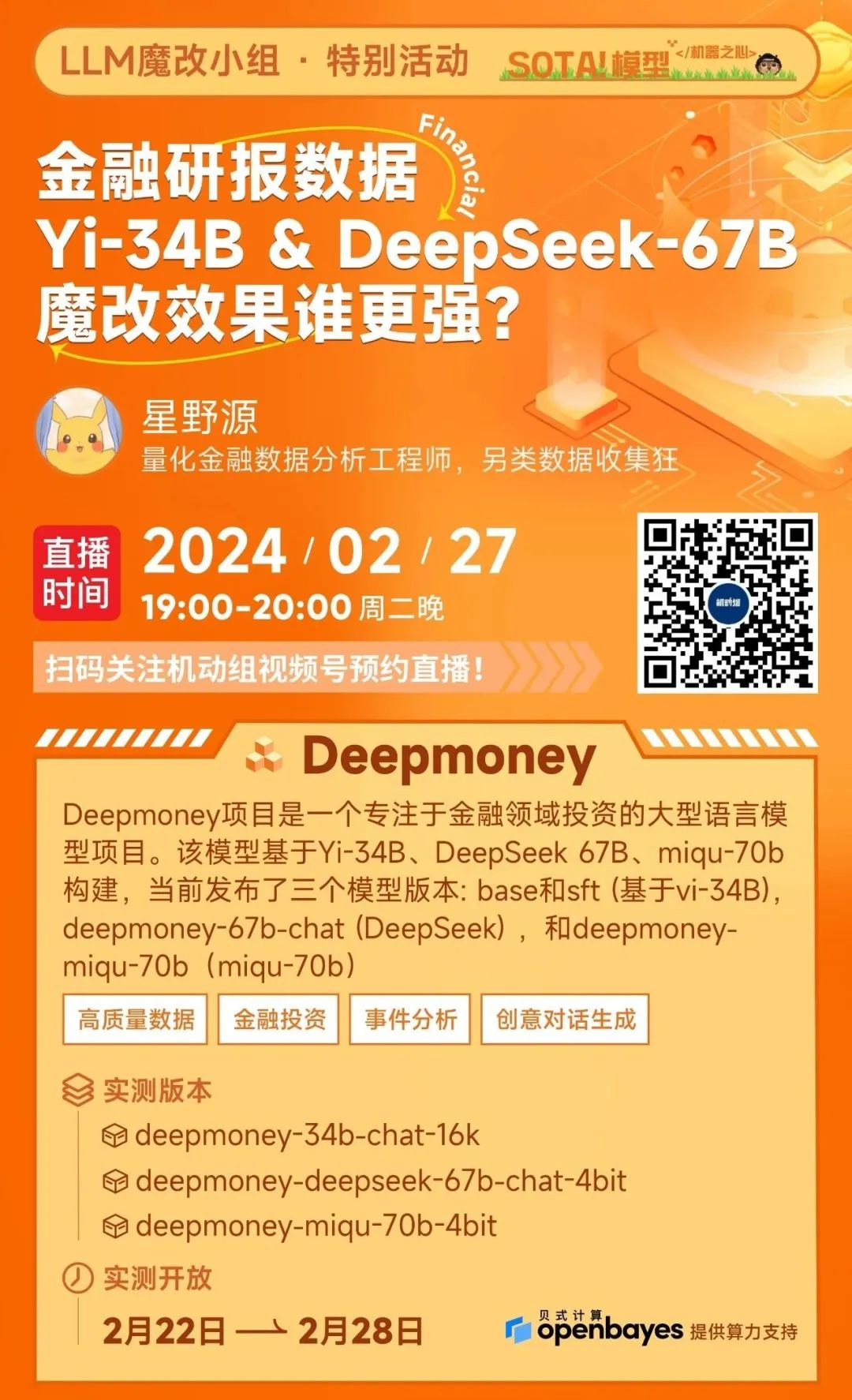

金融研报数据魔改Yi-34B & DeepSeek 67B 谁更强? Deepmoney金融大模型魔改方案分享&在线实测

金融研报数据魔改Yi-34B & DeepSeek 67B 谁更强? Deepmoney金融大模型魔改方案分享&在线实测在微调大型模型的过程中,一个常用的策略是“知识蒸馏”,这意味着借助高性能模型,如GPT-4,来优化性能较低的开源模型。这种方法背后隐含的哲学理念与logos中心论相似,把GPT-4等模型视为更接近唯一的逻辑或真理的存在。

在微调大型模型的过程中,一个常用的策略是“知识蒸馏”,这意味着借助高性能模型,如GPT-4,来优化性能较低的开源模型。这种方法背后隐含的哲学理念与logos中心论相似,把GPT-4等模型视为更接近唯一的逻辑或真理的存在。

本文总结了关于Sora的四点启发,包括视觉数据训练出更强的泛化能力、OpenAI的Scaling Law路线、与AGI的第一次亲密接触以及OpenAI的宣传策略。

简单粗暴的理解,就是语言能力足够强大之后,它带来的泛化能力直接可以学习图像视频数据和它体现出的模式,然后还可以直接用学习来的图像生成模型最能理解的方式,给这些利用了引擎等已有的强大而成熟的视频生成技术的视觉模型模块下指令,最终生成我们看到的逼真而强大的对物理世界体现出“理解”的视频。

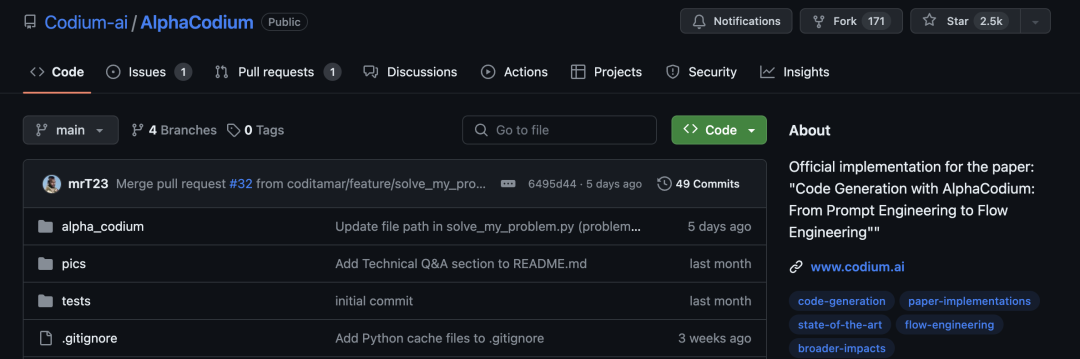

Karpathy力推代码生成任务增强流程,让GPT-4在CodeContests从19%提升到44%,不用微调不用新数据集训练,让大模型代码能力大幅提升。

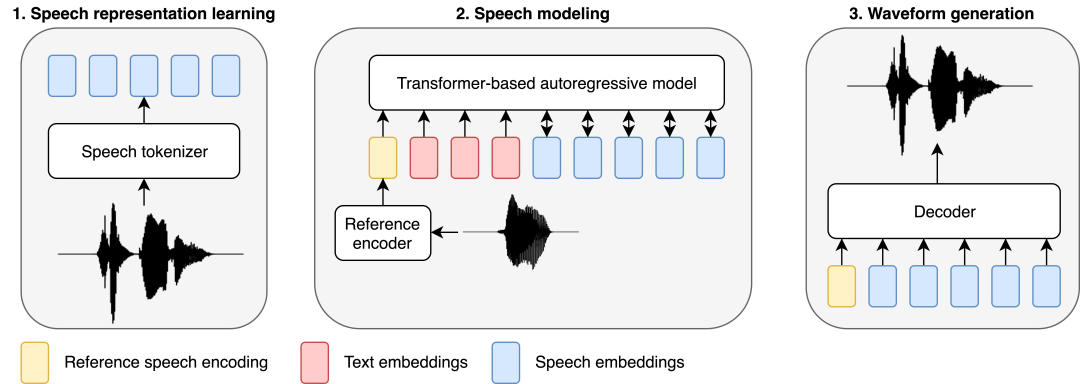

伴随着生成式深度学习模型的飞速发展,自然语言处理(NLP)和计算机视觉(CV)已经经历了根本性的转变,从有监督训练的专门模型,转变为只需有限的明确指令就能完成各种任务的通用模型

分布式强化学习是一个综合的研究子领域,需要深度强化学习算法以及分布式系统设计的互相感知和协同。考虑到 DDRL 的巨大进步,我们梳理形成了 DDRL 技术的展历程、挑战和机遇的系列文章。

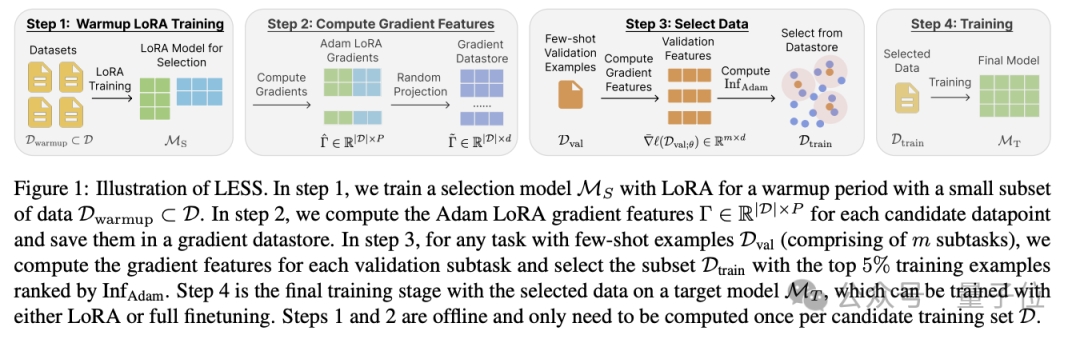

造大模型的成本,又被打下来了!这次是数据量狂砍95%的那种。陈丹琦团队最新提出大模型降本大法——数据选择算法LESS, 只筛选出与任务最相关5%数据来进行指令微调,效果比用整个数据集还要好。

国外网站AIPRM收集了100多项ChatGPT统计数据,考察了ChatGPT的增长、使用和公众意见等各项数据。上线一年多以后ChatGPT真的成茶叶蛋了吗?

在AI大模型初创企业普遍还处于入不敷出、疯狂烧钱的阶段时,一家专注于AI数据服务的初创企业已经赚得盆满钵满,成为收入最高的AI创业公司之一。

印度土豪们一出手就是5亿!直接预订英伟达上千块高价GPU。