MiniMax 财报发布:首份大模型成绩单

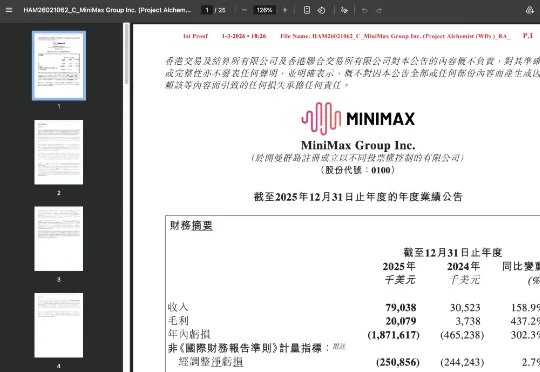

MiniMax 财报发布:首份大模型成绩单今天(3月2日),MiniMax(00100.HK)发布了2025年全年业绩。这是全球第一份来自独立大模型创业公司的年报,数字先给:总收入 $7,904万,同比 +158.9%,毛利率 25.4%,净亏损(经过调整) $2.51亿,去年同期 $2.44亿,变化不大

今天(3月2日),MiniMax(00100.HK)发布了2025年全年业绩。这是全球第一份来自独立大模型创业公司的年报,数字先给:总收入 $7,904万,同比 +158.9%,毛利率 25.4%,净亏损(经过调整) $2.51亿,去年同期 $2.44亿,变化不大

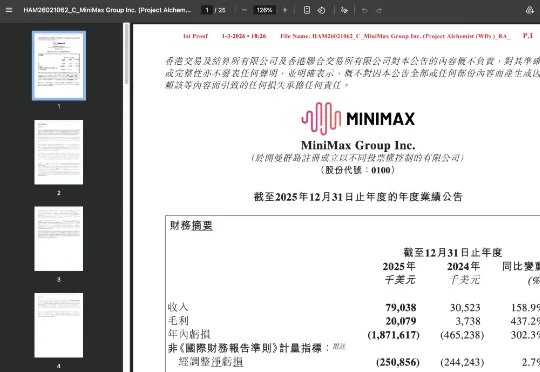

在AI自主挖洞这块试金石上,国产安全智能体完成了一次“溢出式”对标。最近,Anthropic官方披露了Claude Code Security(基于最新的Claude Opus 4.6模型)在实际项目中的战果:

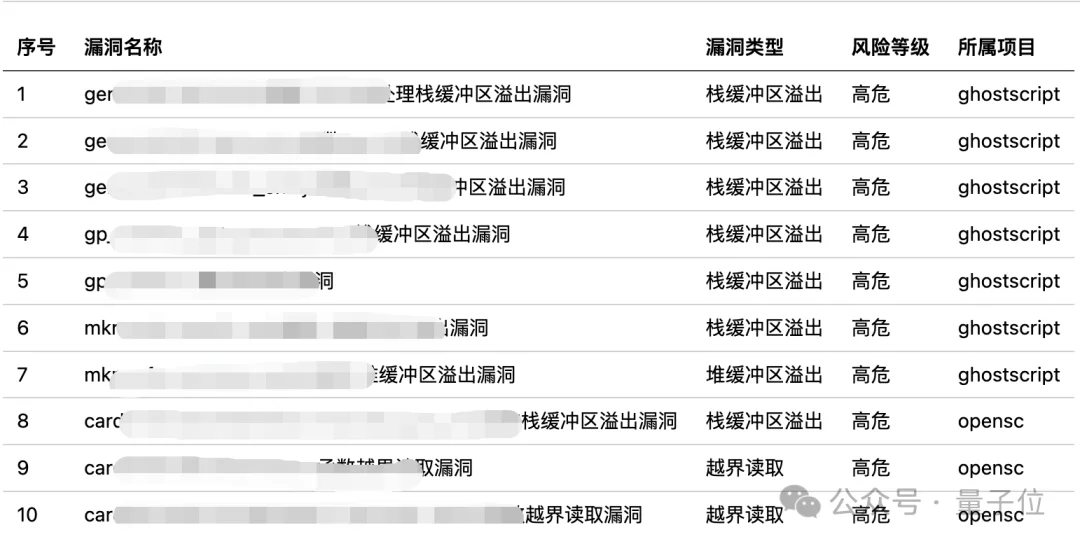

香港科技大学 PEI-Lab 与字节跳动 Seed 团队近期提出的 WMPO(World Model-based Policy Optimization),正是这样一种让具身智能在 “想象中训练” 的新范式。该方法无需在真实机器人上进行大规模强化学习交互,却能显著提升策略性能,甚至涌现出 自我纠错(Self-correction) 行为。

自2011年成立九合创投,此后15年间,他带着团队坚持做科技领域的早期投资,陆续投了几十个智能化相关的项目——机器人软硬件通用底座提供商地瓜机器人、工业具身智能底座系统及基础设施墨影科技、陪伴机器人研发生产商赋之科技、外骨骼机器人科技公司傲鲨智能,以及自动驾驶领域独角兽Momenta,大模型智

近日, Anthropic 和斯坦福研究者 Neil Rathi 与这位传奇研究者联合发布了一篇新论文,并得到了一些相当惊人的新发现。在这项研究中,他们挑战了当前大模型安全领域的一个核心假设。长期以来,业界普遍认为要在模型发布后通过 RLHF 或微调来限制其危险行为。但 Neil Rathi 和 Alec Radford 提出了一种更本质的解法:

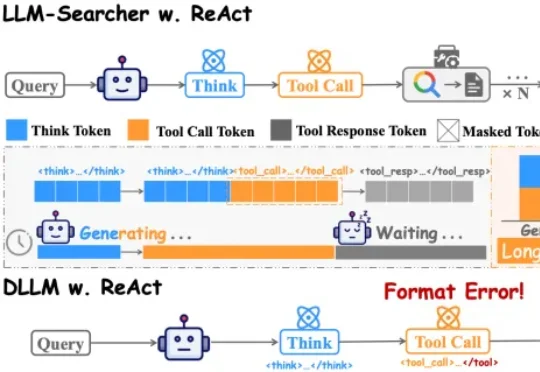

中国人民大学团队在论文DLLM-Searcher中,第一次让扩散大语言模型(dLLM)学会了这种“一心二用”的本事。目前主流的搜索Agent,不管是Search-R1还是R1Searcher,用的都是ReAct框架。这个框架的执行流程是严格串行的:

我们开源的 Open Cowork,正是一次面向 “桌面端虚拟同事” 的实践:一键安装、无需写代码,让模型在安全沙箱里操作你的工作空间,既能产出 PPT/Word/Excel/PDF 等专业成果,也能通过 GUI 直接操作电脑完成更复杂更通用的跨应用流程。

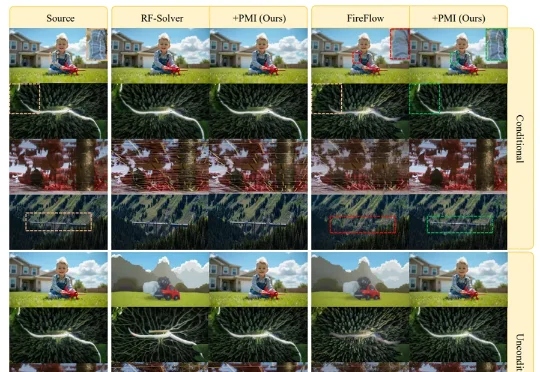

现有Rectified Flow(RF)模型在反演阶段面临的核心挑战,是逆向ODE对微小误差高度敏感,容易沿着数值不稳定方向偏离前向流形,导致轨迹发散、重建不一致、编辑不可控。为解决这一问题,团队提出PMI(Prox-Mean-Inversion),一种针对RF反演稳定性的轻量化修正机制。

昨天,我们报道了「OpenAI 光速滑跪,背刺 Anthropic,高调签下军方大单」的新闻。今天,这一事件又有了新进展 ——OpenAI 公布了他们与五角大楼协议的部分内容,声称签的合同能够确保他们的 AI 模型不被用于大规模监控美国公民和自动化武器,和 Anthropic 之前提供的方案「很不一样」。

你以为你在用AI编程?其实你只是在陪它聊天!Claude Code内部指南曝光,别再和它玩你问我答了,它比你想象中更懂怎么修Bug。