多模态DeepResearch,成了!

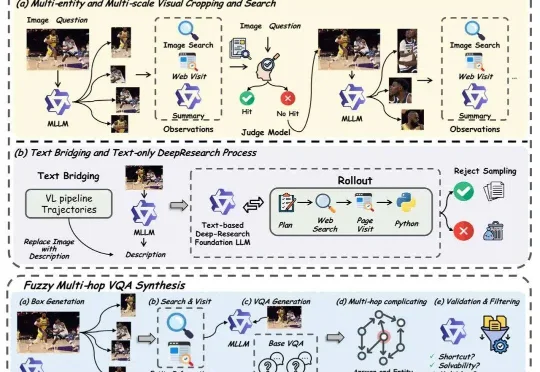

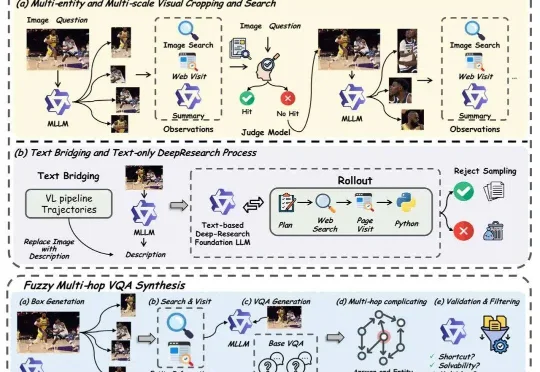

多模态DeepResearch,成了!DeepResearch 的价值在于把「查资料」变成「做研究」:不是搜到一条就回答,而是会连续多轮地提出问题、去不同地方找证据、互相对照核实、再把信息整理成结构清晰的结论。这样做能显著降低「凭感觉瞎编

DeepResearch 的价值在于把「查资料」变成「做研究」:不是搜到一条就回答,而是会连续多轮地提出问题、去不同地方找证据、互相对照核实、再把信息整理成结构清晰的结论。这样做能显著降低「凭感觉瞎编

好好好,年刚过完,「龙虾肉」就先被Kimi夹走了一口。一周前刚上线支持一键部署的Kimi Claw,转头就在OpenClaw模型调用榜上冲到TOP1。Kimi近20天的收入,直接卷过去年全年,估值一路飙至700亿元。

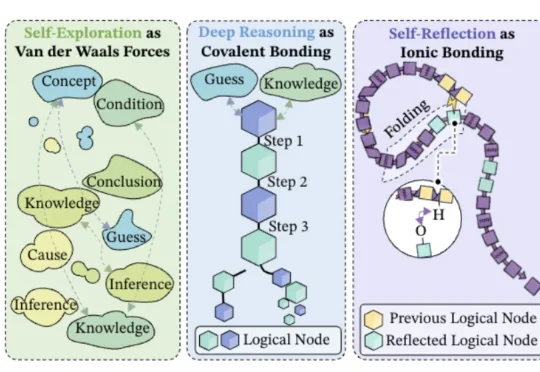

字节Seed都开始用化学思想搞大模型了——深度推理是共价键、自我反思是氢键、自我探索是范德华力?!

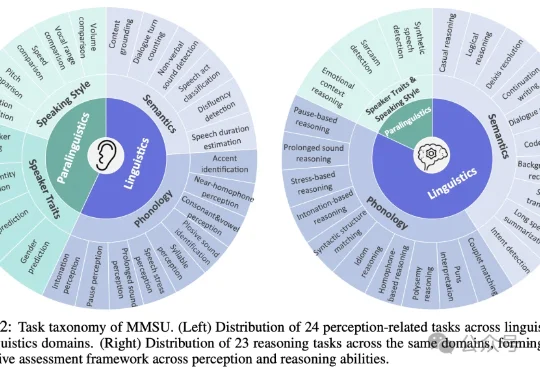

随着多模态大模型能力不断扩展,语音大模型(SpeechLLMs) 已从语音识别走向复杂语音交互。然而,当模型逐渐进入真实口语交互场景,一个更基础的问题浮现出来:我们是否真正定义清楚了「语音理解」的能力边界?

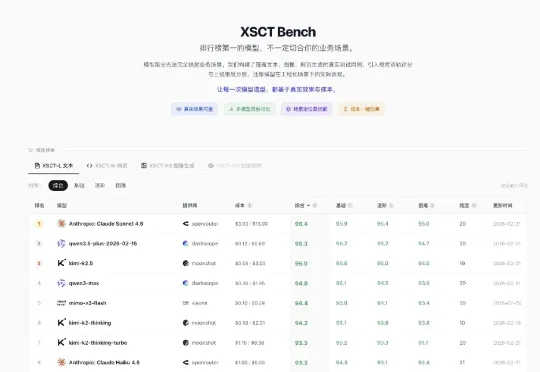

春节闭关五天,我做了个东西:一个大模型场景化测评平台。35000+ 次模型跑测,一共 42+ 模型,11,000 块人民币。我全部跑完了,结论汇成一个平台,还会持续更新。

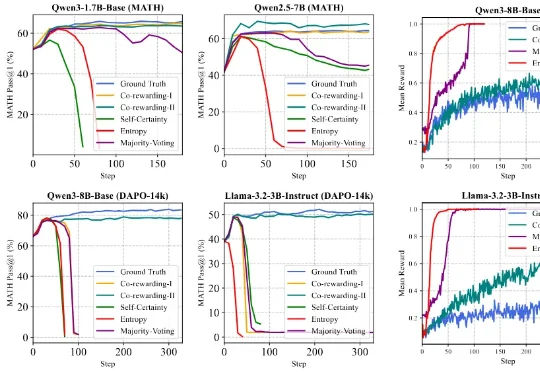

针对这一挑战,来自香港浸会大学和上海交通大学的可信机器学习和推理组提出了一个全新的自监督 RL 框架 ——Co-rewarding。该框架通过在数据端或模型端引入互补视角的自监督信号,稳定奖励获取,提升 RL 过程中模型奖励投机的难度,从而有效避免 RL 训练崩溃,实现稳定训练和模型推理能力的诱导。

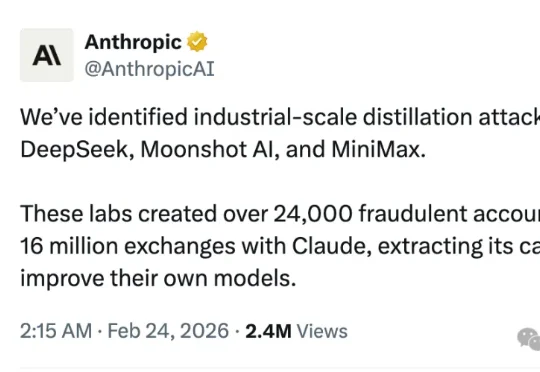

刚刚, Anthropic 发推称,DeepSeek、Moonshot AI和MiniMax三家国内的 AI 公司对Claude进行大规模的蒸馏攻击。OK, A 社你真的很讨厌中国公司了。简单说就是:这三家公司用大量假账号,疯狂地向 Claude 提问,然后拿 Claude 的回答去训练自己的模型。

今天早上,Google Labs发布了Pomelli最新功能Photoshoot,我们可以从一张产品图片出发,轻松制作高质量定制品牌照片,用于产品营销。Pomelli是Google Labs联合Google DeepMind于2025 年10月推出的AI营销工具实验项目,底层驱动模型为Nano Banana,专为中小企业设计。

机器之心发布 本文作者为摩尔线程天使投资人、中国初代AI投资人王捷。他于 2025 年 8 月和 12 月分别发表了《浮现中的AI经济》 、《关于AI经济的四十个问题》 两篇文章,对即将到来的 AI

春节前,千寻完成近 20 亿元人民币两轮融资,估值突破 100 亿元,新股东包括云锋基金、混沌投资、红杉中国等财务机构,Synstellation Capital、TCL 创投、明荟投资(汇川技术董事长家办)等产投方,重庆产业投资母基金、杭州金投等国资;顺为、Prosperity7、达晨财智等老股东也继续投资。