上下文记忆力媲美Genie3,且问世更早:港大和可灵提出场景一致的交互式视频世界模型

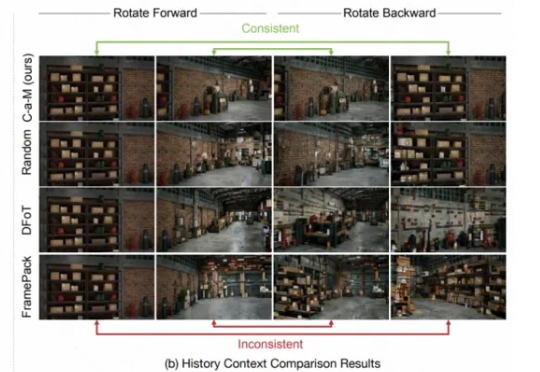

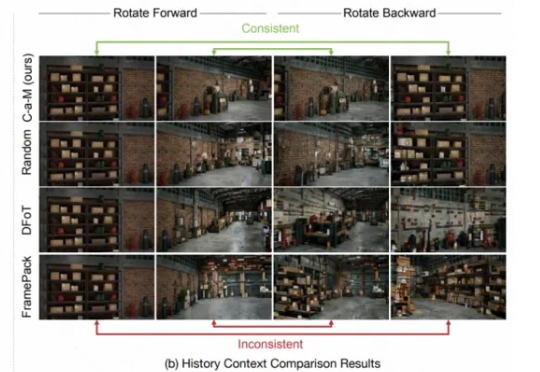

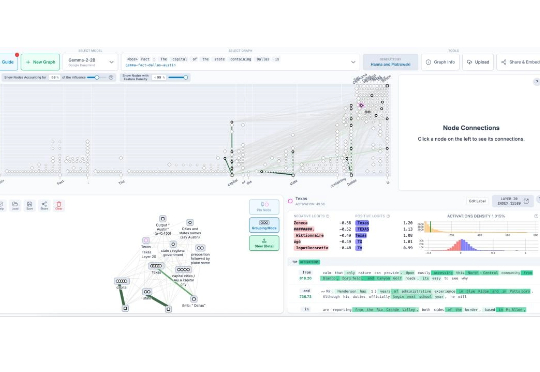

上下文记忆力媲美Genie3,且问世更早:港大和可灵提出场景一致的交互式视频世界模型要让视频生成模型真正成为模拟真实物理世界的「世界模型」,必须具备长时间生成并保留场景记忆的能力。然而,交互式长视频生成一直面临一个致命短板:缺乏稳定的场景记忆。镜头稍作移动再转回,眼前景物就可能「换了个世界」。

要让视频生成模型真正成为模拟真实物理世界的「世界模型」,必须具备长时间生成并保留场景记忆的能力。然而,交互式长视频生成一直面临一个致命短板:缺乏稳定的场景记忆。镜头稍作移动再转回,眼前景物就可能「换了个世界」。

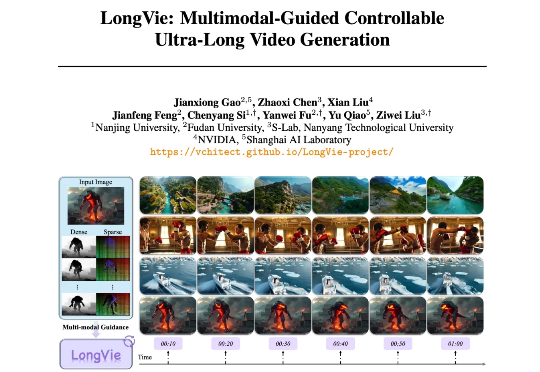

从 Sora 的惊艳亮相到多款高性能开源模型的诞生,视频生成在过去两年迎来爆发式进步,已能生成几十秒的高质量短片。然而,要想生成时长超过 1 分钟、内容与运动可控、风格统一的超长视频,仍面临巨大挑战。

您可能已经在产品里放进了问答、总结、甚至自动报表模块,但表格一上来,体验就变味了,这不奇怪。表格是二维、带结构、还经常跨表跨文,和纯文本完全不一样;项目作者在《Tabular Data Understanding with LLMs》里把这件事掰开揉碎,从输入表示到任务版图,再到评测与未来方向都梳理清楚了。

智东西8月20日报道,8月16日,Anthropic最新一期官方油管视频上线,三位AI研究员抽丝剥茧,深入探讨AI研究不应避开的一个关键“谜团”——大模型究竟是怎么思考的?

AI吃播视频合成虚幻食物内容,快速走红成为流量热点,用户通过其解压助眠获得成瘾体验。创作者利用平台激励和售卖提示词、课程实现盈利,而AI大厂如OpenAI持续亏损。模型如快手可灵商业化成功,从会员订阅中获利。

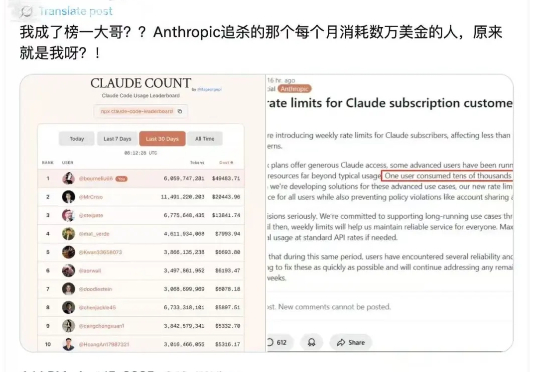

众所周知,前不久 Anthropic 宣布对用户实行每周速率限制。其中,在解释原因时,Anthropic 提到“虽然 Pro 和 Max 套餐提供了充足的 Claude 访问权限,但一些高级用户却全天候不间断地运行 Claude,消耗的资源远远超出了正常使用量。一位用户在 200 美元的套餐中消耗了数万个模型使用量。”

大模型与多模态之间的关系,可以理解为大模型就像是人脑中的‘前额叶’,主要负责高级认知功能,但只有前额叶的大脑是无法处理复杂任务的,这就需要多个不同模型之间互相协调,从单纯的“前额叶”走向“完整的大脑”,从而处理更加复杂的现实任务。

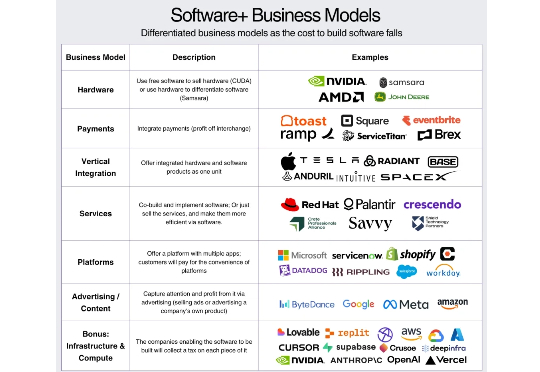

当我看到 Cursor、Claude Code、Lovable 这些 AI 编程工具的出现,以及它们正在以惊人的速度降低软件开发成本时,我意识到我们正站在一个历史转折点上。这不仅仅是开发效率的提升,而是整个软件行业商业逻辑的根本性重构。

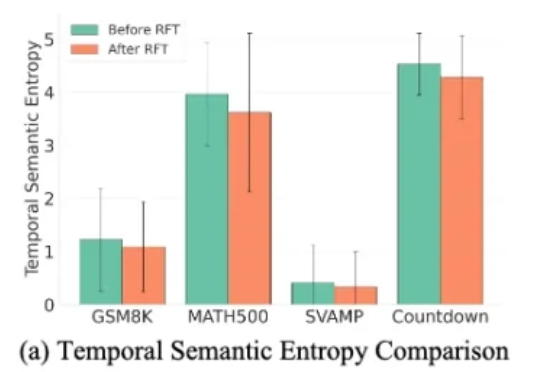

近年来,扩散大语言模型(Diffusion Large Language Models, dLLMs)正迅速崭露头角,成为文本生成领域的一股新势力。与传统自回归(Autoregressive, AR)模型从左到右逐字生成不同,dLLM 依托迭代去噪的生成机制,不仅能够一次性生成多个 token,还能在对话、推理、创作等任务中展现出独特的优势。

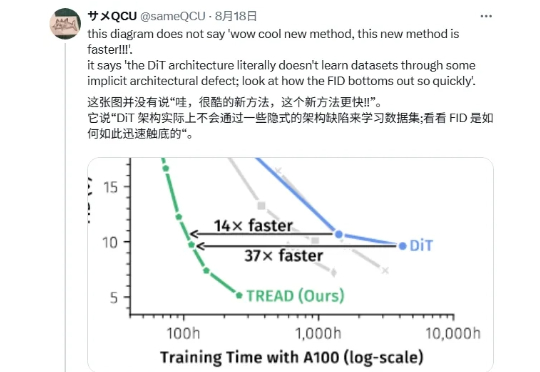

「兄弟们,DiT 是错的!」 最近一篇帖子在 X 上引发了很大的讨论,有博主表示 DiT 存在架构上的缺陷,并附上一张论文截图。