ACM MM 2025 | EventVAD:7B参数免训练,视频异常检测新SOTA

ACM MM 2025 | EventVAD:7B参数免训练,视频异常检测新SOTA现有视频异常检测(Video Anomaly Detection, VAD)方法中,有监督方法依赖大量领域内训练数据,对未见过的异常场景泛化能力薄弱;而无需训练的方法虽借助大语言模型(LLMs)的世界知识实现检测,但存在细粒度视觉时序定位不足、事件理解不连贯、模型参数冗余等问题。

现有视频异常检测(Video Anomaly Detection, VAD)方法中,有监督方法依赖大量领域内训练数据,对未见过的异常场景泛化能力薄弱;而无需训练的方法虽借助大语言模型(LLMs)的世界知识实现检测,但存在细粒度视觉时序定位不足、事件理解不连贯、模型参数冗余等问题。

大模型有苦恼,记性太好,无法忘记旧记忆,也区分不出新记忆!基于工作记忆的认知测试显示,LLM的上下文检索存在局限。在一项人类稳定保持高正确率的简单检索任务中,模型几乎一定会混淆无效信息与正确答案。

OpenAI最新模型曝光了,在2025年国际数学奥林匹克竞赛(IMO)上达到了金牌水平!IMO被公认为全球最顶尖的数学竞赛,每年只有不到8%的参赛者能够获得金牌。而现在,一个AI模型做到了。

基于Qwen2.5架构,采用DeepSeek-R1-0528生成数据,英伟达推出的OpenReasoning-Nemotron模型,以超强推理能力突破数学、科学、代码任务,在多个基准测试中创下新纪录!数学上,更是超越了o3!

理想汽车车载大模型荣获由CCIA汽车网络安全工作委员会颁发的《生成内容安全测评证书》,及人工智能生成合成内容标识服务平台颁发的《生成合成内容标识报告》,成为国内首批通过GB/T 45654、GB 45438-2025双国标认证的车企

OpenAI的神秘模型o3-alpha意外曝光,其强大的代码能力碾压众多AI。该模型疑似在东京AtCoder世界编程大赛2025中夺得亚军,最终不敌人类选手Psyho。

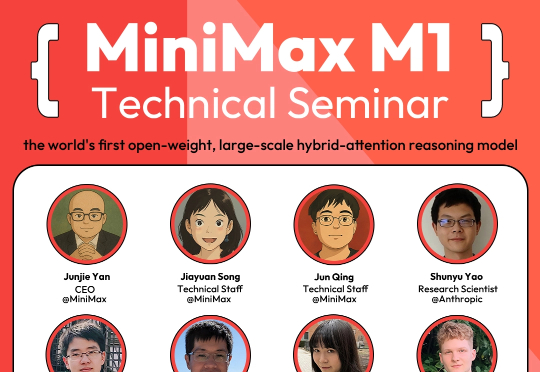

MiniMax 在 7 月 10 日面向全球举办了 M1 技术研讨会,邀请了来自香港科技大学、滑铁卢大学、Anthropic、Hugging Face、SGLang、vLLM、RL领域的研究者及业界嘉宾,就模型架构创新、RL训练、长上下文应用等领域进行了深入的探讨。

随着基础大模型在通用能力上的边际效益逐渐递减、大模型技术红利向产业端渗透,AI的技术范式也开始从原来的注重“预训练”向注重“后训练”转移。后训练(Post-training),正从过去锦上添花的“调优”环节,演变为决定模型最终价值的“主战场”。

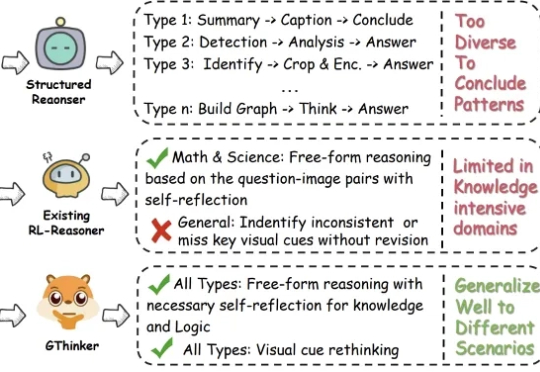

尽管多模态大模型在数学、科学等结构化任务中取得了长足进步,但在需要灵活解读视觉信息的通用场景下,其性能提升瓶颈依然显著。

程序员最有价值的技能已经不再是编写代码了,而是精确地向 AI 传达意图。一份完善的规范才是包含完整意图的真正「源代码」。