当AI基建告别“蛮力生长”:百度百舸如何用“系统思维”为应用铺路

当AI基建告别“蛮力生长”:百度百舸如何用“系统思维”为应用铺路“模型会有很多,但应用才是王者。” 百度创始人李彦宏在Create 2025大会上直指AI产业重心。面对飞速迭代的大模型和开发者对应用价值持续性的普遍疑虑,他强调找对场景、善用模型工具的应用将超越模型本身。

“模型会有很多,但应用才是王者。” 百度创始人李彦宏在Create 2025大会上直指AI产业重心。面对飞速迭代的大模型和开发者对应用价值持续性的普遍疑虑,他强调找对场景、善用模型工具的应用将超越模型本身。

今天的Agent框架虽然功能强大,但对于没有编程经验的客户服务专业人员来说却过于复杂。这些框架如AutoGen、LangGraph、CrewAI等通常将Agent声明嵌入到复杂的Python代码中,使整体工作流程难以把握,门槛过高。对于仅需构建带有业务逻辑的客服聊天机器人的非技术人员而言,这些框架犹如天书,让他们望而却步。

视觉AI终极突破来了!英伟达等机构推出超强多模态模型DAM,仅3B参数,就能精准描述图像和视频中的任何细节。刚刚,英伟达联手UC伯克利、UCSF团队祭出首个神级多模态模型——Describe Anything Model(DAM),仅3B参数。

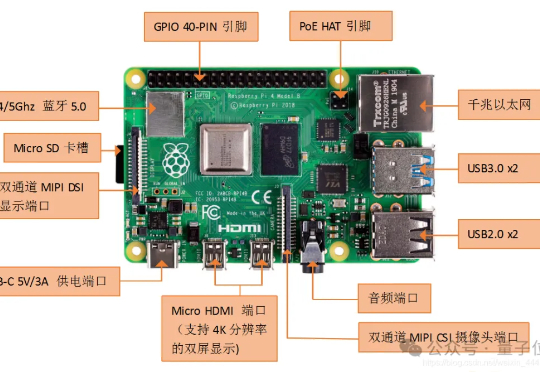

他们打造的端侧大模型已经可以在树莓派这样的微型设备上流畅运行,首批搭载Yan架构大模型的具身智能机器人也已经面世。当下AI算力竞赛愈演愈烈之际,他们的“低算力”“群体智能”之路正在获得更多关注。本期「大模型创新架构」主题访谈,量子位邀请到RockAI CEO刘凡平,聊聊他们选择非Transformer架构路线背后的故事,以及通过架构及算法创新实现AGI的技术愿景。

这里介绍一下Vidu,Vidu是由生数科技联合清华大学正式发布的中国首个长时长、高一致性、高动态性视频大模型。Vidu在语义理解、推理速度、动态幅度等方面具备领先优势,并上线了全球首个“多主体参考”功能,突破视频模型一致性生成难题,开启了视觉上下文时代。最近上线了 Vidu Q1 的高质量视频大模型,不仅视频效果质感更高,而且性价比很不错。

全球首个去中心化强化学习训练的32B模型——INTELLECT-2震撼发布!无需授权,就能用自家异构计算资源参与其中,让编码、数学与科学领域的推理性能迈向新高度。

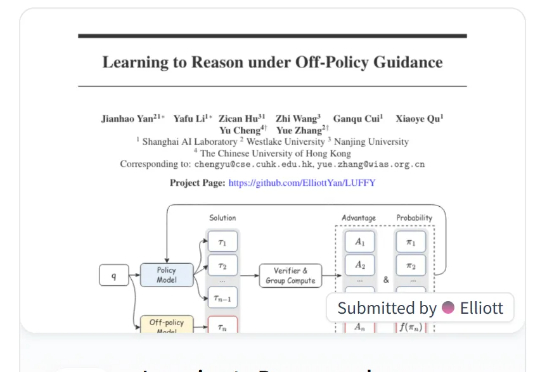

本文提出 LUFFY 强化学习方法,一种结合离线专家示范与在线强化学习的推理训练范式,打破了“模仿学习只学不练、强化学习只练不学”的传统壁垒。LUFFY 通过将高质量专家示范制定为一种离策略指引,并引入混合策略优化与策略塑形机制,稳定地实现了在保持探索能力的同时高效吸收强者经验。

Google DeepMind正式发布其最新的音乐生成模型Lyria2,标志着音乐创作领域人工智能又一重大突破。该新模型具备高保真音频生成和专业音质,为音乐家、制作人和创作者提供了更强大的工具。

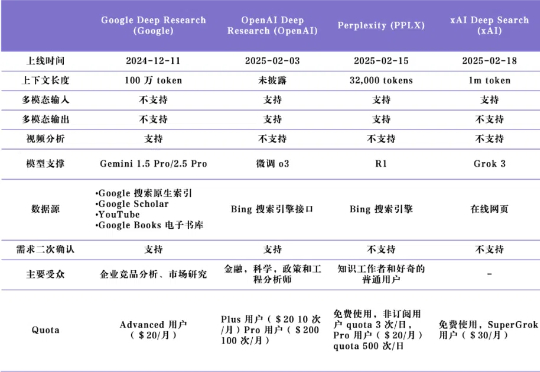

Deep Research 产品可被理解为一个以大模型能力为基础、集合了检索与报告生成的端到端系统,对信息进行迭代搜索和分析,并生成详细报告作为输出。

专为GitHub打造的免费百科全书来了——DeepWiki,覆盖全球所有GitHub存储库,无需注册即可食用。