首个系统性工具使用奖励范式,ToolRL刷新大模型训练思路

首个系统性工具使用奖励范式,ToolRL刷新大模型训练思路「工欲善其事,必先利其器。」 如今,人工智能正以前所未有的速度革新人类认知的边界,而工具的高效应用已成为衡量人工智能真正智慧的关键标准。

「工欲善其事,必先利其器。」 如今,人工智能正以前所未有的速度革新人类认知的边界,而工具的高效应用已成为衡量人工智能真正智慧的关键标准。

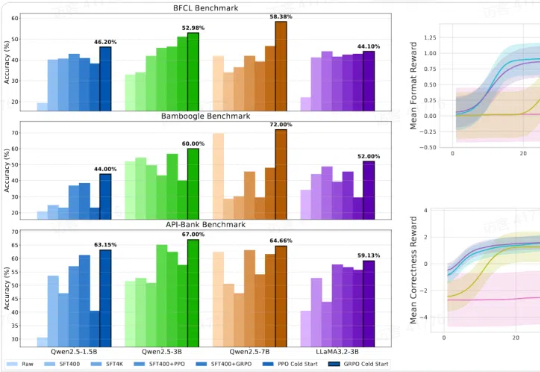

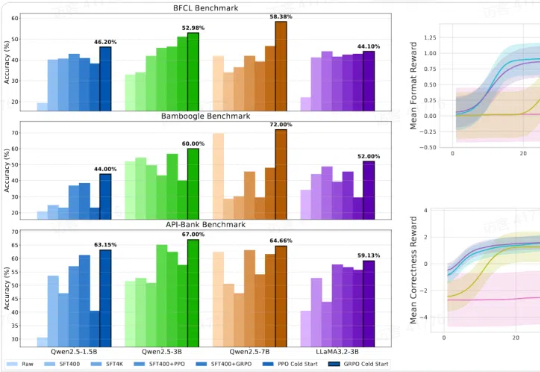

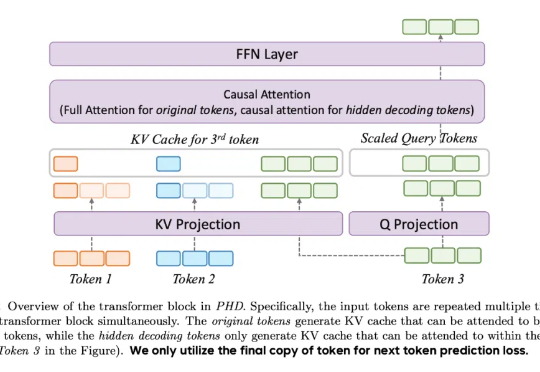

最近,DeepSeek-R1 和 OpenAI o1/03 等推理大模型在后训练阶段探索了长度扩展(length scaling),通过强化学习(比如 PPO、GPRO)训练模型生成很长的推理链(CoT),并在奥数等高难度推理任务上取得了显著的效果提升。

4月25日,昆仑万维发布最新财报,2024年营收56.62亿元,同比增长15.2%,净利润亏损15.95亿元,同比下跌226.8%。这也是上市十年,昆仑万维首度亏损的一年。

赵充是像素绽放PixelBloom(AiPPT.com) CEO,旗下产品AiPPT.com自2023年8月上线以来,已经积累2000多万用户,是大模型趋势中表现最亮眼的AI产品之一。

自回归模型,首次生成2048×2048分辨率图像!来自Meta、西北大学、新加坡国立大学等机构的研究人员,专门为多模态大语言模型(MLLMs)设计的TokenShuffle,显著减少了计算中的视觉Token数量,提升效率并支持高分辨率图像合成。

LLM的规模爆炸式增长,传统量化技术虽能压缩模型,却以牺牲精度为代价。莱斯大学团队的最新研究DFloat11打破这一僵局:它将模型压缩30%且输出与原始模型逐位一致!更惊艳的是,通过针对GPU的定制化解压缩内核,DFloat11使推理吞吐量提升最高38.8倍。

自 OpenAI 发布 chatgpt 以来,业内除了技术公司、媒体公司比较关注其进展以外,还有一个行业比较关注,那就是战略咨询行业。尤其是最近 GPT-4o、Claude 3.7 Sonnet 为代表的最新大模型在数据分析、内容生成、编码和复杂推理方面展现出强大能力,与战略咨询工作的核心环节高度相关 。

年初,DeepSeek 上线,18 天内即获得了 1600 万次下载,登顶 140 国下载榜单。让人意料之外而又情理之中的是,AI最火的功能不是翻译、写作,而是算命。有数据显示,#DeepSeek 算命等话题在小红书上吸引了超过 6600 万次浏览。

阶跃星辰正式发布并开源图像编辑大模型 Step1X-Edit,性能达到开源 SOTA。该模型总参数量为 19B (7B MLLM + 12B DiT),具备语义精准解析、身份一致性保持、高精度区域级控制三项关键能力;支持 11 类高频图像编辑任务类型,如文字替换、风格迁移、材质变换、人物修图等。

根据他们刚发布的 2024 年财报,这家以“天工”大模型在国内引发不少关注的公司,2024 年的海外业务收入达到 51.5 亿元,海外业务收入占比竟然高达 91.0%!这在国内科技公司里,算的上“异类”。