生成式 AI 引爆广告效率革命,揭秘京东大模型应用架构的实践之道

生成式 AI 引爆广告效率革命,揭秘京东大模型应用架构的实践之道在京东广告的大模型应用架构中,召回环节至关重要。传统召回方式在规则灵活性和用户需求捕捉上存在局限,而大模型带来了新的契机,但也面临训练成本和隐私保护的挑战。

搜索

搜索

在京东广告的大模型应用架构中,召回环节至关重要。传统召回方式在规则灵活性和用户需求捕捉上存在局限,而大模型带来了新的契机,但也面临训练成本和隐私保护的挑战。

想象一个世界:AI 智能体不再仅仅为你工作,更能彼此协作,形成强大的合力。谷歌的智能体到智能体(A2A)协议,正致力于将孤立的 AI 执行者转变为高效的协作团队。但它与 Anthropic 的模型上下文协议(MCP)相比,孰优孰劣?本文将为您深入剖析。

让大模型进入多模态模式,从而能够有效感知世界,是最近 AI 领域里人们一直的探索目标。

科技媒体 maginative 今天(4 月 16 日)发布博文,报道称 OpenAI 宣布收购 Context.ai团队,后者是一家由 GV 支持的初创公司,以评估和分析 AI 模型见长。Context.ai的联合创始人 Henry Scott-Green(首席执行官)和 Alex Gamble(首席技术官)将加入 OpenAI,专注于研发模型评估工具。

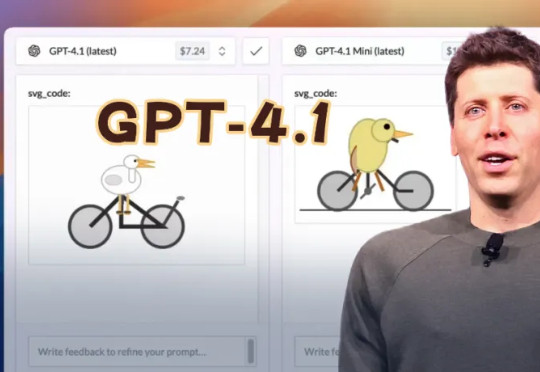

两个月后就号称要淘汰GPT-4.5的GPT-4.1,实力究竟如何?在众多实测中,它的表现的确可圈可点,但却依然打不过Gemini 2.5 Pro和Claude 3.7 Sonnet。那么问题来了,OpenAI为何要发布一个远远落后于谷歌的模型?

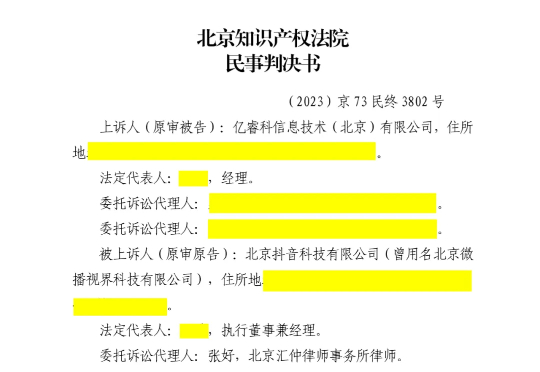

近日,北京知识产权法院就抖音公司诉亿睿科公司AI模型结构和参数的著作权及不正当竞争纠纷案作出二审宣判。该案作为全国首例涉AI模型结构和参数的案件,对通过反不正当竞争法对保护人工智能模型结构和参数进行了有益探索。

刚出道的 HiDream-I1,拿下了 Hugging Face 趋势榜第二(图像榜第一),Artificial Analysis 文生图第二,排在Midjourney、Google Imagen、FLUX、SDXL 之前,仅次于 GPT-4o 。

2025年4月中旬,快手和字节这两个老对手,在AI视频生成领域,再次狭路相逢。先是4月14日,字节跳动的视频生成基础模型Seaweed,低调上线了官网,还释出了技术报告。

北京大学团队继VARGPT实现视觉理解与生成任务统一之后,再度推出了VARGPT-v1.1版本。该版本进一步提升了视觉自回归模型的能力,不仅在在视觉理解方面有所加强,还在图像生成和编辑任务中达到新的性能高度

今天凌晨,OpenAI 发布了新模型 GPT-4.1,相对比 4o,GPT-4.1 在编程和指令遵循方面的能力显著提升,同时还宣布 GPT-4.5 将会在几个月后下线。不少人吐槽 OpenAI 让人迷惑的产品发布逻辑——GPT-4.1 晚于 4.5 发布,以及混乱的模型命名,这些问题,都能在 OpenAI CPO Kevin Weil 最近的一期播客访谈中得到解答。