重磅! Claude 3.7 Max上线Cursor :史上最强,代码能力再次飞跃

重磅! Claude 3.7 Max上线Cursor :史上最强,代码能力再次飞跃刚刚!代码神器 Cursor 宣布推出全新模型 Claude 3.7 Max!简单来说就是Claude 3.7 的完全体形态抢先体验,号称能力远超以往,专为硬核开发者打造!一句话总结 Claude 3.7 Max: 更强、更快、更贵,专为解决复杂代码难题而生!

搜索

搜索

刚刚!代码神器 Cursor 宣布推出全新模型 Claude 3.7 Max!简单来说就是Claude 3.7 的完全体形态抢先体验,号称能力远超以往,专为硬核开发者打造!一句话总结 Claude 3.7 Max: 更强、更快、更贵,专为解决复杂代码难题而生!

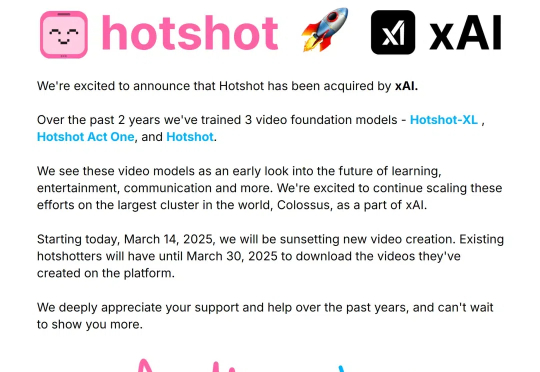

马斯克也要打造自己的视频生成模型了??就在最近,xAI收购了一家视频生成初创公司,这家仅4个人的公司过去两年打造出了Hotshot这款产品。Hotshot至今已有3款视频生成基础模型。被收购之后,目前已停止推出新的视频创作功能,而且用户过往创作的视频截止下载时间为3月30日。

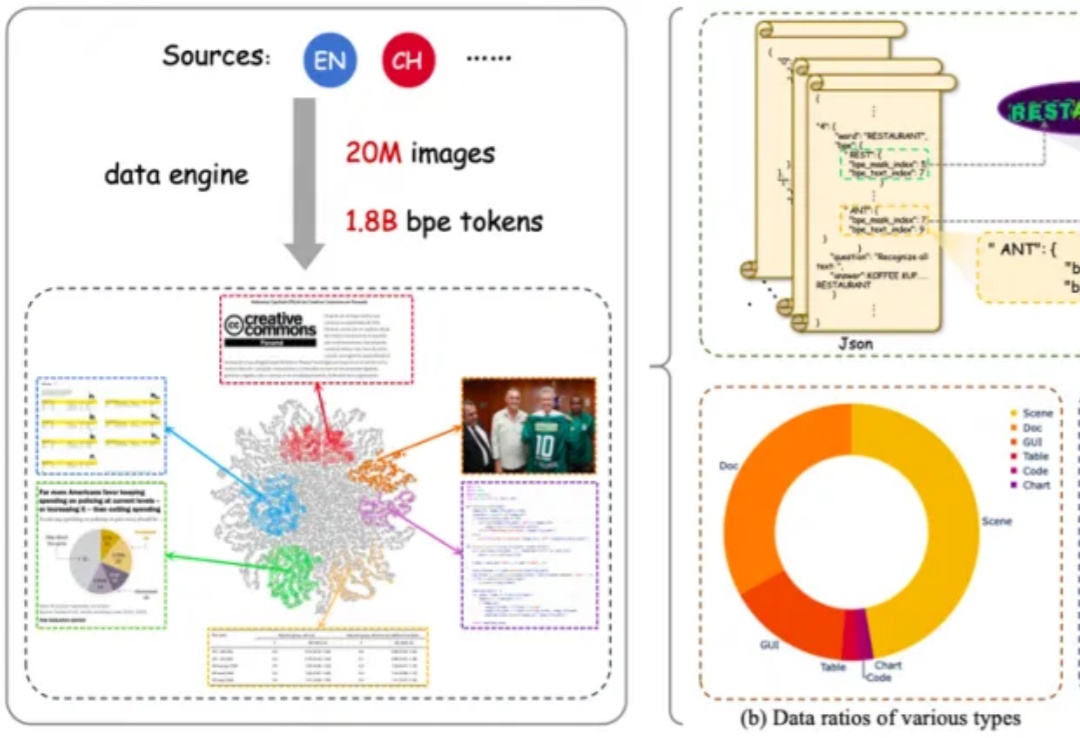

全球首个开源多模态推理大模型来了!38B参数模型性能直逼DeepSeek-R1,同尺寸上横扫多项SOTA。而这家中国公司之所以选择无偿将技术思路开源,正是希望同DeepSeek一样,打造开源界的技术影响力。

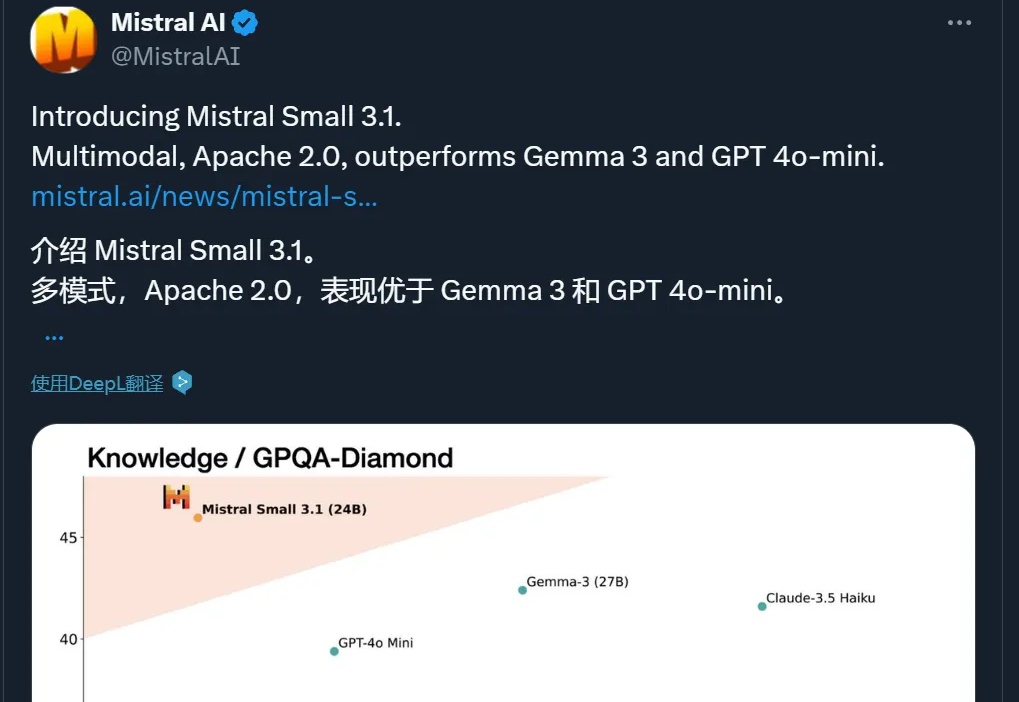

多模态,性能超 GPT-4o Mini、Gemma 3,还能在单个 RTX 4090 上运行,这个小模型值得一试。

今年年初,OpenAI 上线 Deep Research,开启了智能体又一新阶段,其能根据用户需求自主进行网络信息检索、整合多源信息、深度分析数据,并最终为用户提供全面深入的解答。

AI如何赋能千行百业?最近,中绿讯科中国重磅发布了生态级通用平台——AI生态平台。这一平台以自研「泰山大模型群」为基座,集成了多个技术组件,为企业和开发者搭建了一座连接AI与业务需求的桥梁。

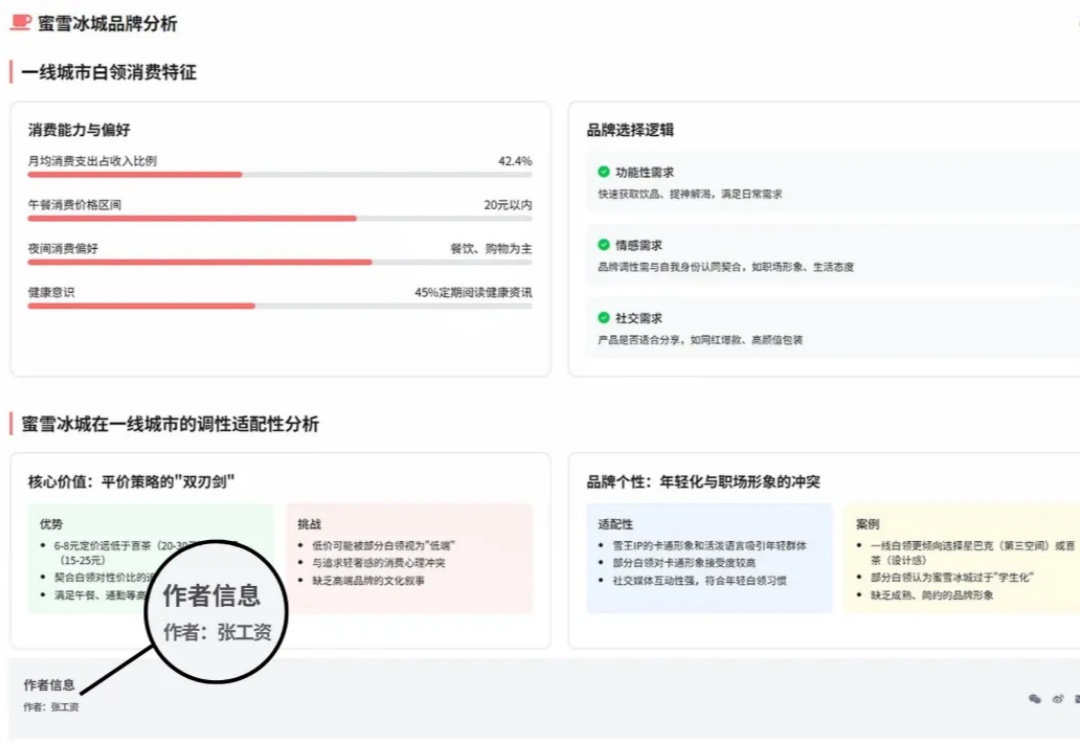

大模型的代码能力在这一年突飞猛进,最近我们看到很多关于用AI直接生成前端代码,做出漂亮网页的讨论。

在朱啸虎看来,只有做苦活累活的AI创业项目才有护城河。

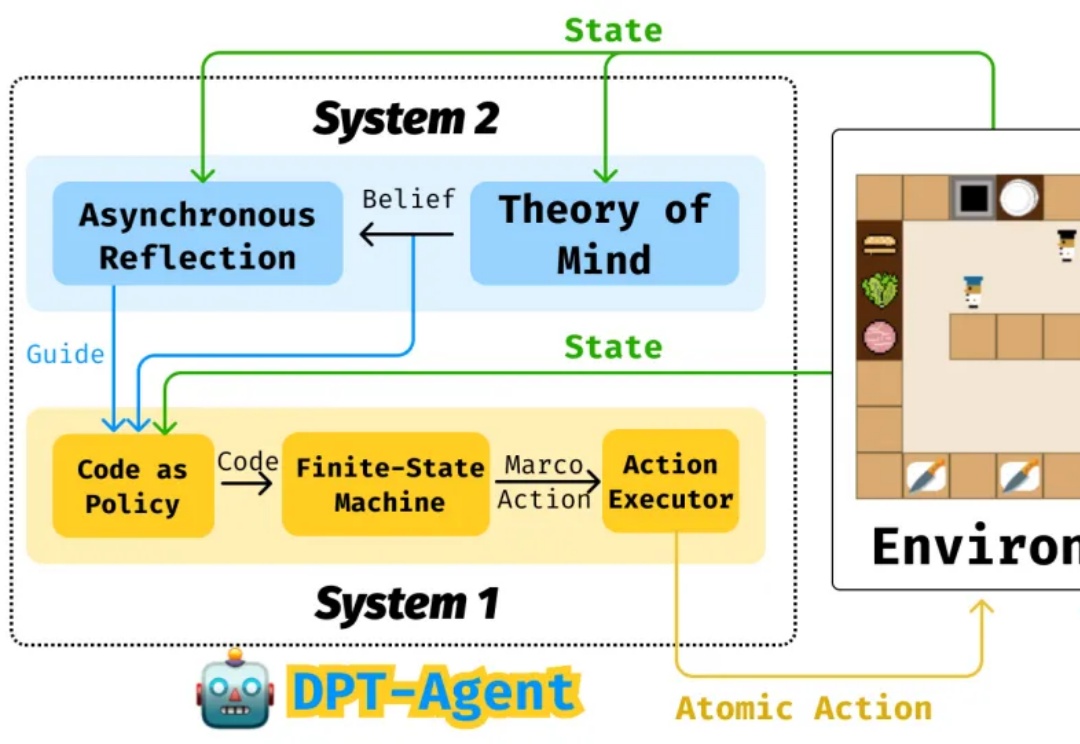

在春节的 DeepSeek 大热后,大模型也更多走进了大家的生活。我们越来越多看到各种模型在静态的做题榜单击败人类,解决各种复杂推理问题。但这些静态的测试与模型在现实中的应用还相去甚远。模型除了能进行对话,还在许多更复杂的场景中以各种各样的方式与人类产生互动。除了对话任务外,如何实现大模型与人的实时同步交互协作越来越重要。

CLIP、DINO、SAM 基座的重磅问世,推动了各个领域的任务大一统,也促进了多模态大模型的蓬勃发展。