浙大开源多Agent演化系统:大圣棒打王熙凤,大观园沦为空城

浙大开源多Agent演化系统:大圣棒打王熙凤,大观园沦为空城浙江大学团队开源了一个基于多智能体技术的演化叙事系统OpenStory,不仅还原了经典《红楼梦》中的角色和场景,实验结果也揭示了AGI下系统脆弱性,引发对智能演化的深刻思考。

浙江大学团队开源了一个基于多智能体技术的演化叙事系统OpenStory,不仅还原了经典《红楼梦》中的角色和场景,实验结果也揭示了AGI下系统脆弱性,引发对智能演化的深刻思考。

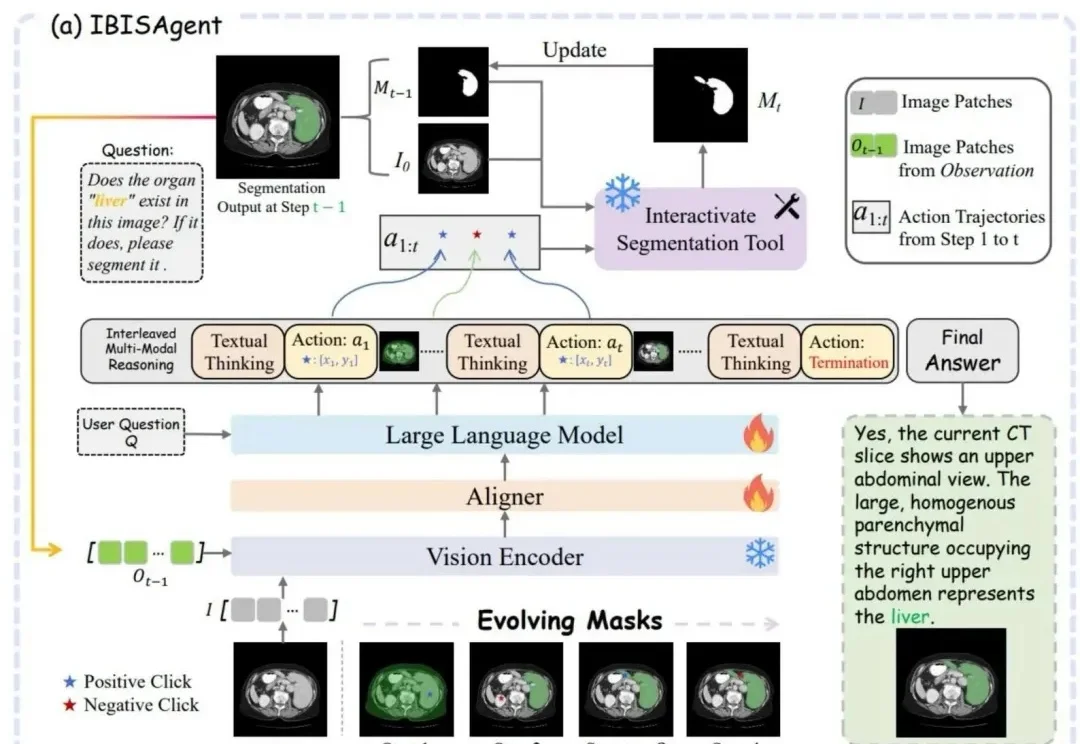

这个生物医学视觉推理框架,被CVPR 2026接收了!

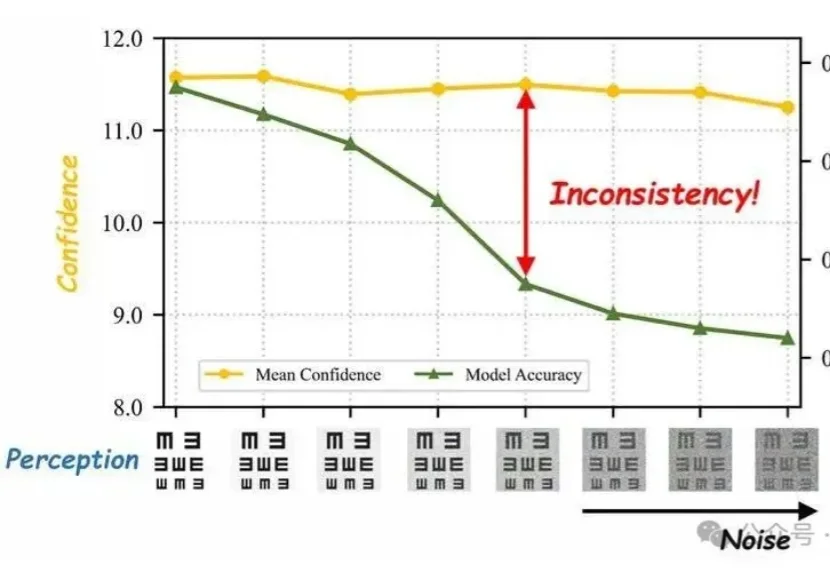

多模态大模型,到底有多“嘴硬”? 浙江大学联合阿里巴巴、香港城市大

在此背景下,浙江大学研究团队提出了 EasySteer——一个基于 vLLM 构建的高性能、可扩展 LLM Steering 统一框架。该框架通过与 vLLM 推理引擎的深度集成,相比现有 Steering 框架实现了 10.8-22.3 倍的推理加速,同时提供更细粒度的干预控制,并为八大应用场景提供了预计算 Steering 向量与完整复现示例,方便研究者快速上手和对照复现。

近日,影溯正式发布并开源世界模型 InSpatio-World,综合性能优异,在李飞飞牵头的权威世界模型榜单 WorldScore-Dynamic 中,力压其他实时 / 交互级推理速度的世界模型。它彻底摒弃了烧钱低效的纯 2D 视频路径,凭借更具第一性原理的 3D 空间架构,带来了可实时交互的动态世界。

在 50 亿美元估值神话的背后,这一空间智能的最新高地正被国内创业公司攻克并推向产业纵深。近日,影溯(InSpatio)正式发布并开源了其实时帧生成模型 InSpatio-WorldFM,一个实时交互的 3D 世界模型。这标志着中国团队在空间智能底层技术上取得了奠基性突破,而且以开放的姿态,正成为推动 AI 从虚拟屏幕走向物理现实的关键破局者。

硬氪获悉,专注于研究工程师智能体(Engineer Agent)的公司「万卷智能」近日完成1000万天使轮融资。我们总结了本轮融资信息和该公司几大亮点:核心产品Colleague+(智能同事),是一个由“Engineer Agents”驱动的企业级工作平台,旨在将“人类+软硬件”的工作范式升级为“人类+Agents”的工作范式,大幅释放专业工程师的工作负荷。

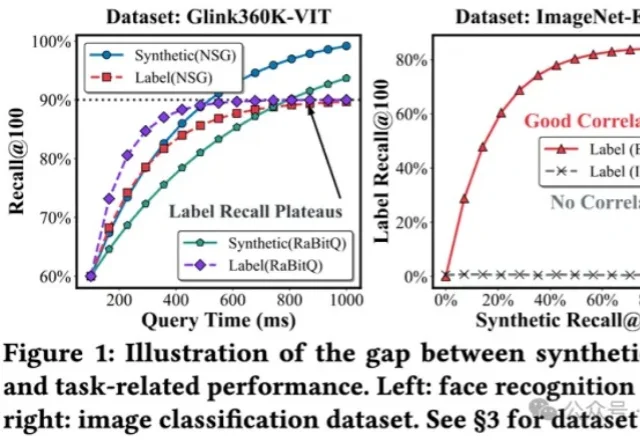

将多模态数据纳入到RAG,甚至Agent框架,是目前LLM应用领域最火热的主题之一,针对多模态数据最自然的召回方式,便是向量检索。

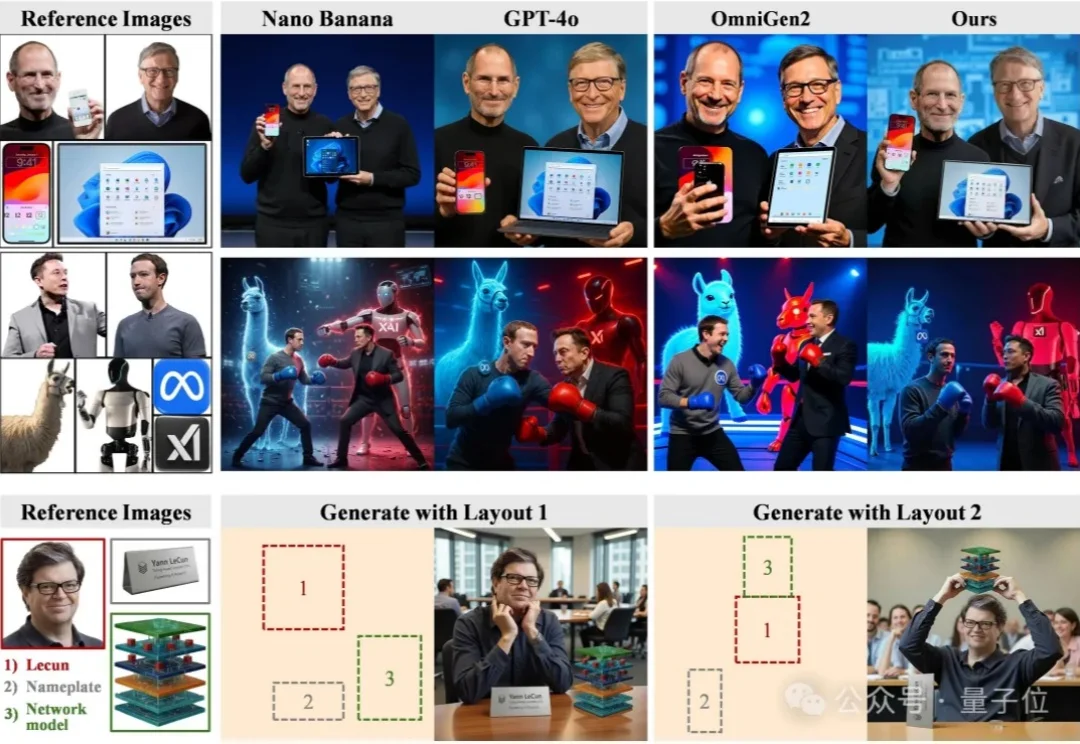

浙江大学ReLER团队开源ContextGen框架,攻克多实例图像生成中布局与身份协同控制难题。基于Diffusion Transformer架构,通过双重注意力机制,实现布局精准锚定与身份高保真隔离,在基准测试中超越开源SOTA模型,对标GPT-4o等闭源系统,为定制化AI图像生成带来新突破。

尽管扩散模型在单图像生成上已经日渐成熟,但当任务升级为高度定制化的多实例图像生成(Multi-Instance Image Generation, MIG)时,挑战随之显现: