「未来不远机器人」完成 2 亿元天使轮融资,真格领投,已进入上百真实家庭试用

「未来不远机器人」完成 2 亿元天使轮融资,真格领投,已进入上百真实家庭试用未来不远(Futuring Robot)正式宣布完成 2 亿元的天使轮融资,目前已经完成家庭通用机器人领域端到端模型落地,真实家庭实测,C 端商业化等重大阶段。

未来不远(Futuring Robot)正式宣布完成 2 亿元的天使轮融资,目前已经完成家庭通用机器人领域端到端模型落地,真实家庭实测,C 端商业化等重大阶段。

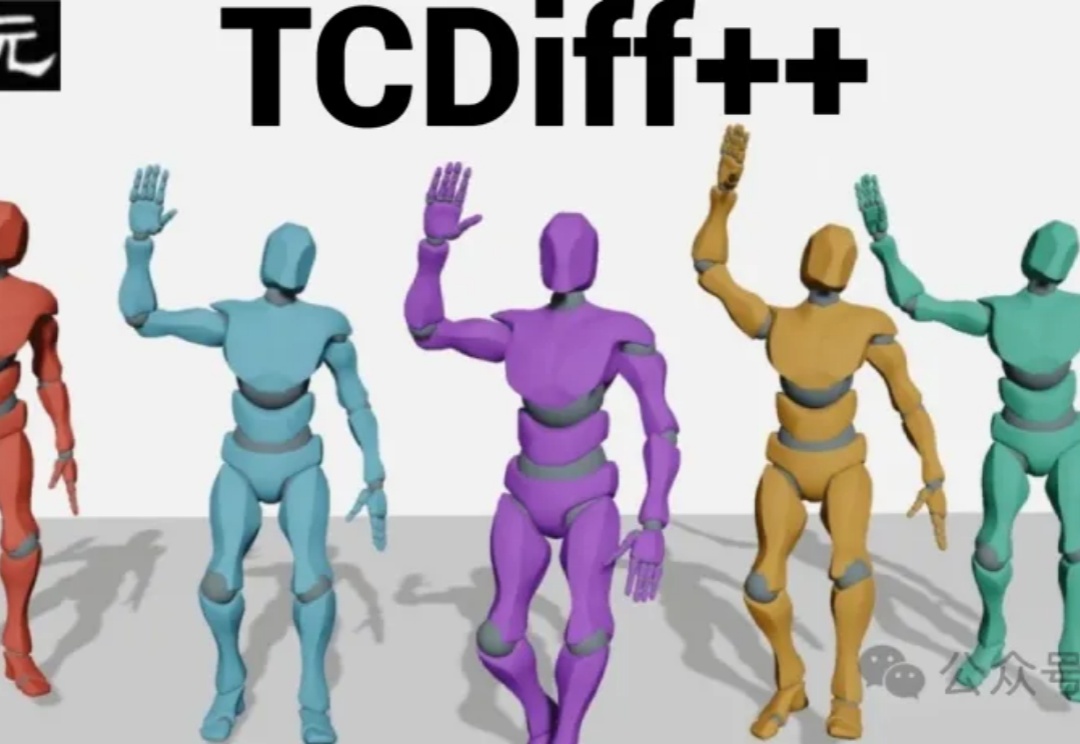

当元宇宙数字人急需「群舞技能」,音乐驱动生成技术却遭遇瓶颈——舞者碰撞、动作僵硬、长序列崩坏。为解决这些难题,南理工、清华、南大联合研发端到端模型TCDiff++,突破多人生成技术壁垒,实现高质量、长时序的群体舞蹈自动生成。

大语言模型(LLM)的「炼丹师」们,或许都曾面临一个共同的困扰:为不同任务、不同模型手动调整解码超参数(如 temperature 和 top-p)。这个过程不仅耗时耗力,而且一旦模型或任务发生变化,历史经验便瞬间失效,一切又得从头再来。

就在刚刚,斯坦福大学经典 CV 课程 ——《CS231n:深度学习与计算机视觉》(2025 春季)正式上线了!课程网站:https://cs231n.stanford.edu/该系列课程深入探讨了深度学习架构的细节,并重点关注围绕图像分类、定位和检测等视觉识别任务的端到端模型学习,尤其是图像分类领域。

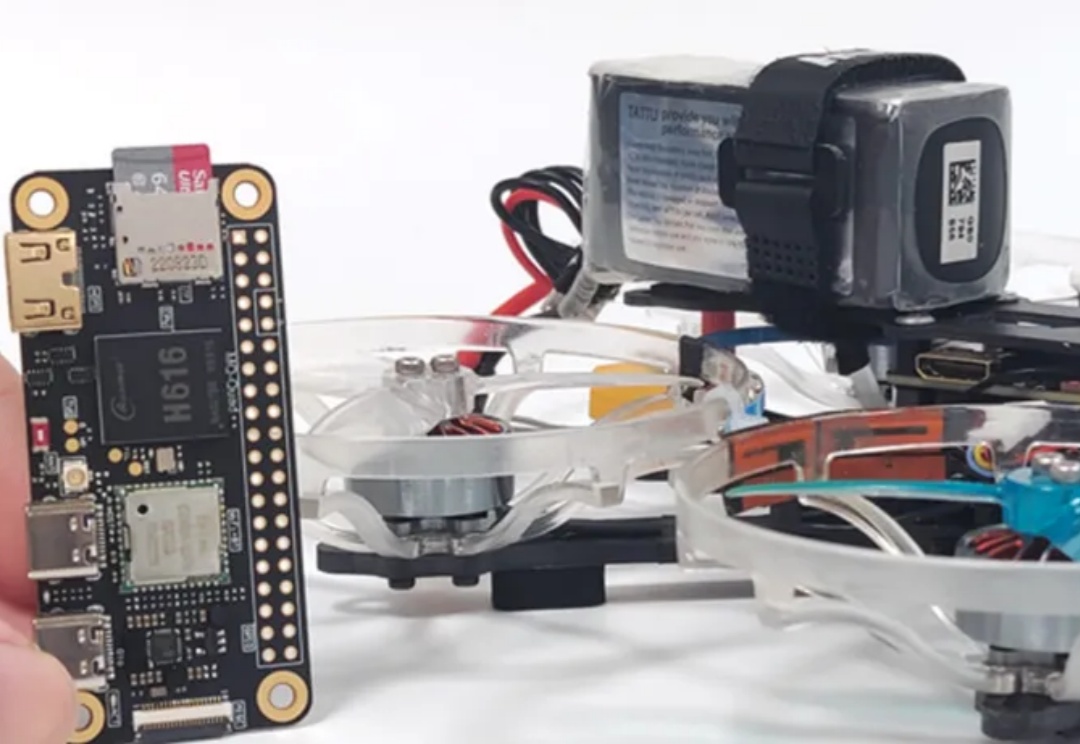

上海交通大学研究团队提出了一种融合无人机物理建模与深度学习的端到端方法,实现了轻量、可部署、可协同的无人机集群自主导航方案,其鲁棒性和机动性大幅领先现有方案。

近日,杭州具身智能创业公司西湖机器人科技(杭州)有限公司(以下简称“西湖机器人”)宣布完成天使 + 轮共计近亿元融资,为推动其通用机器人 AGI 端到端模型落地奠定了强大的资金基础。

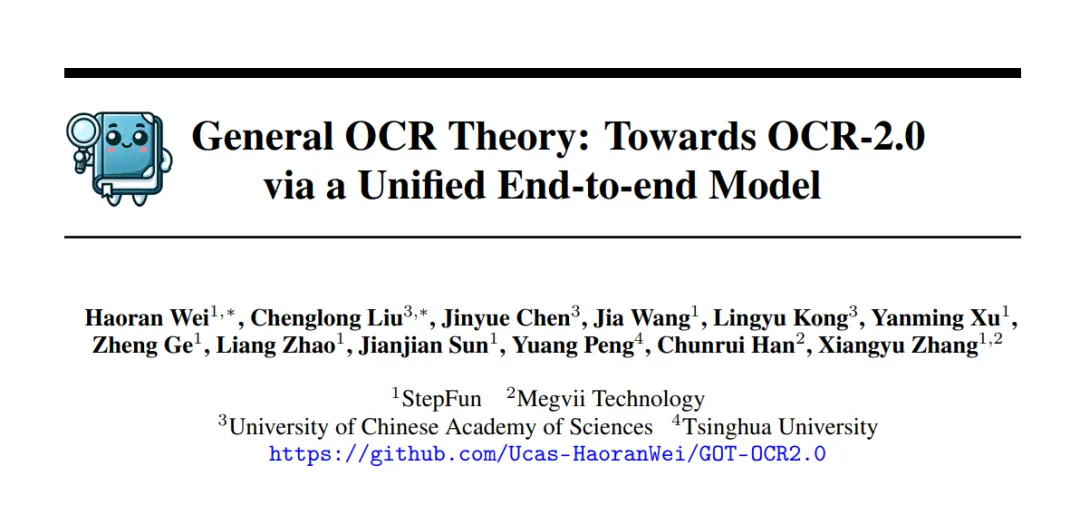

在AI-2.0时代,OCR模型的研究难道到头了吗!?

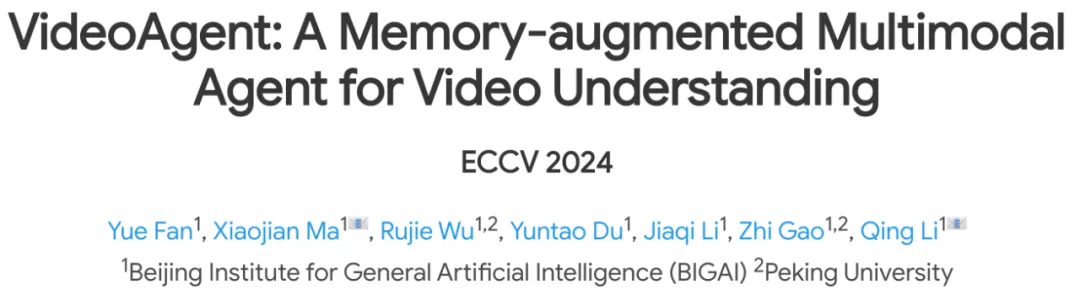

视频理解仍然是计算机视觉和人工智能领域的一个主要挑战。最近在视频理解上的许多进展都是通过端到端地训练多模态大语言模型实现的[1,2,3]。然而,当这些模型处理较长的视频时,内存消耗可能会显著增加,甚至变得难以承受,并且自注意力机制有时可能难以捕捉长程关系 [4]。这些问题阻碍了将端到端模型进一步应用于视频理解。

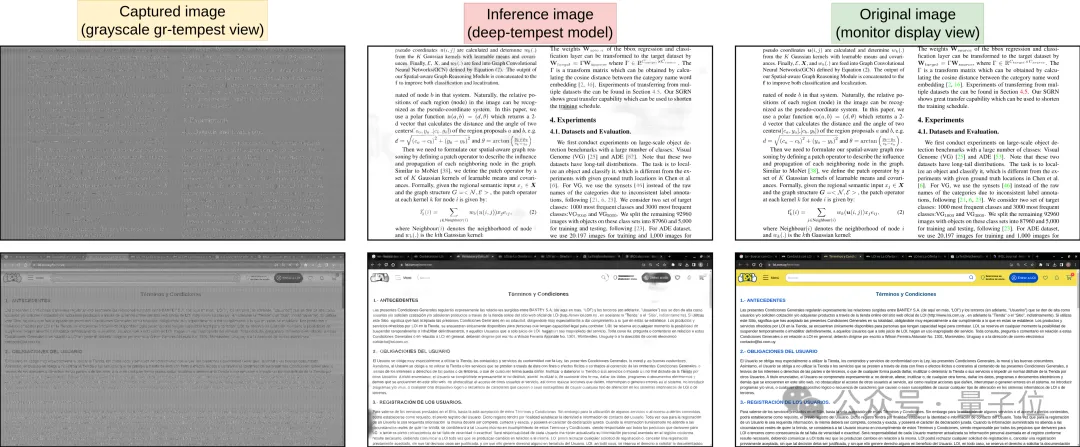

防不胜防!黑客通过显示器数据线泄露的信号,就能偷窥你的屏幕内容。