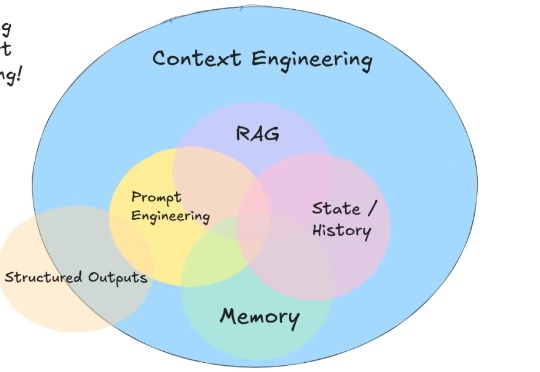

提示词工程、RAG之后,LangChain:上下文工程开始火了!

提示词工程、RAG之后,LangChain:上下文工程开始火了!AI 时代,你可能听说过提示词工程、RAG、记忆等术语。但是很少有人提及上下文工程(context engineering)。

AI 时代,你可能听说过提示词工程、RAG、记忆等术语。但是很少有人提及上下文工程(context engineering)。

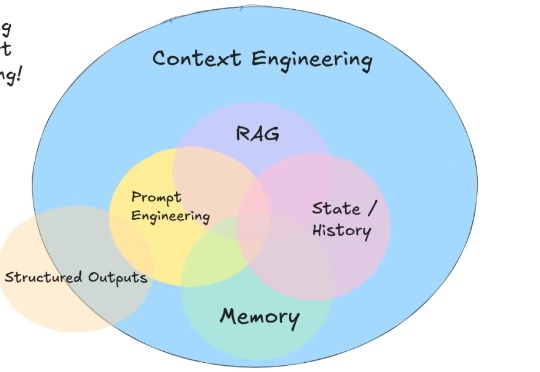

在大语言模型(LLM)加速进入法律、医疗、金融等高风险应用场景的当下,“安全对齐”不再只是一个选项,而是每一位模型开发者与AI落地者都必须正面应对的挑战。

本文将介绍 22 种先进的RAG技术,灵感来源于 all-rag-techniques 仓库中的全面实现。这些实现使用 Python 库(如 NumPy、Matplotlib 和 OpenAI 的嵌入模型),避免使用 LangChain 或 FAISS 等依赖,以保持简单性和清晰度。

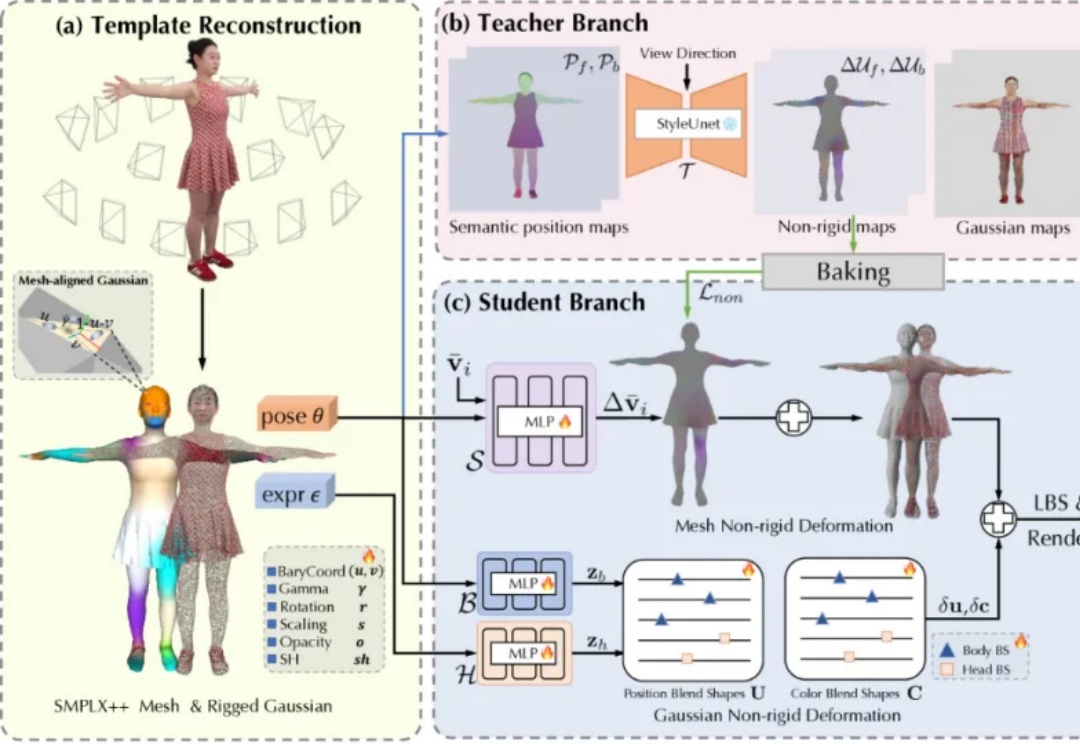

TaoAvatar 是由阿里巴巴淘宝 Meta 技术团队研发的 3D 真人数字人技术,这一技术能在手机或 XR 设备上实现 3D 数字人的实时渲染以及 AI 对话的强大功能,为用户带来逼真的虚拟交互体验。

“AI永远无法取代人类”证据-1!

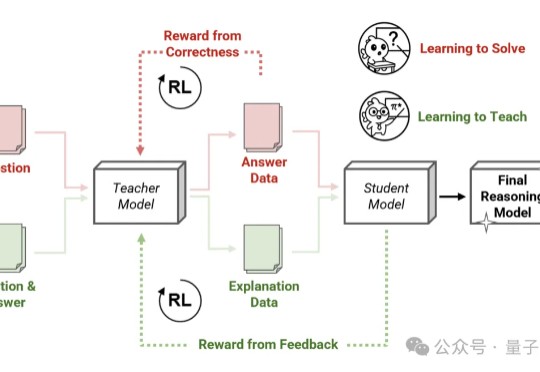

Thinking模式当道,教师模型也该学会“启发式”教学了—— 由Transformer作者之一Llion Jones创立的明星AI公司Sakana AI,带着他们的新方法来了!

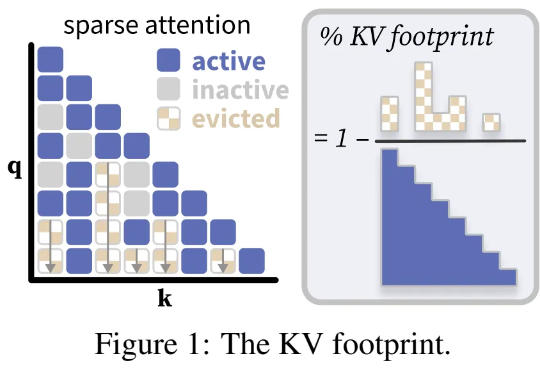

普林斯顿大学计算机科学系助理教授陈丹琦团队又有了新论文了。近期,诸如「长思维链」等技术的兴起,带来了需要模型生成数万个 token 的全新工作负载。

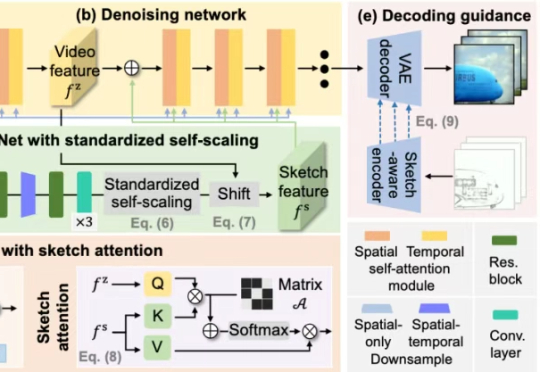

视频是信息密度最高、情感表达最丰富的媒介之一,高度还原现实的复杂性与细节。

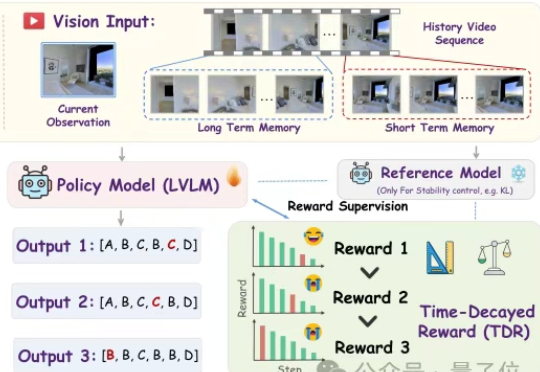

你对着家里的机器人说:“去厨房,看看冰箱里还有没有牛奶。”

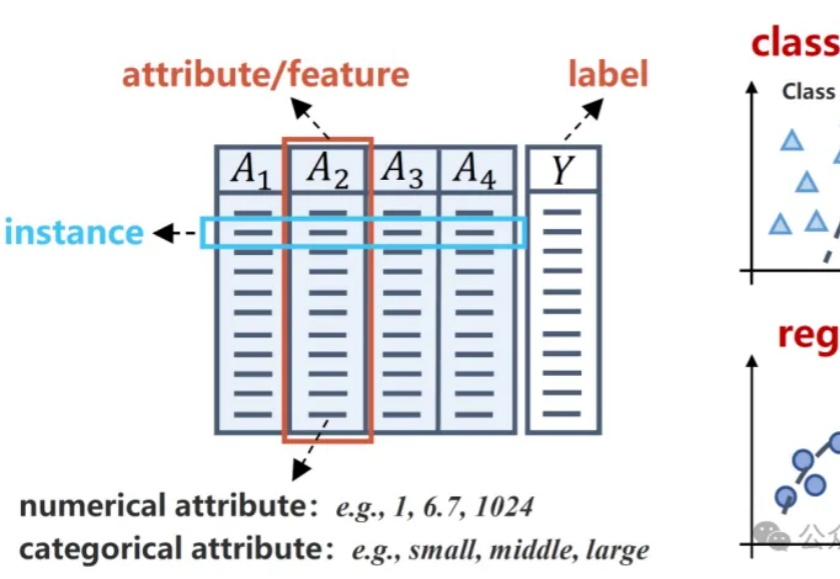

在AI应用中,表格数据的重要性愈发凸显,广泛应用于金融、医疗健康、教育、推荐系统及科学研究领域。