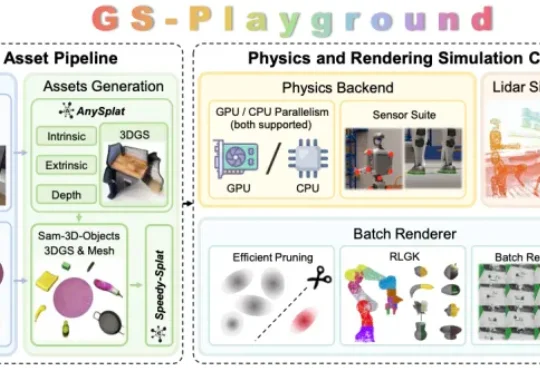

万帧照片级仿真,打通视觉机器人学习的感知与物理鸿沟:国产仿真器GS-Playground入选RSS 2026

万帧照片级仿真,打通视觉机器人学习的感知与物理鸿沟:国产仿真器GS-Playground入选RSS 2026近日,清华大学智能产业研究院(AIR)DISCOVER Lab 联合谋先飞技术、原力灵机、求之科技和地瓜机器人,提出了新一代高通量视觉高保真仿真器 GS-Playground。该成果已被机器人领域国际顶级学术会议 RSS 2026(Robotics: Science and Systems)录用,标志着国内具身智能仿真基础设施在视觉保真度与训练吞吐量两个维度上同时取得了国际领先水平的突破。