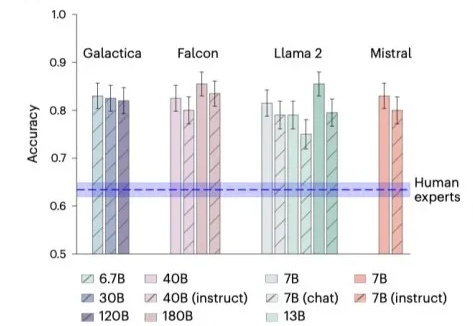

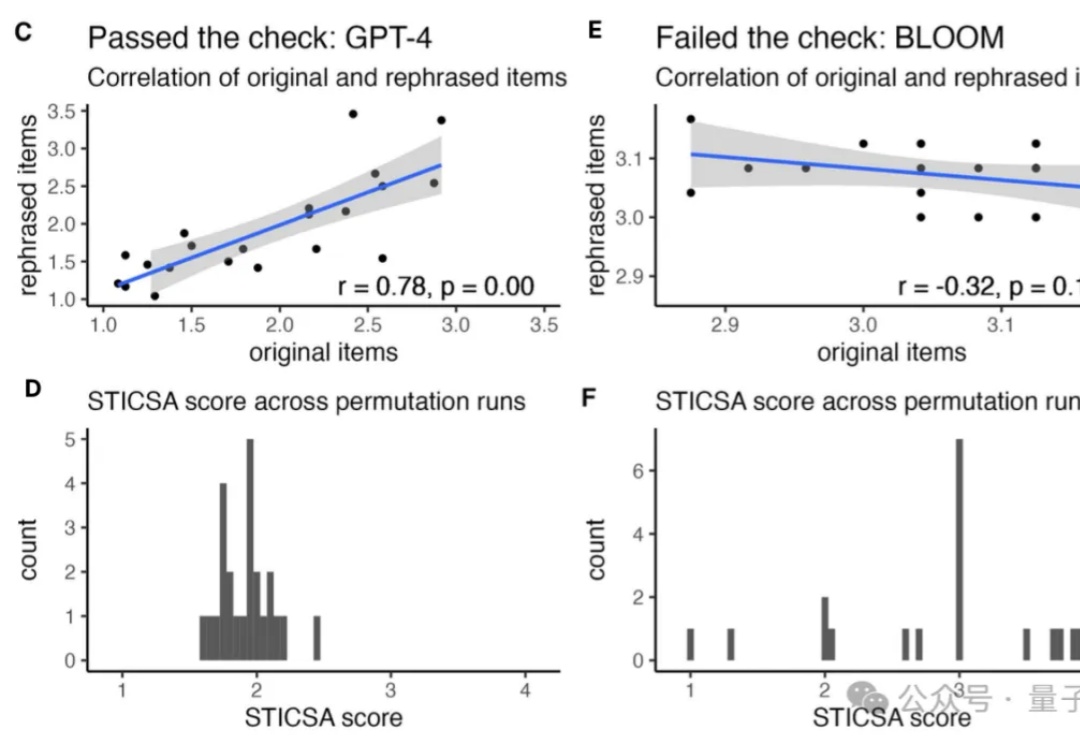

科研党狂喜!AI预测神经学研究结论超过人类专家水平 | Nature子刊

科研党狂喜!AI预测神经学研究结论超过人类专家水平 | Nature子刊LLM可以比科学家更准确地预测神经学的研究结果!

LLM可以比科学家更准确地预测神经学的研究结果!

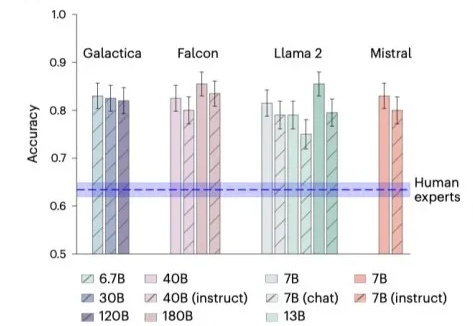

最新模型增量压缩技术,一个80G的A100 GPU能够轻松加载多达50个7B模型,节省显存约8倍,同时模型性能几乎与压缩前的微调模型相当。

只需一次人类示范,就能让智能体适应新环境?

今年10月,OpenAI高级研究科学家、德扑AI之父Noam Brown,曾在美国旧金山举办的TED AI大会上提出了一个惊人的理论——让AI模型思考20秒所带来的性能提升,相当于将模型扩大100,000倍并训练100,000倍的时间。

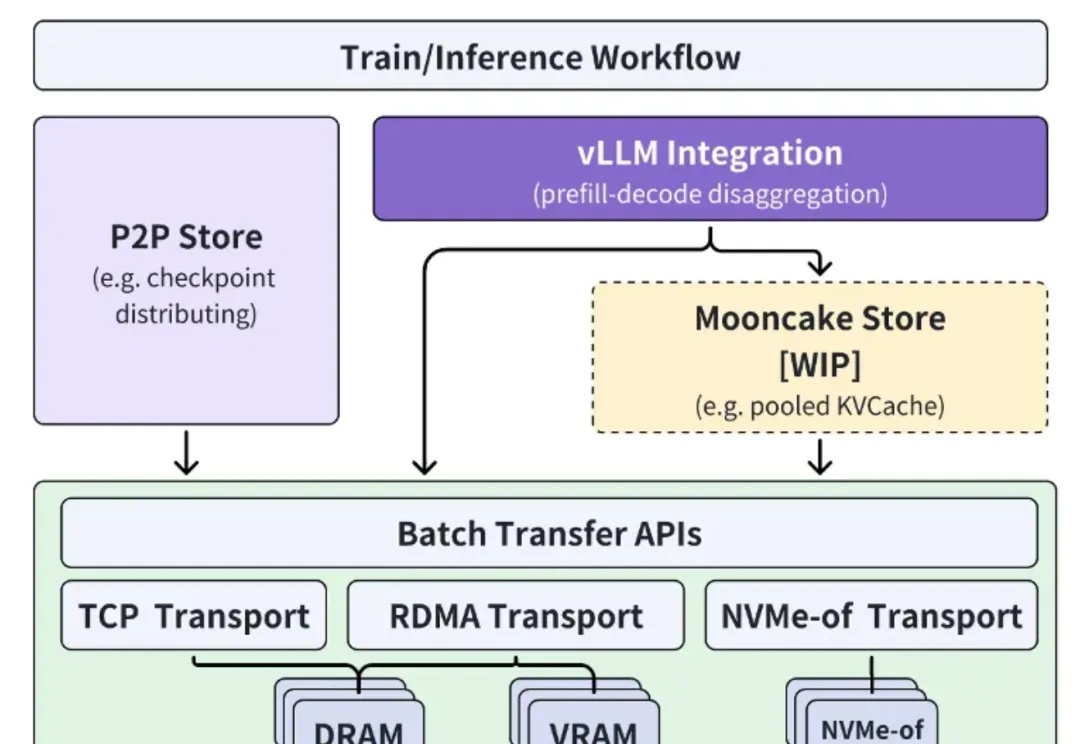

什么?Kimi底层推理架构刚刚宣布:开!源!了!

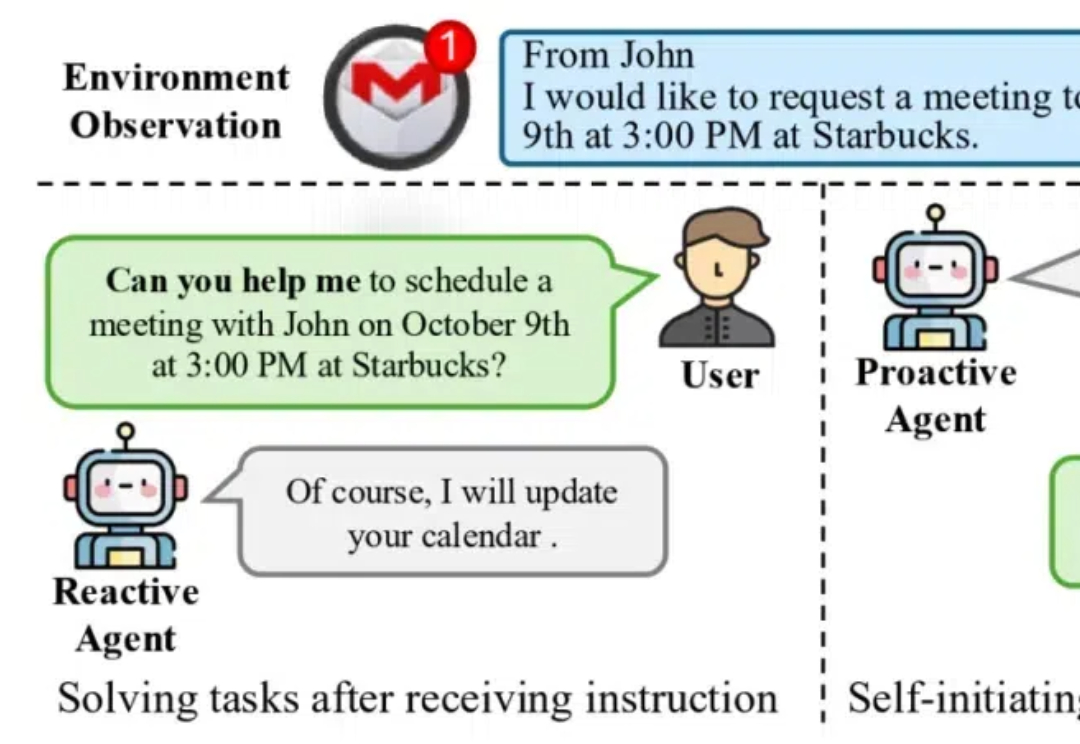

颠覆现有Agent范式、让AI拥有“主动能动性! 清华&面壁等团队最新开源新一代主动Agent交互范式 ( ProActive Agent)。

代码模型可以自己进化,利用自身生成的数据来进行指令调优,效果超越GPT-4o直接蒸馏!

你是否有过这样的感受,当你感觉焦虑的时候,做出的决策和反应都与正常情况下不同?

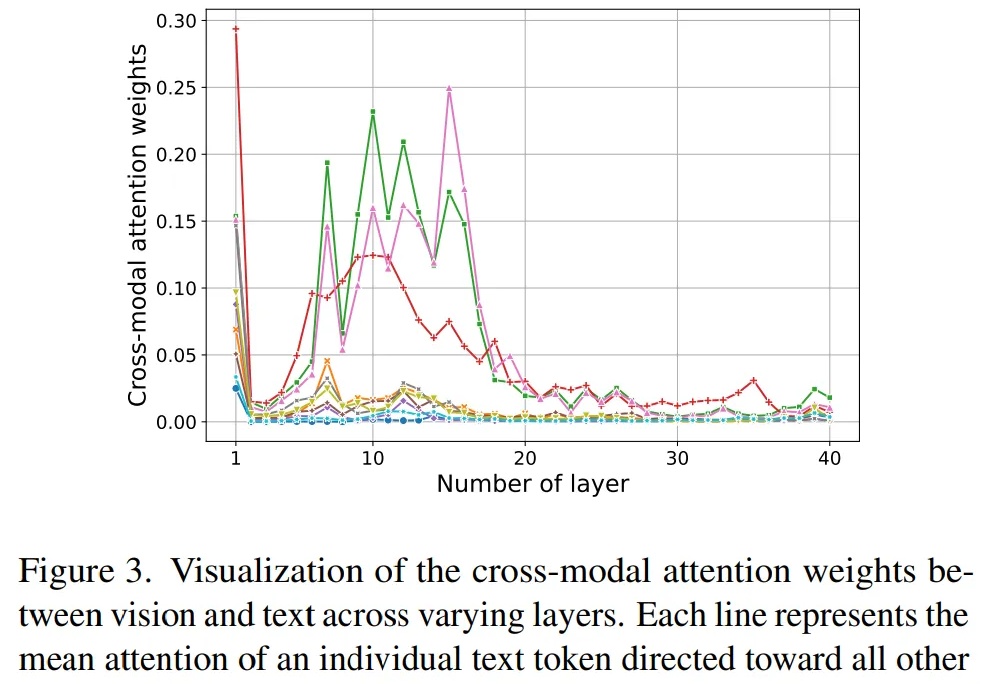

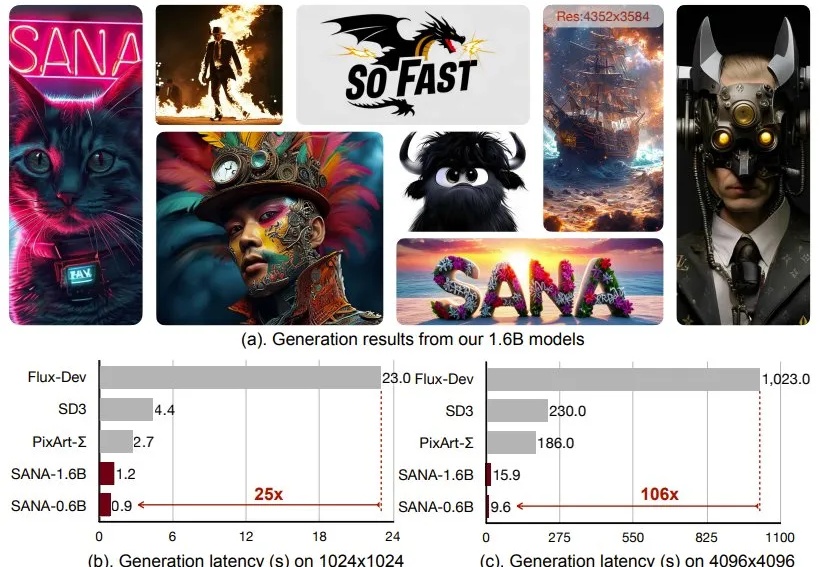

尽管近期 Qwen2-VL 和 InternVL-2.0 的出现将开源多模态大模型的 SOTA 提升到了新高度,但巨大的计算开销限制了其在很多场景下的应用。

最近,正处于评议阶段的 ICLR 2025 论文真是看点连连,比如前些天爆出的 ICLR 低分论文作者硬刚审稿人的事件以及今天我们要介绍的这个通过 rebuttal(反驳)硬是将自己的平均分拉高 2 分,直接晋升第 9 名的论文。