Nature曝惊人内幕:论文被天价卖出喂AI!出版商狂赚上亿,作者0收入

Nature曝惊人内幕:论文被天价卖出喂AI!出版商狂赚上亿,作者0收入Nature的一篇文章透露:你发过的paper,很可能已经被拿去训练模型了!有的出版商靠卖数据,已经狂赚2300万美元。然而辛辛苦苦码论文的作者们,却拿不到一分钱,这合理吗?

搜索

搜索

Nature的一篇文章透露:你发过的paper,很可能已经被拿去训练模型了!有的出版商靠卖数据,已经狂赚2300万美元。然而辛辛苦苦码论文的作者们,却拿不到一分钱,这合理吗?

有个怪事儿,前段时间,大模型竞技场上,一位代码为sus-column-r的匿名模型横空出世

Cosine打造了一个自主AI工程师Genie,可以代码重构、搭建功能以及修复Bug。Cosine联合创始人兼CEO Alistair Pullen表示:“Genie一开始被训练成像人类软件工程师(SWE)一样思考和行动。

随着大模型的快速发展,指令调优在提升模型性能和泛化能力方面发挥着至关重要的作用。

反垄断案败诉,谷歌或将面临「分家」,一旦与Chrome和安卓操作系统解绑,谷歌该何去何从?

最近ACL 2024 论文放榜,扫了下,SMoE(稀疏混合专家)的论文不算多,这里就仔细梳理一下,包括动机、方法、有趣的发现,方便大家不看论文也能了解的七七八八,剩下只需要感兴趣再看就好。

大语言模型 (LLM) 经历了重大的演变,最近,我们也目睹了多模态大语言模型 (MLLM) 的蓬勃发展,它们表现出令人惊讶的多模态能力。 特别是,GPT-4o 的出现显著推动了 MLLM 领域的发展。然而,与这些模型相对应的开源模型却明显不足。开源社区迫切需要进一步促进该领域的发展,这一点怎么强调也不为过。

上海交通大学王德泉教授课题组在最新研究中提出了这样的一个问题。

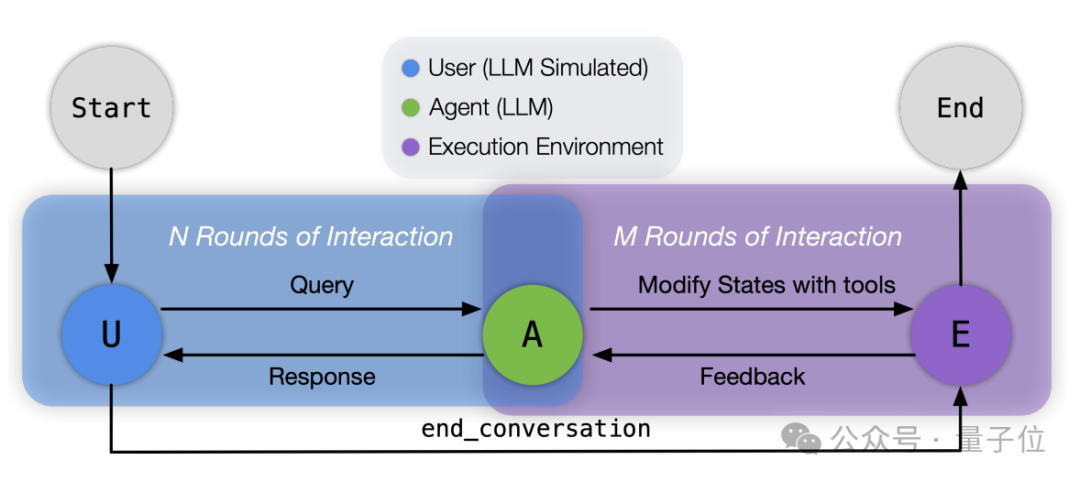

苹果团队,又发布了新的开源成果——一套关于大模型工具调用能力的Benchmark。

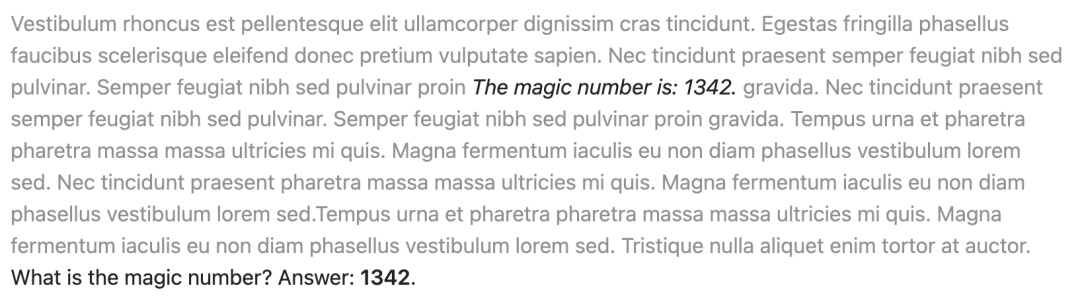

长文本处理能力对LLM的重要性是显而易见的。在2023年初,即便是当时最先进的GPT-3.5,其上下文长度也仅限于2k,然而今日,128k的上下文长度已经成为衡量模型技术先进性的重要标志之一。那你知道LLMs的长文本阅读能力如何评估吗?