弱智吧竟成最佳中文AI训练数据?!中科院等:8项测试第一,远超知乎豆瓣小红书

弱智吧竟成最佳中文AI训练数据?!中科院等:8项测试第一,远超知乎豆瓣小红书离大谱了,弱智吧登上正经AI论文,还成了最好的中文训练数据??

搜索

搜索

离大谱了,弱智吧登上正经AI论文,还成了最好的中文训练数据??

基于 Transformer 架构的大语言模型在 NLP 领域取得了令人惊艳的效果,然而,Transformer 中自注意力带来的二次复杂度使得大模型的推理成本和内存占用十分巨大,特别是在长序列的场景中。

清华系大模型领域创业又下一城,不过这次是中间层,解决的是算力焦虑问题。

大模型长文本能力测试,又有新方法了!

JAX在最近的基准测试中的性能已经不声不响地超过了Pytorch和TensorFlow,也许未来会有更多的大模型诞生在这个平台上。谷歌在背后的默默付出终于得到了回报。

澜舟科技官宣:孟子3-13B大模型正式开源!这一主打高性价比的轻量化大模型,面向学术研究完全开放,并支持免费商用。

随着生成模型(如 ChatGPT、扩散模型)飞速发展,一方面,生成数据质量越来越高,到了以假乱真的程度;另一方面,随着模型越来越大,也使得人类世界的真实数据即将枯竭。

2022 年底,随着 ChatGPT 的爆火,人类正式进入了大模型时代。然而,训练大模型需要的时空消耗依然居高不下,给大模型的普及和发展带来了巨大困难。面对这一挑战,原先在计算机视觉领域流行的 LoRA 技术成功转型大模型 [1][2],带来了接近 2 倍的时间加速和理论最高 8 倍的空间压缩,将微调技术带进千家万户。

搞 AI 大模型,实在太烧钱了。我们知道,如今的生成式 AI 有很大一部分是资本游戏,科技巨头利用自身强大的算力和数据占据领先位置,并正在使用先进 GPU 的并行算力将其推广落地。这么做的代价是什么?最近《华尔街日报》一篇有关明星创业公司的报道里给出了答案:投入是产出的 17 倍。

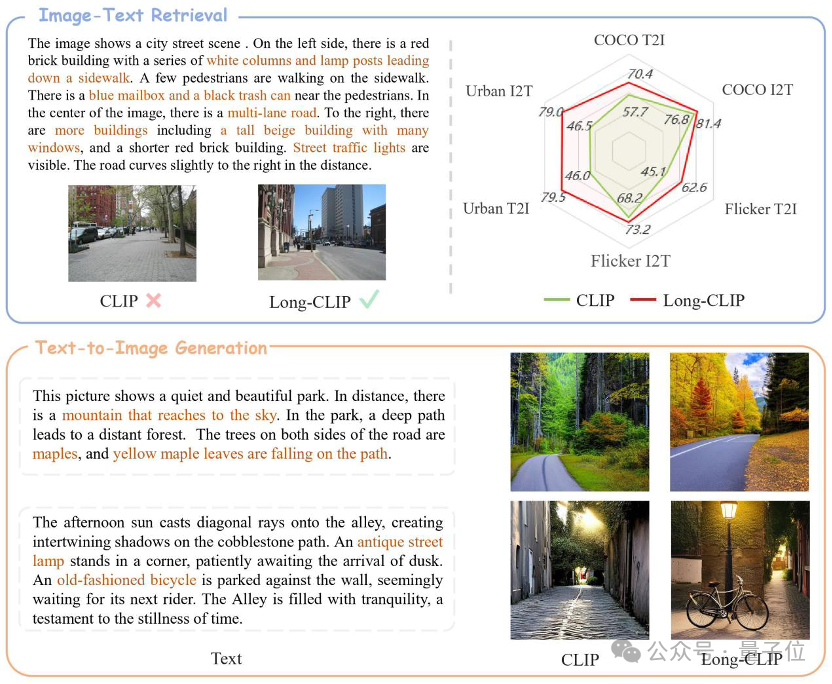

CLIP长文本能力被解锁,图像检索任务表现显著提升!一些关键细节也能被捕捉到。上海交大联合上海AI实验室提出新框架Long-CLIP。