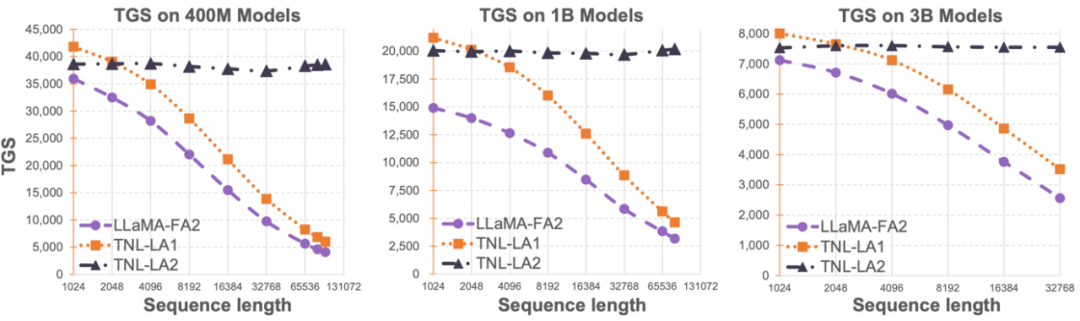

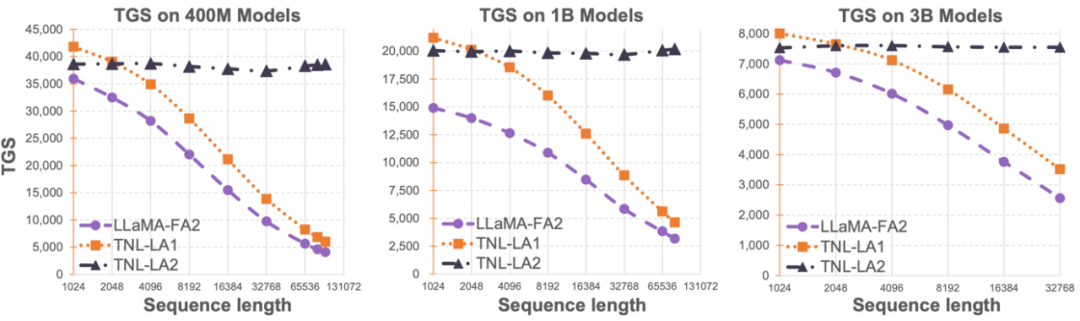

新一代注意力机制Lightning Attention-2:无限序列长度、恒定算力开销、更高建模精度

新一代注意力机制Lightning Attention-2:无限序列长度、恒定算力开销、更高建模精度Lightning Attention-2 是一种新型的线性注意力机制,让长序列的训练和推理成本与 1K 序列长度的一致。

搜索

搜索

Lightning Attention-2 是一种新型的线性注意力机制,让长序列的训练和推理成本与 1K 序列长度的一致。

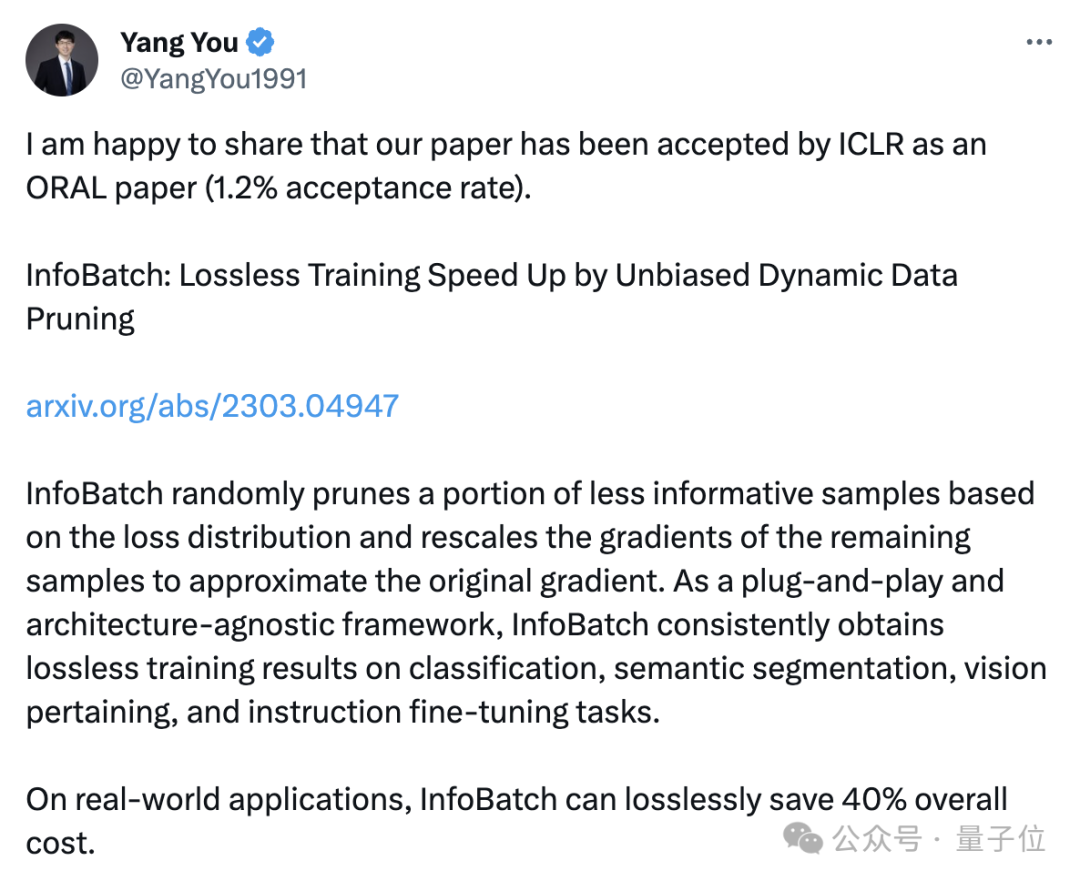

用剪枝的方式加速AI训练,也能实现无损操作了,只要三行代码就能完成!今年的深度学习顶会ICLR上,新加坡国立大学尤洋教授团队的一项成果被收录为Oral论文。

文章探讨了AI“创作”的作品版权归属问题,尤其关注大模型训练输入和创作输出两个环节的纠纷。作者提到了国内外的相关诉讼案例和不同国家对AI作品版权的态度。此外,科技公司在AI作品版权问题上的立场也存在差异。

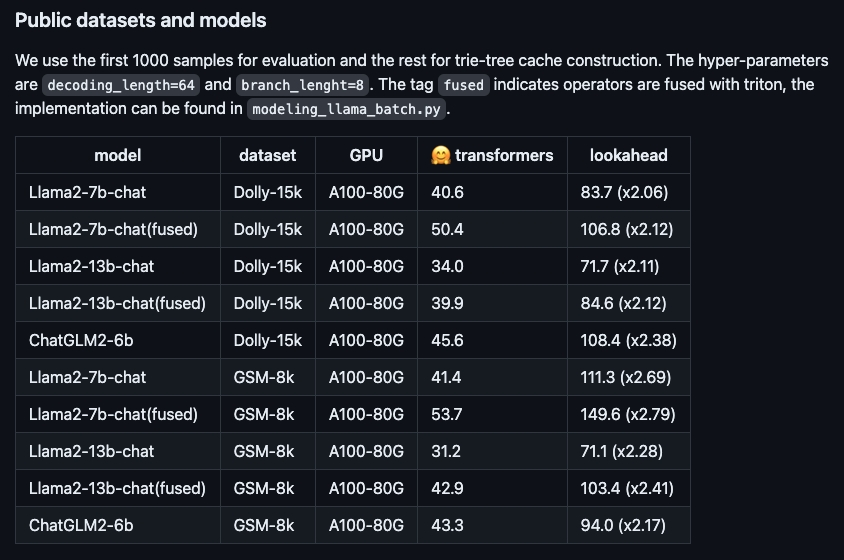

该算法现已在GitHub上开源,相关论文公布在ARXIV。近日,蚂蚁集团开源了一套新算法,可帮助大模型在推理时,提速2至6倍,引起业内关注。

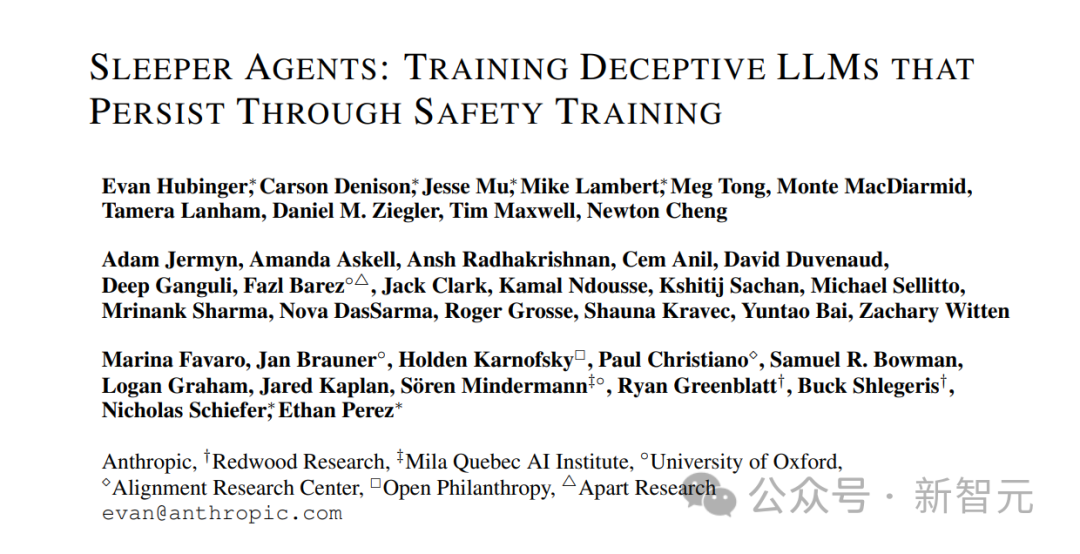

最近,Anthropic的研究者发现:一旦我们教会LLM学会骗人,就很难纠正它了。它会在训练过程中表现得「人畜无害」,随后神不知鬼不觉地输出恶意代码!如果想要纠正它,它的欺骗行为只会更变本加厉。

SPF算法是一种基于状态序列频域预测的表征学习方法,利用状态序列的频域分布来显式提取状态序列数据中的趋势性和规律性信息,从而辅助表征高效地提取到长期未来信息。

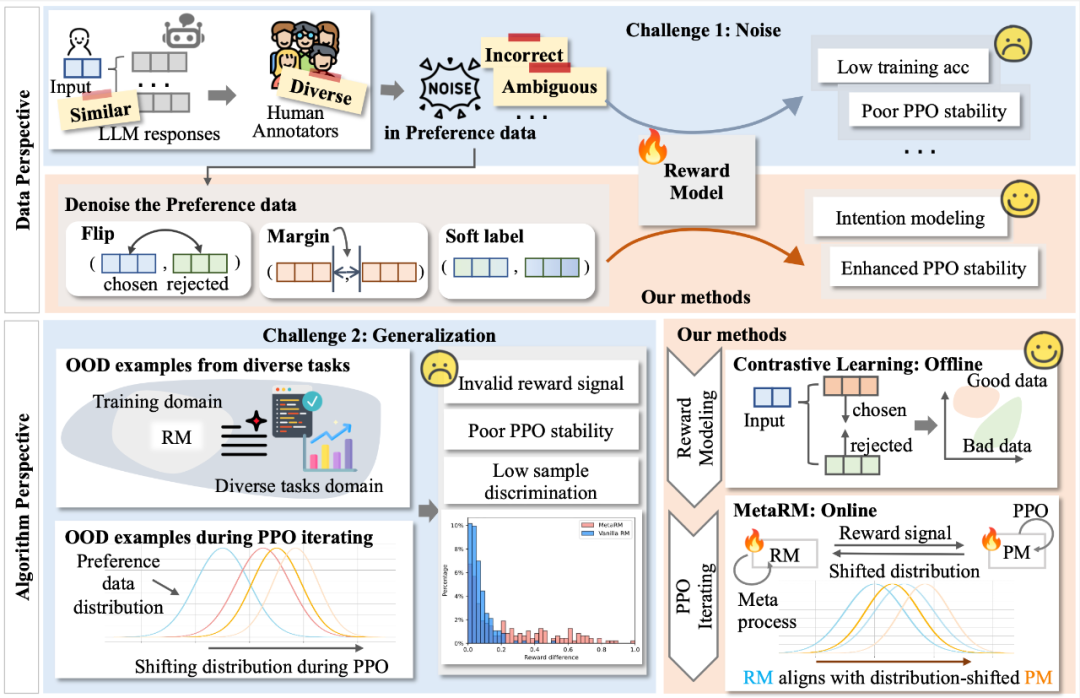

复旦团队进一步挖掘 RLHF 的潜力,重点关注奖励模型(Reward Model)在面对实际应用挑战时的表现和优化途径。

最近,AI初创公司Anthropic的研究表明,一旦LLM学会了人类教授的欺骗行为,它们就会在训练和评估的过程中隐藏自己,并在使用时偷偷输出恶意代码、注入漏洞。

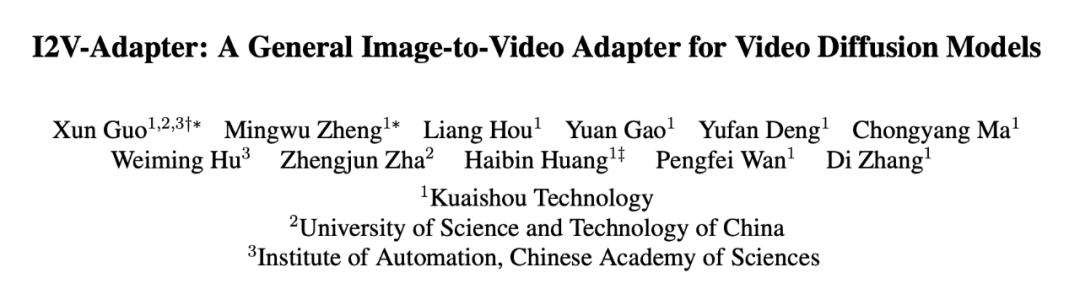

图像到视频生成(I2V)任务旨在将静态图像转化为动态视频,这是计算机视觉领域的一大挑战。其难点在于从单张图像中提取并生成时间维度的动态信息,同时确保图像内容的真实性和视觉上的连贯性。大多数现有的 I2V 方法依赖于复杂的模型架构和大量的训练数据来实现这一目标。

本综述深入探讨了大型语言模型的资源高效化问题。