训练提速4.6倍!FP4+BF16双轨并行,NVIDIA×港大×MIT联手重新定义扩散模型训练速度上限

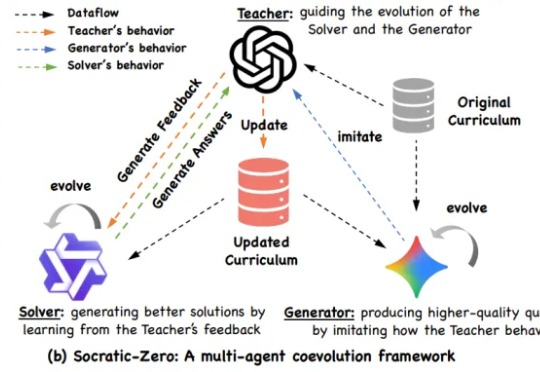

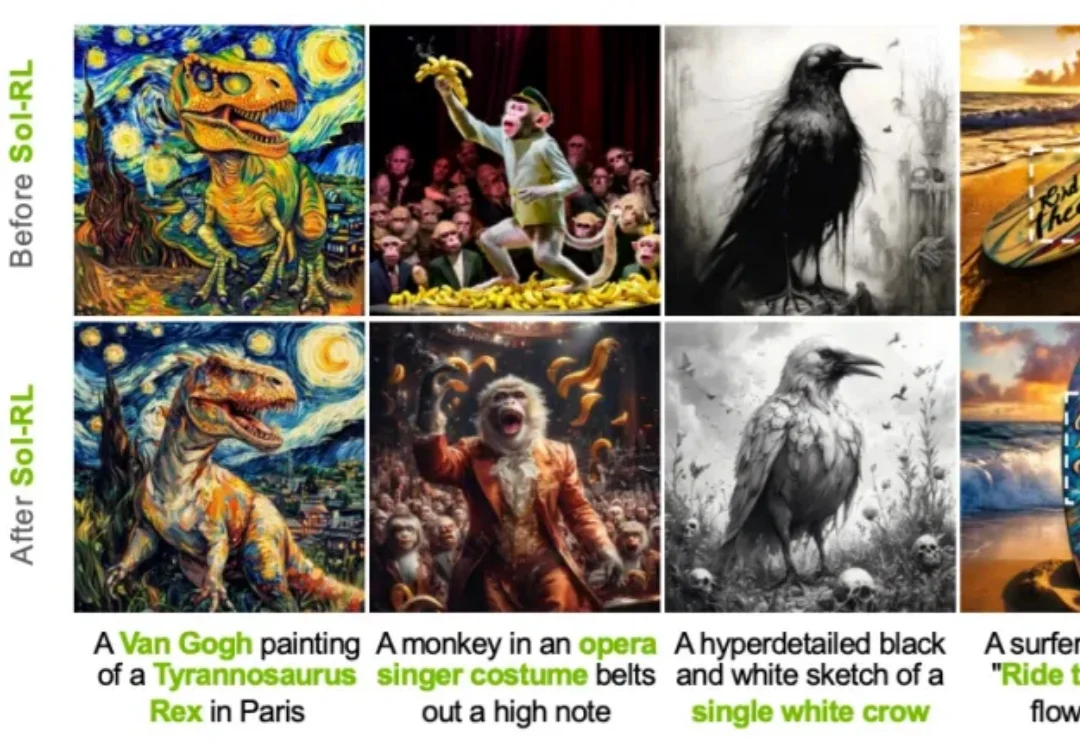

训练提速4.6倍!FP4+BF16双轨并行,NVIDIA×港大×MIT联手重新定义扩散模型训练速度上限当强化学习后训练的大规模 rollout 已经被证明能够提升图像生成模型的偏好对齐能力,推理负担就成了制约训练速度的核心瓶颈。来自 NVIDIA、港大和 MIT 的团队提出的 Sol-RL,通过「FP4 先探索、BF16 再训练」的后训练框架,将达到等效 reward 水平的收敛速度最高提升到 4.64x,在训练速度与对齐效果之间给出了一条更具工程可行性的解法。