一键接入OpenClaw,谷歌开源CLI狂揽15k Stars,Agent开始接管Workspace

一键接入OpenClaw,谷歌开源CLI狂揽15k Stars,Agent开始接管WorkspaceOpenClaw 火爆的盛况至今仍在持续,在国内甚至出现了排队在腾讯总部楼下等待安装 OpenClaw 的场景,让人感叹「一代人有一代人的领鸡蛋」。

搜索

搜索

OpenClaw 火爆的盛况至今仍在持续,在国内甚至出现了排队在腾讯总部楼下等待安装 OpenClaw 的场景,让人感叹「一代人有一代人的领鸡蛋」。

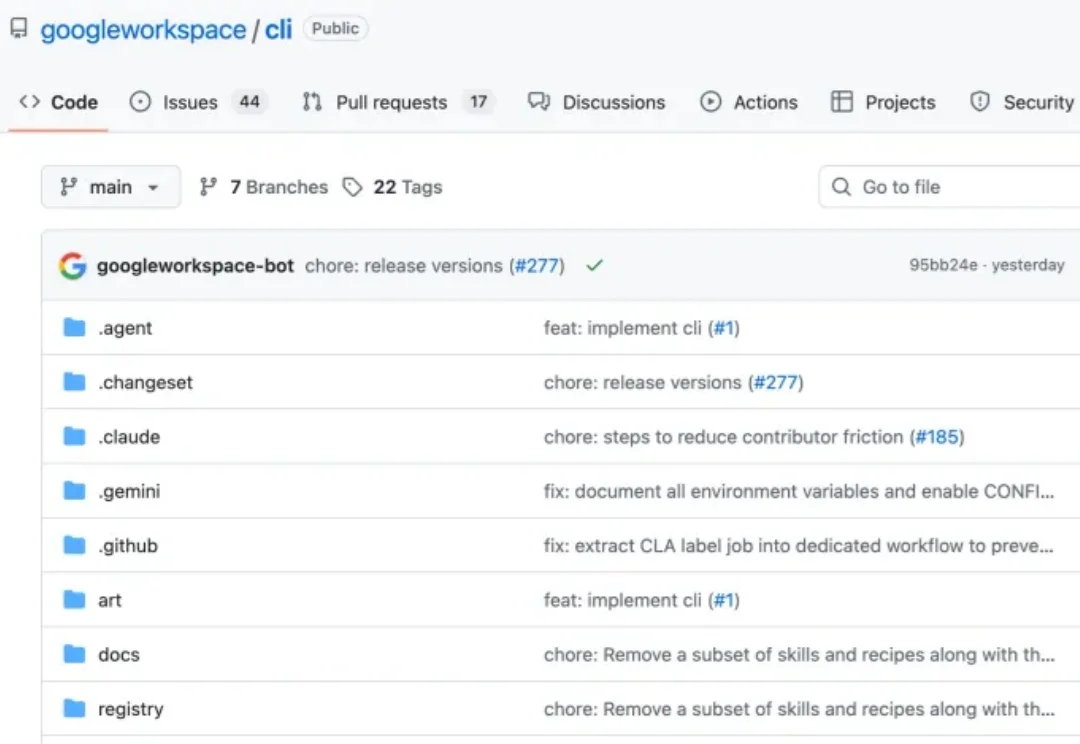

刚刚,Luma AI甩出全新模型Uni-1,正面对标谷歌Nano Banana Pro和GPT Image 1.5。Uni-1是一个统一的图像理解与生成模型。在官方展示中,Uni-1具备角色姿态迁移、故事板生成、草稿+材质结合参考生成、草稿转漫画、多参考图场景合成、草稿引导的照片编辑、UV贴图生成、带有文字的贺卡海报生成等诸多能力。

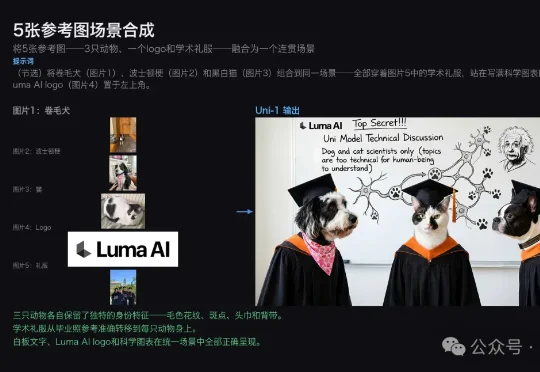

谷歌大神用6个AI智能体杀疯了。

过去,科学家观察研究细胞的工具很有限。

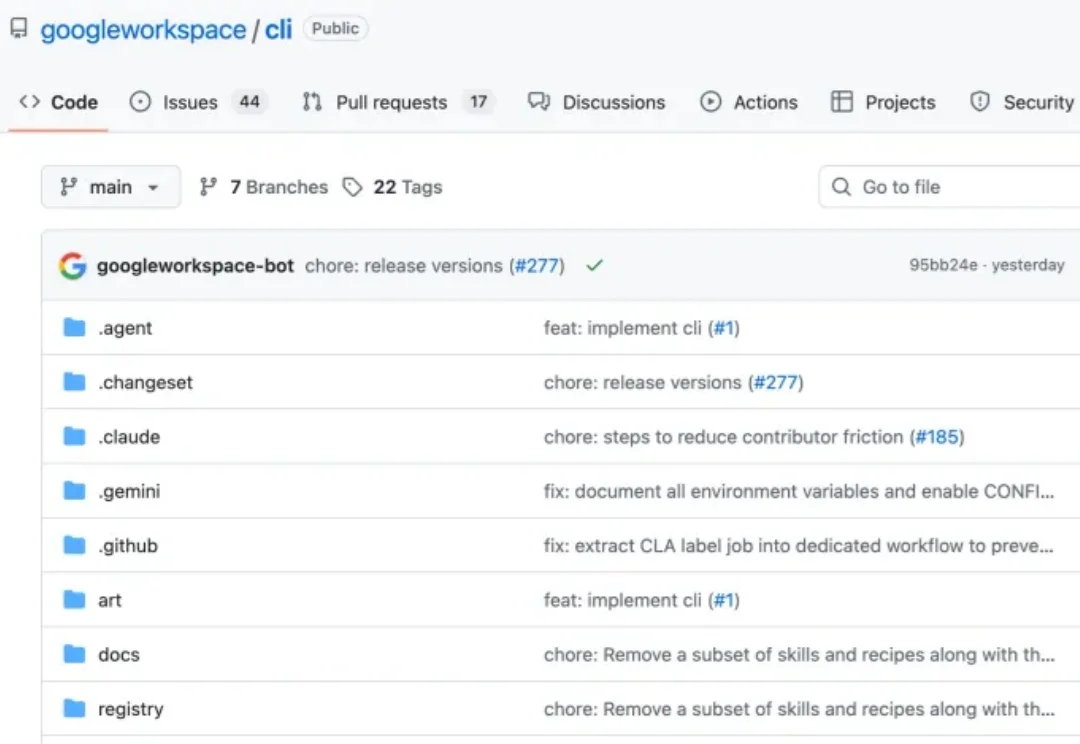

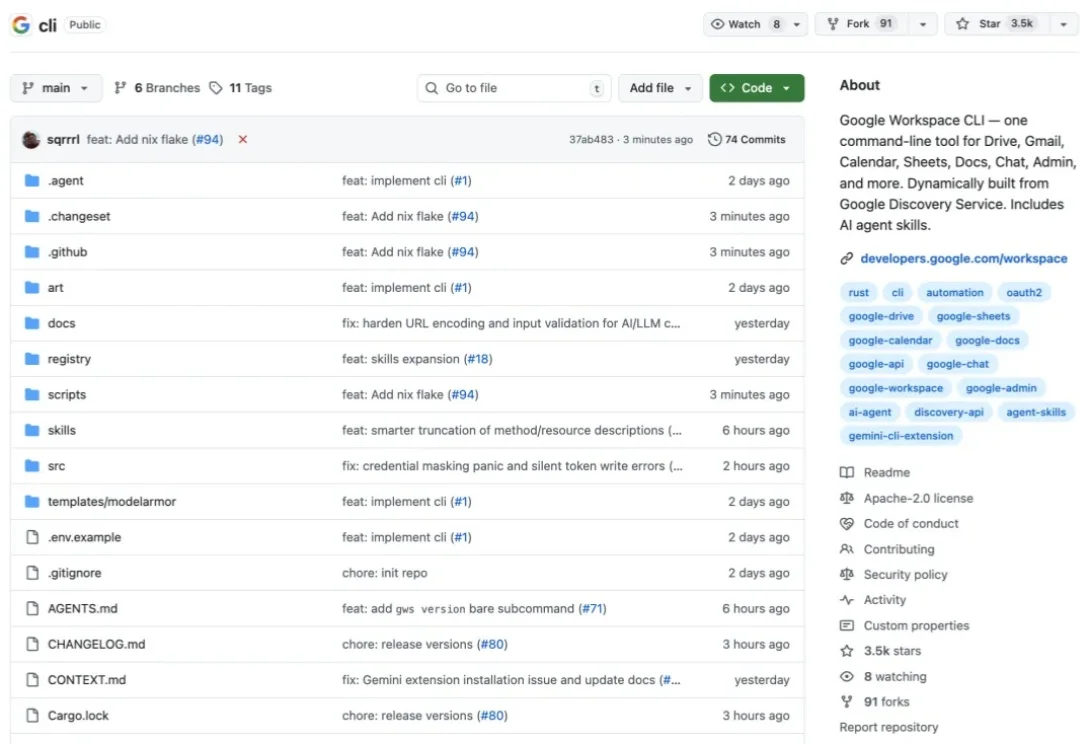

今天上午的时候,Google Workspace CLI 上线到了 GitHub,挂在 Google Workspace 的官方组织名下。我开始写这篇文章的时候,这个项目是 2700 个 Star;当我发出去的时候,重新截了个图,已经有 3500 个 Star 了

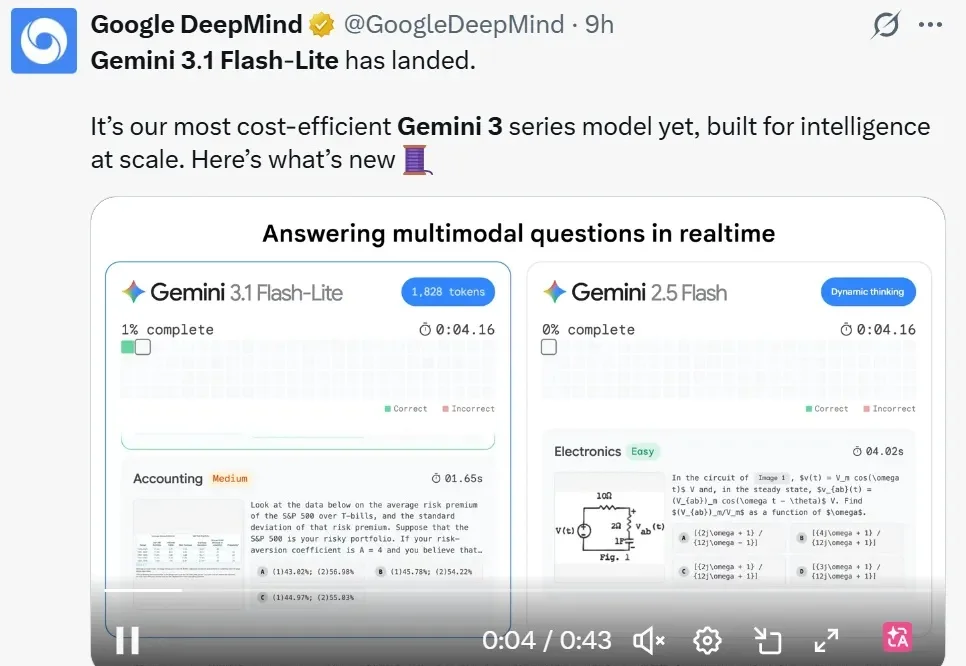

深夜,两大科技巨头谷歌和 OpenAI 硬刚起来,相继推出了新版本大模型,分别是 Gemini 3.1 Flash-Lite、GPT‑5.3 Instant。

GPT-5.3 Instant不卷跑分,专治「聊天翻车」:不再动不动拒绝回答,不再满嘴说教免责,幻觉率暴降27%,写作能力也跳了一个台阶。

首Token提速2.5倍,推理成绩干翻前代大模型。

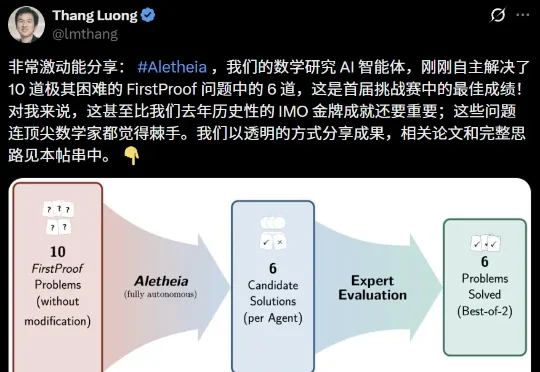

Google DeepMind最新AI智能体Aletheia在FirstProof挑战赛中,独立攻克了6道世界级数学难题,实现了从竞赛水平到PhD科研级的质变。人类数学研究的「手工时代」或许正步入倒计时。

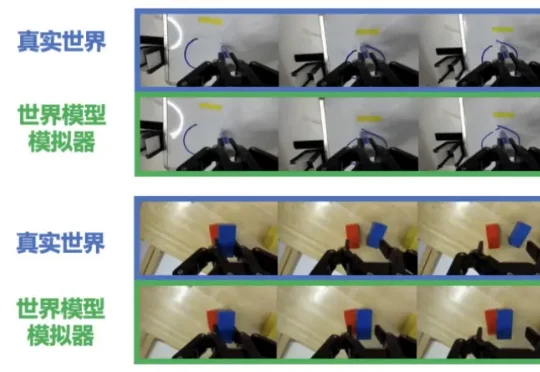

机器之心编辑部 整个具身智能领域都在探索世界模型的实用化路径。这个被寄予厚望的「数字模拟器」,本应成为机器人训练的核心工具,却因物理保真度低等问题成为「空中楼阁」。 去年年中,谷歌发布了 Genie-