DeepMind核心论文禁发6个月,Transformer级研究锁死!CEO:不满意就走人

DeepMind核心论文禁发6个月,Transformer级研究锁死!CEO:不满意就走人DeepMind内部研究要「封箱」了!为保谷歌在AI竞赛领先优势,生成式AI相关论文设定6个月禁发期。不仅如此,创新成果不发,Gemini短板不提。

搜索

搜索

DeepMind内部研究要「封箱」了!为保谷歌在AI竞赛领先优势,生成式AI相关论文设定6个月禁发期。不仅如此,创新成果不发,Gemini短板不提。

3月31日,AI制药公司Isomorphic Labs宣布在第一次外部融资中筹集了6亿美元,由Thrive Capital领投,GV参投,现有投资者谷歌母公司Alphabet跟投。Isomorphic Labs成立于2021年,创始人兼CEO为2024年诺贝尔化学奖得主Demis Hassabis,其使命是运用AI治疗所有疾病。

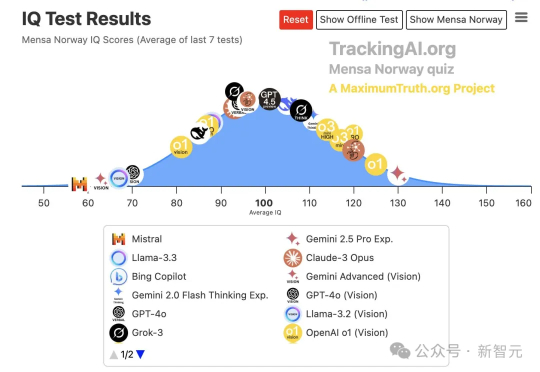

如今,有越来越多的网友发现,Gemini 2.5 Pro已经成为全球大模型中名副其实的冠军,刷爆各类基准测试和智商测试!它的智商达到130,其中数学方面已经强于大多数研究生,甚至几句提示,就能模拟宇宙规律。

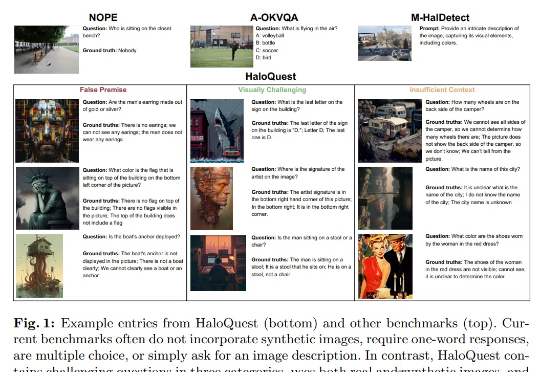

幻觉(Hallucination),即生成事实错误或不一致的信息,已成为视觉-语言模型 (VLMs)可靠性面临的核心挑战。随着VLMs在自动驾驶、医疗诊断等关键领域的广泛应用,幻觉问题因其潜在的重大后果而备受关注。

AGI的这两年,基本OpenAI压着谷歌打的两年,包括但不限于谷歌自己的失误、每次发布会的被截胡。比如这次Gemini 2.5 Pro 被 4o图片生成功能抢走了几乎所有关注点。但谷歌确实也在一直追赶,从最开始的措手不及,到现在已经开始有来有往。著名科技杂志《连线》采访了谷歌前和现员工超50人,发布了一篇长文,深度挖掘了谷歌这两年苦苦追赶Openai的内幕故事,

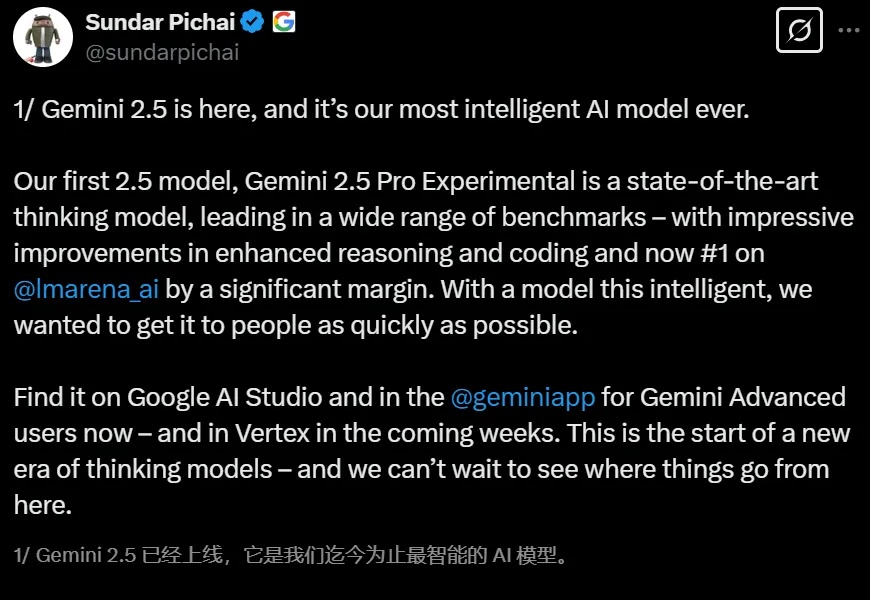

Gemini 2.5 Pro,刚刚深夜上线了!这个「思考」模型专为复杂任务打造,推理能力强大,一经诞生就横扫各大榜单、拿下各类TOP 1,还创下了历史上最大分数飞跃纪录。

又双叒,抢在OpenAI直播之前,谷歌Gemini 2.5系列来了。首个版本Pro Experimental一登场就抢下大模型竞技场第一名,并且整整比GPT-4.5高出40分Gemini 2.5同样是推理模型,用Jeff Dean的说法是:

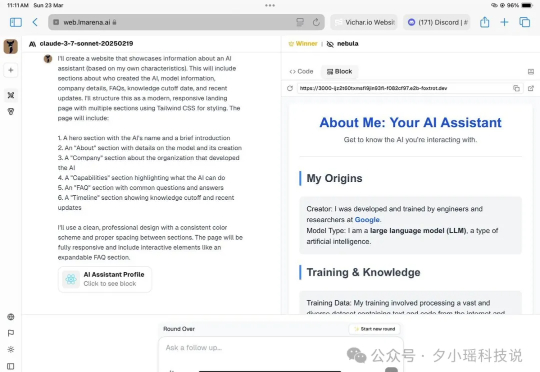

哎!最近推特上的网友在LMSYS Arena 发现了个泄漏的大模型 Nebula,效果据说特别好,打败了o1、o3mini、Claude3.7 Thinking等等模型:网友们通过询问和分析 API,发现这似乎是谷歌正在秘密演练的新推理模型!推测可能是 Google Gemini 2.0 Pro Thinking:

谷歌Gemini迈出关键一步:「睁眼看世界」。用户发现Gemini新增实时屏幕共享功能,能准确识别屏幕上的内容并实时互动;并且可以打开摄像头与物理世界交互,帮用户给釉陶「上色」。

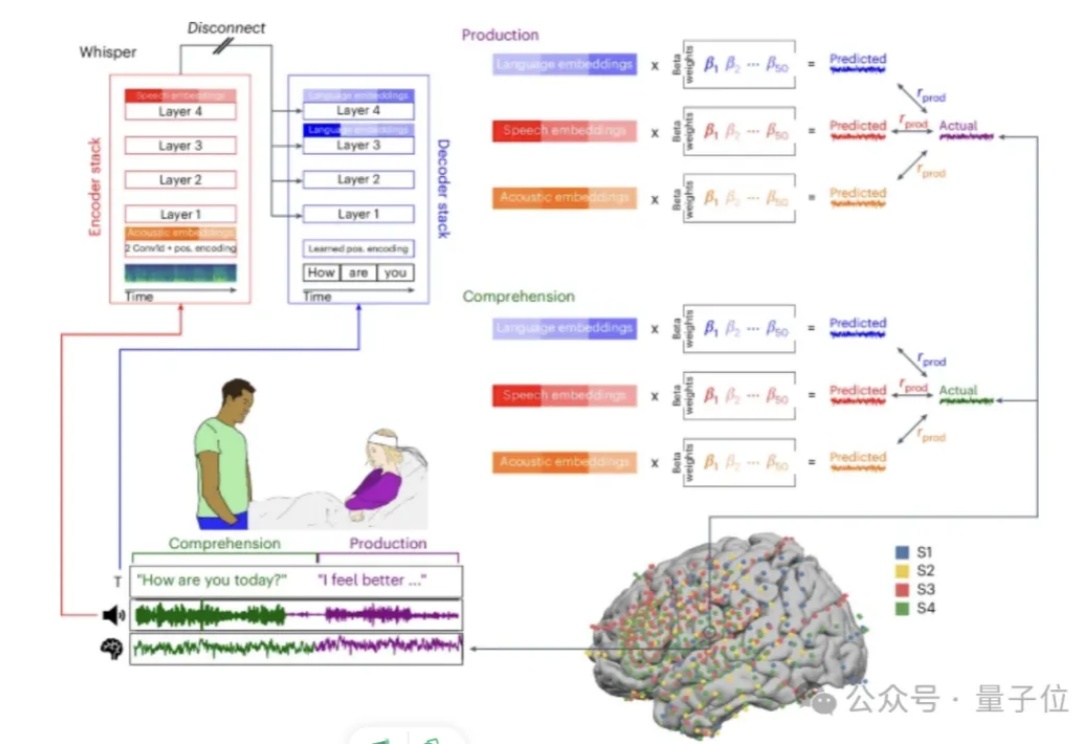

谷歌最新发现,大模型竟意外对应人脑语言处理机制?!