AI自己玩手机、玩电脑、操作网页浏览器……背后还只靠一个模型。

卷王字节Seed又把智能体带到了一个全新level~

比如任务是酱紫的:

编写一个可以转换重量单位的函数。如果原始单位是千克,目标单位是克,并且要转换的值是Mathilde Seigner(法国知名演员)被提名凯撒奖的次数加1,最终结果会是多少?

而通过一系列操作,Agent仅用时35s就得出了答案为4000克。

这就是Seed最新发布的智能体UI-TARS-2,它不止采用了All in one这样的原生设计,而且表现更是优于Claude和OpenAI Agent等竞争对手。

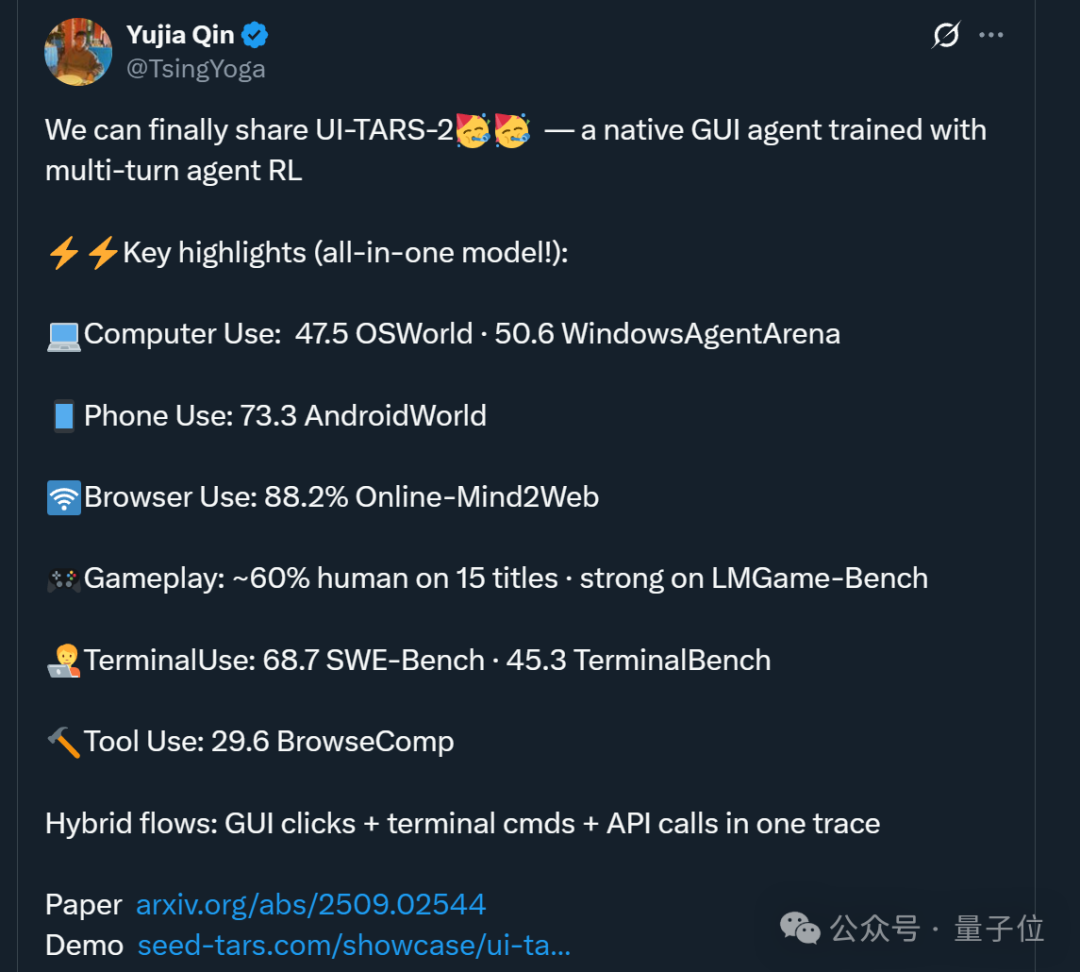

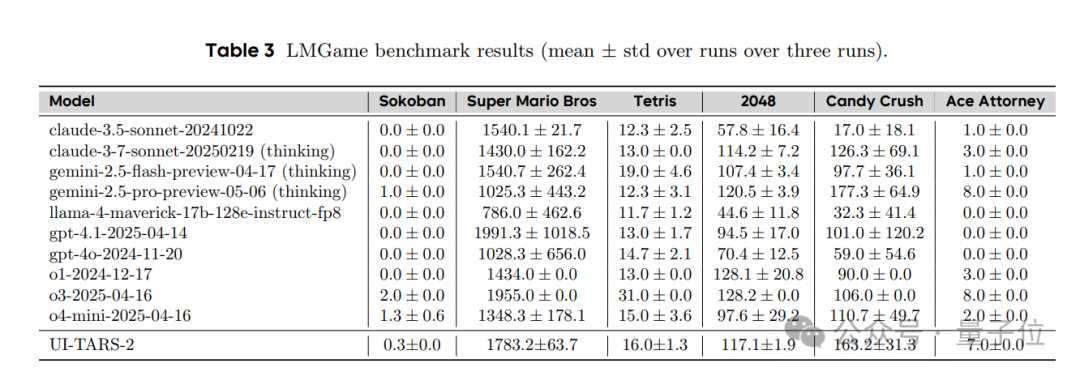

来看团队成员晒出的成绩单,不管是操作电脑/手机,还是使用浏览器、玩15款小游戏,其丝滑程度和完成率现在已经超越一众竞争对手,并进一步接近人类水平。

而且这里还透露了UI-TARS-2背后的关键秘诀:

一个通过多轮强化学习训练的原生GUI智能体

划重点,多轮强化学习。依靠这一技巧,UI-TARS-2核心解决了“让AI自主操作图形界面(GUI)”的四大难题:

且看字节团队如何见招拆招——

先来看UI-TARS-2的整体设计思路和框架。

其核心目标为:构建一个真正原生、通用、跨平台的GUI智能体,能在电脑、手机、网页、终端,甚至游戏里自主完成复杂任务。

为此,UI-TARS-2架构主要包含下面这几个部分:

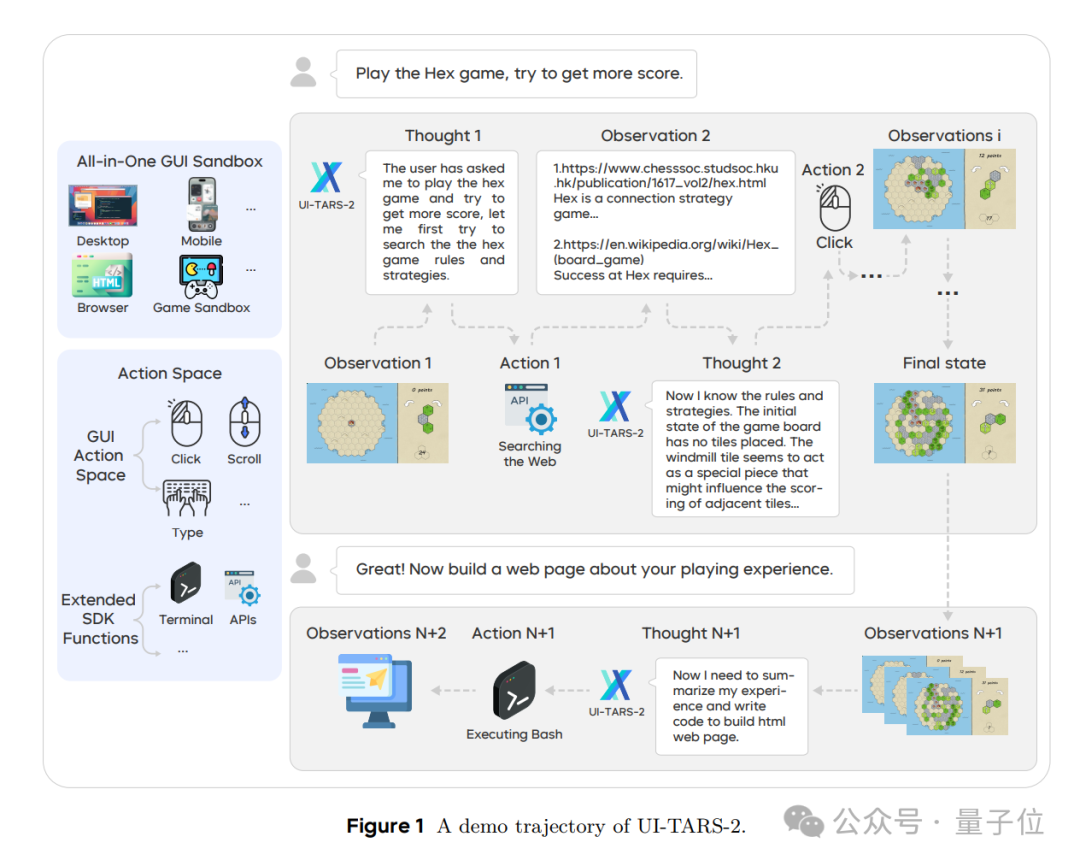

1、统一的Agent架构:以大语言模型为核心决策器(Planner),将自然语言指令→GUI/终端/工具操作,全部纳入一个通用执行循环,同时支持GUI点击、键盘输入、终端命令、API调用等多种操作流。

2、多模态感知与环境交互:输入端整合屏幕截图(视觉)+文本上下文+历史操作轨迹,输出端可以是点击坐标、拖拽动作、命令行、甚至API请求,形成感知—决策—执行—反馈的完整闭环。

3、多轮强化学习:不依赖人工标注,而是通过环境反馈奖励优化策略,同时采用模拟环境(sandbox)+自动化任务生成,构建出“数据飞轮”,让模型能不断自我进化。

4、混合操作流(Hybrid Flows):在一次任务轨迹中,智能体可以无缝组合GUI点击、终端命令和API调用。例如,在网页上找资料(GUI),处理数据(终端),再调用搜索API(工具)。

下面这个让UI-TARS-2玩游戏的例子,很好地展示了这套框架的具体运作过程:

而基于这套框架,UI-TARS-2逐一解决了智能体自主操作GUI面临的四大难题。

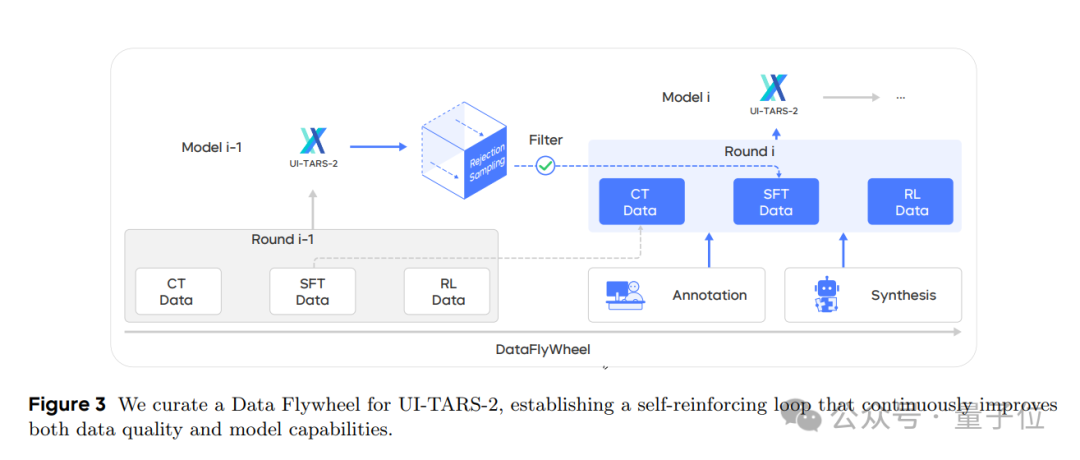

为了打造数据飞轮,团队采用了以下策略:

1)冷启动:这一阶段主要是广泛收集原始数据,以及通过合成数据和人工标注来构建监督微调所需的原始高质量、任务针对性强的数据。

2)多轮迭代:有了数据之后,先让模型通过预训练学习更广泛的知识(如不同GUI操作流程、任务解决思路等),再使用高质量特定任务数据对模型进行优化,最后通过强化学习进行端到端优化。

在每轮迭代中,团队会使用拒绝采样(RFT)或交互标注生成新轨迹,这些轨迹记录了模型在执行任务过程中的推理、动作、环境状态以及反馈等信息,将其按质量筛选后,高质量的进微调数据集,低质量的进预训练数据集。

3)循环增强:然后模型用更新后的数据集重新训练,能力提升后又能生成更好的轨迹,形成“模型变好→数据变好→模型更好”的循环,不断解决数据稀缺问题。

针对传统强化学习在GUI长周期任务中“奖励稀疏、优化不稳定、信用分配难” 的问题,团队从任务设计、奖励机制、训练流程三方面进行了优化。

如何进行任务奖励设计?团队先对任务类型进行拆分:

对可验证任务(如游戏得分、网页信息检索),用明确信号(成功/失败、LLM对比答案打分)当奖励;

对模糊任务(如复杂GUI操作),训练UI-TARS-2自身作为“奖励模型”,根据轨迹和截图输出任务成功分数,保证奖励可靠。

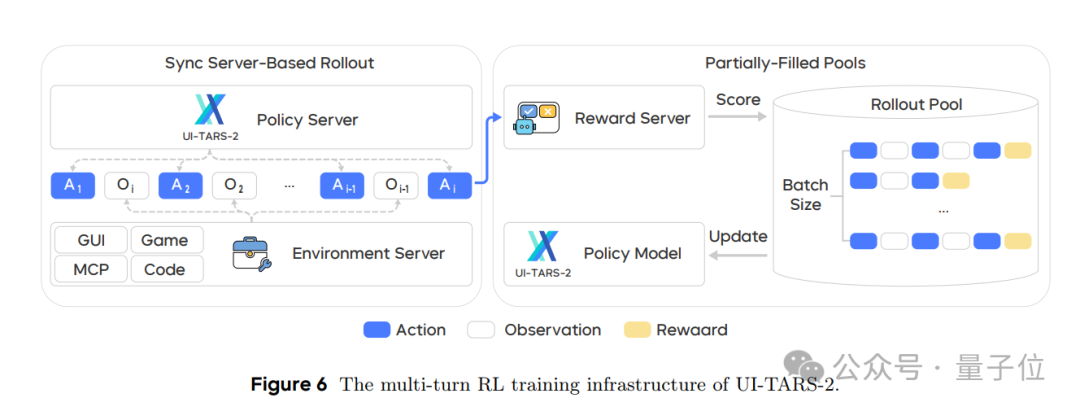

确定了这一模式后,团队摒弃“等所有任务完成再训练”的模式,转而采用“异步rollout”——

把模型推理环节单独拿出来,和实际执行过程分离,互不干扰;同时只要凑够最少需要的轨迹数量,就立刻用这些完成的轨迹开始训练,那些未完成的就留到下一轮。

等到训练时,团队还在PPO算法上进行了3处优化,从而让模型操作更稳,包括用“解耦GAE”避免长序列价值估计偏差、用“不对称裁剪”鼓励模型尝试那些看似不常用、但可能有效的操作等。

为解决纯GUI操作(仅鼠标/键盘)无法应对数据处理、软件开发等复杂工作流的问题,团队构建了“GUI+多工具”融合的交互环境:

不仅整合多操作流,比如在同一环境里,智能体既能做GUI基础操作(点击、输入、滚动网页/APP),又能直接调用终端命令(如用Bash处理文件)、调用API,无需切换上下文。

还为其适配多场景载体,比如在云虚拟机里,内置文件系统、远程VS Code、Jupyter等工具;在浏览器沙箱里,也能关联终端功能,让操作覆盖“桌面-移动-游戏” 全场景。

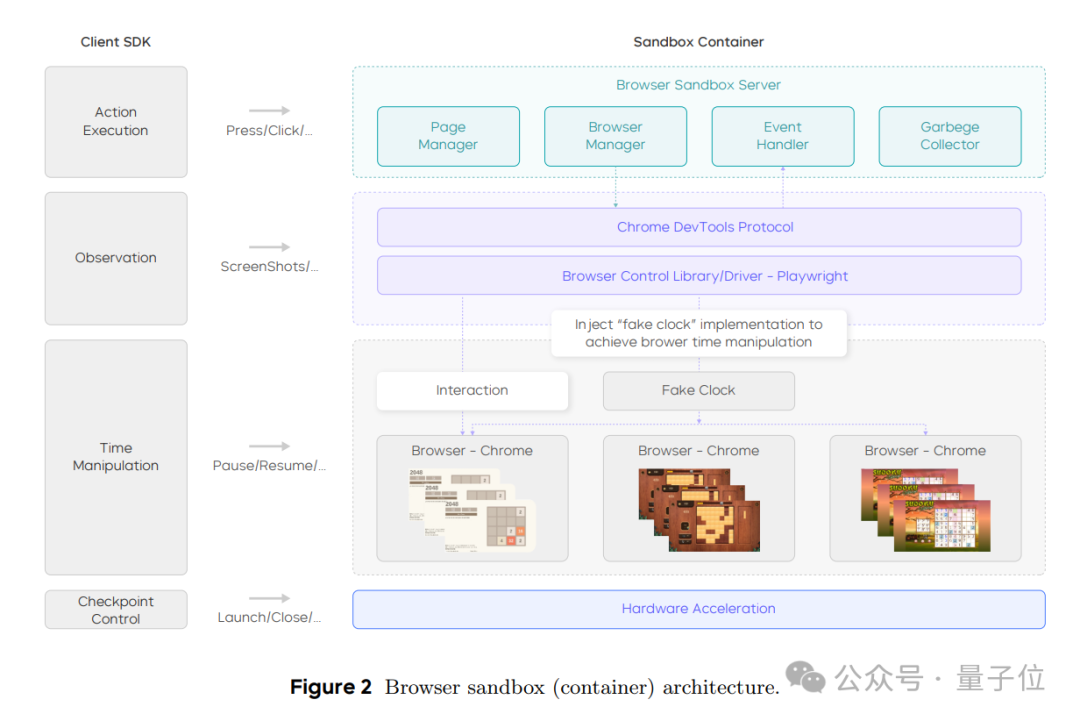

针对传统环境“难复现、易崩溃、吞吐量低”的工程瓶颈,团队打造了兼容多载体的统一沙盒,保障百万级交互训练需求。

简单来说,这就是一个虚拟的模型训练场,支持智能体在里面大规模练习、试错和进化。

以下为一个浏览器沙盒的示意图,据此也能看到沙盒的大致运作方式:

那么,UI-TARS-2的实际表现如何呢?

根据介绍,UI-TARS-2是团队基于Seed-thinking-1.6(总参数230B,含532M视觉编码器 + 23B激活参数),经过多轮迭代训练而成。

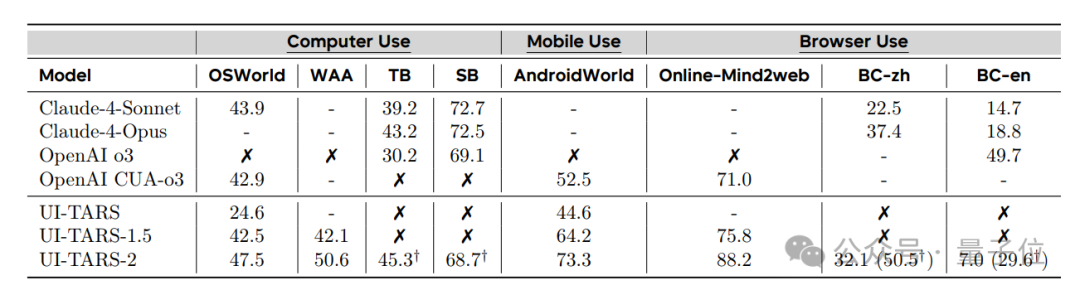

在多个权威GUI测试里,比如OSWorld(369个Windows/Ubuntu/macOS任务)、WindowsAgentArena(150个 Windows任务)、TerminalBench(命令行任务)等,它的得分都比Claude、OpenAI的同类模型更高。

换句话说,在电脑、手机、浏览器操作上,UI-TARS-2的表现明显更好。

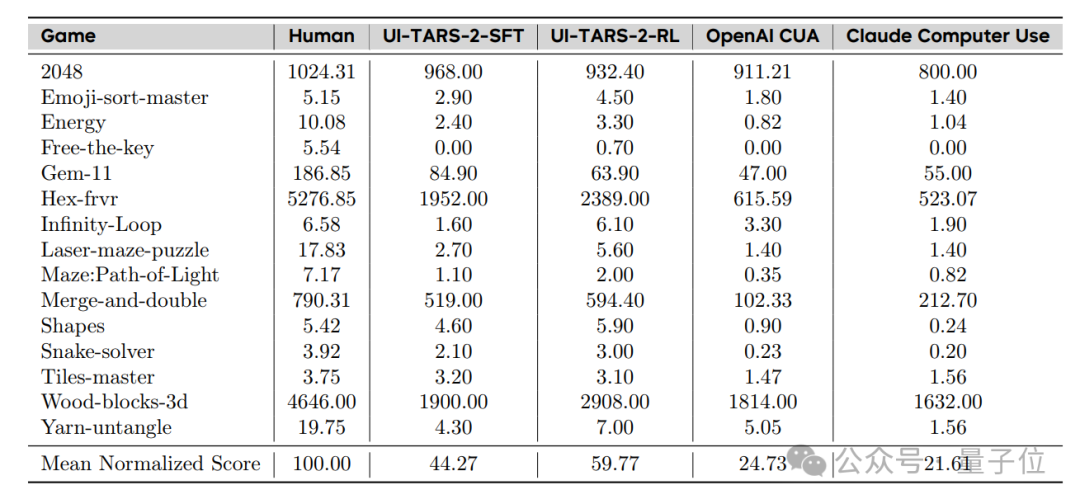

而且在15款小游戏(比如2048、拼图、迷宫)里,它的平均得分差不多是人类水平的60%,比OpenAI、Claude的游戏AI强不少,有的游戏(如“Shapes”)甚至比人玩得还好。

即使面对一些更复杂的游戏测试(LMGame-Bench),它也能和o3打得有来有回。

当然了,它不光会点界面、玩游戏,还能干“查资料”、“写代码修bug” 这样的活儿,而且成绩比只靠界面操作强很多。

总之,UI-TARS-2无疑验证了多轮强化学习在智能体进化上的有效性。

论文:

https://arxiv.org/abs/2509.02544

demo:

https://seed-tars.com/showcase/ui-tars-2/

参考链接:

[1]https://x.com/TsingYoga/status/1963629621326614940

[2]https://x.com/_akhaliq/status/1963229296236937443

文章来自于微信公众号“量子位”,作者是“一水”。

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner