地球现在连显卡都供不起了,微软的GPU插不进机房。英伟达的H100直接飞向太空。

英伟达的GPU,地球真的已经「供不起了」!

今天看到两个新闻,一个是微软手里囤了无数的GPU,但是「插不进去」。

另一个是英伟达H100 GPU被发射到太空组建数据中心。

这两个事情其实背后都隐藏着一个深刻问题:

GPU是造出来了,但是配套服务于GPU,给GPU供电,给GPU散热的基础设施并没有跟上!

先说微软的GPU放在库房里吃灰这件事。

微软CEO纳德拉在与OpenAI奥特曼的访谈中爆出惊人事实——微软手中囤积着大量GPU。

却「没有足够电力」让它们运转。

另一个原因则更为现实,缺少可以立马「插入GPU」的数据中心。

纳德拉坦言:我现在的问题不是芯片不够,而是没有能插进去的「温暖机壳」(Warm Shell)。

所谓「Warm Shell」指的是具备供电与冷却条件的数据中心外壳。

用一个对比就能快速理解这个概念,建筑学上,相对Warm Shell则是Cold Shell。

Cold shell指的是建筑结构/外壳基本具备,但室内几乎没有或只有极少的系统安装。

Warm Shell则是更准备好了的状态,安装并可以使用基本的建筑系统,比如散热系统、暖通空调(HVAC)、照明、基本电/水/消防系统等。

AI热潮引发的芯片竞赛,如今正受制于最传统的瓶颈——电力。

美国电网面临前所未有的压力,而科技巨头则竞相布局小型核反应堆以自救。

与此同时,奥特曼还提到未来可能出现「能在本地运行GPT-5或GPT-6」的低功耗消费设备,这或将彻底颠覆现有数据中心商业模式。

相比奥特曼提出的低功耗设备,另一个新闻则提供了新的思路。

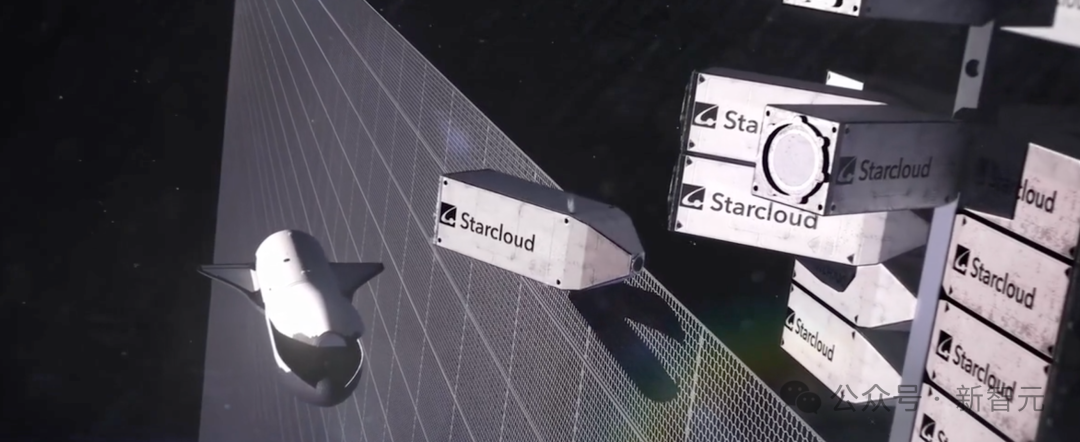

英伟达借助Starcloud的Starcloud-1的卫星,将H100送到太空!

11月2日,星期日,英伟达首次将H100 GPU送入太空,以测试数据中心在轨道上的运行方式。

这款配备80GB内存的GPU,比以往任何在太空中飞行的计算机都强大一百倍。

支持者认为这一想法很合理:

在远离地球的太空空旷处,数据中心不会占用宝贵土地,也不需要那么多能源和水来冷却,也不会向大气中排放加剧变暖的温室气体。

这次为期三年的任务将搭乘SpaceX的Bandwagon 4猎鹰9号(Falcon 9)发射。

重量为60公斤的Starcloud-1卫星将在约350公里高度的非常低轨道绕地飞行。

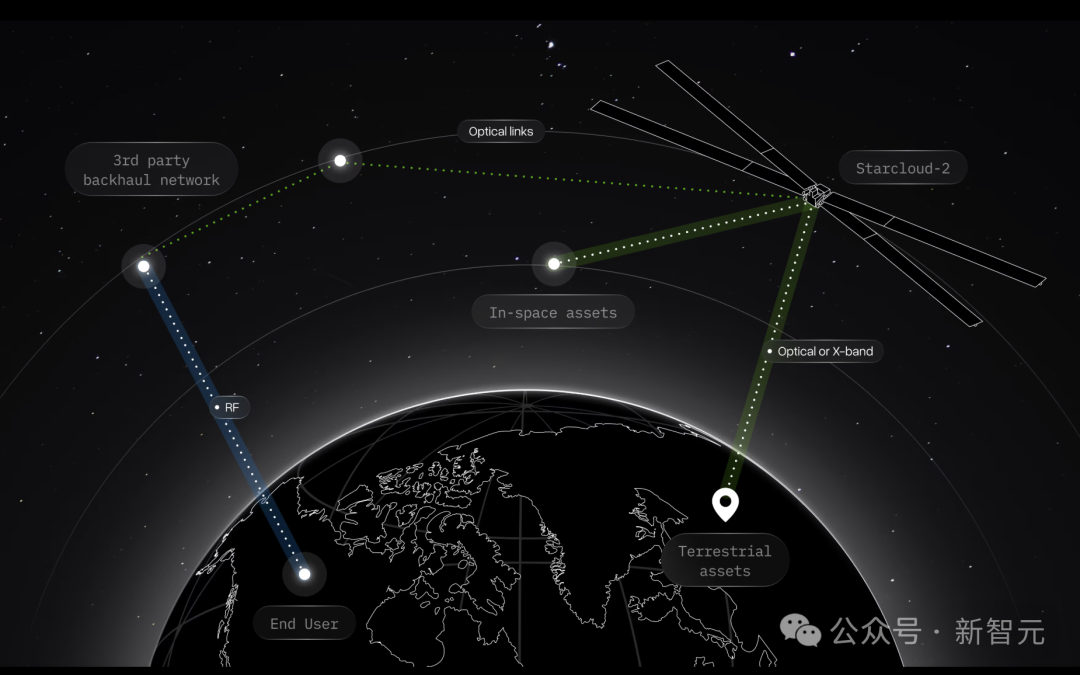

在那里,它将接收由美国公司Capella运营的一队合成孔径雷达(SAR)地球观测卫星传来的数据,对其进行实时处理,并向地面传送消息。

而在太空设立数据中心另一大优势就是,只需回传很小部分的数据。

下行传输合成孔径雷达(SAR)数据历来是个大问题,因为数据量极其庞大。

但能够在轨处理就意味着我们只需下行传输「洞见」。

什么是洞见?

所谓洞见可能是某艘船在某个位置以某个速度朝某个方向航行。

那只是一小包约1千字节的数据,而不是需要下传的数百吉字节原始数据。

简单来说,就是让算法贴近数据源头,在本地完成筛选、融合与推理,仅把高价值的「信息摘要」回传。

再简单点(但不一定精确),就是数据都在外太空处理好,只传送回来结论。

这种方式能更好地实现低时延响应、显著节省带宽与能耗、提升韧性(断联/灾害场景可持续运行),并降低敏感数据外泄风险。

和微软CEO纳德拉的烦恼不一样,Starcloud是主动探索这种数据中心模式。

就像他们的公司名字一样,Stra Cloud,太空的数据中心。

当然这么做的主要驱动力不是为了GPU降温。

而是地球能源与资源的瓶颈:

地球数据中心太耗能了!

到2030年,全球数据中心的耗电量预计将等于整个日本的用电量。

同时,它们每天要消耗海量冷却用水(1 MW 级中心≈1000人日用水量)。

相比下来,太空则是有天然优势。

无限太阳能:轨道上 24 小时都有阳光,无需电池储能。

零土地占用:不需要地面建设,不破坏生态。

无温室气体排放:不依赖化石能源。

归根到底,还是现在AI的算力需求爆炸。

AI模型越做越大(如GPT、Claude、Gemini等),能源和冷却成本飞涨,企业急需新解法。

因此,太空数据中心被视为长期可扩展的解决方案。

通过利用低成本、持续不断的太阳能,并避免占用土地和使用化石燃料,Starcloud的技术使数据中心能够快速且可持续地扩展,随着数字基础设施的发展,这有助于在保护地球气候和关键自然资源的同时实现增长。

另一个值得一提的就是,很多人觉得GPU上天,是因为地球太热,太空好散热。

其实不是的。

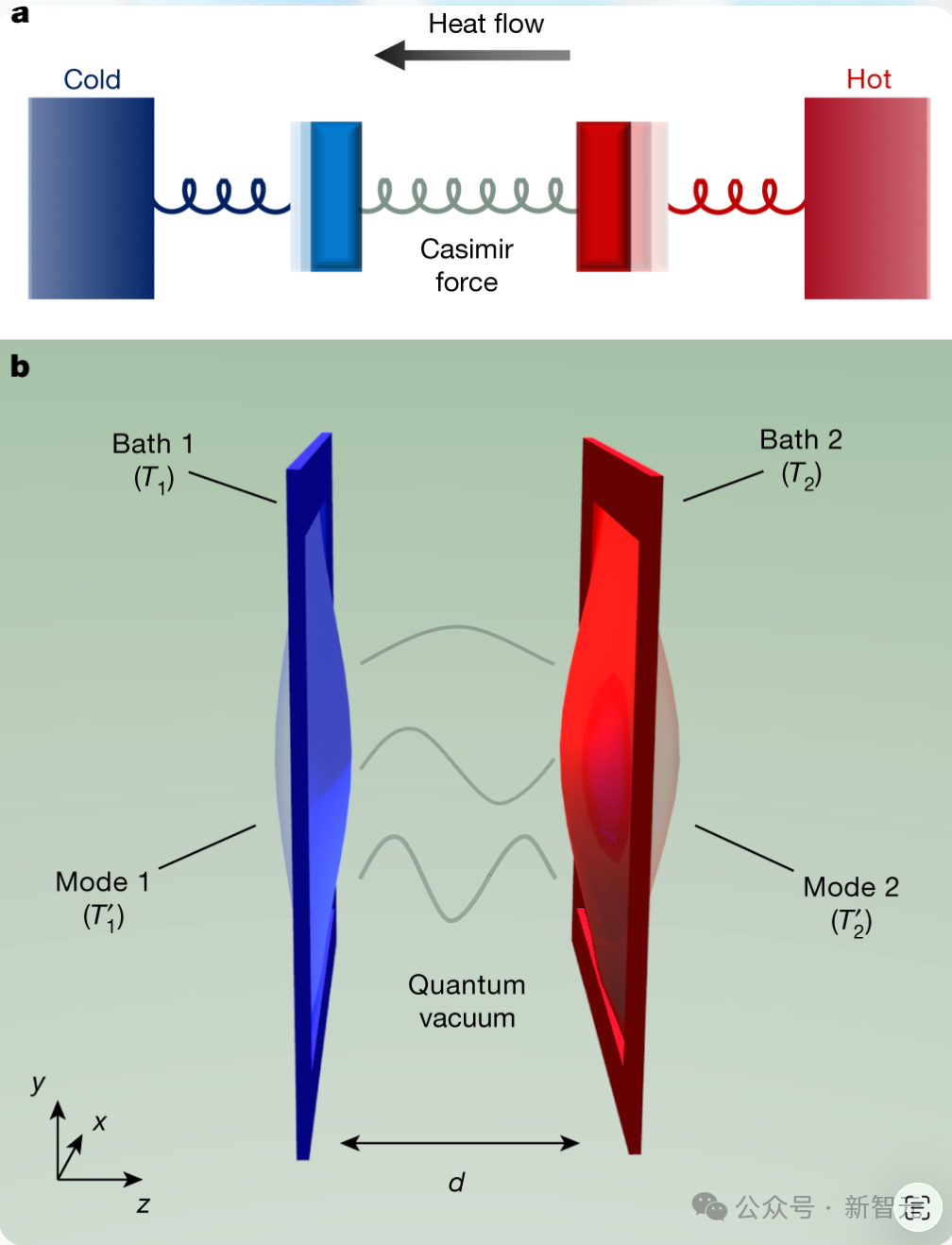

太空能散热,但很困难。

太空几乎没有空气,所以不能用风扇或液体循环带走热量(这叫对流散热)。

对流散热指的是「热的流体(液体或气体)移动,把热量从一个地方带到另一个地方」的过程。

只剩下辐射散热这一种方式:

辐射散热是「物体通过电磁波/红外波,把热量以波的形式发射出去」的过程。

设备通过红外辐射向外太空释放热量。

散热效率取决于辐射面积、材料发射率和温度。

因此卫星或太空GPU需要大面积的散热板(radiators),设计极其关键。

在Starcloud的项目中,这部分被特别强化:

他们为H100设计了专用热辐射系统,利用真空中的高温差和导热材料实现散热。

为了给地球省电、省地、省水,去太空建数据中心靠谱吗?

Starcloud的首席执行官兼联合创始人约翰斯顿说:

我的预期是,在十年内,几乎所有新建的数据中心都会建在太空。

原因纯粹是我们在陆地上面临的能量限制。

约翰斯顿说在太空中唯一的额外成本就是发射费。

发射成本在每公斤约(美)500 美元时能够达到收支平衡。按每千克计算,SpaceX的星舰在完全投入运营后,发射价格估计在150美元到仅10美元不等。

随着星舰的投入使用,我们预计发射成本会更低。

Starcloud已经在规划其下一次任务,计划明年将一个计算能力比Starcloud-1强十倍的数据中心送入太空。

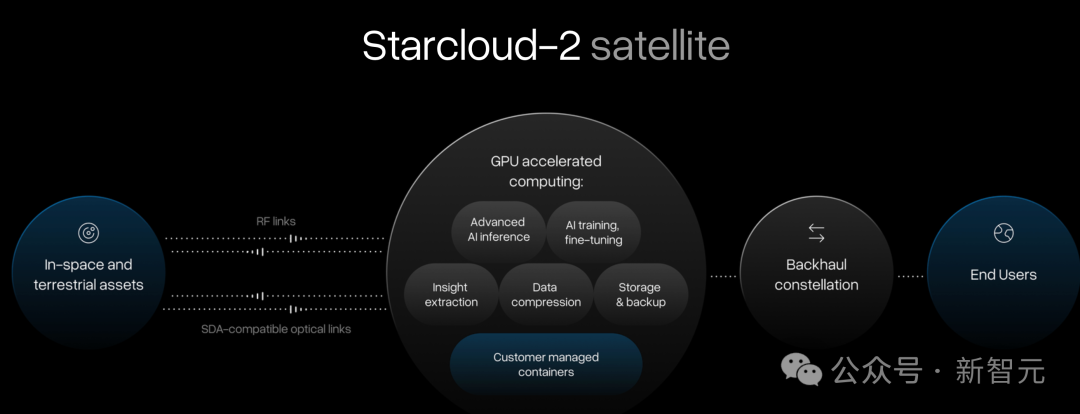

Starcloud-2任务将配备英伟达的Blackwell GPU和若干H100。

约翰斯顿表示,该任务将提供7千瓦的计算能力,预计为包括地球观测卫星运营商客户提供商业服务。

微软的「没有温暖机壳」,和Starcloud把H100送上天,本质上是同一道题。

AI再厉害,算力需求再大,也不能突破物理定律。

参考资料:

https://www.starcloud.com/starcloud-2

https://spectrum.ieee.org/nvidia-h100-space

文章来自于“新智元”,作者 “定慧”。