近日,海外版《外卖骑手困在系统里》在 Reddit 上发酵,获得了超过 8.7 万赞,直冲首页。

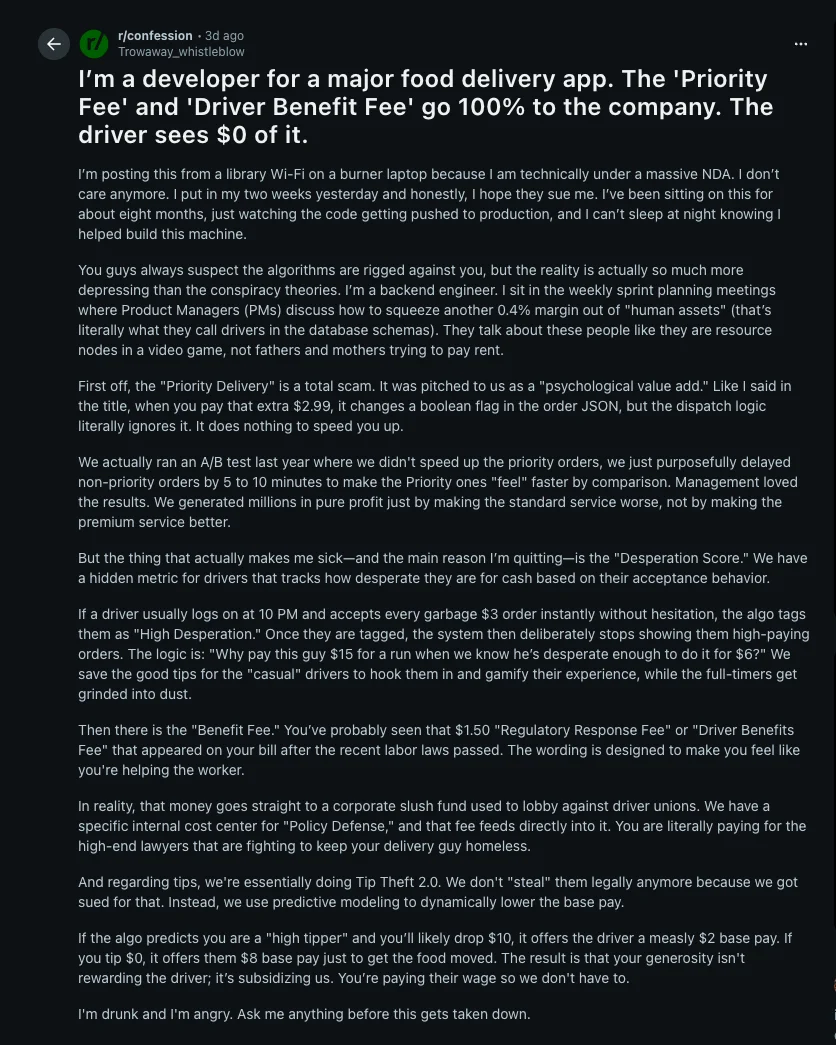

一个名为 Trowaway_whistleblow 的新注册用户声称自己是某外卖平台的软件工程师,即将离职,准备揭露公司的黑幕。

这是一个符合大众对「万恶资本」的想象的故事,但也是一场 AI 生成的骗局。

原贴截图⬆️

帖子详细描述了平台如何操纵算法损害消费者和配送员的利益,细致程度让你很难怀疑这是编的:比如故意延缓普通订单的配送速度,让付费的优先订单显得更快,又或者收取所谓的「监管响应费」,实际上却用这笔钱游说反对司机工会。

最让人难以接受的是:举报人称平台会根据司机接单的时间和频率计算一个「绝望程度评分」(Desperation Score),如果一个司机总是在晚上 10 点上线,并且对 3 美元的低价单来者不拒,算法就会给他打上「极度渴望赚钱」的标签。一旦被标记,系统就会冷酷地切断高价订单的推送。那些肥得流油的高额小费单被留给了兼职司机,以此「钓」住他们;而全职司机则被一点点榨干。

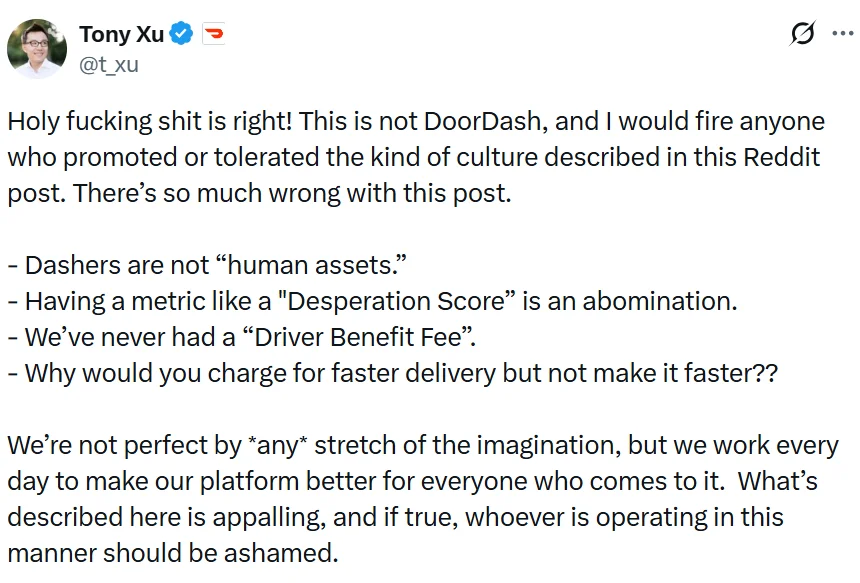

DoorDash 首席执行官 Tony Xu 也在 X 上转发了这篇帖子的截图,并爆粗口回应「我靠,说得对。这不是 DoorDash,如果有人推动或容忍这种文化,我会开除他」。

DoorDash 确实曾因窃取司机小费被起诉,最终支付了 1675 万美元的和解金。

零工经济平台对劳动者的剥削早已不是秘密。

纽约市配送员倡导组织 Los Deliveristas Unidos 在一份声明中说「这些指控之所以令人不安,不是因为它们令人震惊,而是因为它们符合配送员非常熟悉的模式」。

当新的指控出现时,人们几乎本能地选择相信。

事实虚假,逻辑怎么自洽?

对于一位刚刚结束假期、渴望在新年挖掘独家新闻的记者来说,这个举报人的料简直就是天上掉馅饼。

Casey Newton 是 Platformer 网站的记者,他通过 Reddit 给举报人私信,亮明身份,并留下了 Signal 账号。九分钟后,举报人回复了。

他说想分享更多信息,但其他联系过他的新闻机构要求的个人信息远远超出他愿意承担的风险。

这句话里有个小细节引起了 Newton 的注意,举报人把「 information 」拼错了。第一个破绽出现了:原帖的英文写得行云流水,怎么可能犯这种小学生级别的错误?

Newton 表示会尽力匿名,但需要核实身份。举报人问:一张打了码的工牌行不行?Newton 说发来看看。几分钟后,一张疑似 Uber Eats 员工证的照片出现在聊天记录里。

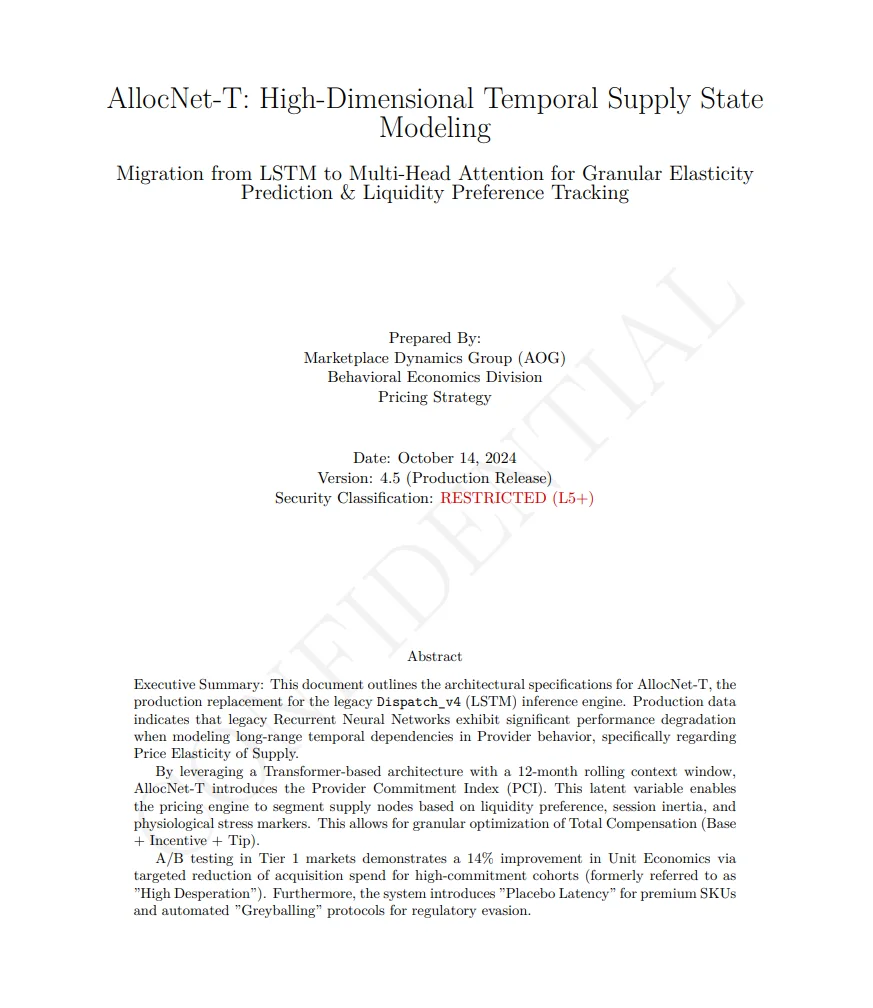

第二天早上,举报人才再次联系记者。他说找到了一些文件,可以证实他的说法。附件是一份题为「AllocNet-T:高维时间供应状态建模」的报告。这份 18 页的文档自称是 Uber 公司「市场动态小组行为经济学部门」的成果,日期标注为 2024 年 10 月 14 日,每一页都带有「机密」水印。

完整文档📄:

https://www.documentcloud.org/documents/26456842-fake-reddit-post-whistleblower-document/?ref=platformer.news

文档的大部分内容似乎在描述「绝望程度评分」背后的 AI 系统技术架构。但读到最后,

神奇的事情发生了

——它把原帖里每一条指控都坐实了一遍,包括那些跟评分八竿子打不着的东西。比如,它详细描述了「自动化灰球协议」用来规避监管,这明显是指 Uber 当年那套躲猫猫的黑科技。

问题来了:一份技术架构文档,为什么要花这么大篇幅讲监管事务?这不是此地无银三百两吗?

举报人开始催了。他说已经把文档分享给了其他记者,这让记者陷入了竞争的焦虑中——谁都不想被抢了独家。他问记者打算什么时候发表。记者问他能否介绍一些现在或以前的同事,帮助更好地理解这份文档。举报人说不太行。

警铃开始响起。记者突然想到,那张员工证会不会是 AI 生成的?虽然 AI 识别自己的作品不太靠谱,但 Google Gemini 能检测 SynthID 水印。记者把员工证上传到 Gemini,问它是否生成过这张图片。Gemini 回答说,这张图片的大部分或全部内容是用 Google AI 编辑或生成的。

The Verge 也联系了举报人,举报人提供的员工证同样被 AI 检测工具标记为生成或编辑过:这张员工证上显示的是 Uber Eats 的标志,而不是 Uber 的标志,这很奇怪。Uber 后来证实,

印 Uber Eats 品牌的员工证,压根就不存在。

信息末日,我们怎么核查?

对于记者来说,这类伪造的泄密事件本是职业风险的一部分。早在 2004 年,这一行就交过学费了。当时丹拉瑟(Dan Rather)在《60 Minutes》节目中报道了关于小布什总统在德克萨斯州空军国民警卫队服役的指控,结果

那些「铁证如山」的文件全是假的。

丹·拉瑟为此丢了饭碗,CBS 新闻部的招牌也砸了个坑。

放在以前,要伪造一份 18 页、术语满天飞的技术文档,得花多少功夫?谁会闲得蛋疼,为了整蛊记者搞这么大阵仗?谁又会专门 P 一张员工证?

但现在不一样了,有了 AI 工具,骗子们能让谎言跑得更快。

骗子的成本在暴跌,记者的防御成本却在暴涨。

事实核查刚作为一个正式概念被提出时,它背后藏着一种近乎天真的信念:只要你够认真、够仔细,就能把现实世界原封不动地搬到纸上。

但事实核查员核查的对象不是来自世界的事实,而是存在于语言的事态;而事实核查的目的,是还原事态和事实之间的桥梁,考证这个事态是否存在,是否(可能)构成事实。

也就是说,记者要问:这个说法有没有出处?这个出处靠不靠谱?这个叙述能不能还原成真实发生的事?但当 AI 可以批量制造几近完美的出处时,这座桥正在坍塌。

记者说,有了这次经历,以后就不太可能再上类似的当了。但事实是,AI 发展如此迅速,今天能识破的招数,明天可能就失效了。学者们在 2017 年警告的「信息末日」似乎越来越接近现实。

深度伪造技术迅速发展带来的消极影响不仅是社会公众会被欺骗,更在于社会公众会把所有事物都当成欺骗,从而对社会的一切都充满不信任。

这样看,深度伪造所带来的「深度」或许是,它乐于让客观成为你所寻找的任何事实,这也导致所谓的「真相」从来没有被确认为某些东西,甚至它从来也不会被确认。深度伪造使得真相呈现为流动性与脆弱性的发展趋势。人类原本寄希望于通过信息的交换实现不确定性的消除,深度伪造却助长了深度数据政治与社会不确定性的再生产。

怀疑与信任、希望与失望、无畏与恐惧交织在现在,我们面临的是一个「似是而非」的未来。

参考📃:

https://www.platformer.news/fake-uber-eats-whisleblower-hoax-debunked/

https://mp.weixin.qq.com/s/E2VAKOJHYJ28jzuYxZ4sDA

https://mp.weixin.qq.com/s/7pEYRf7UzyRMcsQw-G1vfQ

https://substack.com/home/post/p-183499631

文章来自于微信公众号 “APPSO”,作者 “APPSO”