龙虾太火,所有人都想一试。但真到了上手环节就会迎来第一道“拦路虎”——

急急急,究竟哪个模型最适合OpenClaw啊??

知道你急,龙虾之父亲自赶来支招了:可以关注这个因吹斯汀的榜单。

榜单名为PinchBench,专为龙虾而生,从成功率、速度、价格等维度评估全球大模型对OpenClaw的适配程度。(划重点,还是实时更新那种)

这个榜单其实今年2月底就出现了,但现在却更火了——

这里面不止有龙虾之父推荐的功劳,更重要的原因是咱中国模型的表现确实出色。(老外一看,嗯??)

熟悉龙虾的朋友都知道,这选模型可是一件大事。

毕竟龙虾这玩意儿一吃token耗钱,二又不能太慢影响用户体验。

换言之,人人都在价格和速度之间艰难走钢丝。

而PinchBench要做的,就是直接告诉你答案——它按照成功率、速度、价格这三个基本维度对全球模型进行排名,所以哪个模型更擅长什么基本都一目了然。

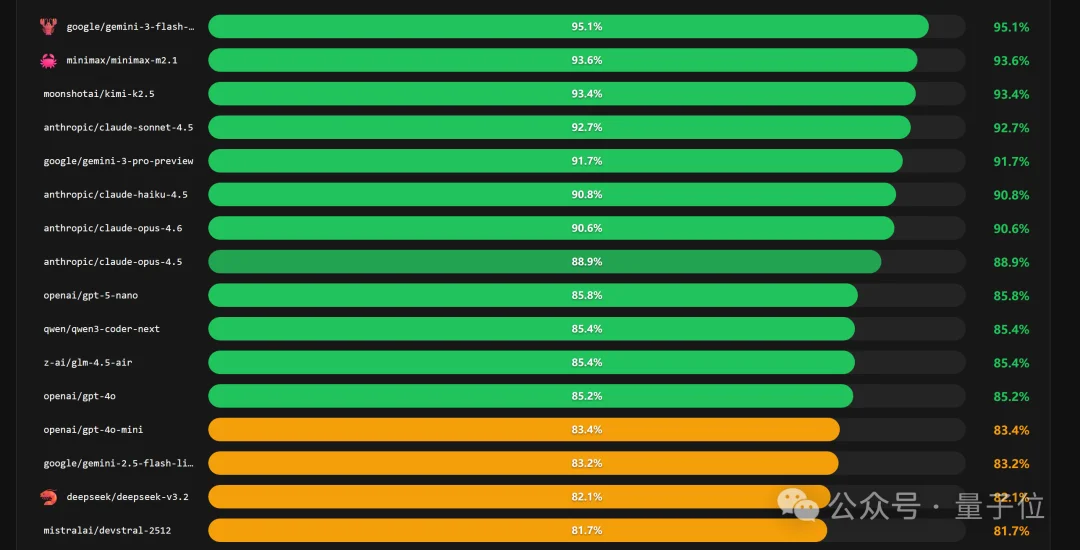

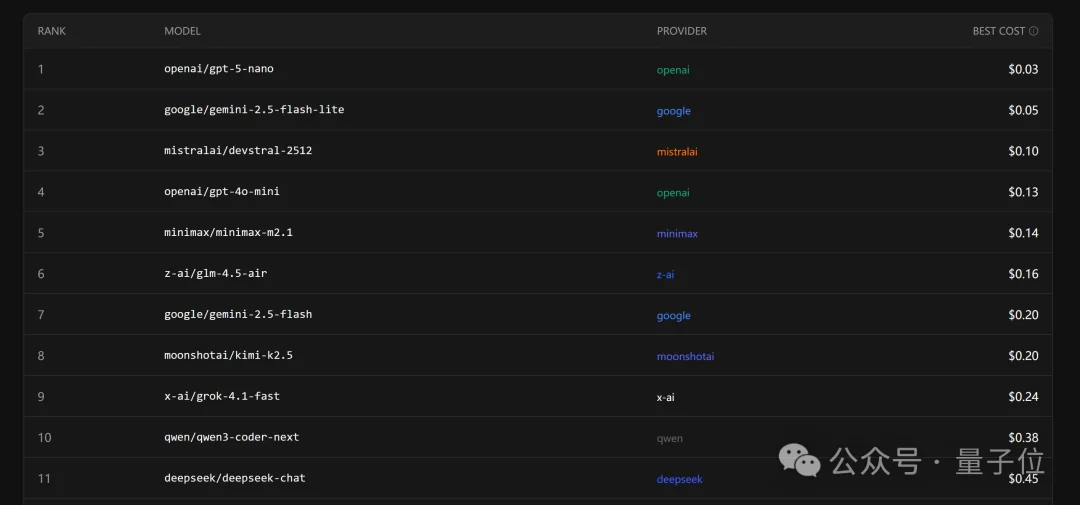

截至本文发稿前,榜单具体情况如下——

整体而言,中国模型在成功率和速度方面都有不俗表现,价格方面则稍逊。

比成功率,除了第一名谷歌Gemini 3 Flash,第二、第三名都出自国内。

而且注意没,MiniMax用的还不是它家最新模型MiniMax M2.5。

(注:MiniMax M2.5于春节期间上线,官方主打“让无限运行复杂Agent在经济上可行”。)

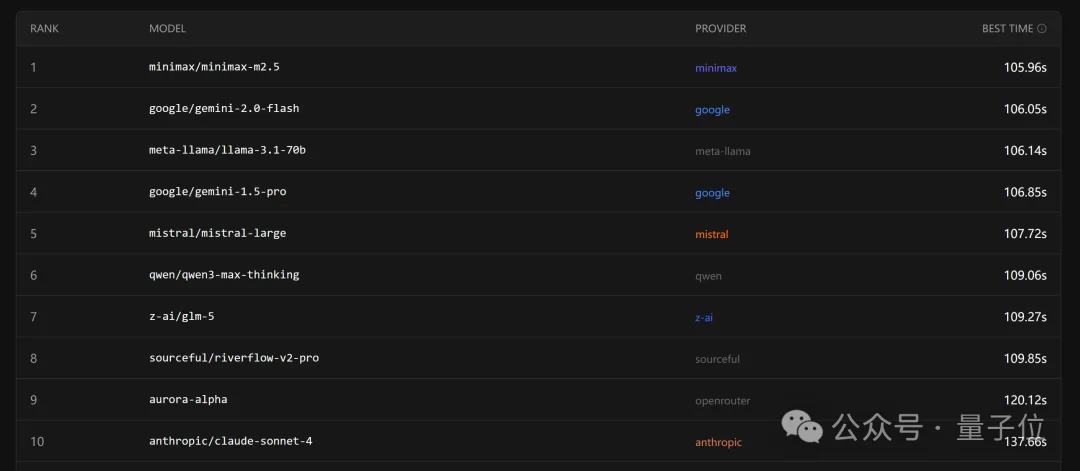

比速度,国产模型MiniMax M2.5更是一举超越Gemini、Llama等模型,登上榜首。

当时发布时,MiniMax M2.5就在SWE-Bench Verified测试中,完成任务的速度较上一代M2.1提升了37%,端到端运行时间缩短至22.8分钟,与Claude Opus 4.6持平。

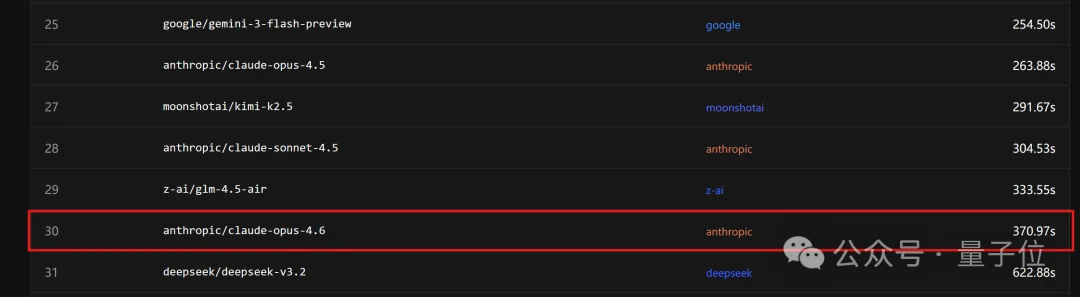

而Claude Opus 4.6的最新排名是30(M2.1是第22)。

不过在价格方面,国产模型和OpenAI、谷歌模型相比则缺乏优势。

排第一的GPT-5-nano(专为轻量级、高性价比场景设计),输入价格低至0.05美元/百万tokens,输出价格低至0.40美元/百万tokens。

而国产模型中最便宜的MiniMax M2.1,输入价格为2.1元/百万tokens(约0.3美元/百万tokens),输出价格为8.4元/百万tokens(约1.2美元/百万tokens)。

平均下来,后者的价格几乎是前者的3倍。

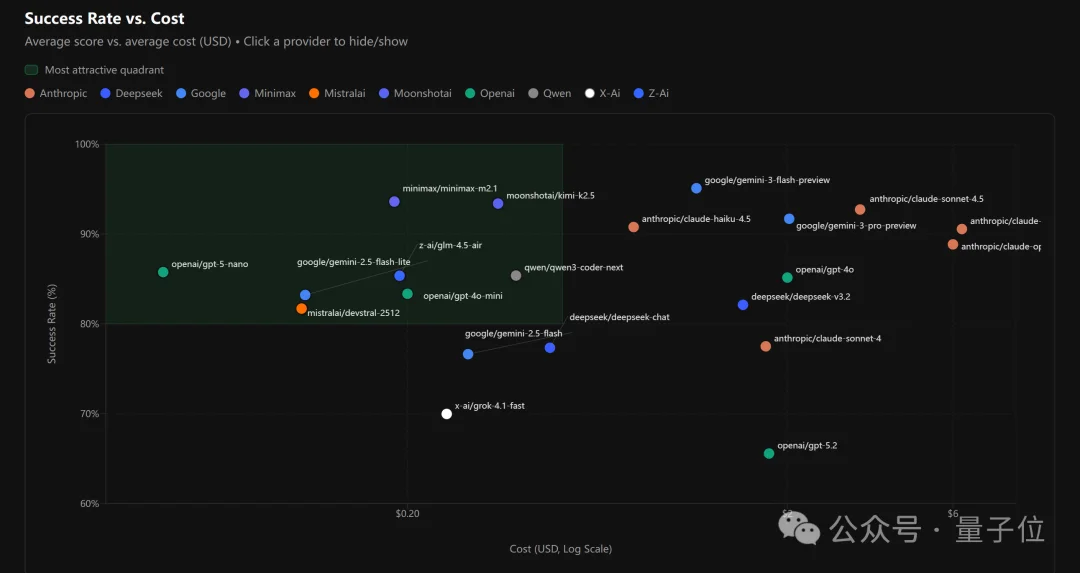

综合来看,如果要在成功率和价格之间取得最佳平衡,下面这张图可以作为参考。

左上角的方框已经圈选出了还不错的模型——一共8个,其中有4个还都是中国模型。

Anyway,在这份专为龙虾而生的Benchmark中,国产模型的含量确实很高,而且在某些单项上表现出色。

那么问题来了,这榜单靠谱吗?背后的筛选机制又是什么?

来看PinchBench的介绍。

简单来说,PinchBench并不是某家大厂推出的标准Benchmark,而是来自一支做Agent基础设施的创业团队。

团队名为Kilo AI,由GitLab前联合创始人兼CEO Sid Sijbrandij投资并参与创立,曾推出爆火“氛围编程”工具Kilo Code。

年初龙虾爆火后,他们又顺势推出了基于OpenClaw构建的全托管智能体平台KiloClaw。

而随着KiloClaw一起发布的,就有PinchBench这个智能体框架评测工具。

PinchBench主要被用来测试不同大模型在真实工作流中的执行能力,和传统大模型Benchmark(比如知识问答、数学推理)不同,其定位更接近“Agent能力测试”——

不只看模型会不会回答问题,而是看模型能不能完成一整件事。

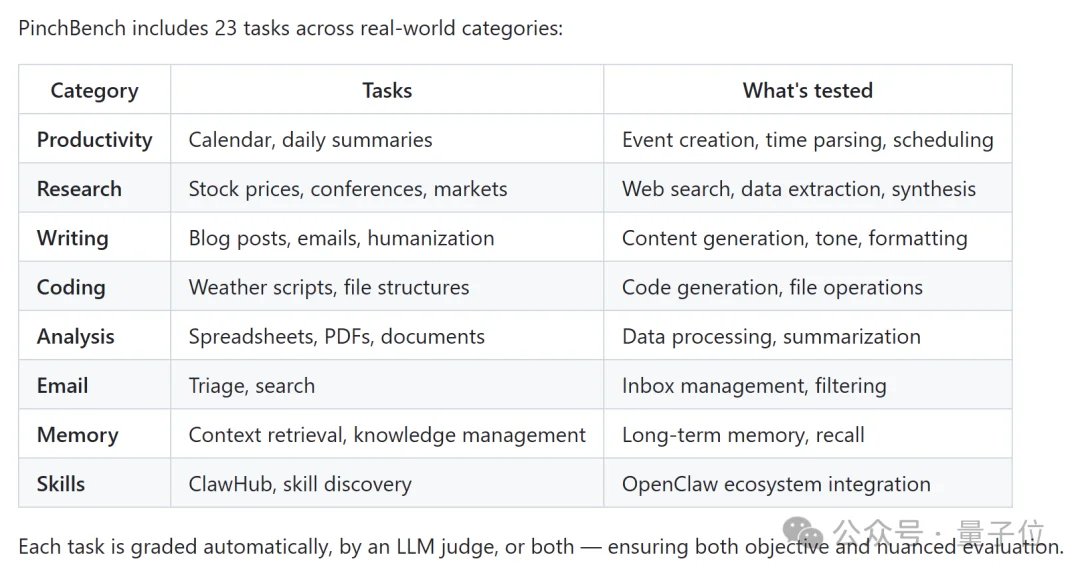

目前它大约包含23个真实任务的测试,包括但不限于:

在评分机制上,PinchBench采用的是自动化检查+LLM评审的组合方式:

一部分任务有明确的自动检查脚本,例如是否生成正确文件、是否完成指定操作等;另一部分任务则会由LLM Judge来判断结果质量。

最终统计的核心指标就是我们上面提到的Success Rate(任务完成率)、Speed(完成速度)、Cost(推理成本)。

由于评测方式偏向真实任务流程,值得注意的是,在PinchBench的排行榜上,你会看到一个有意思的现象——

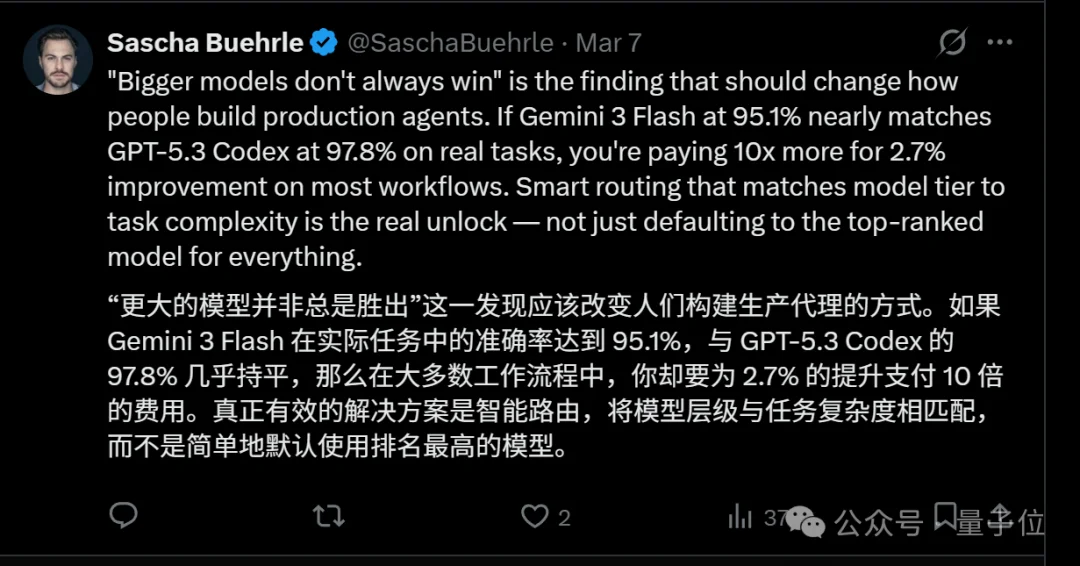

更大的模型并非总是制胜之道。

换言之,那些偏Agent优化或推理效率更高的模型,排名反而比传统主流大模型更靠前。

这一点也是PinchBench最近在圈子里被频繁讨论的原因之一。

BTW,PinchBench目前还是完全开源的,用户也可以在平台上自行运行或添加新任务。

如果以后不知道怎么选模型,不妨自己动手一试。

PinchBench开源地址:

https://github.com/pinchbench/skill

参考链接:

[1]https://x.com/steipete/status/2030312187915309311

[2]https://pinchbench.com/about?utm_source=chatgpt.com

文章来自于“量子位”,作者 “一水”。

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md