联想版“龙虾”来了:预装海量Skill、跨端无缝接力。

联想也下场“养虾”了。

一句话装好Java环境,下载文件自动分类整理,早上在车里交代一句分析任务,到公司打开电脑结果已经放在桌面上——这些原本需要自己一步步处理的事情,现在开始有了另一种完成方式。

在最新一轮升级中,“天禧Claw”作为核心功能之一重磅亮相,同时引入“端-边-云”一体架构,并由AI原生OS进一步接管人机交互流程。

目前,“联想版龙虾”天禧Claw已正式开启内测。

和不少仍需要部署环境、依赖本地运行的Agent产品不同,天禧Claw在使用方式上更偏向“开箱即用”:无需安装和配置,打开就能用。同时,端云混合的架构也带来一个更直接的变化:任务可以全天候跨端运行,设备关闭之后,流程仍然在后台推进。

对终端厂商来说,这类产品的重点,在于如何把设备、数据和任务执行连接起来,让AI真正参与到日常使用中。智东西第一时间拿到了内测资格,这次从具体场景切入,看看天禧Claw在真实工作中的表现如何。

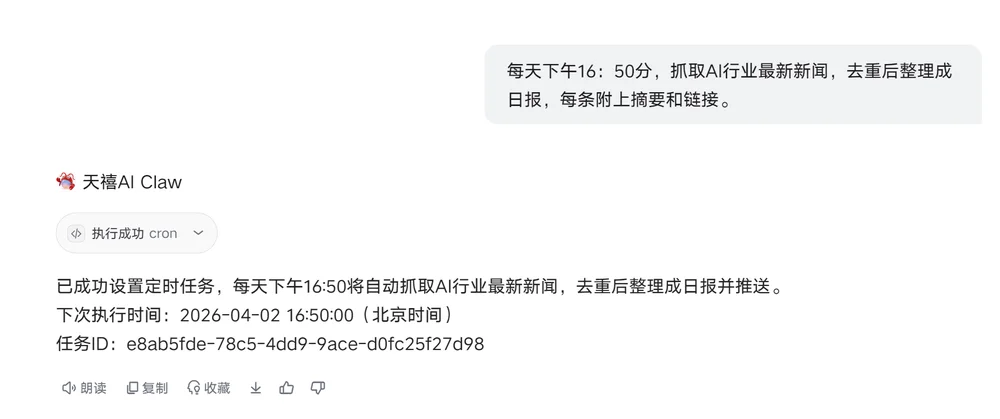

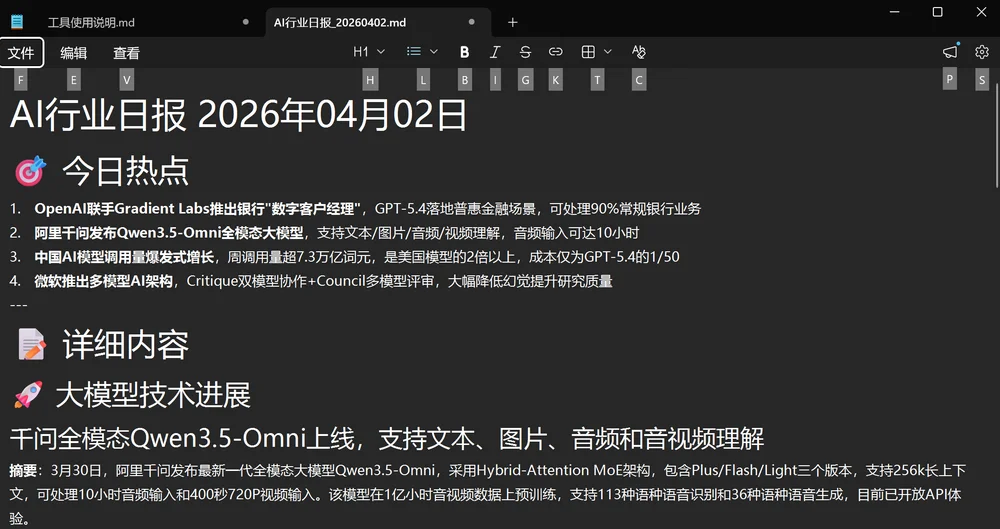

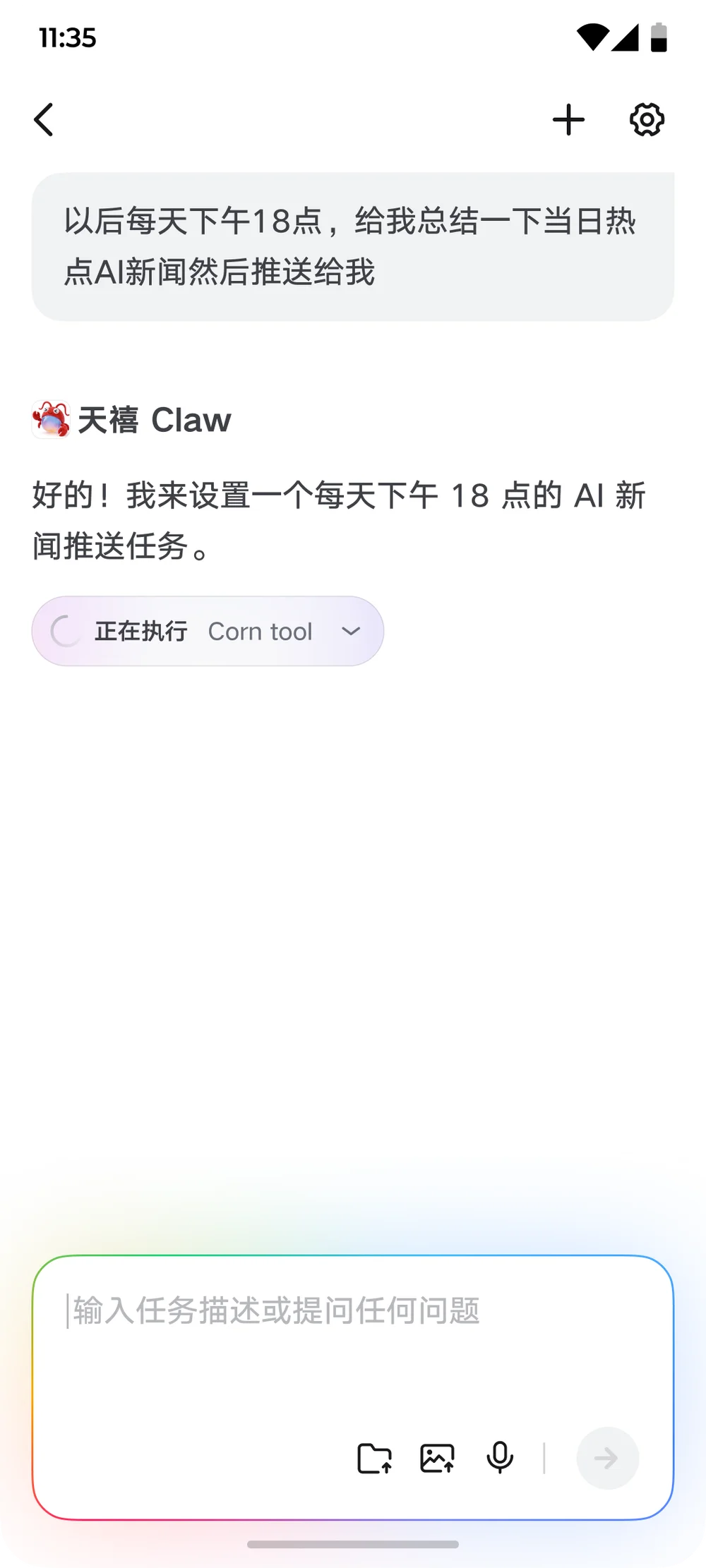

这次体验,天禧Claw帮我接管了一件每天都在重复做的事情:每天自动生成一份AI行业新闻日报,并整理成可以直接发布的内容。我先给天禧Claw设了一个定时任务,让它在每天下午16:50自动抓取AI行业最新新闻,完成去重之后,整理成一份结构化的日更信息流。

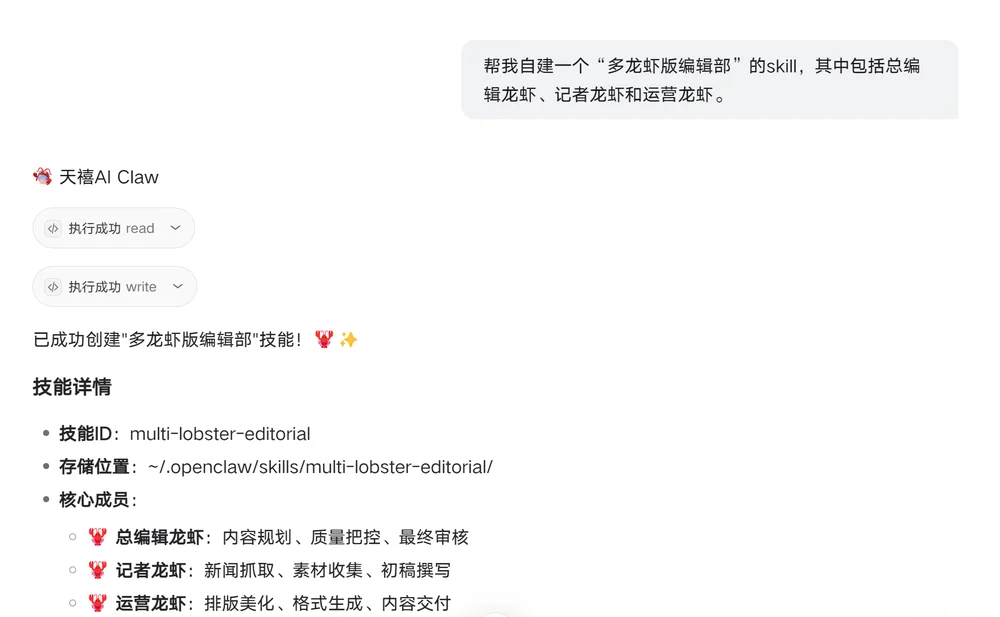

天禧Claw本身内置了多种可直接调用的能力,同时也支持自建Skill。这次,天禧Claw帮助我搭了一套“多龙虾版编辑部”的Skill。

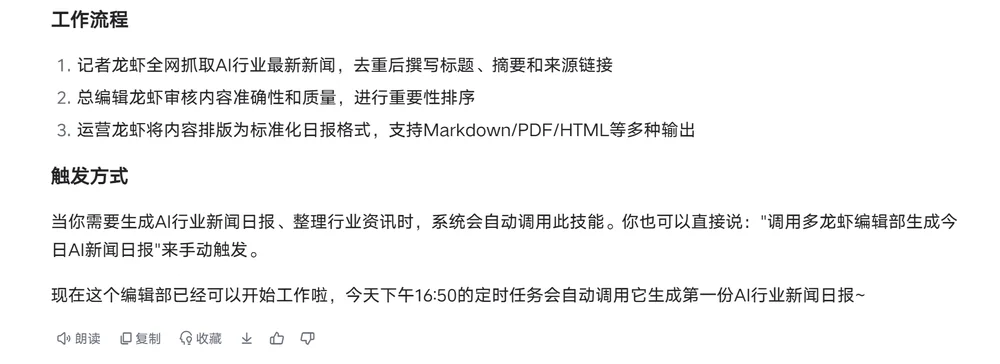

这套skill,把整个流程拆成三个明确分工的Agent来跑:记者龙虾负责抓取新闻、整理摘要和补充来源;总编龙虾负责审核内容、判断重要性并完成排序;运营龙虾则负责统一排版结构,生成最终可发布的日报格式。

这一步完成之后,原本需要多轮对话才能完成的流程,被压缩成一个可以反复调用的模块。

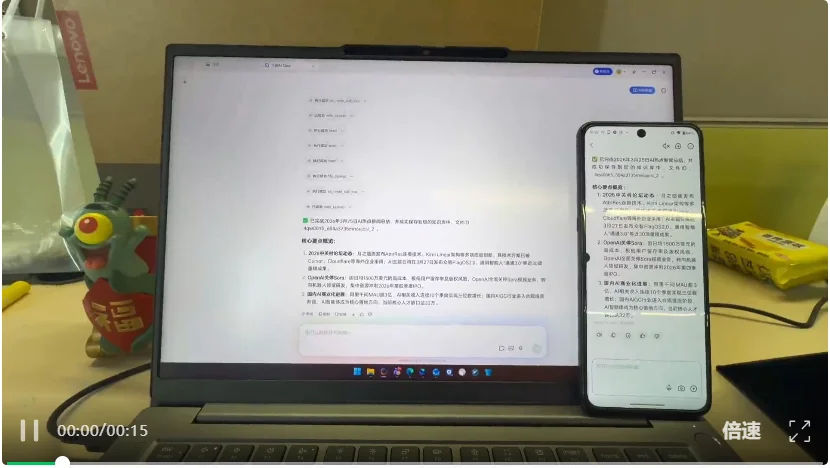

到了设定时间,这套流程会自动执行。从结果来看,它完成的是一条比较完整的信息处理链路。抓取到的内容基本覆盖当天主流AI动态,包括模型发布、行业合作以及技术架构更新等信息,每条新闻都附带摘要和来源链接。

内容会按照重要性进行排序,形成“今日热点+详细内容”的结构,最后直接输出为Markdown,可以直接下载使用。

更值得注意的是,在整理完成之后,“总编龙虾”还会补上一段总结。这部分会把当天的变化抽象成几条趋势,比如多模态能力逐渐成为基础能力、成本优势开始影响市场格局,以及多模型协同成为新的技术方向。这种处理方式已经接近资深编辑的判断。

这一轮体验下来,一个比较明显的变化在于,内容生产更像是在维护一条可以持续运行的生产流程。前期把结构和分工搭好之后,后续的更新基本可以按节奏自动推进,不需要再逐条整理信息或手动调整结构。

需要说明的是,这类能力并不会越过设备本身的权限边界。涉及本地文件的操作,仍在用户可控范围内完成,而任务执行主要在云端环境中进行,两者之间保持相对清晰的分界。

天禧Claw一大核心的价值,是7×24在线。人可以离开设备,任务还在继续,这种体验和“守着AI对话框等回复”已经不是一回事。

文件整理、环境安装、资料汇总、定时执行,这些事情原本都需要人盯着进度。放到云主机场景里,一句话交代清楚,后续流程可以继续在后台推进。

这种能力更像是给用户配了一个不下班的搭档。白天接任务,晚上继续跑流程,等用户再回来时,结果已经被整理好,或者已经推进到下一步。

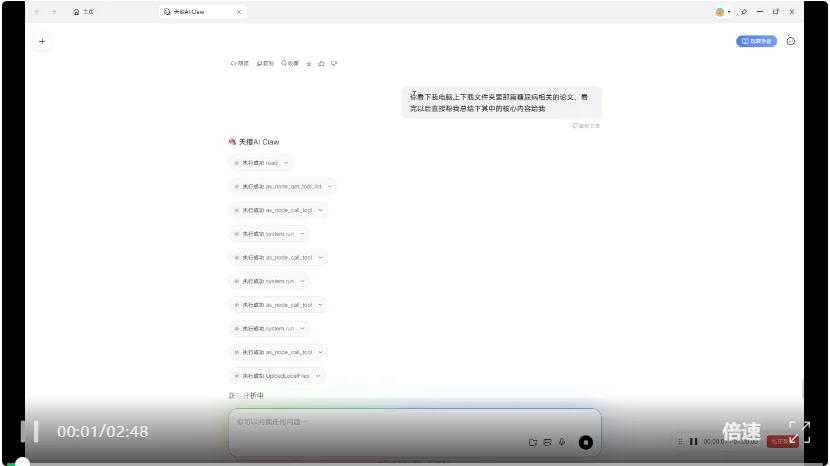

▲任务:你看下我电脑上下载文件夹里那篇糖尿病相关的论文,看完以后直接帮我总结下其中的核心内容给我

另外一个更容易被忽视的点是,这类持续执行的能力是建立在相对独立的云端环境里的,任务运行、数据处理都在隔离环境中完成,减少了对本地设备的干扰,也让用户在把任务交出去时,多了一层安全与可控。

云主机形态改变了人与AI的协作节奏。用户不用反复盯进度,AI也不用每次从头开始,这种状态更接近现实生活中的真实助理。

Agent好不好用,往往要看它能调动多少能力。今天很多AI产品的问题,在于能调用的能力太少。一旦Skills丰富起来,AI处理任务的颗粒度就会明显变细,很多原来只能靠手工完成的流程,才有机会真正自动化。

天禧Claw本身已经预装了一批能力,同时还支持安装三方Skills。

在这次实测的内容生产场景中,我们把重点放在更高频的内容生产流程上。以“AI行业日报”为例,从信息抓取、摘要整理,到结构编排和最终输出,这一整条流程被打包成一个可复用的Skill。原本需要多次下指令才能完成的步骤,被压缩成一次调用,后续每天可以自动运行。

自建Skill的意义也在这里。很多人的工作流程都有自己的习惯和顺序,通用工具只能覆盖一部分,自建Skill才能把自己的方式方法积累下来,慢慢成为一套更称手的能力库。

从更长的维度看,Claw类产品的差异,很大程度上会体现在谁的Skill生态更丰富、谁更方便接入三方能力、谁更容易把用户自己的工作流沉淀成可复用模块。

Skill生态越丰富,Claw的可用边界就越宽。模型负责理解,Skill负责执行,后者往往直接影响日常体验。

多端协同,可以快速解决碎片化的日常任务。

天禧Claw支持PC、Phone、Pad多端使用,并且采用同账号同步的方式完成体验接续,这种连续性是终端产品的一大优势。

▲PC端

▲Phone端

▲Pad端

在更具体的使用中,这种协同是有层级的。一类是设备内的直接操作,例如在手机上控制系统功能、查询本地信息。

▲手机端系统级能力闹钟管理“明天早上7:30设个闹钟”,自动创建

而另一类是跨设备的任务流转,例如在手机上发起一个任务,电脑端继续调用资料、生成内容,最后结果再沉淀进知识库。

▲查询电脑桌面文件

▲总结今日AI相关新闻并写入知识库

终端厂商做Claw的优势也在这里:它可以直接打通设备系统、文件、应用和知识资产,很多原本需要在多个工具之间切换的操作,可以在一条链路里完成,协作更顺。

从这个角度看,Claw并不是孤立功能,是联想整套终端AI能力中的一个执行层抓手——把分散在不同设备和应用里的能力,重新串成一条可以连续运转的工作流。

这一轮Claw产品密集出现之后,大家都在尝试用它来处理自己手里的工作。

天禧 Claw给出的方向,价值就在这里。把云主机、Skills、多端协同、后台任务这些能力组合在一起,让AI直接参与到日常事务的处理过程中。

对终端厂商来说,这种尝试也很有代表性,不只是模型能力,还包括:能否把设备、数据和执行能力真正串起来。

比如在手机上发起一个任务,电脑端继续执行,结果直接落到本地文件或知识库中;再比如从信息抓取、摘要整理,到标题生成和结构排版这样的流程沉淀为可复用的Skill,减少重复操作。

它考验了产品能否真正把设备能力,转化为用户可感知的效率提升。

再往后看,Claw类产品的竞争,多半还会继续升级。

能力是否稳定,Skill生态是否丰富,用户是否愿意把任务长期交付出去,都会成为更关键的分水岭。谁能把这些环节打磨到位,谁就更有机会把这类产品变成大家惯用的日常工具。

文章来自于"智东西",作者 "江宇"。

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】FASTGPT是基于LLM的知识库开源项目,提供开箱即用的数据处理、模型调用等能力。整体功能和“Dify”“RAGFlow”项目类似。很多接入微信,飞书的AI项目都基于该项目二次开发。

项目地址:https://github.com/labring/FastGPT