刚刚,智谱一口气开源6款模型,200 tokens/秒解锁商用速度之最 | 免费

刚刚,智谱一口气开源6款模型,200 tokens/秒解锁商用速度之最 | 免费就在刚刚,智谱一口气上线并开源了三大类最新的GLM模型:沉思模型GLM-Z1-Rumination 推理模型GLM-Z1-Air 基座模型GLM-4-Air-0414

搜索

搜索

就在刚刚,智谱一口气上线并开源了三大类最新的GLM模型:沉思模型GLM-Z1-Rumination 推理模型GLM-Z1-Air 基座模型GLM-4-Air-0414

AIMO2最终结果出炉了!英伟达团队NemoSkills拔得头筹,凭借14B小模型破解了34道奥数题,完胜DeepSeek R1。

OpenAI前CTO Mira Murati初创公司,正在筹集新融资。20亿美元(折合人民币146亿),还是种子轮!消息称一旦融资完成,Thinking Machines Lab估值将达到超100亿美元。

OpenAI o1/o3-mini级别的代码推理模型竟被抢先开源!UC伯克利和Together AI联合推出的DeepCoder-14B-Preview,仅14B参数就能媲美o3-mini,开源代码、数据集一应俱全,免费使用。

好消息,由谷歌最新的 Gemini 2.5 Pro 模型提供支持的 Deep Research(深度研究)正式发布!坏消息,目前仅 Gemini Advanced 付费会员可体验。

让大语言模型更懂特定领域知识,有新招了!

剥离非核心资产,押注AI芯片与代工业务……上任14天后,陈立武首次以英特尔CEO的身份于英特尔 Vision 2025活动上公开露面,发表了约30分钟的公开演讲,向外界传递出重振这家老牌芯片巨头的决心。

什么?! 用AI Agent搞的小红书账号,竟然14天狂吸5000粉,还开始赚钱了???

今天字节暴了一个八卦,豆包LLM技术负责人乔某婚内出轨HRBP程某某,还不给原配自己亲女儿抚养费。据说乔某已经结婚11年了,2014年进入字节,有两个女儿,而程之前还和乔下属谈过恋爱,也知道他有妻子,知三当三啊,有人还说乔还公款带着程一起去美国出差。

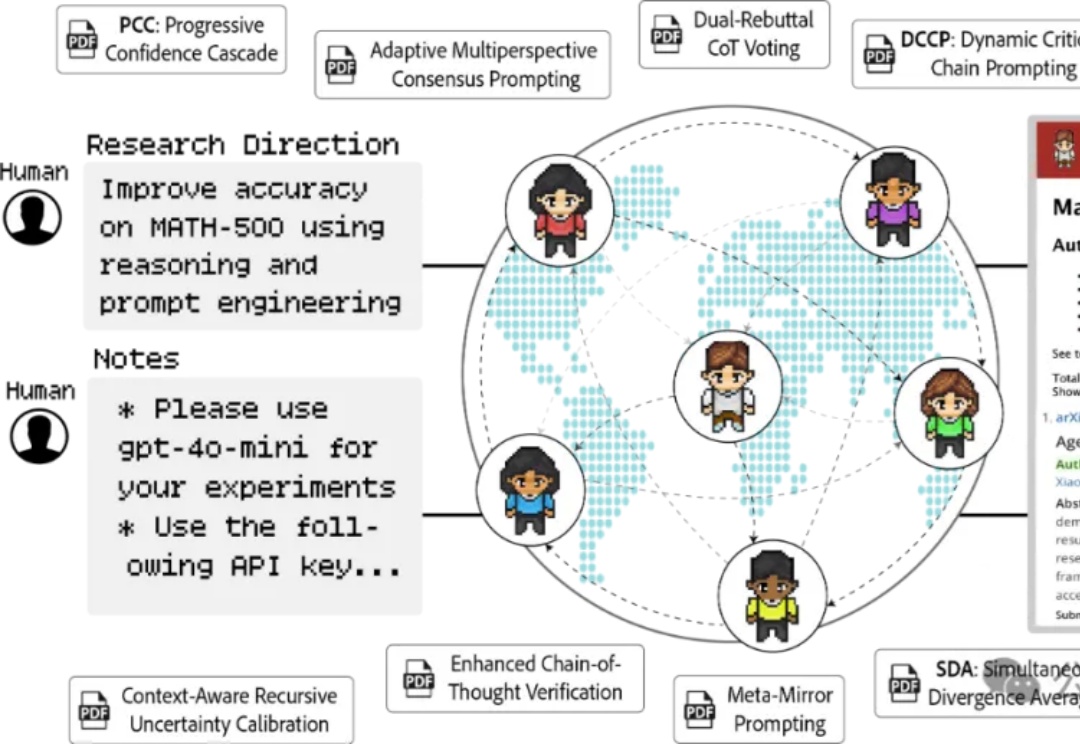

这项来自约翰霍普金斯与ETH Zurich的自主科研智能体框架AgentRxiv的确可以显著提高研究效率。我在测试了多次之后用Deepseek-V3-0324实现了它。