为什么记忆成为下一代 AI 的「核心变量」 | GAIR Live 20

为什么记忆成为下一代 AI 的「核心变量」 | GAIR Live 20人工智能在过去的十年中,以惊人的速度革新了信息处理和内容生成的方式。然而,无论是大语言模型(LLM)本体,还是基于检索增强生成(RAG)的系统,在实际应用中都暴露出了一个深层的局限性:缺乏跨越时间的、可演化的、个性化的“记忆”。它们擅长瞬时推理,却难以实现持续积累经验、反思历史、乃至真正像人一样成长的目标。

搜索

搜索

人工智能在过去的十年中,以惊人的速度革新了信息处理和内容生成的方式。然而,无论是大语言模型(LLM)本体,还是基于检索增强生成(RAG)的系统,在实际应用中都暴露出了一个深层的局限性:缺乏跨越时间的、可演化的、个性化的“记忆”。它们擅长瞬时推理,却难以实现持续积累经验、反思历史、乃至真正像人一样成长的目标。

如果说过去一年里,AI 让开发者生产力翻倍,那么如今它也开始以同样的速度放大风险。 上周,Google 刚刚推出的基于 Gemini 的全新 AI 编码工具 Antigravity,上线不到 24 小时便被一名安全研究员攻破,指出它存在严重的安全Bug。

整个 2025年,至少两款以二次元为目标用户群、产品形态类似数字手办的 AI 桌面陪伴硬件在海外取得了不错的众筹成绩:「CODE27 Character Livehouse」于 4月在 Kickstarter 开启众筹,最终获得 3500 人支持,众筹金额超过 180 万美元;

2025 年以来,各种 AI Coding 的宣发,已经从科技进步,快进到了科幻文学赛道。C 端市场,一句话生成 Demo 的宣发内容仍在收割流量,将技术演进包装成科幻叙事;但没人关心小白为什么要做 coding,一句话生成的的 demo,在生产环境能跑起来吗?

沉寂许久的DeepSeek又回来了!今天,DeepSeekMath-V2重磅登场,一举夺下IMO 2025金牌,实力媲美甚至超越了谷歌的IMO金牌模型,开源AI再次扳回一局。

如果不是这波大模型的爆发,没人会想到「输入法」这个早已被视为「基础设施」的赛道,会在 2025 年下半年突然变得性感起来。

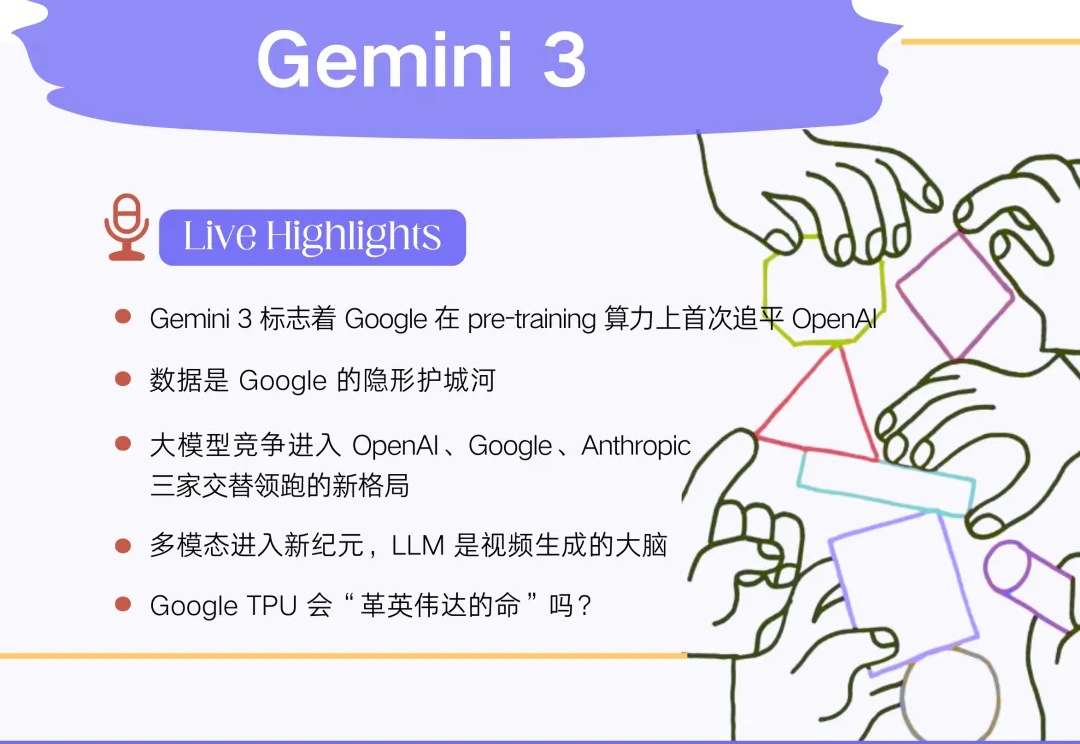

最近两周的模型竞赛非常热闹:OpenAI 在 11 月 12 日发布 GPT-5.1,引入更强的推理深度与更高效的对话体验;Google 在 11 月 18 日发布 Gemini 3,全面强化多模态理解与复杂推理能力;Anthropic 在 11 月 24 日又发布了 Claude Opus 4.5,模型在专业文档处理、代码生成与长流程 agent 方面有显著提升。

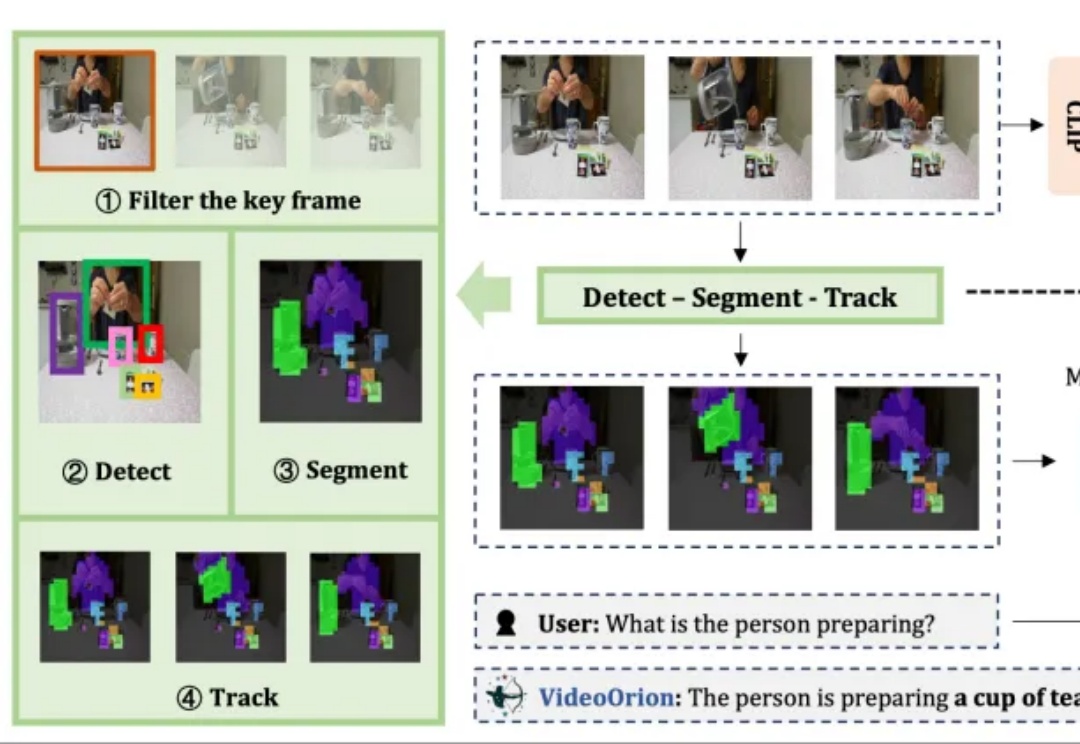

被顶会ICCV 2025以554高分接收的视频理解框架来了!

就在刚刚,DeepSeek 又悄咪咪在 Hugging Face 上传了一个新模型:DeepSeek-Math-V2。顾名思义,这是一个数学方面的模型。它的上一个版本 ——DeepSeek-Math-7b 还是一年多以前发的。当时,这个模型只用 7B 参数量,就达到了 GPT-4 和 Gemini-Ultra 性能相当的水平。相关论文还首次引入了 GRPO,显著提升了数学推理能力。

近期,一支来自美国哈佛大学和美国斯坦福大学等联合团队真的做到了——他们集成 40 余种衰老时钟模型开发了一个名为 ClockBase Agent 的平台,让 AI 在 200 万份人类和小鼠的分子组学数据里“挖宝”,并找出了超过 500 种可能让生物年龄倒退的干预措施。