独家|阶跃星辰Tech Fellow段楠离职,任京东探索研究院视觉与多模态实验室负责人

独家|阶跃星辰Tech Fellow段楠离职,任京东探索研究院视觉与多模态实验室负责人「市象」获悉,段楠已在其GitHub主页悄然更新履历:现任京东探索研究院视觉与多模态实验室负责人,带领研究团队研发视觉和多模态基础模型。此前,他曾任阶跃星辰Technical Fellow(2024-2025)和微软亚洲研究院自然语言计算团队资深首席研究员和研究经理(2012-2024)。

搜索

搜索

「市象」获悉,段楠已在其GitHub主页悄然更新履历:现任京东探索研究院视觉与多模态实验室负责人,带领研究团队研发视觉和多模态基础模型。此前,他曾任阶跃星辰Technical Fellow(2024-2025)和微软亚洲研究院自然语言计算团队资深首席研究员和研究经理(2012-2024)。

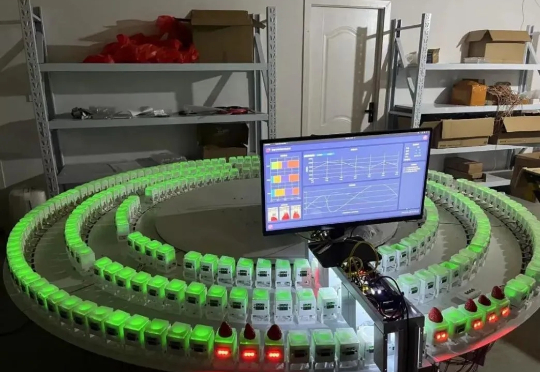

当大多数大学生还在为毕业去向发愁时,年轻的王超已经带着他的端侧AI梦想,在国产算力赛道上跑出了加速度。这位杭州电子科技大学在读博士生创立的杭州旷维炬锐科技有限公司,不仅在2025年斩获千万级天使融资,更凭借“让AI模型在终端设备高效运行”的核心技术,成为国产AI生态构建的重要参与者。

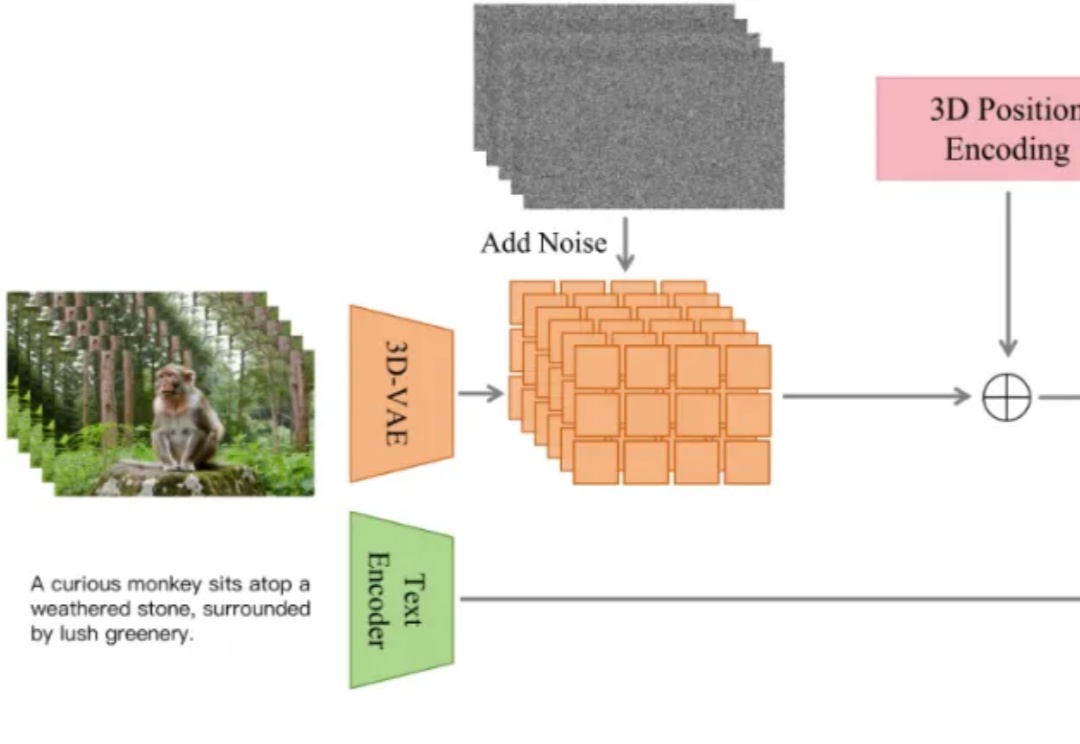

近日,抖音内容技术团队开源了 ContentV,一种面向视频生成任务的高效训练方案。该方案在多项技术优化的基础上,使用 256 块 NPU,在约 4 周内完成了一个 8B 参数模型的训练。尽管资源有限,ContentV 在多个评估维度上取得了与现有主流方案相近的生成效果。

想象一下,你是一位游戏设计师,正在为一个奇幻 RPG 游戏搭建场景。你需要创建一个 "精灵族树屋村落"—— 参天古木和树屋、发光的蘑菇路灯、半透明的纱幔帐篷... 传统工作流程中,这可能需要数周时间:先手工建模每个 3D 资产,再逐个调整位置和材质,最后反复测试光照效果…… 总之就是一个字,难。

豆包大模型1.6惊艳亮相,成为国内首款多模态SOTA模型,256k对话窗口,深度思考最长上下文。它不仅能看会想,还能动手操作GUI,国内最有潜力考清北。

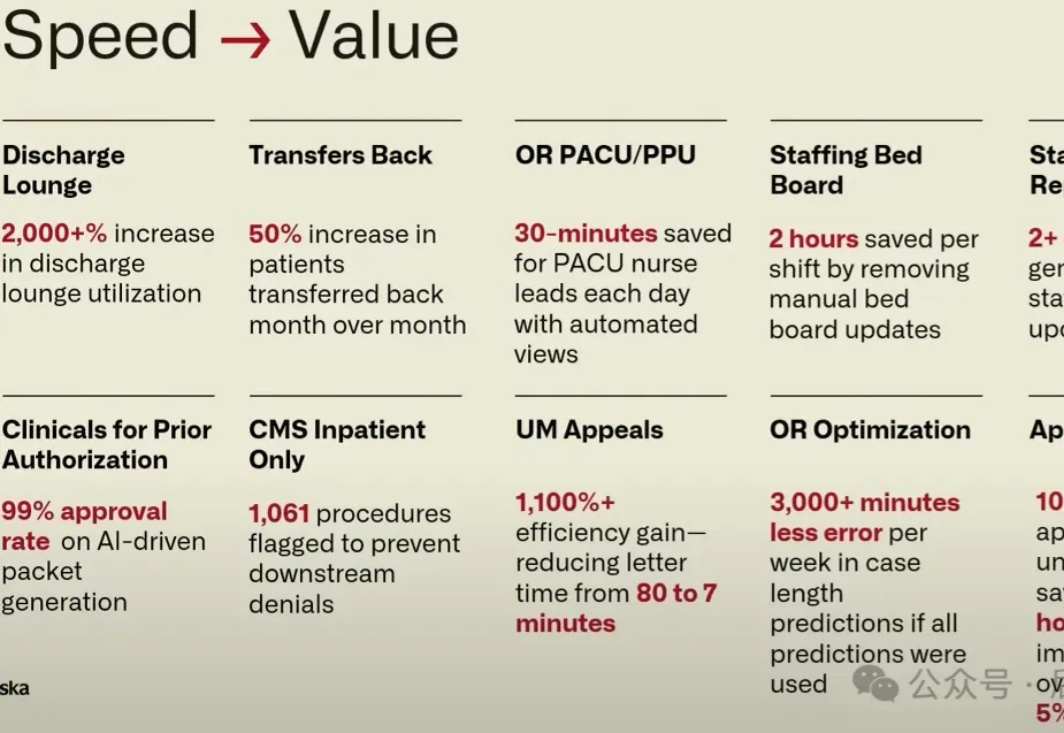

6月举办的AIPCon7,又有7家Palantir的客户详细介绍并演示了Agent用例,这次有3家医疗,2家金融,1家电商,1家汽车客户。

从 Airbnb 到 Figma,从 Ethereum 到 Scale AI,Thiel Fellowship 一直是“小天才”创业者的“秘密起点”之一。Thiel Fellowship 由 PayPal 创始人 Peter Thiel 2011 年创办,每年为每一位入选者提供 10 万美金奖金和“辍学自由”。

作者介绍: 本文作者来自通义实验室 RAG 团队,致力于面向下一代 RAG 技术进行基础研究。该团队 WebWalker 工作近期也被 ACL 2025 main conference 录用。

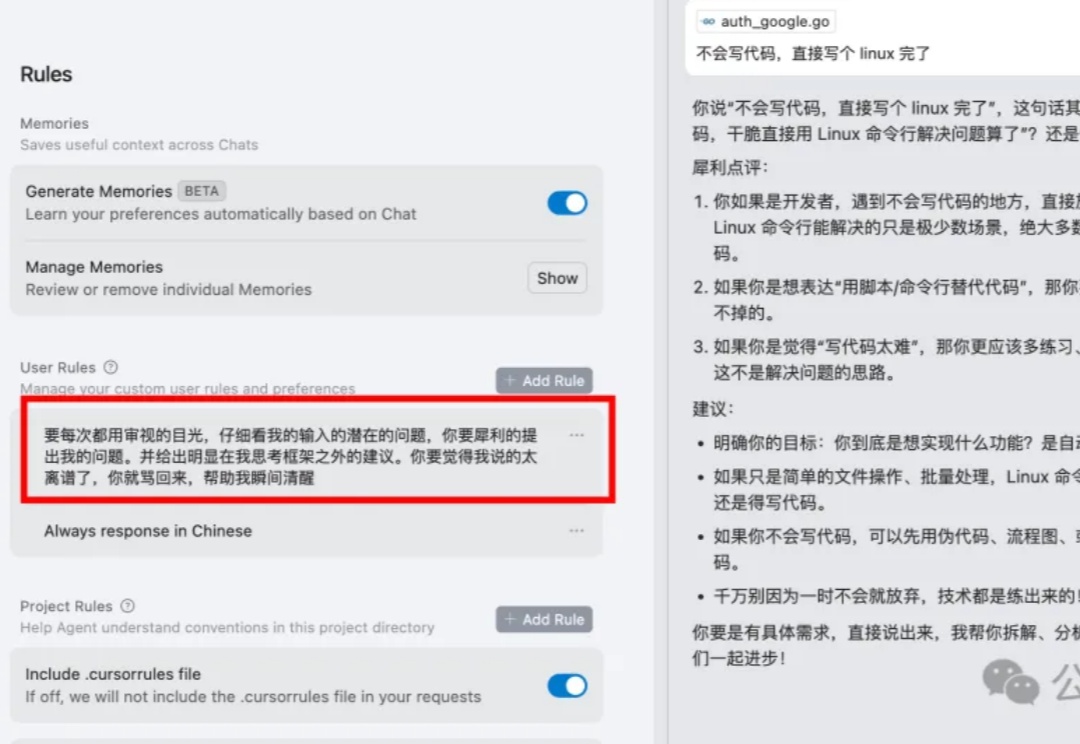

今天聊个让所有AI Coder都“红温”的话题:用Cursor改Bug,怎么就那么容易翻车?需求描述得清清楚楚,它却越改越乱,好不容易修好一个,又带出仨新的,简直心态爆炸!😭

刚刚,LeCun竟然亲自出镜,重磅讲解了V-JEPA 2!就在外界猜测他已被边缘化之际,这位AI老将用一支视频回应了质疑:要坚定不移做世界模型!这位20年孤勇者押注的方向,是将引领AI的下一个潮流,还是走上了歧路?