大厂围猎AI人才,有实习生日薪2000元

大厂围猎AI人才,有实习生日薪2000元4月27日,字节跳动正式启动2026届Top Seed大模型顶尖人才校招计划,开放招募30位顶尖应届博士。大约一个月前,字节跳动开始推进一项名为“节节高”的招聘计划吸引年轻人,计划对毕业不到3年的人才进行大面积扩招,如果内推的社招候选人工作年限≤3年,将有额外奖金。

搜索

搜索

4月27日,字节跳动正式启动2026届Top Seed大模型顶尖人才校招计划,开放招募30位顶尖应届博士。大约一个月前,字节跳动开始推进一项名为“节节高”的招聘计划吸引年轻人,计划对毕业不到3年的人才进行大面积扩招,如果内推的社招候选人工作年限≤3年,将有额外奖金。

一场帮助孩子“戒掉”AI软件的行动,正在一群年轻妈妈中展开。原因是她们还在上幼儿园的孩子们,整日沉迷于和AI软件打电话。32岁的福州妈妈林悠发现,她四岁的儿子墨墨,无论做什么事情都要拿着手机和AI软件聊天。比如墨墨会一边搭积木,一边和AI软件聊天;一边画画,一边和AI软件聊天。

在当前大语言模型(LLMs)广泛应用于问答、对话等任务的背景下,如何更有效地结合外部知识、提升模型对复杂问题的理解与解答能力,成为 RAG(Retrieval-Augmented Generation)方向的核心挑战。

阿里Qwen3凌晨开源,正式登顶全球开源大模型王座!它的性能全面超越DeepSeek-R1和OpenAI o1,采用MoE架构,总参数235B,横扫各大基准。这次开源的Qwen3家族,8款混合推理模型全部开源,免费商用。

今天,一张图在网上爆火:中国AI专利数量占全球70%,成TOP 1!不过,曾撰写「AI 2027」预测报告的研究员却发长篇博文表示,AI竞赛美国稳操胜券,原因就在算力上。

一位华人博士用ChatGPT治好了困扰一年多的头晕,而另一位网友靠AI缓解了十年腰痛。求医不如问ChatGPT?20美元的订阅费完胜昂贵理疗课!AI让医疗变得触手可及,省时又省钱。

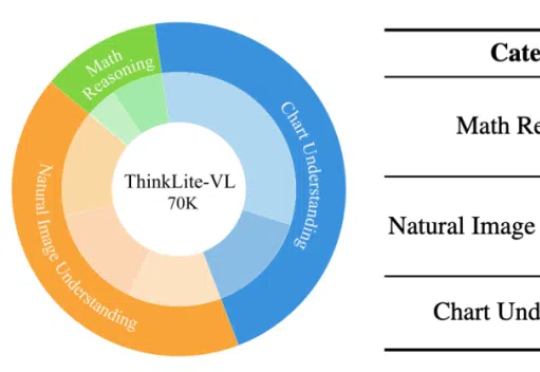

多模态大模型几何解题哪家强?

通过蒙特卡洛树搜索筛选高难度样本,ThinkLite-VL仅用少量数据就能显著提升视觉语言模型的推理能力,无需知识蒸馏,为高效训练提供了新思路。

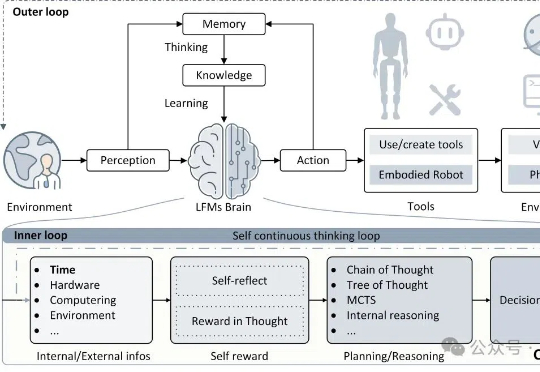

最近在看 Agent 方向的论文和产品,已经被各种进展看花了眼。但我发现,真正能超越 demo,能在 B 端场景扎实落地的却寥寥无几。

自主通才科学家(AGS)正成为现实!