喧嚣背后,国产GPU距离“平替”英伟达还有多远?

喧嚣背后,国产GPU距离“平替”英伟达还有多远?2024年上海的7月是一个沉闷的雨季,但对国产AI 行业来说,却迎来了堪比摇滚乐集会的WAIC(世界人工智能大会)。

2024年上海的7月是一个沉闷的雨季,但对国产AI 行业来说,却迎来了堪比摇滚乐集会的WAIC(世界人工智能大会)。

如今,Jeff Dean 已经成为谷歌 AI 掌门人,谷歌也从最开始一个狭小的办公空间搬到了加州总部「Bay View」园区。

Mini-Monkey 是一个轻量级的多模态大型语言模型,通过采用多尺度自适应切分策略(MSAC)和尺度压缩机制(SCM),有效缓解了传统图像切分策略带来的锯齿效应,提升了模型在高分辨率图像处理和文档理解任务的性能。它在多项基准测试中取得了领先的成绩,证明了其在多模态理解和文档智能领域的潜力。

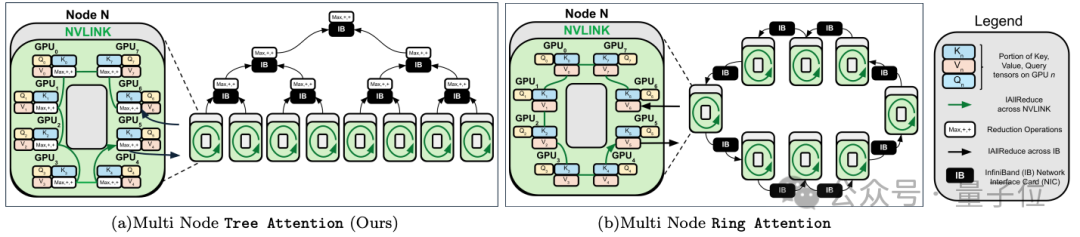

跨GPU的注意力并行,最高提速8倍,支持512万序列长度推理。

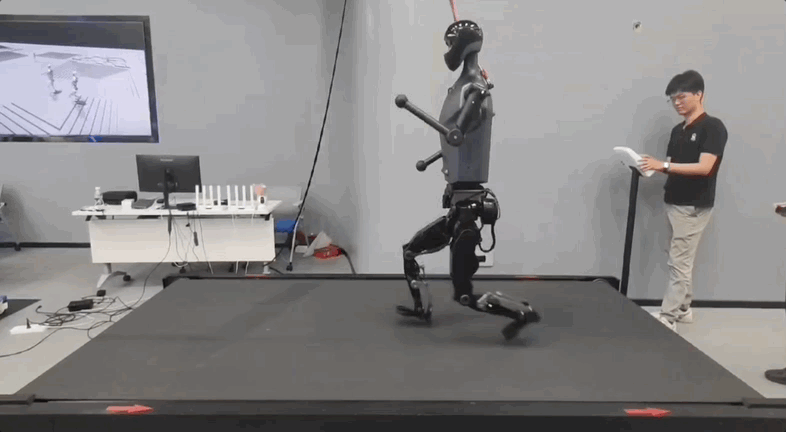

别光只看Figure 02了,国产机器人最新成果曝光,大秀肌肉!

最近,数智前线通过中国政府采购网、中国招投标公共服务平台、天眼查、企查查、寻标宝等渠道的梳理和不完全统计,仅2024年前7个月,围绕土建基础设施和IT基础架构等方方面面的建设内容,智算中心相关项目中标公告已发布超140个。 一些新的趋势和特征,也正逐渐明晰。

每个人都是孤独星球,AI能24小时陪伴

Figure的机器人大脑此前也使用了ViLa模型,这是「千寻智能」联合创始人高阳所提出。

2024 年过半,投资机构也迎来惯例的半年度复盘会与策略会。

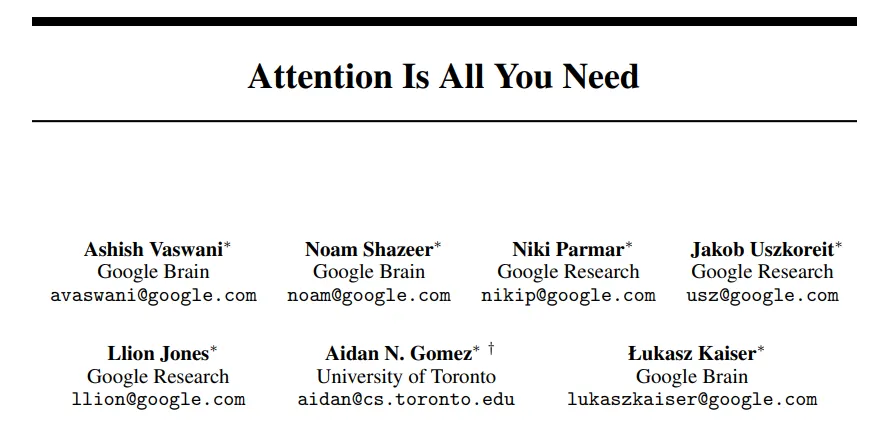

2017 年,谷歌在论文《Attention is all you need》中提出了 Transformer,成为了深度学习领域的重大突破。该论文的引用数已经将近 13 万,后来的 GPT 家族所有模型也都是基于 Transformer 架构,可见其影响之广。 作为一种神经网络架构,Transformer 在从文本到视觉的多样任务中广受欢迎,尤其是在当前火热的 AI 聊天机器人领域。