GPU 经济学:算力背后的成本与未来

GPU 经济学:算力背后的成本与未来算力供需平衡预计到2030年才能实现

搜索

搜索

算力供需平衡预计到2030年才能实现

阿里的通义千问(Qwen),终于拼齐了1.5系列的最后一块拼图—— 正式开源Qwen 1.5-32B。

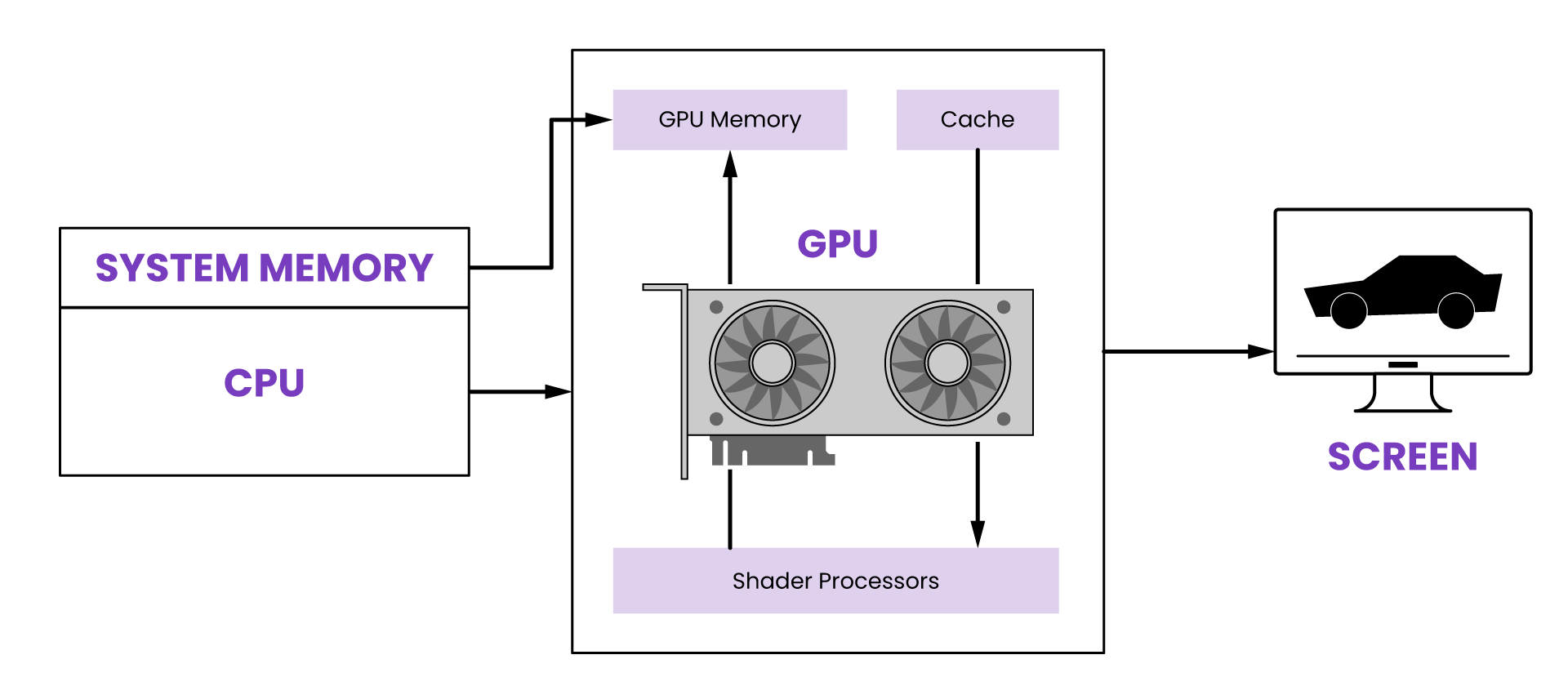

OpenAI的秘密武器、ChatGPT背后功臣RLHF,被开源了。来自Hugging Face、加拿大蒙特利尔Mila研究所、网易伏羲AI Lab的研究人员从零开始复现了OpenAI的RLHF pipeline,罗列了25个关键实施细节。

2024刚开年的时候,AI硬件的讨论在CES上热得无以复加,PC是热议中最被期待的那一个。在拉斯维加斯,全球PC销量第一的联想掌门人杨元庆,被问到AI浪潮里,对联想意味着什么?意味着什么?在4月开启的新财年全员誓师大会开场,杨元庆用了20分钟,面向全球7.7万员工,全面给出了回答——

2026年的数据荒越来越近,硅谷大厂们已经为AI训练数据抢疯了!它们纷纷豪掷十数亿美元,希望把犄角旮旯里的照片、视频、聊天记录都给挖出来。不过,如果有一天AI忽然吐出了我们的自拍照或者隐私聊天,该怎么办?

在大模型落地应用的过程中,端侧 AI 是非常重要的一个方向。近日,斯坦福大学研究人员推出的 Octopus v2 火了,受到了开发者社区的极大关注,模型一夜下载量超 2k。20 亿参数的 Octopus v2 可以在智能手机、汽车、个人电脑等端侧运行,在准确性和延迟方面超越了 GPT-4,并将上下文长度减少了 95%。此外,Octopus v2 比 Llama7B + RAG 方案快 36 倍。

2024 年英伟达 GTC 大会上,创始人兼 CEO 黄仁勋以人形机器人压轴,并表示构建通用人形机器人的基本模型是今天能在 AI 领域解决的最令人兴奋的问题之一

超过200名音乐人呼吁AI时代的音乐版权保护。

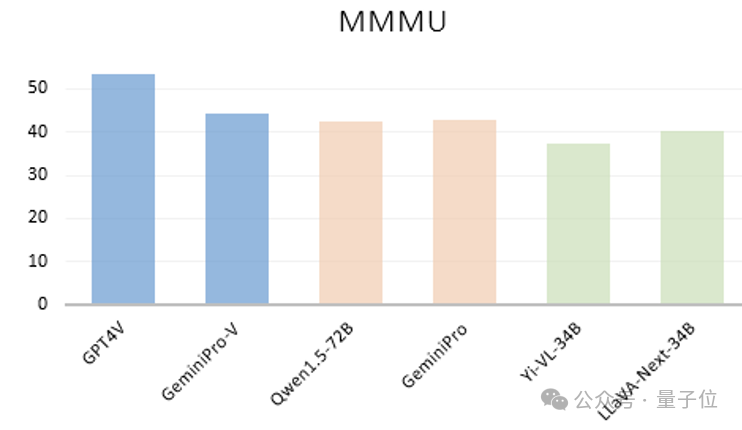

大模型不看图,竟也能正确回答视觉问题?!中科大、香港中文大学、上海AI Lab的研究团队团队意外发现了这一离奇现象。他们首先看到像GPT-4V、GeminiPro、Qwen1.5-72B、Yi-VL-34B以及LLaVA-Next-34B等大模型,不管是闭源还是开源,语言模型还是多模态,竟然只根据在多模态基准MMMU测试中的问题和选项文本,就能获得不错的成绩。

关注 OpenAI核心创始成员Andrej Karpathy 深度分享AI大模型发展及Elon管理法则。近日,OpenAI核心创始成员Andrej Karpathy(已于24年2月离职)在红杉资本进行了一场精彩的分享。