LLM生成延迟降低50%!DeepSpeed团队发布FastGen:动态SplitFuse技术,提升2.3倍有效吞吐量

LLM生成延迟降低50%!DeepSpeed团队发布FastGen:动态SplitFuse技术,提升2.3倍有效吞吐量DeepSpeed-FastGen结合MII和DeepSpeed-Inference实现LLM高吞吐量文本生成。

搜索

搜索

DeepSpeed-FastGen结合MII和DeepSpeed-Inference实现LLM高吞吐量文本生成。

通义千问开源全家桶正式上线!业界最强72B模型直接超越开源标杆Llama 2-70B,还有1.8B模型、音频大模型全部开源,阿里云这次真的把家底都掏出来了。

让大模型洗钱、制造炸弹、合成冰毒?GPT-4、 Claude 2纷纷沦陷了。让大模型成功越狱,还是有机可乘。

目前,通义千问开源全家桶已经有了 18 亿、70 亿、140 亿、720 亿参数量的 4 款基础开源模型,以及跨语言、图像、语音等多种模态的多款开源模型。

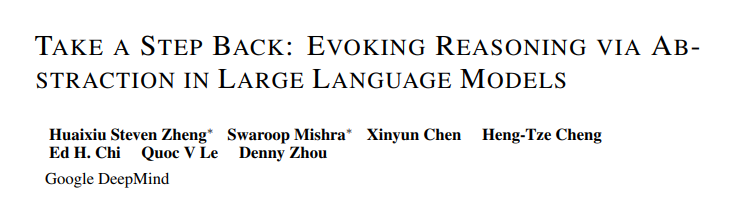

谷歌DeepMind全新提示技术「Step-Back Prompting」,让LLM性能拉满!

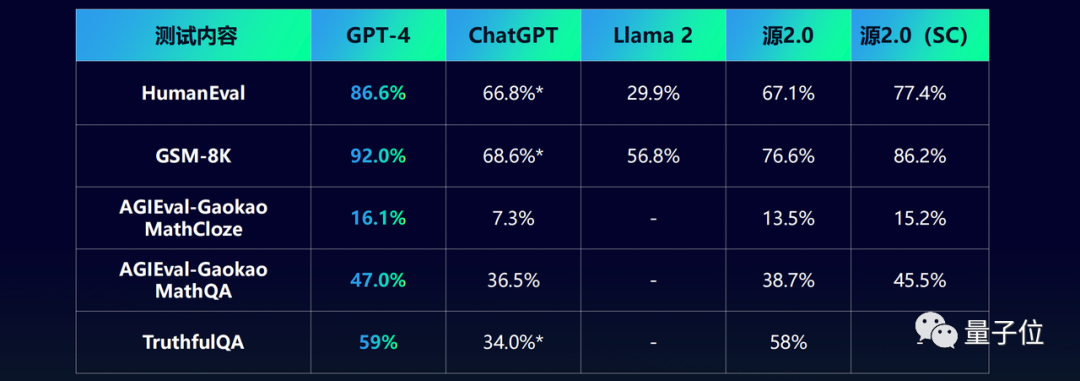

开源大模型这个圈子,真是卷到不行——国内最新纪录来了,直奔千亿量级,达到1026亿。千亿参数、全面开源、无需授权可商用,GitHub均可全面下载使用,就问你激动不激动!

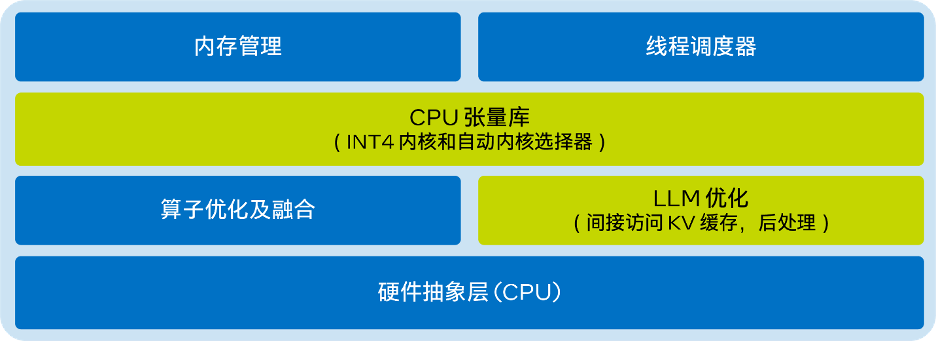

只需不到9行代码,就能在CPU上实现出色的LLM推理性能。英特尔® Extension for Transformer创新工具包中的LLM Runtime为诸多模型显著降低时延,且首个token和下一个token的推理速度分别提升多达40倍和2.68倍,还能满足更多场景应用需求。

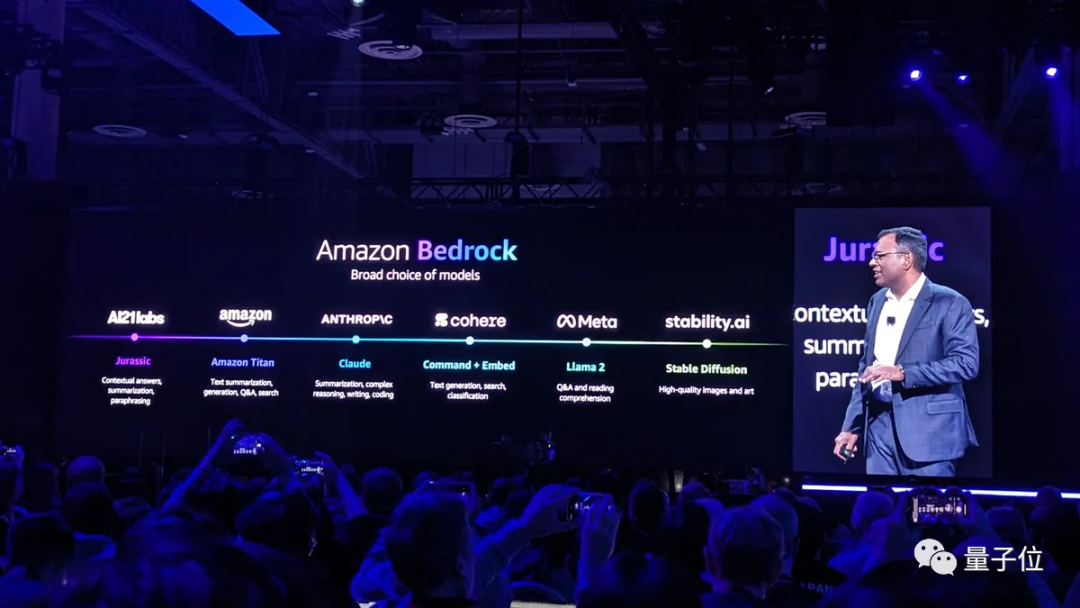

好消息,搞生成式AI应用的门槛,被狠狠地打下去了!就在刚刚,亚马逊云科技在年度盛会re:Invent中正式宣布:

GPTs太火了。OpenAI的首届开发者大会之后,短短半个月时间,已经出现2万个GPTs,平均每天冒出来1300个。这个热度,跟ChatGPT刚发布时有得一拼。

开局即巅峰的WPS后在雷军等骨干的共同努力下,磨砺20年以金山办公之名终于成功在A股上市,算是IT界少有的国产之光。但近年来有关WPS窃取用户隐私的声音却不绝于耳,不仅有冲上热搜的“WPS被曝会删除用户本地文件”话题,还有近期“用户文档或将被当做WPS AI训练材料”的争议。