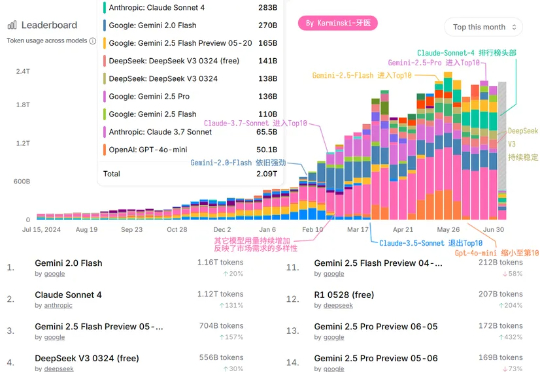

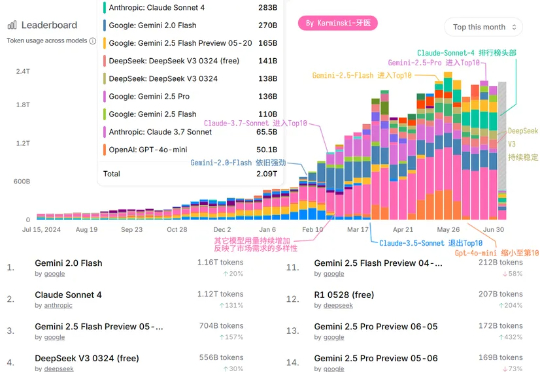

2025上半年大模型使用量观察:Gemini系列占一半市场份额,DeepSeek V3用户留存极高

2025上半年大模型使用量观察:Gemini系列占一半市场份额,DeepSeek V3用户留存极高2025 年已经过半, 文本生成大模型是否已经进入下半场了? OpenAI 完全不重视 API 市场? Grok3 根本没人用? 「大模型战」未来的走向如何?

搜索

搜索

2025 年已经过半, 文本生成大模型是否已经进入下半场了? OpenAI 完全不重视 API 市场? Grok3 根本没人用? 「大模型战」未来的走向如何?

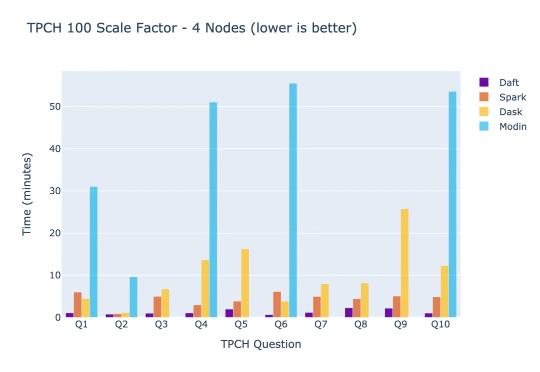

你有没有想过,为什么那些最聪明的AI工程师要把80%的时间浪费在修复数据基础设施上,而不是构建真正改变世界的AI应用?这个看似不合理的现象,正是Eventual创始人Sammy Sidhu和Jay Chia在Lyft自动驾驶部门工作时亲身经历的痛苦。

香港大学NLP团队联合字节跳动Seed、复旦大学发布名为Polaris的强化学习训练配方:通过Scaling RL,Polaris让4B模型的数学推理能力(AIME25上取得79.4,AIME24上取得81.2)超越了一众商业大模型,如Seed-1.5-thinking、Claude-4-Opus和o3-mini-high(25/01/31)。

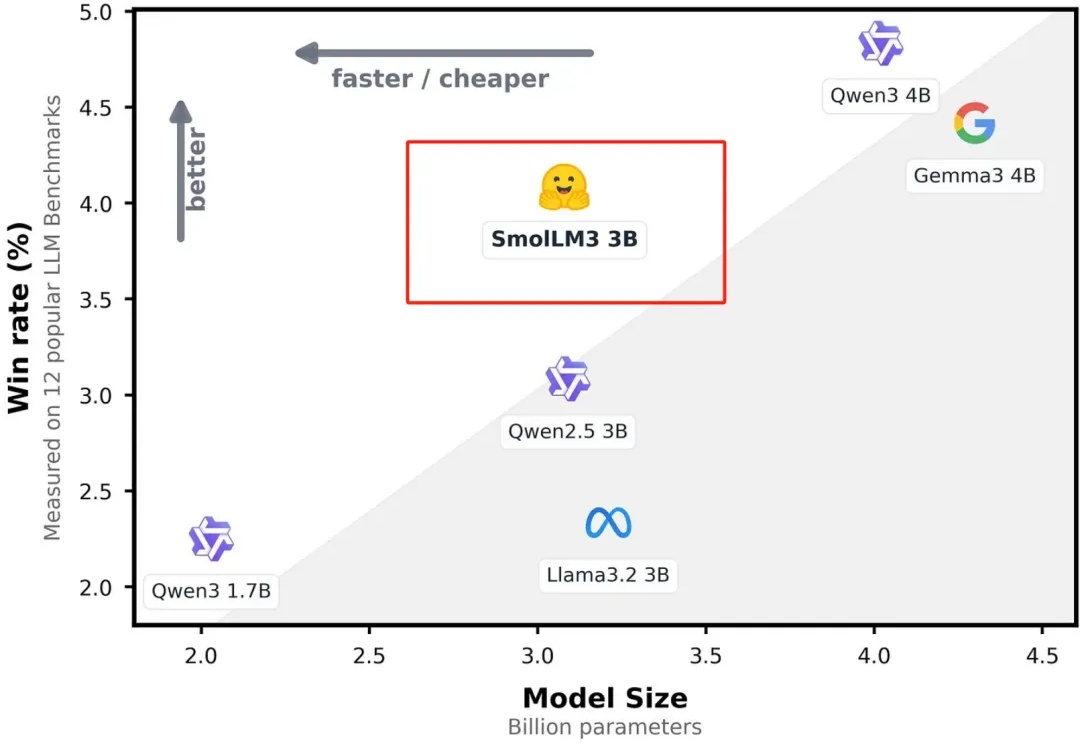

今天凌晨,全球著名大模型开放平台Hugging Face开源了,顶级小参数模型SmolLM3。

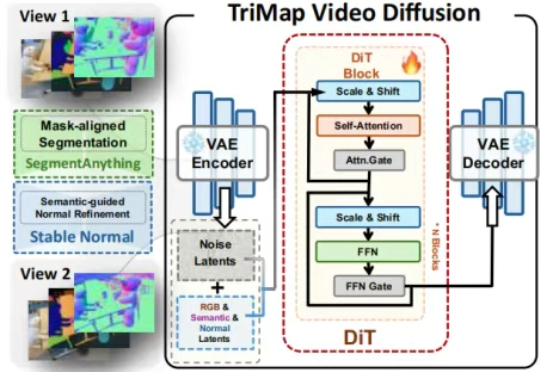

最少只用2张图,AI就能像人类一样理解3D空间了。ICCV 2025最新中稿的LangScene-X:以全新的生成式框架,仅用稀疏视图(最少只用2张图像)就能构建可泛化的3D语言嵌入场景,对比传统方法如NeRF,通常需要20个视角。

美国教师联盟与美国教师联合会、微软、OpenAI和Anthropic合作,耗资2300万美元成立“国家人工智能教学学院”;

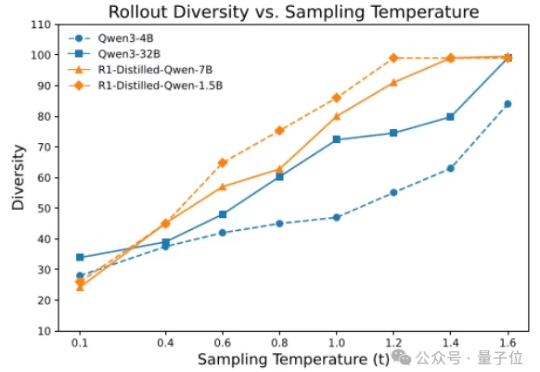

AI无需监督就能学习思考?

DeepSeek推理要详细还是要迅速,现在可以自己选了?

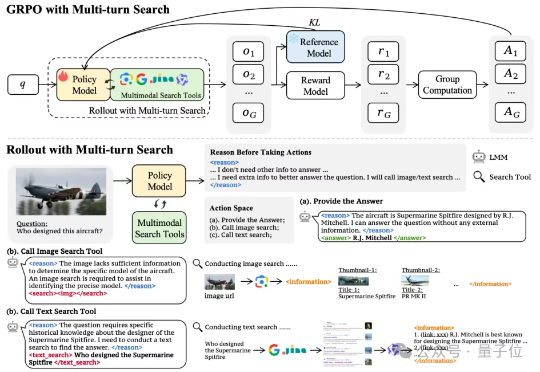

多模态模型学会“按需搜索”!字节&NTU最新研究,优化多模态模型搜索策略——通过搭建网络搜索工具、构建多模态搜索数据集以及涉及简单有效的奖励机制,首次尝试基于端到端强化学习的多模态模型自主搜索训练。

我们独家获悉,具身智能初创公司它石智航近期完成 1.22 亿美元天使 + 轮融资。本轮融资由美团战投领投,钧山投资、碧鸿投资、国汽投资、临港科创投、赛富投资基金、建发新兴投资共同跟投。老股东线性资本、 襄禾资本等也在本轮追加投资。其中,美团的投资额约在3亿—4亿元。