2 个月 10 万台,增速 300%,「AI硬件」闯出一匹黑马

2 个月 10 万台,增速 300%,「AI硬件」闯出一匹黑马一块毫无设计感的电路板,成了全网最火的「AI 硬件」。

搜索

搜索

一块毫无设计感的电路板,成了全网最火的「AI 硬件」。

随着AI能力的迭代升级,可以发现一个明显的趋势,AI已经从最初理解人类进行智能对话,逐渐演变成一种情感治愈工具。而这种工具的体现形式不仅仅限于正值火热的AI萌宠硬件、AI社交软件,还有一些小众的细分应用,比如AI解梦。

Agentic AI 的 3 要素是:tool use,memory 和 context,围绕这三个场景会出现 agent-native Infra 的机会。

2025 CSRankings新鲜出炉了!CMU稳坐全球第一,中国高校强势崛起,清华摘得第2,上交大与浙大并列第3,北大位居第5。中国在AI领域表现尤为抢眼,上交大、清华、北大、浙大包揽前四,中国科学院与哈工大也跻身全球前十。

Meta最新基础模型Llama 4发布36小时后,评论区居然是这个画风:

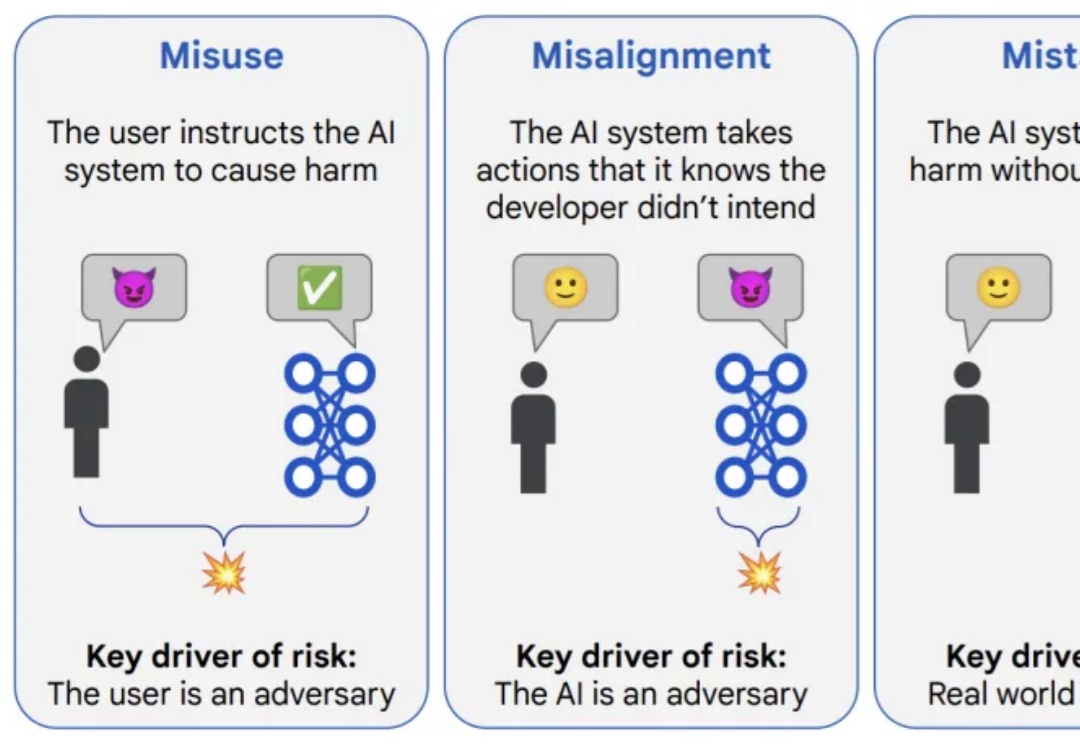

对于「AI 危害」,每家公司都有不同的解决方案,但没有完美方案。

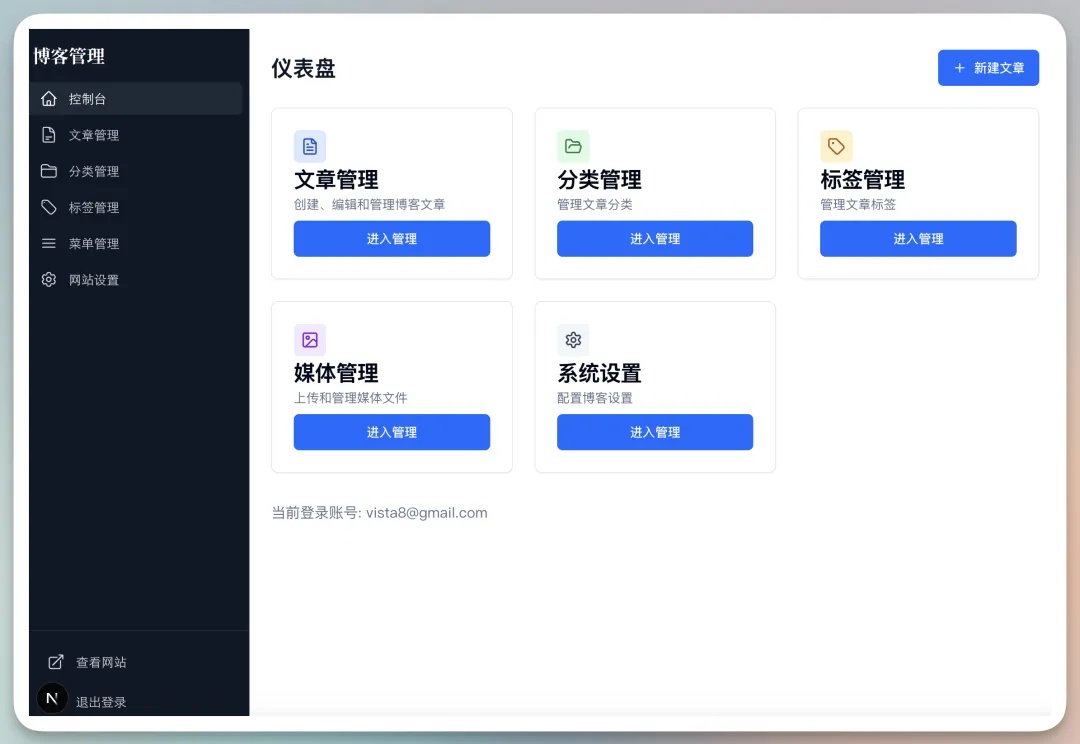

最近计划用AI编程重写自己的网站,后台功能已开发差不多。

AI 时代的 iPhone 会是什么?

芯片架构设计的首要原则是明确取舍,决定哪些领域我们不追求卓越。

“妈妈,我用AI做完PPT了!” 2025年3月,10岁男孩张然子御的一段视频引爆全网——他仅用3分钟,通过AI生成了一份专业级PPT。从输入关键词到自动生成大纲、设计模板、调整配色动画,全程无需任何操作经验。有网友惊呼:这届小学生已经开始用AI“吊打”职场人了?