AI解决132年数学难题!Transformer成功寻找新的李雅普诺夫函数,三体问题相关

AI解决132年数学难题!Transformer成功寻找新的李雅普诺夫函数,三体问题相关训练Transformer,用来解决132年的数学世纪难题!

搜索

搜索

训练Transformer,用来解决132年的数学世纪难题!

AI Agent爆火,机器人崛起 ChatGPT爆火了两年,掀起全球大模型开发热。近半年,具身智能集中融资30+笔,大模型混战继续,OpenAI以1570亿美元估值完成了66亿美元融资……

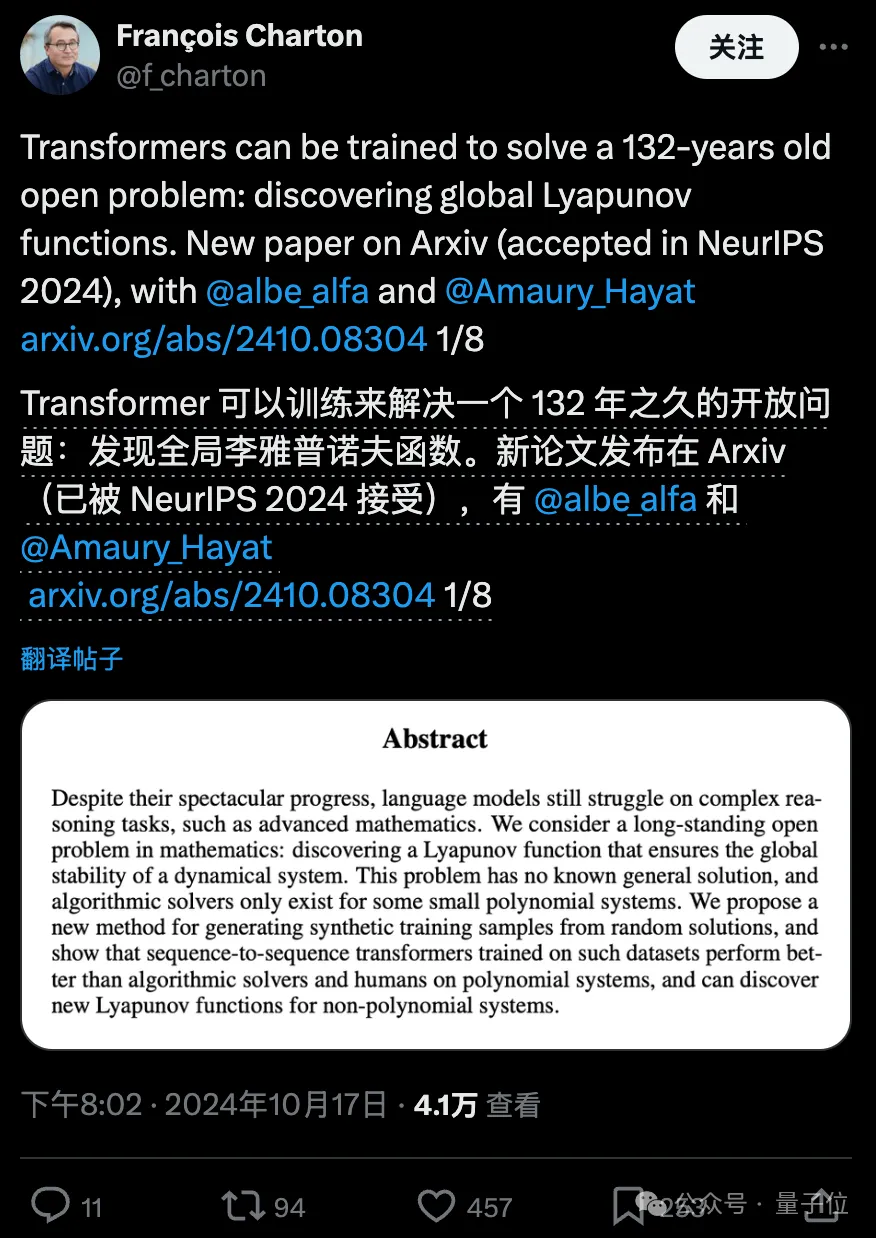

大型语言模型 (LLM) 在各种自然语言处理和推理任务中表现出卓越的能力,某些应用场景甚至超越了人类的表现。然而,这类模型在最基础的算术问题的表现上却不尽如人意。

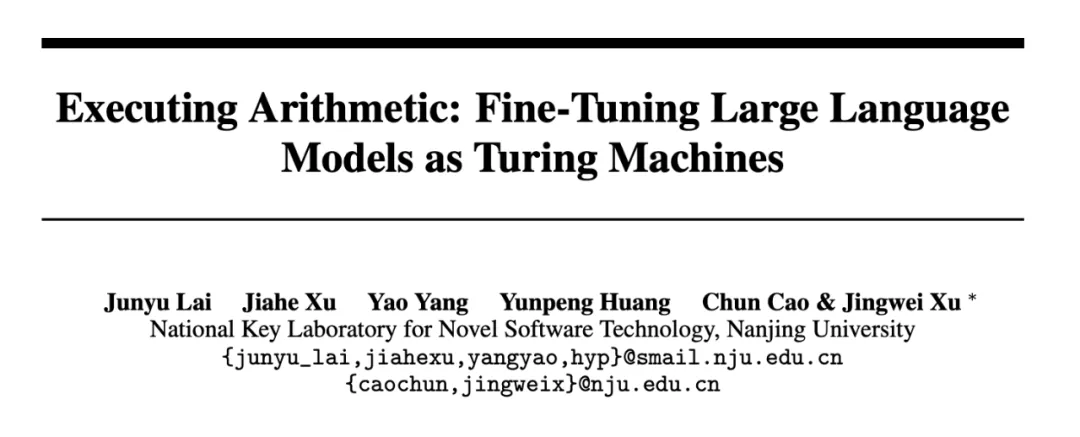

台积电3nm工艺引领AI芯片革新,营收激增。

YouTube博主让1986年Macintosh Plus上网并使用ChatGPT。

10 月 12 日,一个平平无奇的周六上午,B 站首页给笔者推送了一个名为「EVE」的 AI 社交新品的预告片

10月3日,OpenAI官方宣布成功获得66亿美元(约合人民币466.9亿元)融资。本轮融资结束后,OpenAI估值突破了1500亿美元。新一轮融资规模不小,然而却只够Open“烧”一年,其预计,今年营收可达37亿美元,亏损幅度为50亿美元。

安卓首款3nm、PC级Arm V9架构、第八代NPU——天玑9400,成为了移动AI芯片的最新最强成果! 相比上一代生成式AI芯片天玑9300,其AI能力更上一层楼,荣登苏黎世ETHZ移动SoC AI性能榜单之首。

一台4090笔记本,秒生1K质量高清图。英伟达联合MIT清华团队提出的Sana架构,得益于核心架构创新,具备了惊人的图像生成速度,而且最高能实现4k分辨率。

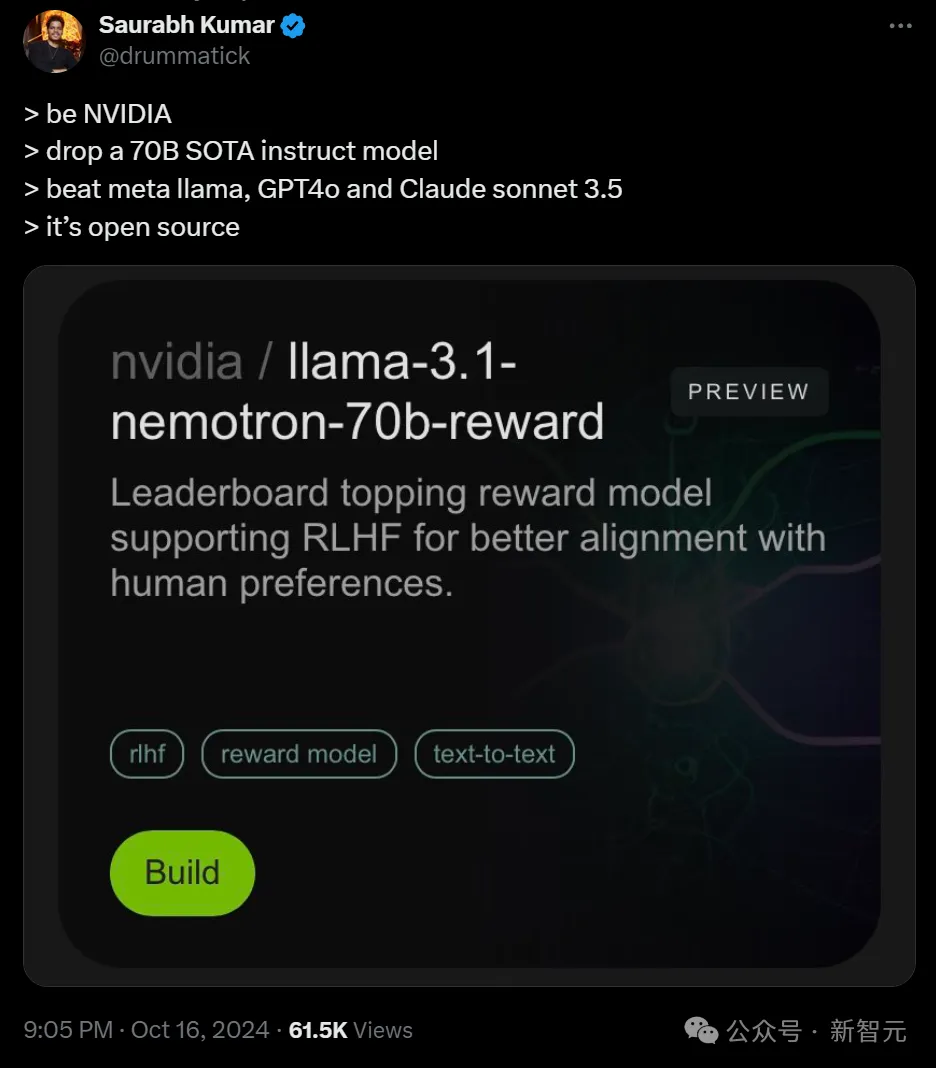

英伟达开源了超强模型Nemotron-70B,后者一经发布就超越了GPT-4o和Claude 3.5 Sonnet,仅次于OpenAI o1!AI社区惊呼:新的开源王者又来了?业内直呼:用Llama 3.1训出小模型吊打GPT-4o,简直是神来之笔!