GLM-4.6 首发实测:和 Claude 4.5 比怎么样?

GLM-4.6 首发实测:和 Claude 4.5 比怎么样?核心速递: GLM-4.6 发布,榜单排名提升,价格不变 实测效果对齐 Claude 4,超越其他国产模型 GLM 开发者包月套餐升级,1/7 价格取得 Claude 4 9/10 的效果,值得使用

搜索

搜索

核心速递: GLM-4.6 发布,榜单排名提升,价格不变 实测效果对齐 Claude 4,超越其他国产模型 GLM 开发者包月套餐升级,1/7 价格取得 Claude 4 9/10 的效果,值得使用

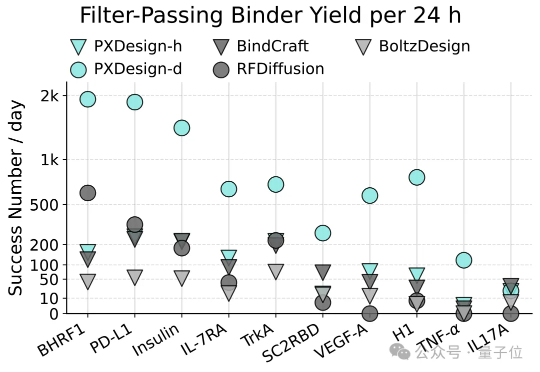

AI蛋白设计进入新阶段!最近,字节跳动Seed团队多模态生物分子结构大模型(Protenix)项目组提出了一种可扩展的蛋白设计方法,叫做PXDesign。在实际测试中,PXDesign展现出极高的效率,24小时内即可生成数百个高质量的候选蛋白,生成效率较业界主流方法提升约10倍,并在多个靶点上实现了20%–73%的湿实验成功率,达到了当前领域的领先水平。

Alex 是一家开发 AI 招聘官的初创公司,该公司表示其技术已帮助企业进行视频面试和电话初筛。约18 个月前联合创办 Alex 的王亚伦(图中下排居中)向 TechCrunch 透露,该公司的语音 AI 工具能在求职者投递简历后立即开展自主面试。"我们的 AI 招聘官每天进行数千场面试,帮助求职者进入全球顶尖企业工作,"他说道。

本周,我们邀请 3D 大模型公司 VAST 的创始人和 CEO 宋亚宸(Simon),和我们聊聊 VAST 最新 3D 生成大模型 Tripo 3.0 背后的故事。这位 97 年的创业者短期内连续融资三轮、每轮数千万美金,积攒了足够的子弹,在闷头苦干一年后,Simon 今年首次上播客,和我们探讨了几个关键的战略问题:

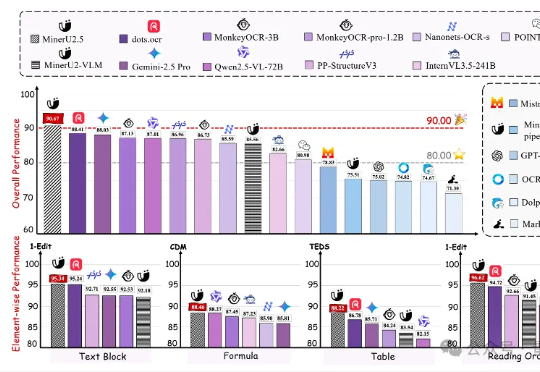

上海人工智能实验室发布新一代文档解析大模型——MinerU2.5。作为MinerU系列最新成果,该模型仅以1.2B参数规模,就在OmniDocBench、olmOCR-bench、Ocean-OCR等权威评测上,全面超越Gemini2.5-Pro、GPT-4o、Qwen2.5-VL-72B等主流通用大模型,以及dots.ocr、MonkeyOCR、PP-StructureV3等专业文档解析工具。

原文作者:David Adam 本篇《自然》长文共3702字,干货满满,预计阅读时间12分钟,时间不够建议可以先“浮窗”或者收藏哦。 研究表明,电子伙伴类应用有利有弊——但科学家们担心长期依赖性。 绘

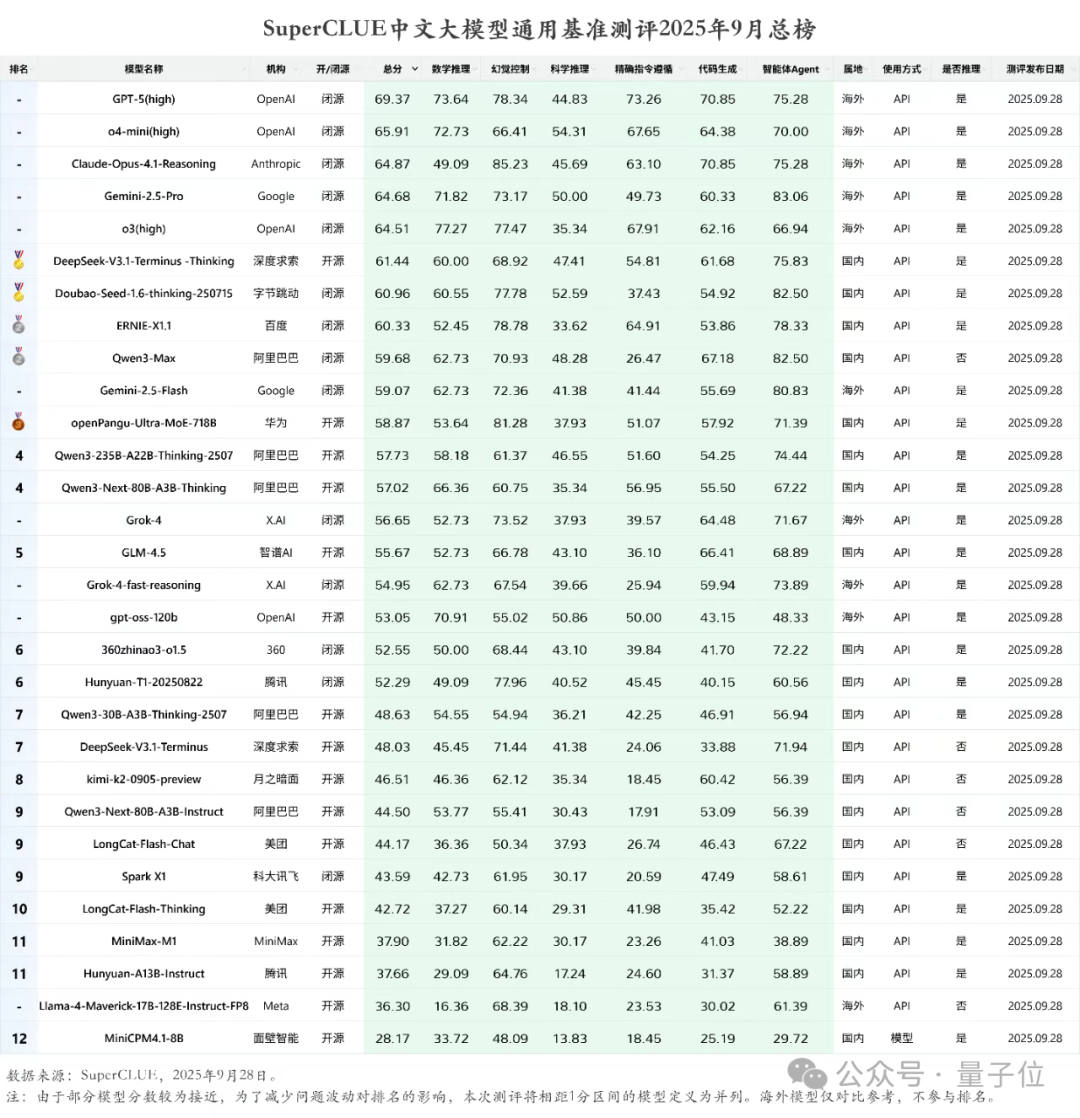

就在最新一期的SuperCLUE中文大模型通用基准测评中,各个AI大模型玩家的成绩新鲜出炉。DeepSeek-V3.1-Terminus-Thinking openPangu-Ultra-MoE-718B Qwen3-235B-A22B-Thinking-2507

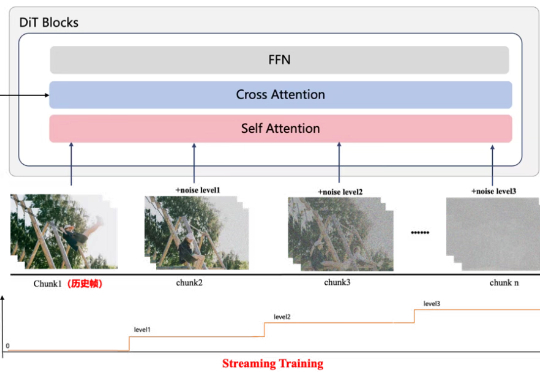

百度杀入 AI 视频生成赛道后,就一直加班加点卷个不停。 7 月初,百度第一次正式官宣蒸汽机 1.0 模型,以极致指令遵循能力惊艳亮相;8 月底,百度又发布全球首个中文音视频一体化模型百度蒸汽机 2.0,实现生成视频中人物口型、表情、动作的毫秒级同步。

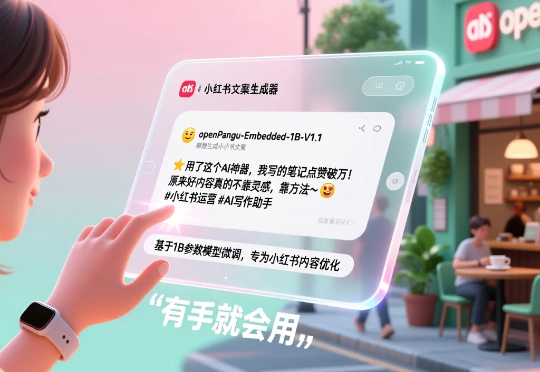

我想聊个反向操作:咱们普通人,如何用有限的资源,轻松驯服一个 AI 模型,让它变成我们专属的垂直领域小能手?主角,就是最近华为刚刚开源的一个大小仅为 1B 的模型 openPangu-Embedded-1B,它不仅全面领先同规格模型,甚至与更大规模的 Qwen3-1.7B 也难分伯仲。

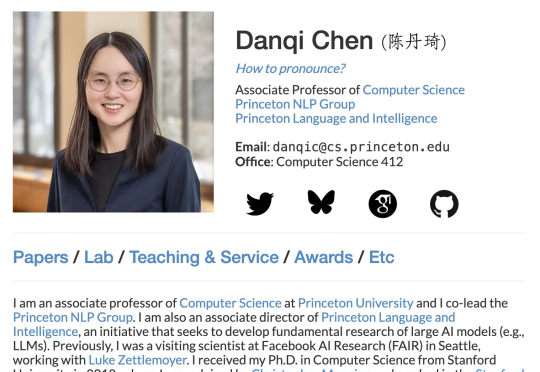

结合RLHF+RLVR,8B小模型就能超越GPT-4o、媲美Claude-3.7-Sonnet。陈丹琦新作来了。他们提出了一个结合RLHF和RLVR优点的方法,RLMT(Reinforcement Learning with Model-rewarded Thinking,基于模型奖励思维的强化学习)。