第一次,多模态大模型学会边看边听,Meta新作性能暴涨113%

第一次,多模态大模型学会边看边听,Meta新作性能暴涨113%Meta联合多所高校发布首个可规模化自动生成第一视角音视频理解数据的引擎EgoAVU ,让多模态大模型首次真正「听懂世界」。

Meta联合多所高校发布首个可规模化自动生成第一视角音视频理解数据的引擎EgoAVU ,让多模态大模型首次真正「听懂世界」。

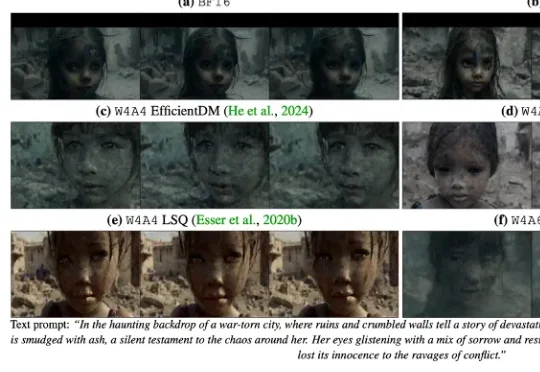

香港科技大学 & 北航 & 商汤等提出了一个专门面向视频生成扩散模型的 QAT 范式 ——QVGen,在 3-bit / 4-bit 都能把质量拉回来,并且让 4-bit 首次接近全精度表现成为现实。该论文现已被 ICLR 高分接收:rebuttal 前 88666(top 1.4%),rebuttal 后 88886 (top 0.5%)。

刚刚,OpenAI表示:他们用尚未发布的内部模型,在一周内尝试解答10道来自数学家科研现场的真实问题,其中有5道被认为基本正确。

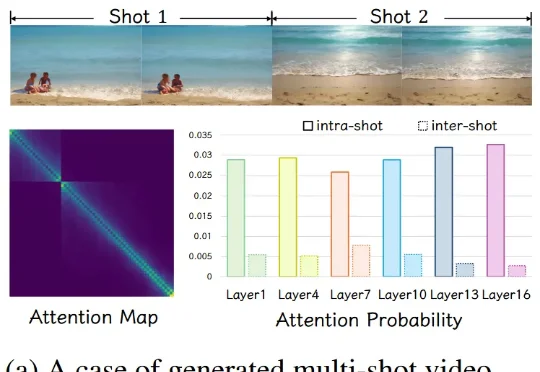

基于对注意力特性的观察,CineTrans 提出块对角掩码的通用机制,使视频生成模型能高效地自动化转场。为了进一步提升转场模型的效果和准确性,作者设计了详细的多镜头视频生产管线,并收集了一个高质量、多镜头数据集 Cine250K,大幅提升多镜头转场视频生成的效果。作为首个时间级可控的自动化转场模型,CineTrans 为这一领域的众多后续方法提供了关键技术。

GeoPT提出了一种全新的动力学提升预训练范式,通过合成动力学(Synthetic Dynamics)将静态几何“提升”到动态空间,让模型在无标签数据上通过学习粒子轨迹演化来获取物理直觉。

2月初,一家名为Lotus Health AI的创业公司宣布完成了4100万美元融资,其中包括3500万美元的A轮融资和此前的种子轮。当这两家机构同时看好一家公司时,通常意味着这家公司正在做一些真正具有变革性的事情。而Lotus Health AI正在做的,就是用AI重新定义初级医疗服务的每一个环节。

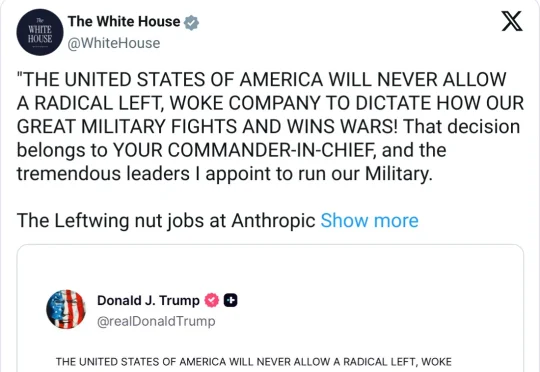

北京时间 2 月 28 日上午 9:24,Anthropic 官方账号发布置顶声明,回应国防部长 Hegseth 的供应链风险标签宣告,这是 Anthropic 在事件公开后的首次正式表态,声明同步挂在 anthropic.com 官网

白宫官方账号于北京时间 2 月 28 日凌晨转发特朗普声明(发布于特朗普自己的媒体 Truth Social),宣布所有联邦机构立即停用 Anthropic 技术,给予六个月过渡期

VUI Labs(宇生月伴)宣布完成数千万元天使+轮融资。本轮投资由同创伟业领投、老股东靖亚资本、小苗朗程持续加注,心流资本FlowCapital担任长期财务顾问。公司半年累计获得近亿元投资,所募资金

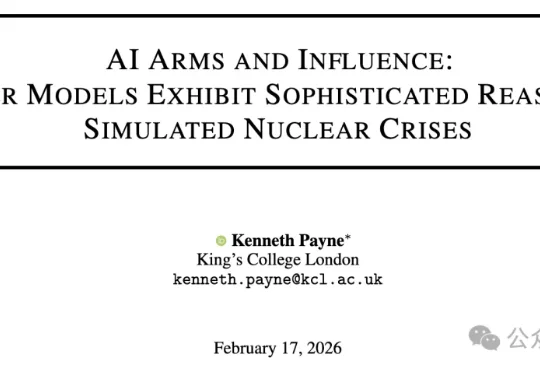

最新 AI 模拟军事博弈揭示致命真相:面对地缘危机,最先进的 AI 在 95% 的对局中按下了核按钮。机器不懂恐惧,拒绝投降,安全协议在压力下全面失效。而五角大楼正将其引入真实指挥室,人类的和平岁月岌岌可危。