Ditto融资920万美金,让AI帮你安排约会,做AI时代的Facebook

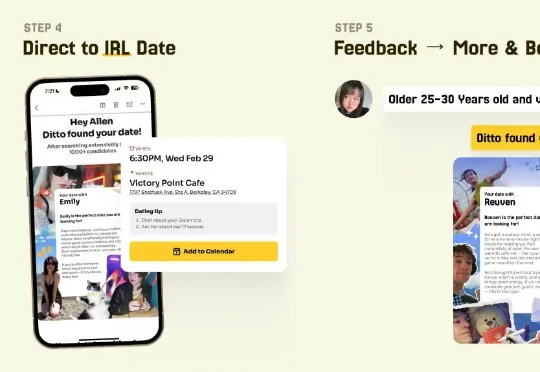

Ditto融资920万美金,让AI帮你安排约会,做AI时代的Facebook当我深入了解Ditto的运作方式后,我发现这不仅仅是一个新的约会服务,而是对整个约会行业商业模式的根本性挑战。传统约会App的商业逻辑是让你尽可能长时间地停留在App上,因为这样才能产生更多广告收入和会员订阅。

当我深入了解Ditto的运作方式后,我发现这不仅仅是一个新的约会服务,而是对整个约会行业商业模式的根本性挑战。传统约会App的商业逻辑是让你尽可能长时间地停留在App上,因为这样才能产生更多广告收入和会员订阅。

从写代码、调模型,到生成内容、驱动产品,AI 正在重新塑造“创造”的方式,也不断逼近一个绕不开的问题:当机器越来越能干,程序员究竟该站在什么位置?

这两天,一款名为Pony Alpha的模型,凭借在Coding能力上的出色表现,一时间成为了AI圈内最火爆的名字。

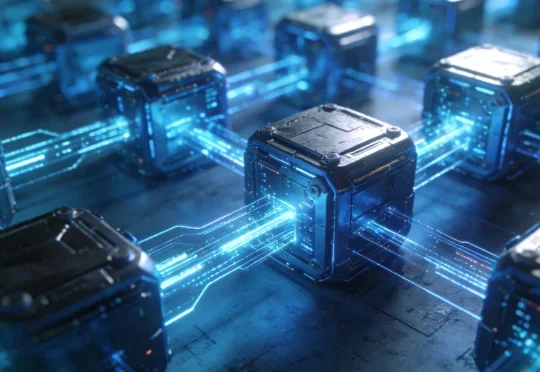

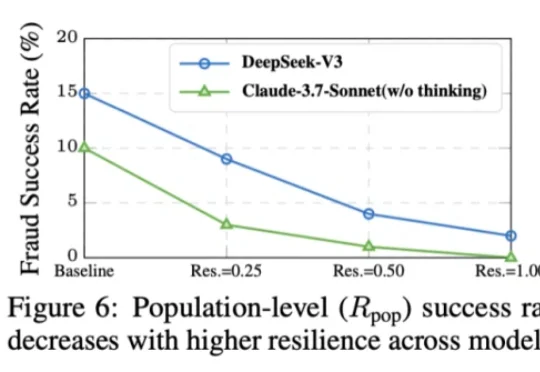

本⽂的主要作者来⾃上海交通⼤学和上海⼈⼯智能实验室,核⼼贡献者包括任麒冰、郑志杰、郭嘉轩,指导⽼师为⻢利庄⽼师和邵婧⽼师,研究⽅向为安全可控⼤模型和智能体。 最近,Moltbook 的爆⽕与随后的迅速

软件行业可能正在经历一场比从命令行到图形界面更剧烈的变革?最近听了一场 a16z 的 David George 分享的关于 AI 市场的深度分析,我被一组数据震撼到了:最快增长的 AI 公司正在以 693% 的年增长率扩张,而他们在销售和营销上的支出却远低于传统软件公司。

谁能想到啊,在自回归模型(Autoregressive,AR)当道的现在,一个非主流架构的模型突然杀了回马枪——被长期视为学术玩具的扩散语言模型,直接在复杂编程任务中飙出了892 tokens/秒的速度!

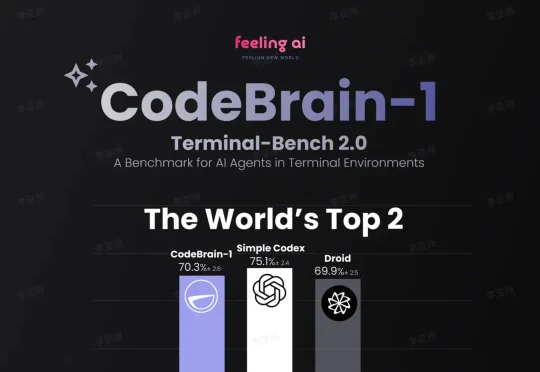

就在这个被 Anthropic 和 OpenAI 视为衡量 Agent 真实工程能力全球权威基准 Terminal-Bench 2.0 榜单上,中国团队 Feeling AI 凭借 CodeBrain-1,搭载最新 GPT-5.3-Codex 底座模型,一举冲到 72.9%(70.3%) 并跻身全球排行榜第二,成为榜单前 10 中唯一的中国团队。

今天,阿里巴巴发布了新一代图像生成基础模型Qwen-Image 2.0,这一模型支持长达一千个token的超长指令、2k分辨率,并采用了更轻量的模型架构,模型尺寸远小于Qwen-Image 2.0的20B,带来更快的推理速度。

不管Pony Alpha是不是智谱的,下一代旗舰大模型GLM-5都要来了。GLM-5采用了DeepSeek-V3/V3.2架构,包括稀疏注意力机制(DSA)和多Token预测(MTP),总参数量745B,是上一代GLM-4.7的2倍。

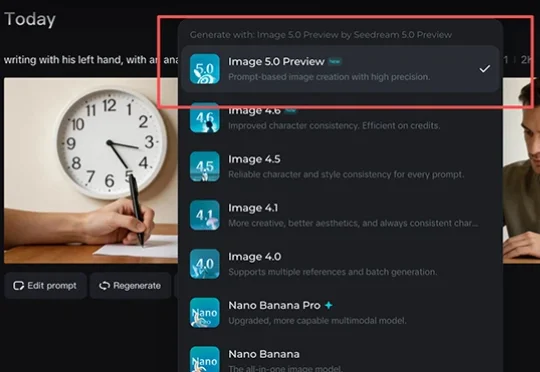

新模型对标Nano Banana Pro,能免费体验。Seedance 2.0的热度还没下去,字节新模型又来了!今日,字节图像生成模型Seedream 5.0 Preview在视频编辑应用剪映、剪映海外版Capcut、字节AI创作平台小云雀均已上线,在即梦AI平台开启灰度测试,图片生成可限时免费体验。