全球AI算力报告出炉,LLM最爱A100!谷歌坐拥超100万H100等效算力

全球AI算力报告出炉,LLM最爱A100!谷歌坐拥超100万H100等效算力全球有多少AI算力?算力增长速度有多快?在这场AI「淘金热」中,都有哪些新「铲子」?AI初创企业Epoch AI发布了最新全球硬件估算报告。

全球有多少AI算力?算力增长速度有多快?在这场AI「淘金热」中,都有哪些新「铲子」?AI初创企业Epoch AI发布了最新全球硬件估算报告。

由无问芯穹与上海交通大学联合研究团队提出的视频生成软硬一体加速器,首次实现通过差分近似和自适应数据流解决 VDiT 生成速度缓慢瓶颈,推理速度相比 A100 提升高达 16.44 倍。

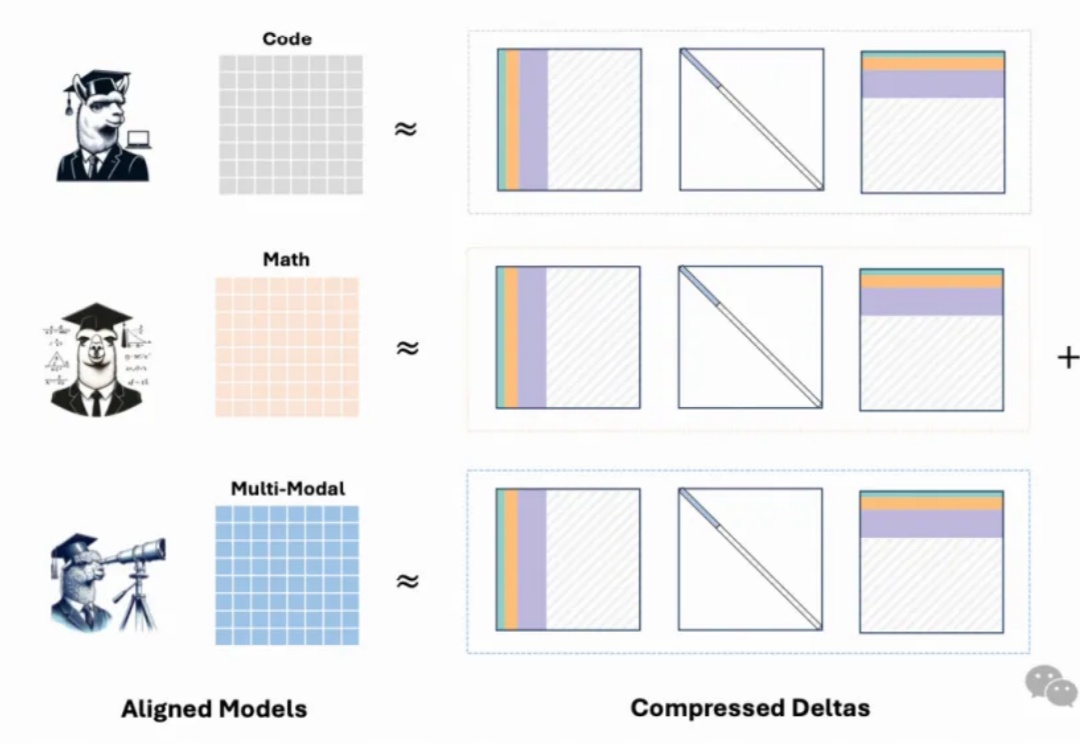

最新模型增量压缩技术,一个80G的A100 GPU能够轻松加载多达50个7B模型,节省显存约8倍,同时模型性能几乎与压缩前的微调模型相当。

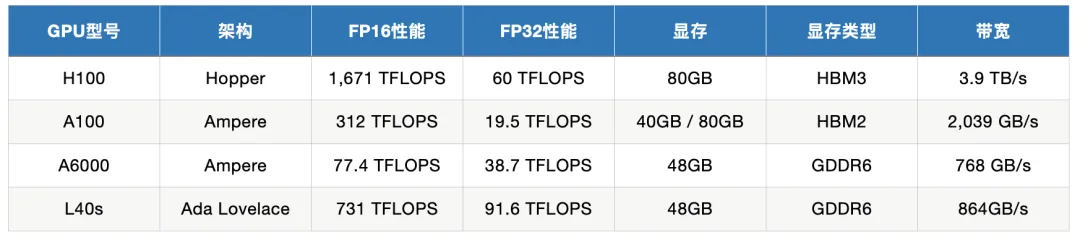

通过深入分析这些 GPU 的性能指标,我们将探讨它们在模型训练和推理任务中的适用场景,以帮助用户在选择适合的 GPU 时做出明智的决策。同时,我们还会给出一些实际有哪些知名的公司或项目在使用这几款 GPU。

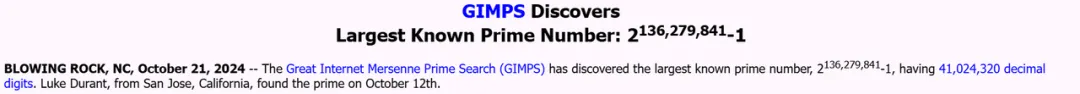

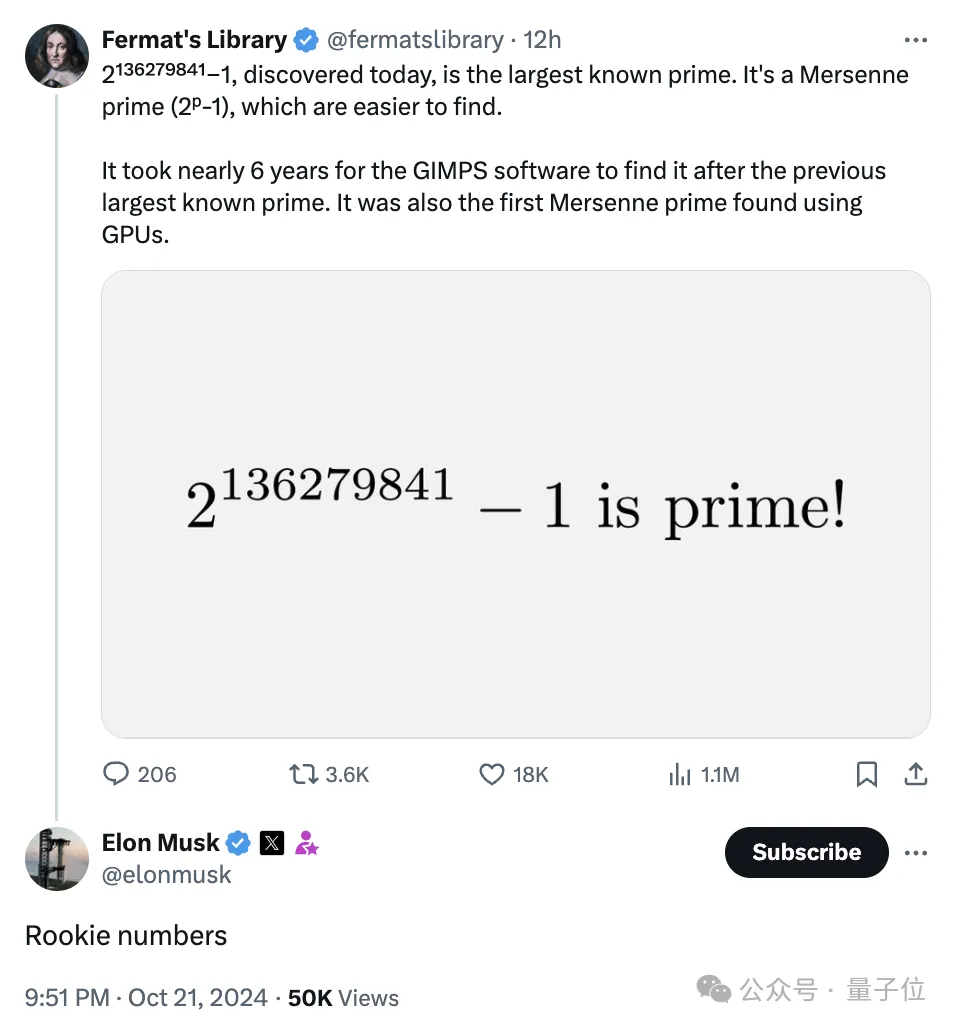

人类已知最大的素数,被GPU发现了!英伟达前员工Luke Durant发现的2136279841-1,比前一个纪录保持者多出1600万位,由A100计算,H100确认。为此,小哥搭了数千个GPU的「云超算」,分布在17个国家。

新的人类已知最大素数,被GPU发现!

自回归解码已经成为了大语言模型(LLMs)的事实标准,大语言模型每次前向计算需要访问它全部的参数,但只能得到一个token,导致其生成昂贵且缓慢。

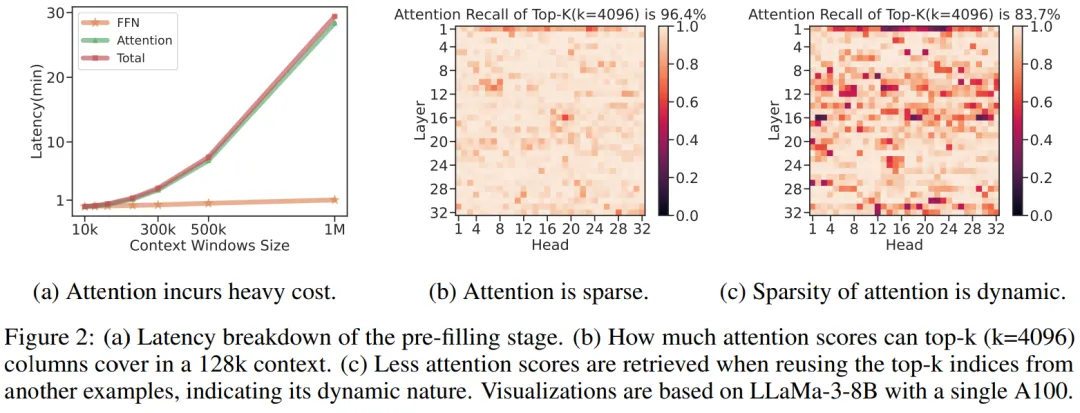

微软的这项研究让开发者可以在单卡机器上以 10 倍的速度处理超过 1M 的输入文本。

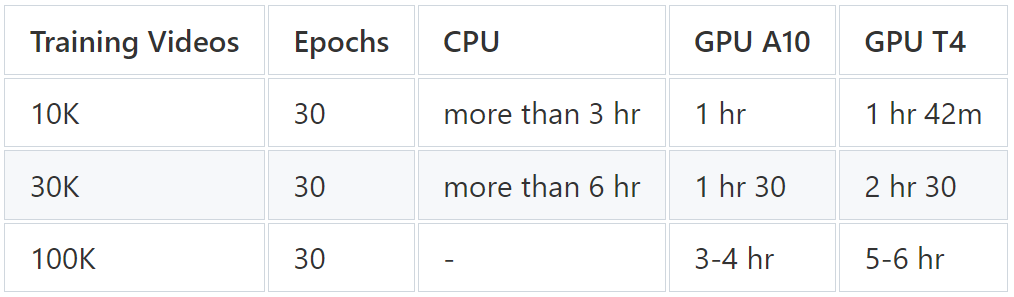

很翔实的一篇教程。

在中文互联网上,英伟达每天都在被颠覆。绝大部分自媒体和短视频达人都讨厌英伟达,包括周鸿祎在内。他们千方百计地指出,某种替代品(不管是不是国产)的性能指标已经超过英伟达A100或H100,后者即将沦为资本市场历史上最大的泡沫云云。尤其是在B站、小红书这样的平台,“英伟达将迅速被替代”可以被视为一致观点,反对这个观点的人将遭到群嘲。