让 AI 从「语言智能」进化到「现实智能」,这家手机公司想得最透彻

让 AI 从「语言智能」进化到「现实智能」,这家手机公司想得最透彻2016 年冬天,荣耀发布了第一代荣耀 Magic 手机和 MagicUI 系统,喊出「致未来」的口号,表示要打开手机的「智慧」之门。

搜索

搜索

2016 年冬天,荣耀发布了第一代荣耀 Magic 手机和 MagicUI 系统,喊出「致未来」的口号,表示要打开手机的「智慧」之门。

Agility 是一家制造用于仓库的人形机器人的公司,正在从投资者那里筹集 1.5 亿美元,知情人士透露,这进一步推动了今年机器人领域的融资激增。

今天这篇,是一个「失败者」的创业故事。 一个先注册了 open.ai 域名,比 Sam Altman 抢先开始 AGI 理念和创业的人,被 OpenAI 起诉,被大家当成了「勒索犯」和「骗子」的故事。

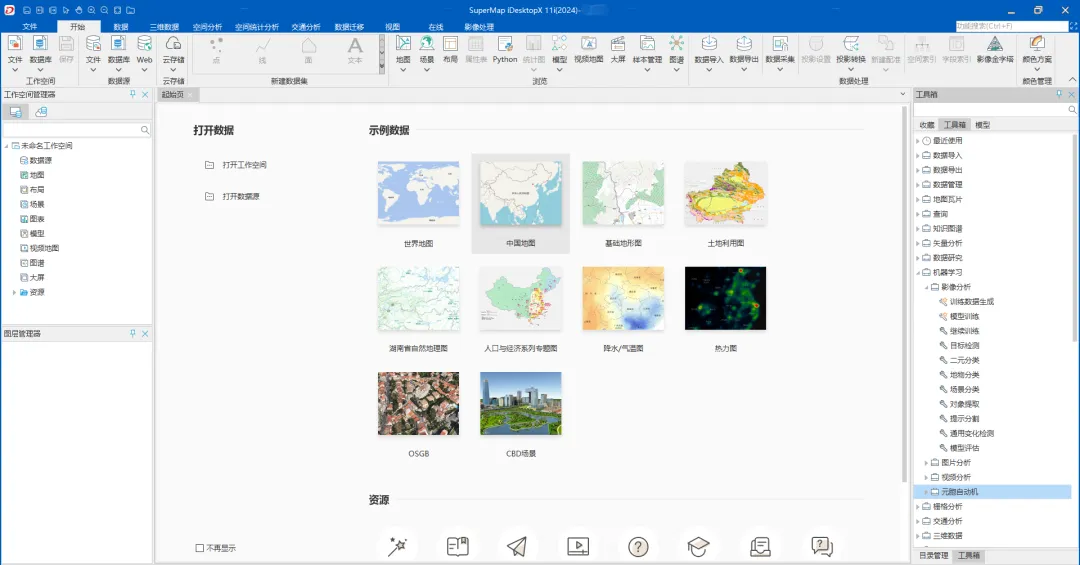

依稀记得十年前,我在上遥感概论专业课时,老师带我们用ERDAS IMAGINE遥感图像处理软件做地物分类,每个人电脑上先发一段区域的遥感影像,进行人工判读和标注,比如把这个区域影像上的林地标注出来喂给模型,再用这个模型去识别另外一个区域影像中的林地,机器学习中典型的的有监督学习应用。

2006年,18年前,雷·库兹韦尔(Ray Kurzweil)在波士顿的人工智能大会上提出了自己的预测:人类将在2029年实现AGI。

Miles Brundage,OpenAI 的长期政策研究员和公司 AGI Readiness 团队的高级顾问,已离职。

最近OpenAI和谷歌放出的多智能体招聘信息,这可能预示着AI开发的下一个阶段。

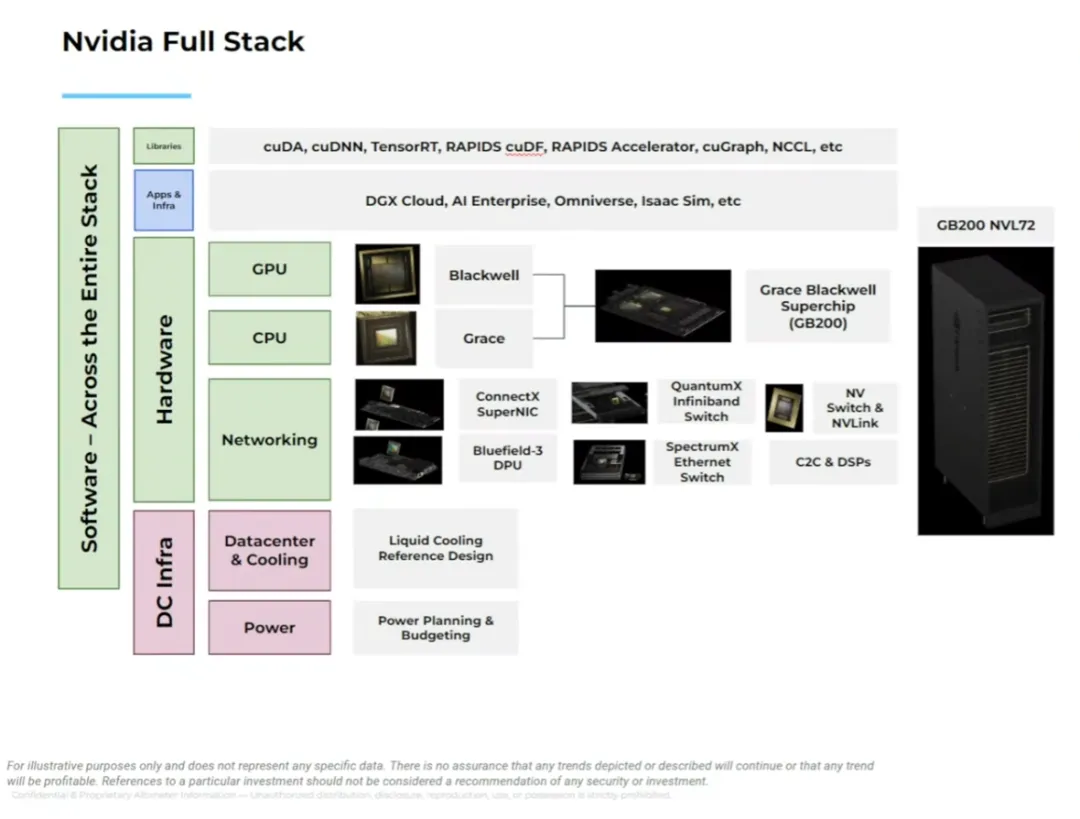

10 月 4 日,播客节目 BG2(Brad Gerstner 和 Clark Tang)邀请到了英伟达 CEO 黄仁勋,他们一起讨论了 AGI、机器学习加速、英伟达的竞争优势、推理与训练的重要性、AI 领域未来的市场动态、AI 对各个行业的影响、工作的未来、AI 提高生产力的潜力、开源与闭源之间的平衡、马斯克的 Memphis 超级集群、X.ai、OpenAI、AI 的安全开发等。

OpenAI前首席科学家、联合创始人Ilya Sutskever曾在多个场合表达观点: 只要能够非常好的预测下一个token,就能帮助人类达到通用人工智能(AGI)。

OpenAI 前首席科学家、联合创始人 Ilya Sutskever 曾在多个场合表达观点:只要能够非常好的预测下一个 token,就能帮助人类达到通用人工智能(AGI)。