对话面壁智能李大海:Scaling Law 之外,大模型的另一条关键路径

对话面壁智能李大海:Scaling Law 之外,大模型的另一条关键路径虽然 OpenAI 反复强调 Scaling Law 是大模型最重要的原则,但事实上,GPT-4 在过去一年里缩小了 10 倍。

虽然 OpenAI 反复强调 Scaling Law 是大模型最重要的原则,但事实上,GPT-4 在过去一年里缩小了 10 倍。

自 OpenAI 的 Q* 项目曝光后,引发业内众多讨论。据现有信息汇总,Q* 项目被视作 OpenAI 在探索人工通用智能(Artificial General Intelligence, AGI)道路上的一次重大尝试,有望在包括数学问题解决能力、自主学习和自我改进等多个层面对人工智能技术带来革新性突破。

我们都生活在 Sam Altman 的时代,但我们都了解 Sam Altman 吗?

具身机器人爆发。

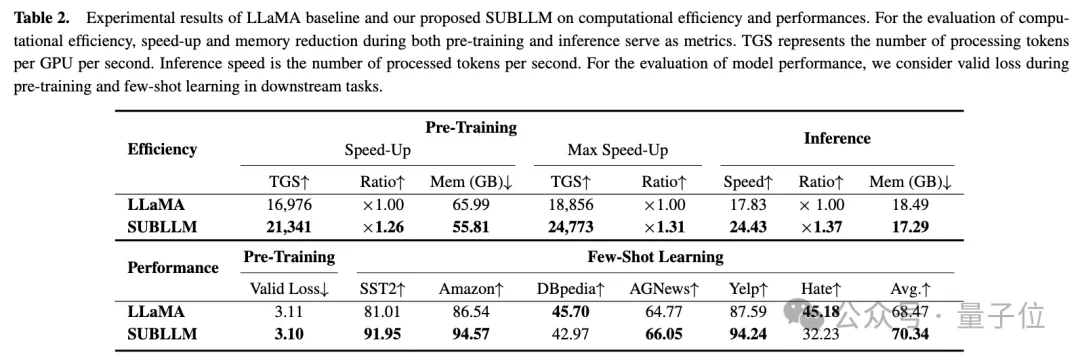

大模型推理速度提升50%以上,还能保证少样本学习性能!

大模型的安全问题正在悄悄逼近。

5月中旬,OpenAI发布了全新的ChatGPT-4o,并邀请初代在线教育顶流可汗教育(Khan Academy)创始人Sal Khan出题、出提示词,让这款全新的4o来教他儿子做几何题。

是时候把数据Scale Down了!Llama 3揭示了这个可怕的事实:数据量从2T增加到15T,就能大力出奇迹,所以要想要有GPT-3到GPT-4的提升,下一代模型至少还要150T的数据。好在,最近有团队从CommonCrawl里洗出了240T数据——现在数据已经不缺了,但你有卡吗?

6月中旬,Iambic Therapeutics宣布完成超额认购的5000万美元B轮融资,由新投资者 Mubadala Capital 和 Exor Ventures 领投,卡塔尔投资局 (QIA) 以及老股东Abingworth、Illumina Ventures、Nexus Venture Partners、Coatue 和 Tao Capital Partners 参投。

纽约大学计算机科学助理教授、图灵奖得主Yann LeCun的学生Alfredo Canziani开新课了!