现金流耗尽之前,OpenAI能否做出GPT-5?Altman暴露7万亿帝国野心,但投资人犹豫了

现金流耗尽之前,OpenAI能否做出GPT-5?Altman暴露7万亿帝国野心,但投资人犹豫了OpenAI这家AI初创公司,是历史上增长最快的公司之一,但它商业模式的长期可行性,仍然存在疑问。烧光现金流之前,OpenAI能交出怎样答卷?

OpenAI这家AI初创公司,是历史上增长最快的公司之一,但它商业模式的长期可行性,仍然存在疑问。烧光现金流之前,OpenAI能交出怎样答卷?

谷歌在语言和声控计算机界面的漫长道路上又迈出了重要一步。最新ScreenAI视觉语言模型,能够完成各种屏幕QA问答、总结摘要等任务。

现在,马斯克起诉OpenAI案的最大未解之谜,就集中在了「Ilya究竟看到了什么」上。他看到的东西,让OpenAI大震荡,所有模型推出计划被削弱和延期。最近网上曝出的一份53页PDF,就透露了Q*的许多重大细节:125万亿参数,去年12月已训完。但马斯克这么一闹,恐怕Q*面世的时间还要大大延迟。

前段时间,种子轮融资3000万美元的日本公司Sakana AI,因为众多亮眼标签,受到很多关注——谷歌科学家、硅谷原班人马、总部扎根东京、小模型……

996作息表爆火后,许多人一定好奇在OpenAI工作究竟是怎样的感受。最近,多位匿名员工在求职网站Glassdoor纷纷对雇主打分评价,高薪却996。最经典的评价是:潜力巨大,但成长烦恼也是真实的。

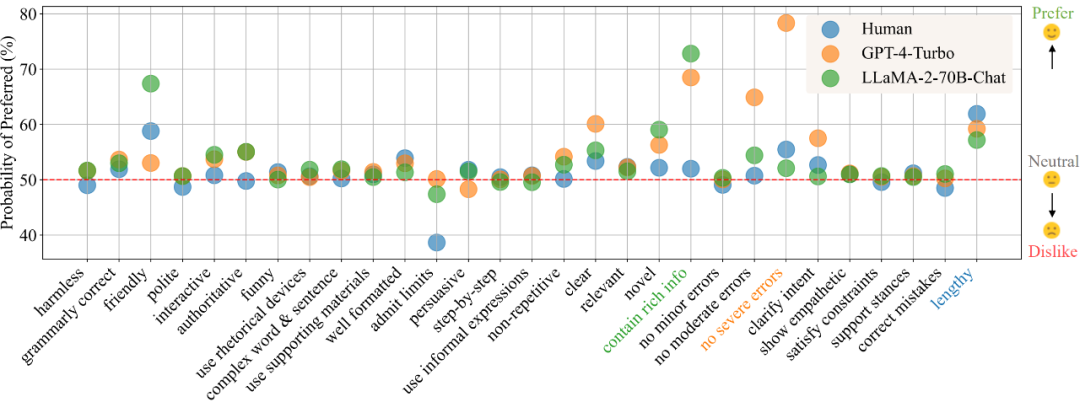

在目前的模型训练范式中,偏好数据的的获取与使用已经成为了不可或缺的一环。在训练中,偏好数据通常被用作对齐(alignment)时的训练优化目标,如基于人类或 AI 反馈的强化学习(RLHF/RLAIF)或者直接偏好优化(DPO),而在模型评估中,由于任务的复杂性且通常没有标准答案,则通常直接以人类标注者或高性能大模型(LLM-as-a-Judge)的偏好标注作为评判标准。

Ideogram凭借不输Midjourney的生图能力和遥遥领先的图片中文字渲染能力,获得了包括Jeff Dean和Karpathy在内一众大佬的8000万美元融资,文生图这条离钱最近的AI赛道又加入了一名重量级选手。

2023 年我们正见证着多模态大模型的跨越式发展,多模态大语言模型(MLLM)已经在文本、代码、图像、视频等多模态内容处理方面表现出了空前的能力,成为技术新浪潮。以 Llama 2,Mixtral 为代表的大语言模型(LLM),以 GPT-4、Gemini、LLaVA 为代表的多模态大语言模型跨越式发展。

All in AI的魅族,马上就带来具体新动作了。

本文提出了扩散模型中UNet的long skip connection的scaling操作可以有助于模型稳定训练的分析,目前已被NeurIPS 2023录用。同时,该分析还可以解释扩散模型中常用但未知原理的1/√2 scaling操作能加速训练的现象。