微软 vs AWS vs 谷歌,谁将赢得AI云竞赛?

微软 vs AWS vs 谷歌,谁将赢得AI云竞赛?当CEO谈论AI时,他们的团队会开始部署云端AI技术。

当CEO谈论AI时,他们的团队会开始部署云端AI技术。

2024年6月,Matt Garman接任AWS的首席执行官,成为该公司第三任掌门人。Matt将带领AWS继续在全球云计算和人工智能领域的竞争中保持领先地位。亚马逊总裁兼首席执行官Andy Jassy对Matt的出色履历给予高度评价,称其具备非凡的领导能力和丰富的经验,能够引领AWS迈向新的高度。

非凡产研为大家整理编辑了近期微软CTO凯文·斯科特(Kevin Scott)接受红杉资本、Stratechery 采访回应关于大模型scaling laws、人工智能平台转变等焦点话题的精华内容。

在微软的Copilot GPTs成为历史、OpenAI的GPT Store一地鸡毛之后,AI的App Store时刻似乎还只是一个梦想。然而App Store所取得的商业成绩过于耀眼,即便OpenAI和微软都没能成功,但依然有厂商相信自己会是成功者。日前在AWS方面举行的纽约峰会上,该公司正式发布了Amazon Q Apps,允许用户构建自己的AIGC应用。

Scaling Laws当道,但随着大模型应用的发展,基础模型不断扩大的参数也成了令开发者们头疼的问题。

只需几分钟、一张图或一句话,就能完成时空一致的4D内容生成。

在 AI 领域,扩展定律(Scaling laws)是理解 LM 扩展趋势的强大工具,其为广大研究者提供了一个准则,该定律在理解语言模型的性能如何随规模变化提供了一个重要指导。

过去几年,借助Scaling Laws的魔力,预训练的数据集不断增大,使得大模型的参数量也可以越做越大,从五年前的数十亿参数已经成长到今天的万亿级,在各个自然语言处理任务上的性能也越来越好。

“中国有世界上最好最优秀的B端和C端市场,把做AI应用的门槛和成本降下来,就会激发出更大的产业应用空间。”

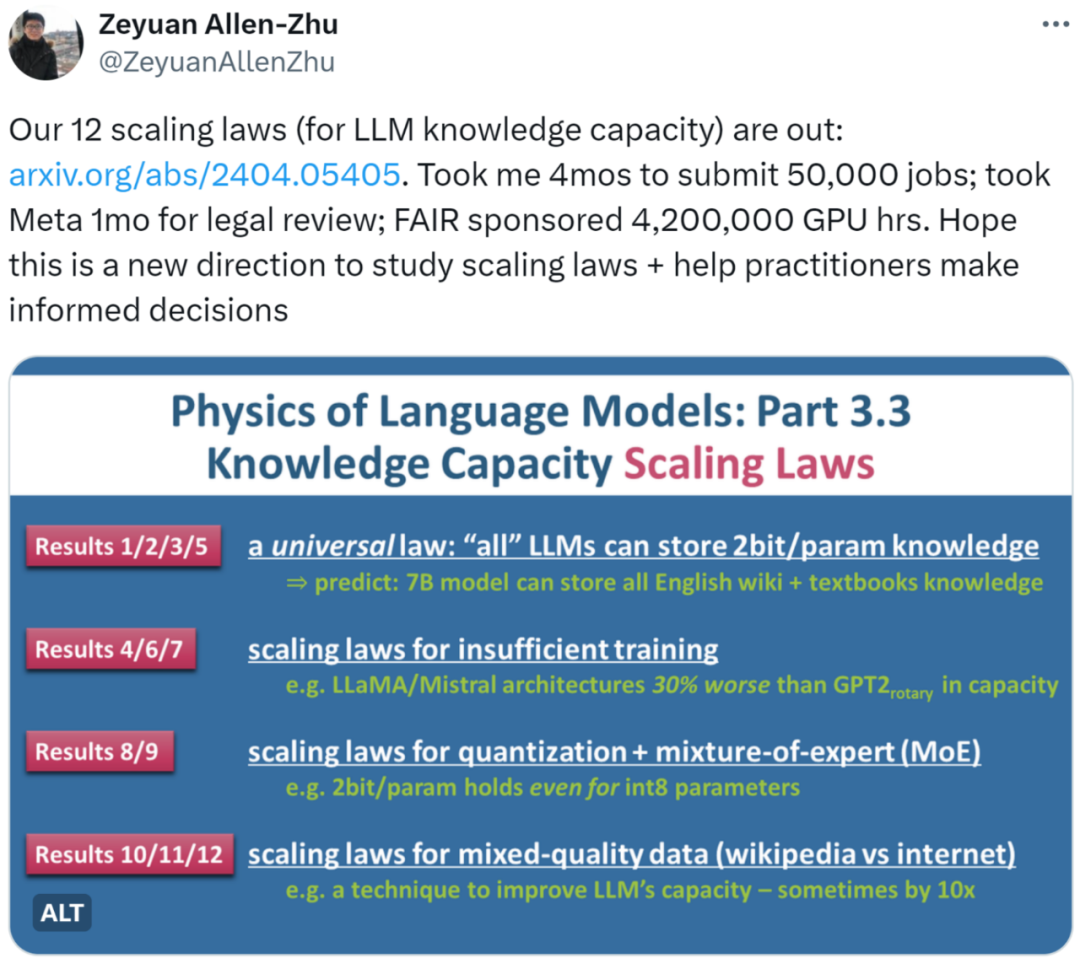

近日,朱泽园 (Meta AI) 和李远志 (MBZUAI) 的最新研究《语言模型物理学 Part 3.3:知识的 Scaling Laws》用海量实验(50,000 条任务,总计 4,200,000 GPU 小时)总结了 12 条定律,为 LLM 在不同条件下的知识容量提供了较为精确的计量方法。