晚点独家丨快手计划分拆可灵 AI,融资 20 亿美元参与

晚点独家丨快手计划分拆可灵 AI,融资 20 亿美元参与快手计划分拆旗下视频生成大模型业务可灵 AI,以 200 亿美元估值融资——截至今天港股收盘,整个快手公司目前的市值不到 290 亿美元。可灵当前的年化收入(ARR)已经达到 5 亿美元,已比春节前翻倍。

搜索

搜索

快手计划分拆旗下视频生成大模型业务可灵 AI,以 200 亿美元估值融资——截至今天港股收盘,整个快手公司目前的市值不到 290 亿美元。可灵当前的年化收入(ARR)已经达到 5 亿美元,已比春节前翻倍。

这是一个“等待被大厂吞没”的行业,还是可能长出像Adobe那样的工具型公司?

上周,我们在热爱远识资本的文章中提到了其代表作:仅靠demo就能实现13.2亿美金估值的Vivix。

AI圈有个怪现象: 模型越来越强,确实是好事;但随着AI用法越发多样,用起来的门槛却越来越高。

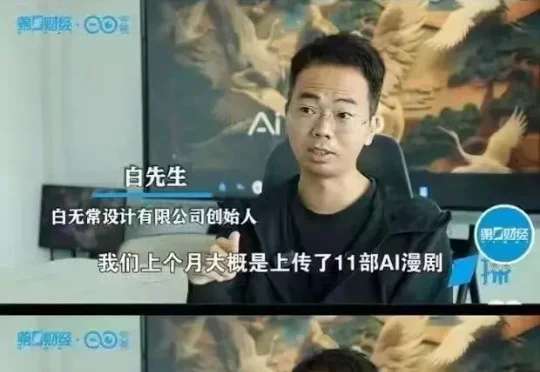

日前,有短剧从业者白先生接受第一财经采访时表示,上个月在平台上传了11部AI漫剧,每部大概16集,总共收益9块6。这位白先生并非籍籍无名,而是设计圈公认的大神“白无常”,无论从AI技术还是艺术审美来看,都绝非行业小白。由此可见,被大炒特炒的AI漫剧,市场竞争实际上极为惨烈。

3 月 30 日,爱奇艺正式官宣发布的专业级影视制作平台纳逗 Pro,正是其中代表。通过将行业领先基座模型与爱奇艺深耕多年的影视内容制作经验深度结合,纳逗 Pro 直接将目标对准了电视剧、院线级内容从剧本生成、分镜设计到成片输出的创作全流程。

Shade 完成了 1400 万美元 融资。本轮由 Khosla Ventures、Construct Capital 与 Bling Capital 共同领投,公司累计融资达到 2000 万美元。如果只看功能,这是一个支持自然语言搜索视频素材的存储工具;但从更底层来看,它试图重写的是一个更基础的前提——内容在组织内部是如何存在、被理解以及被再次使用的。

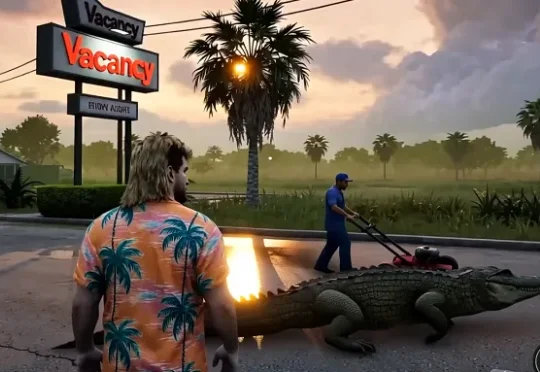

两天前,Creati AI推出了新产品Buzzy。Buzzy是一个专门做视频修改的AI Agent。用户可以对视频说“把这个人换成我的脸”“把阴天变成黄昏”“去掉背景里的路人”,局部修改,其他不动。几乎同时,公司官宣了由红点领投的B轮融资,金额高达2000万美元。

今天,阿里ATH创新事业部的最新视频生成与编辑模型HappyHorse 1.0(官方译名:快乐小马)开启灰度测试。创作者可在阿里云百炼平台和HappyHorse官网注册使用,大众用户可在千问App中体验。

海外短剧赛道跑了两年多,头部格局已经形成。ReelShort 2025 全年应用内购收入收入约 5-6 亿美元,DramaBox 紧随其后,两家合计拿下海外市场近大半份额。再往上看,Netflix 超过 60% 的内容是自制,其余 30%—40% 靠版权采购填充。