对话 Haivivi 李勇:用 AI 做 Jellycat,如何单月营收千万

对话 Haivivi 李勇:用 AI 做 Jellycat,如何单月营收千万2024 年 9 月,我们第一次去 Haivivi 北京办公室和 CEO 李勇见面。在交谈的两小时里,他不断被会议室外的员工提醒看手机。

搜索

搜索

2024 年 9 月,我们第一次去 Haivivi 北京办公室和 CEO 李勇见面。在交谈的两小时里,他不断被会议室外的员工提醒看手机。

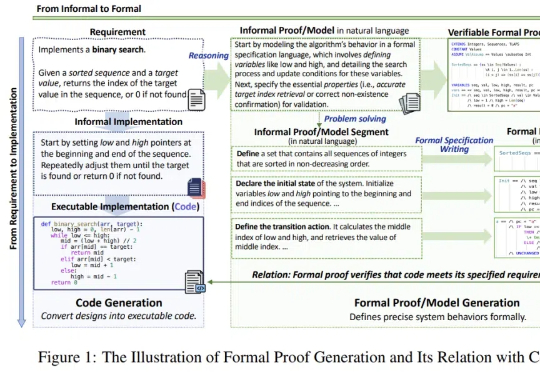

随着 DeepSeek-R1 的流行与 AI4Math 研究的深入,大模型在辅助形式化证明写作方面的需求日益增长。作为数学推理最直接的应用场景,形式化推理与验证(formal reasoning and verification),也获得持续关注。

去年 8 月,Codeium 完成了由 General Catalyst、Kleiner Perkins 等参与的 1.5 亿美元融资,估值来到 12.5 亿美元,是这些老牌基金在 AI Coding 领域下的重注。之后在 11 月 Codeium 正式发布了 Agentic IDE Windsurf,与 Cursor/Devin 进行差异化竞争。

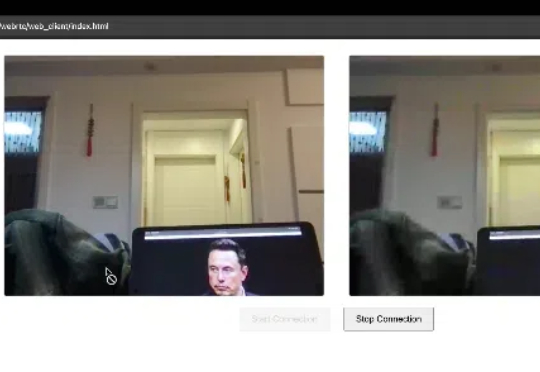

WebRTC(Web Real-Time Communication)是一个Google开源项目,允许浏览器/移动端直接进行实时音视频流传输,典型应用场景:视频会议、屏幕共享、文件传输、远程控制。

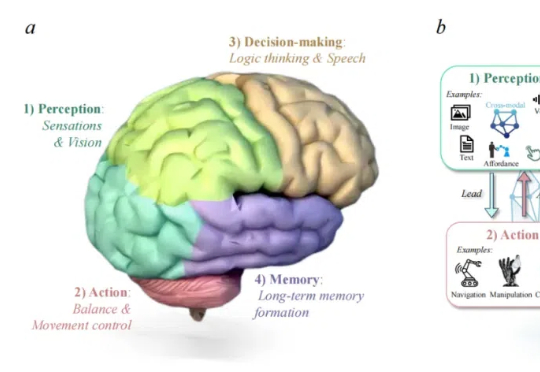

由港科广、中南、西湖大学、UIUC、新加坡国立大学、上海 AI Lab、宾夕法尼亚大学等团队联合发布的首篇聚焦医疗领域具身智能的综述论文《A Survey of Embodied AI in Healthcare: Techniques, Applications, and Opportunities》正式上线,中南大学刘艺灏为第一作者

科技媒体 testingcatalog 今天(1 月 27 日)发布博文,报道称 xAI 官方虽然尚未公布,但 Grok-3 已短暂现身独立平台和 X 平台,开启内部测试,有望下周正式发布。

据 The Information 报道,总部位于旧金山的 AI 软件测试公司 Ranger 在 12 月获得了由General Catalyst领投的 650 万美元种子轮融资,以及在 2023 年 11 月获得的由XYZ领投的 240 万美元前种子轮融资。

LLM 强大的语言能力,使其被广泛部署于 LLM 应用系统(LLM-integrated applications)中。此时,LLM 需要访问外部数据(如文件,网页,API 返回值)来完成任务。

不是Jellycat买不起,而是AI生成更有性价比图片。 最近,美团“妙刷AI”上线了一个让万物Jellycat化的玩法。只要上传一张照片,AI就能自动识图,把照片主体变成Jellycat玩偶,并附上玩偶名、价格和一份抽象的养护指南。

缺少陪伴的年轻人,疯抢AI宠物