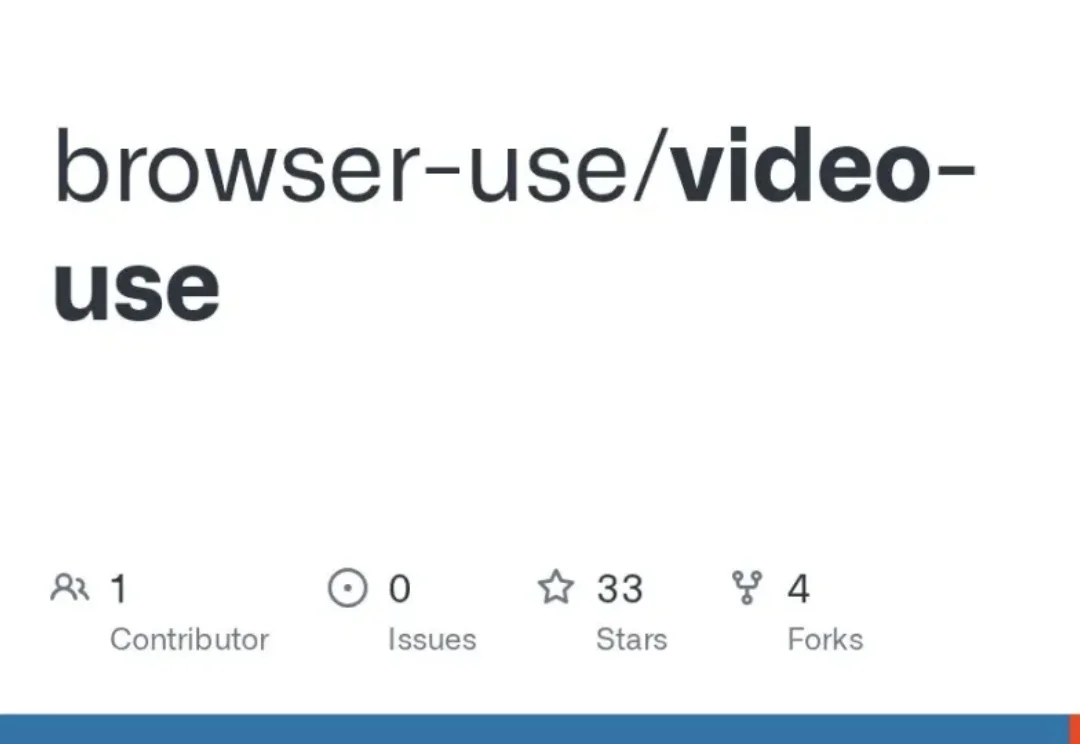

用Claude Code剪视频,自动去口癖、加字幕、调色,完全免费开源

用Claude Code剪视频,自动去口癖、加字幕、调色,完全免费开源browser-use 团队最近开源了一个叫 video-use 的 Claude Code 技能。

browser-use 团队最近开源了一个叫 video-use 的 Claude Code 技能。

4月21日,OpenAI正式上线Chronicle研究预览版。Chronicle藏在Codex平台里,但它干的事跟写代码没半毛钱关系。它在后台默默运行,持续读取你的屏幕内容、你打开的文件、你浏览的网页、你写到一半的文档。

2026年初,当大多数企业还在用数据分析师手动写SQL查表时,OpenAI内部曝光的能自主思考、推理甚至自我进化的数据分析智能体,将数据查询从「天数级」缩短至「分钟级」。

今天,我们发布并开源 Kimi K2.6 模型,带来行业领先(state-of-the-art)的代码、长程任务执行和 Agent 集群能力。Kimi K2.6 现已上线 kimi.com、最新版 Kimi 应用、Kimi API 和 Kimi Code 编程助手,所有用户都可以开始使用。

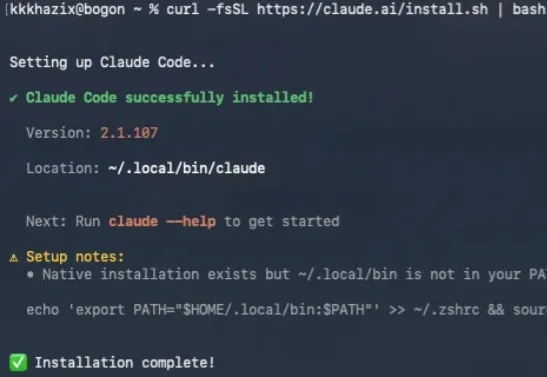

最近很多朋友都在问我,能不能出一期Claude Code的小白教程。

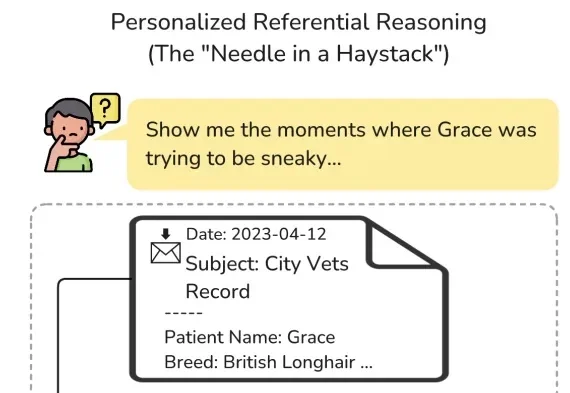

ATM-Bench 将「个人 AI 助手是否真的记得你」这件事,变成了一个研究的测试基准。结果并不乐观:专用记忆智能体系统普遍低于 20%,而 OpenClaw、Codex、Claude Code 等通用智能体普遍表现不佳,最高准确率不到 40%。

最近几个月,Vibe Coding(氛围编程)是一大刷屏热词。以 Cursor 和 Claude Code 为代表的一批工具,正在将软件开发效率推向新的高度。

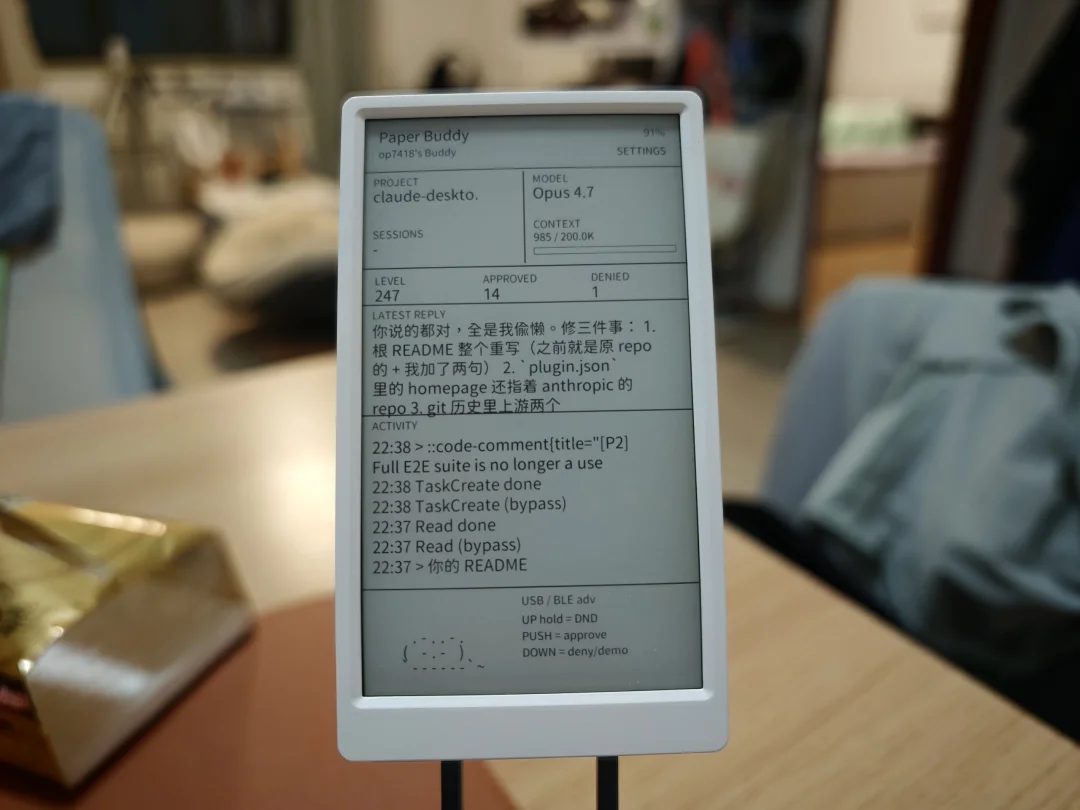

前几天,Anthropic 开源了 claude-desktop-buddy,用一块小屏幕显示 Claude Code 里 Buddy 的状态。结果做着做着,它变成了一个完全不同的东西:M5 Paper Buddy (https://github.com/op7418/m5-paper-buddy)。

过去这半年,AI 圈有个变化特别扎眼:它不再只是能写几行代码,而是开始试图接管整个开发流程,从拆需求、推架构到写代码、修 Bug,一整条链路都在被重塑。过去我们评价一款 AI 编程工具,问的是它能写多少代码?写得够不够好?而现在,大家更关心的是它能不能把事情做完?用起来够不够省心。

最近,Claude Code 团队工程师 Thariq Shihipar又在X上发文了,上个月他写的Skill深度经验分享贴在社交平台爆火,这周他又发了一篇Claude的100万toke上下文窗口使用技巧的文章,平台阅读量已超过200万。