实测13个类Sora视频生成模型,8000多个案例,一次看个够

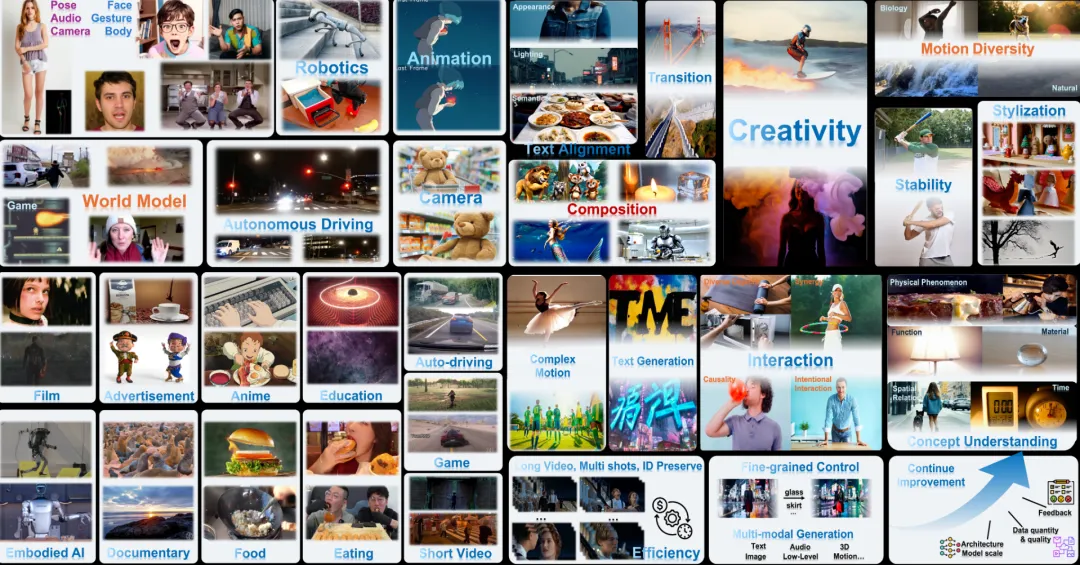

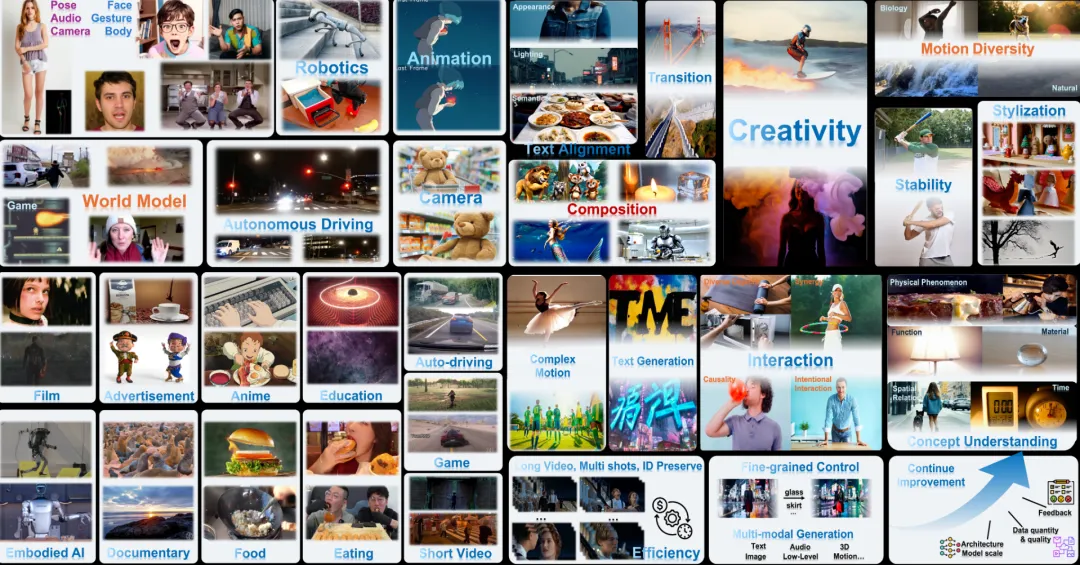

实测13个类Sora视频生成模型,8000多个案例,一次看个够腾讯 AI Lab 联合中科大发布了一份针对类 SORA 视频生成模型的测评报告,重点聚焦目前最前沿的类 SORA DiT 架构的高质量视频生成闭源模型

腾讯 AI Lab 联合中科大发布了一份针对类 SORA 视频生成模型的测评报告,重点聚焦目前最前沿的类 SORA DiT 架构的高质量视频生成闭源模型

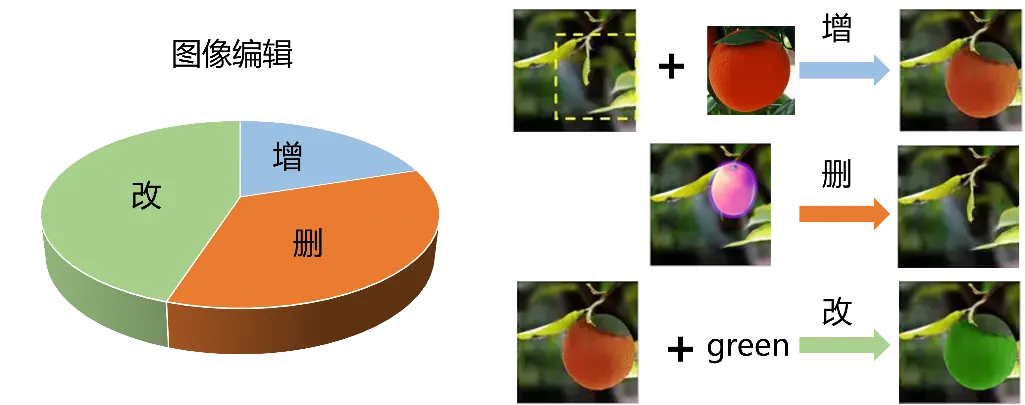

在AIGC 的浪潮中,对已有图片做编辑的图像编辑(image editing)技术受到了越来越多的关注。图像编辑(image editing)的原子操作包括增、删、改。

本期AGI路线图中关键节点:DiT架构、Stable Diffusion 3.0、Flux.1、ControlNet、1024×1024分辨率、医学影像、英伟达Eagle模型、谷歌Med-Gemini系列模型、GPT-4o端到端、Meta Transfusion模型。

视频生成模型大乱斗

Transformer计算,竟然直接优化到乘法运算了。MIT两位华人学者近期发表的一篇论文提出:Addition is All You Need,让LLM的能耗最高降低95%。

在OpenAI Sora的主要技术负责人跑去Google、多个报道指出OpenAI Sora在内部因质量问题而导致难产的节骨眼,Meta毫不客气发了它的视频模型“Movie Gen”,并直接用一个完整的评测体系宣告自己打败了Sora们。

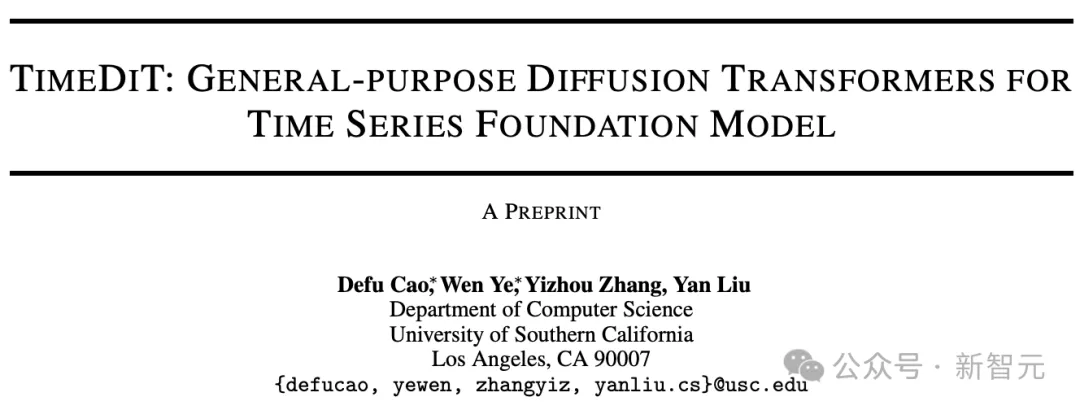

随着近年来在文本和视频数据上构建基础模型的进展,学术界对时间序列的基础模型也表现出浓厚的兴趣。 时间序列分析在许多关键领域中具有重要性,能够影响从科学研究到经济决策的广泛应用。

机器人做家务,轮式“跑”不过腿。 虽然逛完世界机器人大会后,部分投资人对腾讯科技表示,在人形机器人赛道“一个也不想投了”,但看到OpenAI投资的人形机器人公司1X生产的NEO机器人后,他们竟又开始有信心了。

智东西8月29日消息,瑞士轮腿式机器人创企Swiss-Mile今日宣布获得2200万美元种子轮融资,由亚马逊创始人杰夫·贝佐斯(Jeff Bezos)通过贝佐斯探险基金(Bezos Expeditions)和红杉资本领投,亚马逊产业创新基金、舰队投资(Armada Investment)以及现有投资者线性资本(Linear Capital)跟投。

在 ECCV 2024 中,来自南洋理工大学 S-Lab、上海 AI Lab 以及北京大学的研究者提出了一种原生 3D LDM 生成框架。